Generalizable End-to-End Tool-Use RL with Synthetic CodeGym

作者: Weihua Du, Hailei Gong, Zhan Ling, Kang Liu, Lingfeng Shen, Xuesong Yao, Yufei Xu, Dingyuan Shi, Yiming Yang, Jiecao Chen

分类: cs.LG, cs.AI, cs.CL

发布日期: 2025-09-22

备注: 22 pages. Project available at https://github.com/StigLidu/CodeGym

💡 一句话要点

提出CodeGym,用于训练通用端到端工具使用强化学习LLM Agent。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 工具使用 强化学习 LLM Agent 代码生成 环境合成

📋 核心要点

- 现有工具增强型LLM Agent训练依赖静态轨迹的监督微调或狭窄任务的强化学习,泛化能力差。

- CodeGym将静态编码问题转化为交互式环境,提取原子函数为可调用工具,构建可验证的多样化任务。

- 实验表明,在CodeGym训练的模型具有良好的分布外泛化能力,例如Qwen2.5-32B-Instruct在$τ$-Bench上提升显著。

📝 摘要(中文)

本文提出CodeGym,一个可扩展的框架,用于合成多样、可验证和可控的多轮工具使用环境,以进行Agent强化学习,使LLM Agent能够主动探索和掌握各种工作流程。CodeGym通过将静态编码问题重写为交互式环境来实现这一点,方法是将原子函数或逻辑提取到可调用的工具中,从而产生跨越各种工具执行工作流程的可验证任务。在CodeGym中训练的不同大小和思维链配置的模型表现出一致的分布外泛化能力。例如,Qwen2.5-32B-Instruct在OOD基准$τ$-Bench上实现了8.7个百分点的绝对精度提升。这些结果表明,CodeGym是朝着可扩展的通用RL环境迈出的一步,该环境与实际Agent工作流程相一致。

🔬 方法详解

问题定义:现有工具增强型LLM Agent的训练方法,如监督微调(SFT)和强化学习(RL),在静态数据集或特定任务上进行,导致模型在新工具和未见工作流程中表现出脆弱性,泛化能力不足。缺乏一个能够模拟真实世界Agent工作流程的可扩展、多样化的训练环境。

核心思路:利用代码执行反映真实世界工作流程的结构这一特性,将编码问题作为构建Agent训练环境的基础。通过将静态编码问题转化为交互式环境,并提取原子函数或逻辑作为可调用工具,从而创建多样化、可验证和可控的工具使用环境,使Agent能够主动探索和学习各种工作流程。

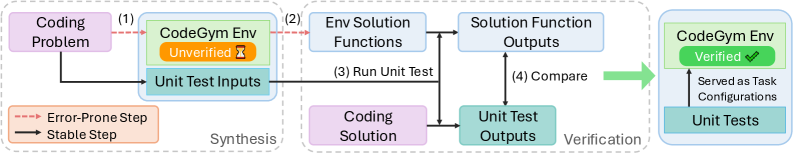

技术框架:CodeGym框架主要包含以下几个核心组成部分:1) 静态编码问题库:作为生成交互式环境的基础。2) 工具提取模块:将静态编码问题中的原子函数或逻辑提取为可调用的工具。3) 环境生成器:根据提取的工具和原始编码问题,生成交互式的多轮工具使用环境。4) Agent训练模块:使用强化学习算法,在生成的环境中训练LLM Agent,使其学习如何有效地使用工具解决问题。

关键创新:CodeGym的关键创新在于其能够自动生成多样化、可验证和可控的工具使用环境。与以往依赖人工标注或静态数据集的方法不同,CodeGym通过程序化的方式生成环境,从而实现了环境的可扩展性和多样性。此外,CodeGym还提供了可验证的任务,确保Agent学习到的技能是有效的。

关键设计:CodeGym的环境生成器需要精心设计,以确保生成的环境既具有挑战性,又不会过于复杂,从而保证Agent能够有效地学习。具体来说,需要控制提取的工具的数量和复杂度,以及任务的难度。此外,强化学习算法的选择和超参数的调整也至关重要,需要根据具体的任务和Agent模型进行优化。论文中可能使用了特定的奖励函数来引导Agent学习,具体细节未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,在CodeGym中训练的LLM Agent具有显著的分布外泛化能力。例如,Qwen2.5-32B-Instruct模型在OOD基准$τ$-Bench上实现了8.7个百分点的绝对精度提升。这表明CodeGym能够有效地提升LLM Agent在未见任务上的表现,验证了该框架的有效性。

🎯 应用场景

该研究成果可应用于各种需要LLM Agent与外部工具交互的场景,例如智能客服、自动化运维、科学研究等。通过在CodeGym中训练,可以提升LLM Agent在真实世界任务中的泛化能力和鲁棒性,使其能够更好地适应新的工具和工作流程,降低部署和维护成本。

📄 摘要(原文)

Tool-augmented large language models (LLMs), hereafter LLM agents, leverage external tools to solve diverse tasks and interface with the real world. However, current training practices largely rely on supervised fine-tuning (SFT) over static trajectories or reinforcement learning (RL) on narrow tasks, and generalize poorly beyond development settings, leading to brittleness with new tools and unseen workflows. Because code execution reflects many structures of real-world workflows, coding problems provide a natural basis for building agent training environments. Motivated by this, we introduce CodeGym, a scalable framework that synthesizes diverse, verifiable, and controllable multi-turn tool-use environments for agent RL, enabling LLM agents to explore and master various workflows actively. CodeGym rewrites static coding problems into interactive environments by extracting atomic functions or logic into callable tools, yielding verifiable tasks that span various tool-execution workflows. Models of varying sizes and chain-of-thought configurations, trained in CodeGym, exhibit consistent out-of-distribution generalizability; for example, Qwen2.5-32B-Instruct achieves an absolute accuracy gain of 8.7 points on the OOD benchmark $τ$-Bench. These results highlight CodeGym as a step toward scalable general-purpose RL environments that align with real-world agent workflows.