Physics-Informed Operator Learning for Hemodynamic Modeling

作者: Ryan Chappell, Chayan Banerjee, Kien Nguyen, Clinton Fookes

分类: cs.LG, eess.SP

发布日期: 2025-09-22

备注: To appear in the proceedings of DICTA 2025

💡 一句话要点

提出基于物理信息的算子学习方法,用于高效准确的血流动力学建模。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 物理信息神经网络 算子学习 知识蒸馏 血流动力学建模 心血管监测

📋 核心要点

- 现有PINN方法建模心血管动力学依赖复杂架构和训练策略,导致可扩展性和部署受限。

- 提出利用物理信息算子学习,预训练DeepONet作为监督信号,指导简化模型训练,降低复杂度。

- 实验表明,该方法在保持性能的同时,显著降低了模型复杂度和训练开销,提升了实用性。

📝 摘要(中文)

精准的个性化心血管动力学建模对于无创监测和治疗计划至关重要。目前先进的基于物理信息的神经网络(PINN)方法采用深度多分支架构,结合对抗或对比目标来强制满足偏微分方程约束。尽管有效,这些增强引入了显著的训练和实现复杂性,限制了可扩展性和实际部署。我们研究了基于物理信息的神经算子学习模型,将其作为高效的监督信号,通过知识蒸馏训练简化的架构。我们的方法预训练一个基于物理信息的DeepONet(PI-DeepONet),利用高保真无袖带血压记录,学习从原始可穿戴波形到心跳间压力信号的算子映射,同时嵌入物理约束。这个预训练的算子在轻量级的知识蒸馏流程中充当冻结的监督者,指导精简的基础模型,消除了复杂的对抗和对比学习组件,同时保持性能。我们描述了物理信息正则化在算子学习中的作用,并证明了其对监督指导的有效性。通过广泛的实验,我们的算子监督方法实现了与复杂基线相当的性能(相关性:0.766 vs. 0.770,RMSE:4.452 vs. 4.501),同时显著降低了架构复杂性,从八个关键超参数减少到一个正则化系数,并将训练开销降低了4%。我们的结果表明,基于算子的监督有效地取代了复杂的多组件训练策略,提供了一种更具可扩展性和可解释性的生理建模方法,并降低了实现负担。

🔬 方法详解

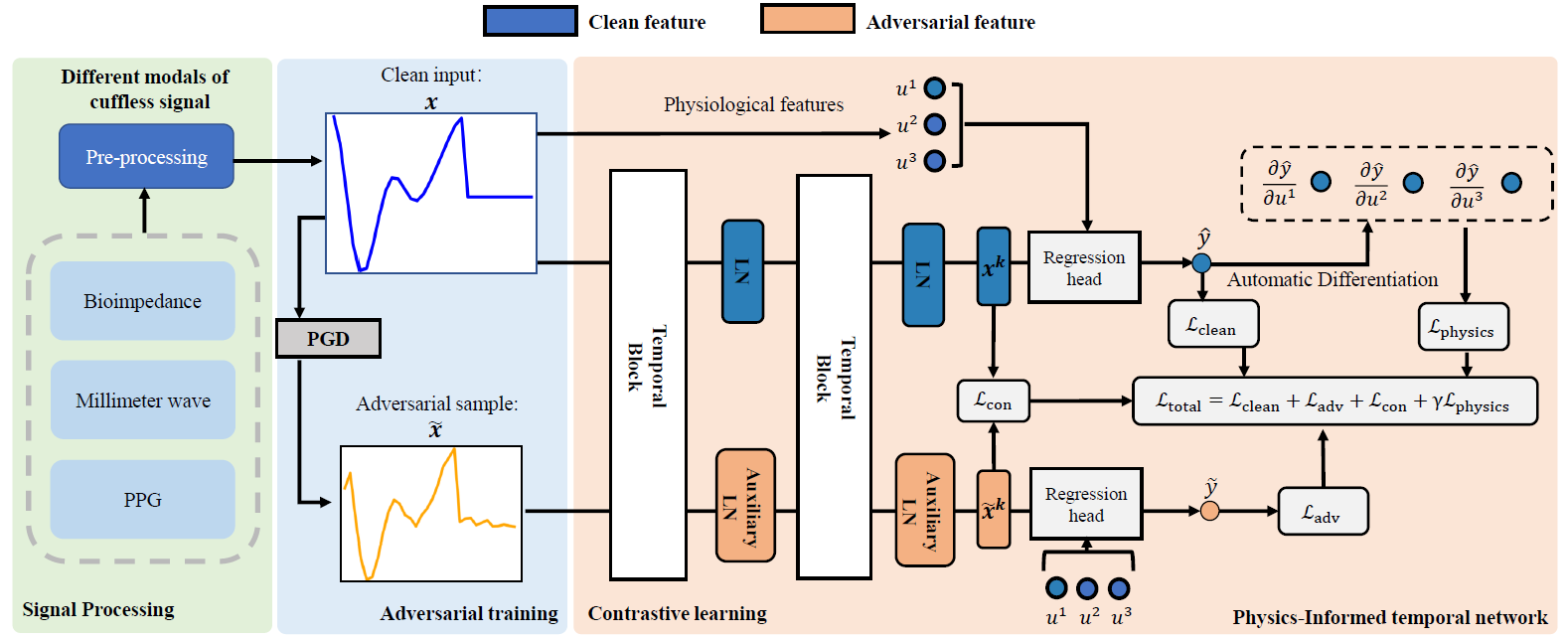

问题定义:论文旨在解决个性化心血管动力学建模中,现有基于物理信息的神经网络(PINN)方法复杂度高、难以扩展和部署的问题。现有方法通常需要复杂的多分支架构以及对抗或对比学习目标来满足偏微分方程约束,这增加了训练难度和计算成本。

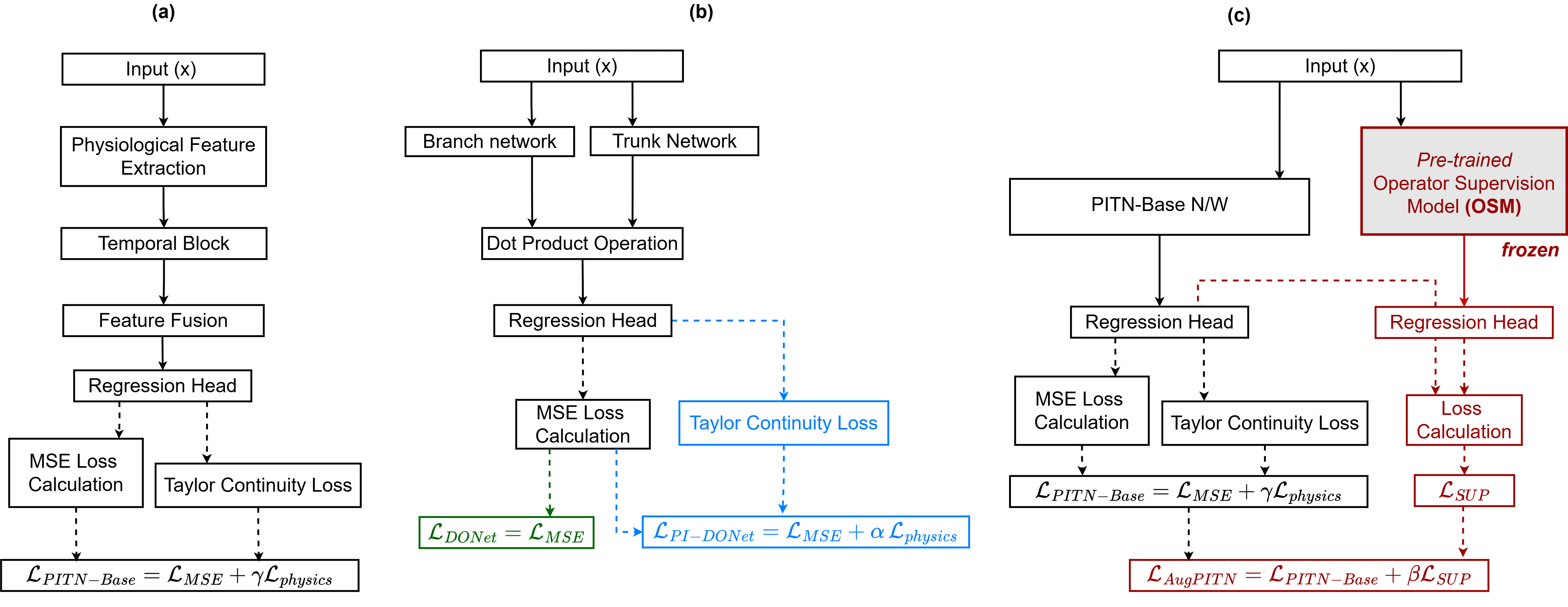

核心思路:论文的核心思路是利用物理信息算子学习,通过知识蒸馏的方式,将一个预训练的、基于物理信息的DeepONet(PI-DeepONet)作为“教师”模型,指导一个更轻量级的“学生”模型进行学习。这样可以在保持甚至提升性能的同时,显著降低模型的复杂度,提高可扩展性和部署效率。

技术框架:整体框架包含两个主要阶段:1) 预训练阶段:使用高保真无袖带血压记录,训练一个PI-DeepONet,使其学习从原始可穿戴波形到心跳间压力信号的算子映射,同时嵌入物理约束。2) 知识蒸馏阶段:将预训练的PI-DeepONet作为冻结的监督者,指导一个简化的基础模型进行学习。基础模型不再需要复杂的对抗或对比学习组件。

关键创新:最重要的创新点在于利用算子学习的思想,将复杂的物理信息嵌入到一个算子中,然后利用这个算子作为监督信号,指导简化模型的训练。这种方法有效地解耦了物理约束和模型结构,使得可以在不牺牲性能的前提下,显著降低模型的复杂度。

关键设计:关键设计包括:1) PI-DeepONet的架构设计,需要能够有效地学习从输入波形到输出压力信号的算子映射,并嵌入物理约束。2) 知识蒸馏的损失函数设计,需要能够有效地将PI-DeepONet的知识传递给基础模型。3) 正则化系数的选择,需要在模型复杂度和性能之间进行权衡。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在保持与复杂基线模型相当的性能(相关性:0.766 vs. 0.770,RMSE:4.452 vs. 4.501)的同时,显著降低了模型复杂度,将关键超参数从八个减少到一个正则化系数,并将训练开销降低了4%。这表明该方法在实际应用中具有更高的效率和可扩展性。

🎯 应用场景

该研究成果可应用于无创心血管监测、个性化医疗和远程健康管理等领域。通过轻量化和高效的血流动力学建模,可以更方便地集成到可穿戴设备和移动医疗应用中,实现对个体心血管健康的实时监测和风险评估,为临床决策提供更准确的依据。

📄 摘要(原文)

Accurate modeling of personalized cardiovascular dynamics is crucial for non-invasive monitoring and therapy planning. State-of-the-art physics-informed neural network (PINN) approaches employ deep, multi-branch architectures with adversarial or contrastive objectives to enforce partial differential equation constraints. While effective, these enhancements introduce significant training and implementation complexity, limiting scalability and practical deployment. We investigate physics-informed neural operator learning models as efficient supervisory signals for training simplified architectures through knowledge distillation. Our approach pre-trains a physics-informed DeepONet (PI-DeepONet) on high-fidelity cuffless blood pressure recordings to learn operator mappings from raw wearable waveforms to beat-to-beat pressure signals under embedded physics constraints. This pre-trained operator serves as a frozen supervisor in a lightweight knowledge-distillation pipeline, guiding streamlined base models that eliminate complex adversarial and contrastive learning components while maintaining performance. We characterize the role of physics-informed regularization in operator learning and demonstrate its effectiveness for supervisory guidance. Through extensive experiments, our operator-supervised approach achieves performance parity with complex baselines (correlation: 0.766 vs. 0.770, RMSE: 4.452 vs. 4.501), while dramatically reducing architectural complexity from eight critical hyperparameters to a single regularization coefficient and decreasing training overhead by 4%. Our results demonstrate that operator-based supervision effectively replaces intricate multi-component training strategies, offering a more scalable and interpretable approach to physiological modeling with reduced implementation burden.