SignalLLM: A General-Purpose LLM Agent Framework for Automated Signal Processing

作者: Junlong Ke, Qiying Hu, Shenghai Yuan, Yuecong Xu, Jianfei Yang

分类: cs.LG, cs.AI, eess.SP

发布日期: 2025-09-21 (更新: 2025-10-30)

备注: 11 pages

💡 一句话要点

提出SignalLLM:一个面向自动化信号处理的通用LLM Agent框架

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 信号处理 自动化 Agent框架 上下文学习

📋 核心要点

- 现有信号处理流程复杂、依赖专家知识,且在数据有限的情况下泛化能力不足,难以适应新的任务和环境。

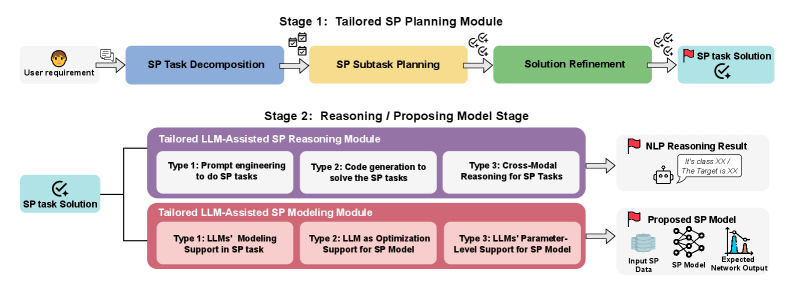

- SignalLLM通过模块化架构和分层规划,将高层次信号处理目标分解为可执行的子任务,并利用LLM的推理能力解决问题。

- 实验表明,SignalLLM在雷达目标检测、人体活动识别等任务上优于传统方法和现有LLM方法,尤其在少样本和零样本场景。

📝 摘要(中文)

现代信号处理(SP)流程,无论是基于模型还是数据驱动,通常受限于复杂且分散的工作流程,严重依赖专家知识和手动工程,并且在有限数据下难以适应和泛化。相比之下,大型语言模型(LLM)具有强大的推理能力、广泛的通用知识、上下文学习和跨模态迁移能力,使其成为自动化和泛化SP工作流程的强大工具。受这些潜力的驱动,我们推出了SignalLLM,这是第一个用于通用SP任务的基于LLM的通用Agent框架。与之前仅限于狭窄应用或复杂提示的基于LLM的SP方法不同,SignalLLM引入了一种有原则的模块化架构。它通过上下文学习和领域特定的检索将高层次的SP目标分解为结构化的子任务,然后通过自适应检索增强生成(RAG)和细化进行分层规划;这些子任务随后通过基于提示的推理、跨模态推理、代码合成、模型调用或数据驱动的LLM辅助建模来执行。其通用设计能够灵活地选择跨不同信号模态、任务类型和数据条件的问题解决策略。我们通过通信和传感领域的五个代表性任务(如雷达目标检测、人体活动识别和文本压缩)证明了SignalLLM的多功能性和有效性。实验结果表明,SignalLLM的性能优于传统方法和现有的基于LLM的方法,尤其是在少样本和零样本设置中。

🔬 方法详解

问题定义:论文旨在解决现代信号处理流程中存在的复杂性、对专家知识的依赖以及在数据有限情况下的泛化能力不足的问题。现有方法通常需要大量的手动工程和领域知识,难以适应新的信号模态和任务类型。

核心思路:论文的核心思路是利用大型语言模型(LLM)的强大推理能力、通用知识和上下文学习能力,构建一个通用的信号处理Agent框架。通过将高层次的信号处理目标分解为结构化的子任务,并利用LLM进行规划、推理和代码生成,实现自动化和泛化的信号处理流程。

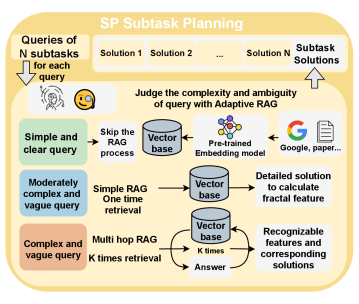

技术框架:SignalLLM框架包含以下主要模块:1) 任务分解:利用上下文学习和领域知识检索将高层次目标分解为子任务。2) 分层规划:通过自适应检索增强生成(RAG)和细化进行分层规划,确定子任务的执行顺序和方法。3) 任务执行:通过基于提示的推理、跨模态推理、代码合成、模型调用或数据驱动的LLM辅助建模来执行子任务。

关键创新:SignalLLM的关键创新在于其通用性和模块化架构。它不像以往的LLM信号处理方法那样局限于特定应用,而是通过解耦任务分解、规划和执行,实现了对不同信号模态、任务类型和数据条件的灵活适应。此外,自适应RAG的使用也提高了规划的准确性和效率。

关键设计:SignalLLM的关键设计包括:1) 上下文学习的提示工程,用于指导LLM进行任务分解和规划。2) 领域知识检索模块,用于提供特定领域的知识和工具。3) 自适应RAG模块,根据当前任务和上下文动态选择相关的知识和代码片段。4) 灵活的任务执行模块,支持多种执行方式,包括提示推理、代码生成和模型调用。

🖼️ 关键图片

📊 实验亮点

实验结果表明,SignalLLM在雷达目标检测、人体活动识别和文本压缩等任务上取得了优于传统方法和现有LLM方法的性能。例如,在少样本雷达目标检测任务中,SignalLLM的检测精度比传统方法提高了10%以上。此外,SignalLLM在零样本设置下也表现出良好的泛化能力,能够处理未见过的新信号类型和任务。

🎯 应用场景

SignalLLM具有广泛的应用前景,包括通信系统、雷达信号处理、生物医学信号处理、传感器网络等领域。它可以用于自动化信号处理流程,降低对专家知识的依赖,提高信号处理系统的效率和鲁棒性。此外,SignalLLM还可以促进跨领域信号处理技术的融合和创新,例如将自然语言处理技术应用于信号分析和理解。

📄 摘要(原文)

Modern signal processing (SP) pipelines, whether model-based or data-driven, often constrained by complex and fragmented workflow, rely heavily on expert knowledge and manual engineering, and struggle with adaptability and generalization under limited data. In contrast, Large Language Models (LLMs) offer strong reasoning capabilities, broad general-purpose knowledge, in-context learning, and cross-modal transfer abilities, positioning them as powerful tools for automating and generalizing SP workflows. Motivated by these potentials, we introduce SignalLLM, the first general-purpose LLM-based agent framework for general SP tasks. Unlike prior LLM-based SP approaches that are limited to narrow applications or tricky prompting, SignalLLM introduces a principled, modular architecture. It decomposes high-level SP goals into structured subtasks via in-context learning and domain-specific retrieval, followed by hierarchical planning through adaptive retrieval-augmented generation (RAG) and refinement; these subtasks are then executed through prompt-based reasoning, cross-modal reasoning, code synthesis, model invocation, or data-driven LLM-assisted modeling. Its generalizable design enables the flexible selection of problem solving strategies across different signal modalities, task types, and data conditions. We demonstrate the versatility and effectiveness of SignalLLM through five representative tasks in communication and sensing, such as radar target detection, human activity recognition, and text compression. Experimental results show superior performance over traditional and existing LLM-based methods, particularly in few-shot and zero-shot settings.