Conversational Orientation Reasoning: Egocentric-to-Allocentric Navigation with Multimodal Chain-of-Thought

作者: Yu Ti Huang

分类: cs.LG, cs.AI, cs.CL, cs.RO

发布日期: 2025-09-20

💡 一句话要点

提出多模态链式思考框架,解决复杂环境下基于语音和地标的室内定位问题。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱六:视频提取与匹配 (Video Extraction) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 室内定位 多模态融合 链式思考 语音识别 空间推理

📋 核心要点

- 现有方法难以在GPS信号弱且缺乏地图的复杂环境中,将自我中心的语音指令转化为场景中心的方向。

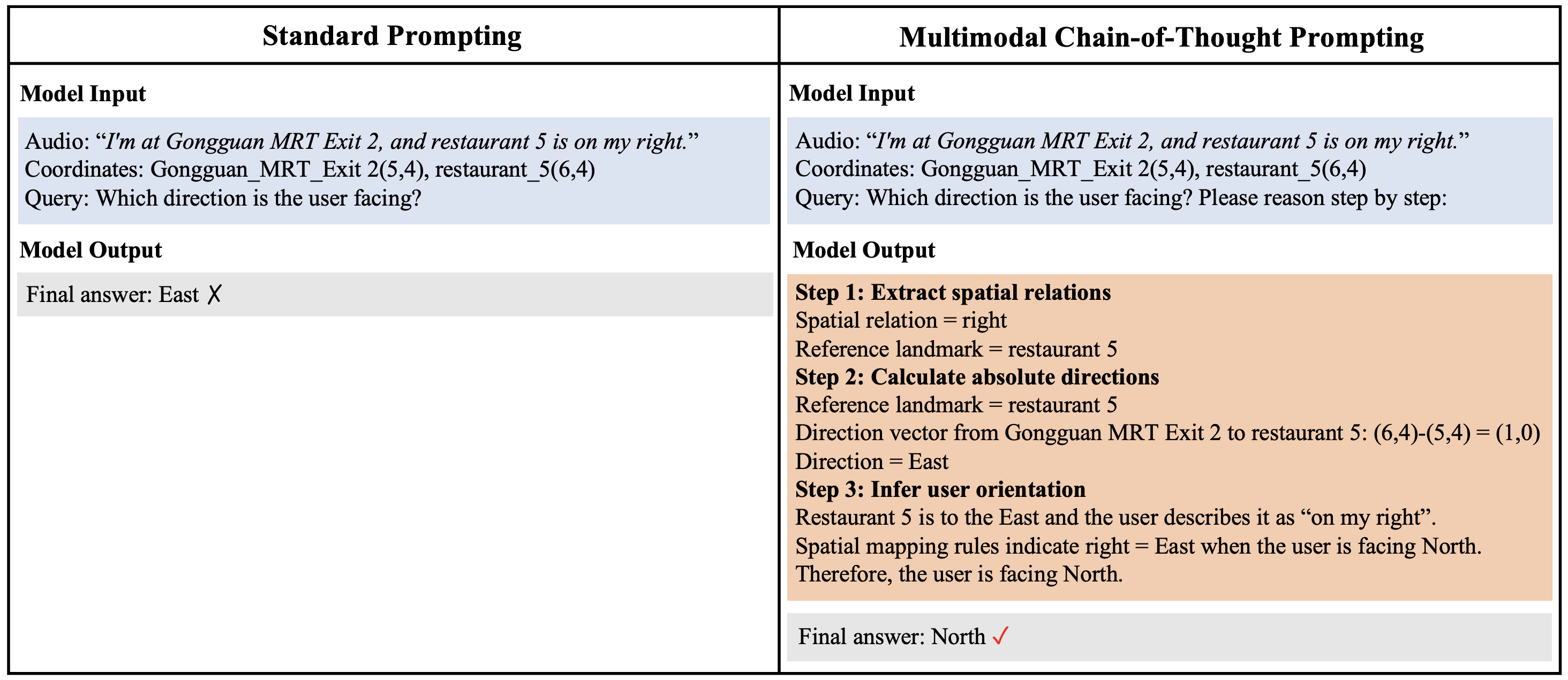

- 论文提出多模态链式思考(MCoT)框架,通过提取空间关系、映射坐标和推断方向三步推理实现定位。

- 实验表明,MCoT在真实场景的语音转录中达到98.1%的定位准确率,优于其他基线方法。

📝 摘要(中文)

本文提出了一种用于会话智能体的方向推理方法,旨在将以自我为中心的语音指令(例如,“在我的右边”)转换为以场景为中心的方向(北/东/南/西)。该问题在GPS信号弱且缺乏详细地图的室内或复杂环境中尤为重要。虽然链式思考(CoT)提示已推动了语言和视觉任务的推理,但其在多模态空间方向上的应用仍未被充分探索。为此,我们引入了会话方向推理(COR),这是一个新的基准,专为从真实环境投影的繁体中文会话导航而设计,解决了非英语和ASR转录场景中的以自我为中心到以场景为中心的推理。我们提出了一种多模态链式思考(MCoT)框架,该框架通过结构化的三步推理过程整合了ASR转录的语音与地标坐标:(1)提取空间关系,(2)将坐标映射到绝对方向,以及(3)推断用户方向。课程学习策略逐步在Taiwan-LLM-13B-v2.0-Chat上构建这些能力。实验表明,MCoT在干净的转录本上实现了100%的方向准确率,在ASR转录本上实现了98.1%的准确率,大大优于单模态和非结构化基线。此外,MCoT在嘈杂的会话条件下(包括ASR识别错误和多语言代码切换)表现出鲁棒性。该模型还在跨域评估中保持了高精度,并且对语言变异、领域转移和指代歧义具有弹性。这些发现突出了结构化MCoT空间推理作为一种可解释且资源高效的具身导航路径的潜力。

🔬 方法详解

问题定义:论文旨在解决在室内或复杂环境中,会话智能体如何将用户以自我为中心的语音指令(例如“我的右边”)转化为以场景为中心的方向(例如“北”)的问题。现有方法在处理语音识别错误、多语言环境以及缺乏精确地图信息的情况下表现不佳,难以实现准确可靠的定位。

核心思路:论文的核心思路是利用多模态信息(语音和地标坐标)以及链式思考(Chain-of-Thought, CoT)的推理方式,将复杂的定位问题分解为多个易于处理的步骤。通过逐步推理,模型可以更好地理解用户意图,并克服语音识别错误和环境噪声的影响。这种方法借鉴了人类解决空间推理问题的思维方式,更具可解释性和鲁棒性。

技术框架:MCoT框架包含三个主要阶段:1) 空间关系提取:从ASR转录的语音中提取关键的空间关系信息,例如“在我的右边”、“靠近门口”等。2) 坐标映射到绝对方向:利用地标的坐标信息,将相对的空间关系映射到绝对的方向,例如“右边是东边”。3) 用户方向推断:综合考虑提取的空间关系和映射的绝对方向,推断出用户的当前朝向。整个框架采用链式思考的方式,每个阶段的输出作为下一个阶段的输入,逐步完成定位任务。

关键创新:论文的关键创新在于将多模态信息和链式思考相结合,用于解决室内定位问题。传统的定位方法往往依赖于GPS信号或预先构建的地图,而MCoT框架可以在缺乏这些信息的环境下工作。此外,MCoT框架还具有较强的鲁棒性,能够处理语音识别错误和多语言环境。

关键设计:论文采用Taiwan-LLM-13B-v2.0-Chat作为基础模型,并使用课程学习策略逐步训练模型。课程学习从简单的任务开始,逐步增加任务的难度,使模型能够更好地学习空间推理能力。在训练过程中,论文使用了交叉熵损失函数来优化模型的参数。此外,论文还设计了一系列数据增强方法,以提高模型的鲁棒性,例如模拟语音识别错误和多语言代码切换。

🖼️ 关键图片

📊 实验亮点

实验结果表明,MCoT框架在干净的语音转录本上实现了100%的方向准确率,在ASR转录本上实现了98.1%的准确率,显著优于单模态和非结构化的基线方法。此外,MCoT框架在嘈杂的会话条件下(包括ASR识别错误和多语言代码切换)表现出良好的鲁棒性,并且在跨域评估中保持了高精度。

🎯 应用场景

该研究成果可应用于室内导航、机器人定位、智能家居等领域。例如,在商场或医院等复杂环境中,用户可以通过语音指令引导机器人到达指定地点。该技术还可用于开发更智能的语音助手,使其能够理解用户的空间意图,并提供更准确的导航服务。未来,该技术有望在智慧城市和智能建筑等领域发挥重要作用。

📄 摘要(原文)

Conversational agents must translate egocentric utterances (e.g., "on my right") into allocentric orientations (N/E/S/W). This challenge is particularly critical in indoor or complex facilities where GPS signals are weak and detailed maps are unavailable. While chain-of-thought (CoT) prompting has advanced reasoning in language and vision tasks, its application to multimodal spatial orientation remains underexplored. We introduce Conversational Orientation Reasoning (COR), a new benchmark designed for Traditional Chinese conversational navigation projected from real-world environments, addressing egocentric-to-allocentric reasoning in non-English and ASR-transcribed scenarios. We propose a multimodal chain-of-thought (MCoT) framework, which integrates ASR-transcribed speech with landmark coordinates through a structured three-step reasoning process: (1) extracting spatial relations, (2) mapping coordinates to absolute directions, and (3) inferring user orientation. A curriculum learning strategy progressively builds these capabilities on Taiwan-LLM-13B-v2.0-Chat, a mid-sized model representative of resource-constrained settings. Experiments show that MCoT achieves 100% orientation accuracy on clean transcripts and 98.1% with ASR transcripts, substantially outperforming unimodal and non-structured baselines. Moreover, MCoT demonstrates robustness under noisy conversational conditions, including ASR recognition errors and multilingual code-switching. The model also maintains high accuracy in cross-domain evaluation and resilience to linguistic variation, domain shift, and referential ambiguity. These findings highlight the potential of structured MCoT spatial reasoning as a path toward interpretable and resource-efficient embodied navigation.