LLM-Guided Co-Training for Text Classification

作者: Md Mezbaur Rahman, Cornelia Caragea

分类: cs.LG

发布日期: 2025-09-20 (更新: 2025-09-23)

💡 一句话要点

提出LLM引导的协同训练方法,提升文本分类在半监督学习中的性能

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 协同训练 半监督学习 大型语言模型 文本分类 伪标签

📋 核心要点

- 现有半监督学习方法在利用未标注数据方面存在局限性,尤其是在数据量大时。

- 利用LLM生成伪标签,并设计动态加权协同训练框架,提升模型对未标注数据的利用率。

- 实验表明,该方法在多个文本分类数据集上超越了现有半监督学习方法,达到SOTA。

📝 摘要(中文)

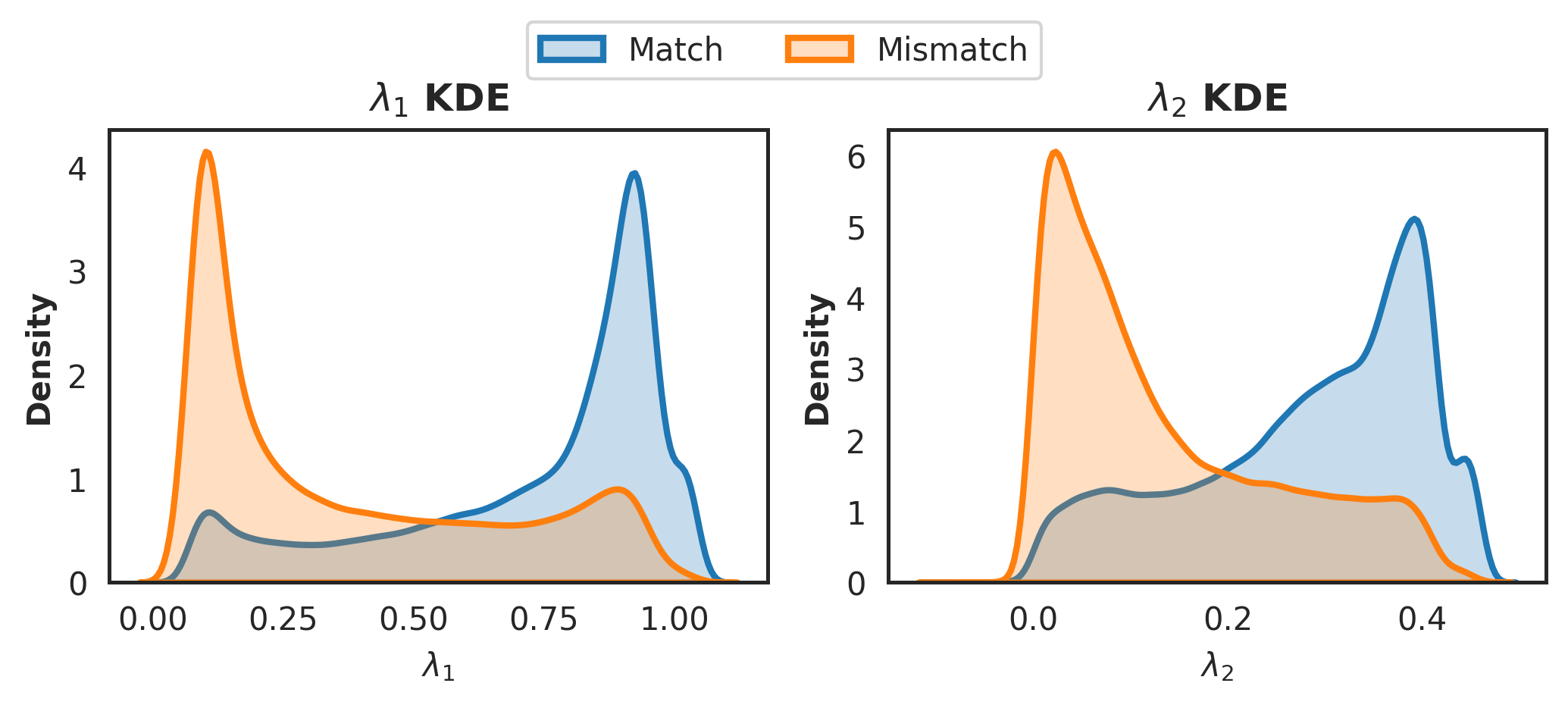

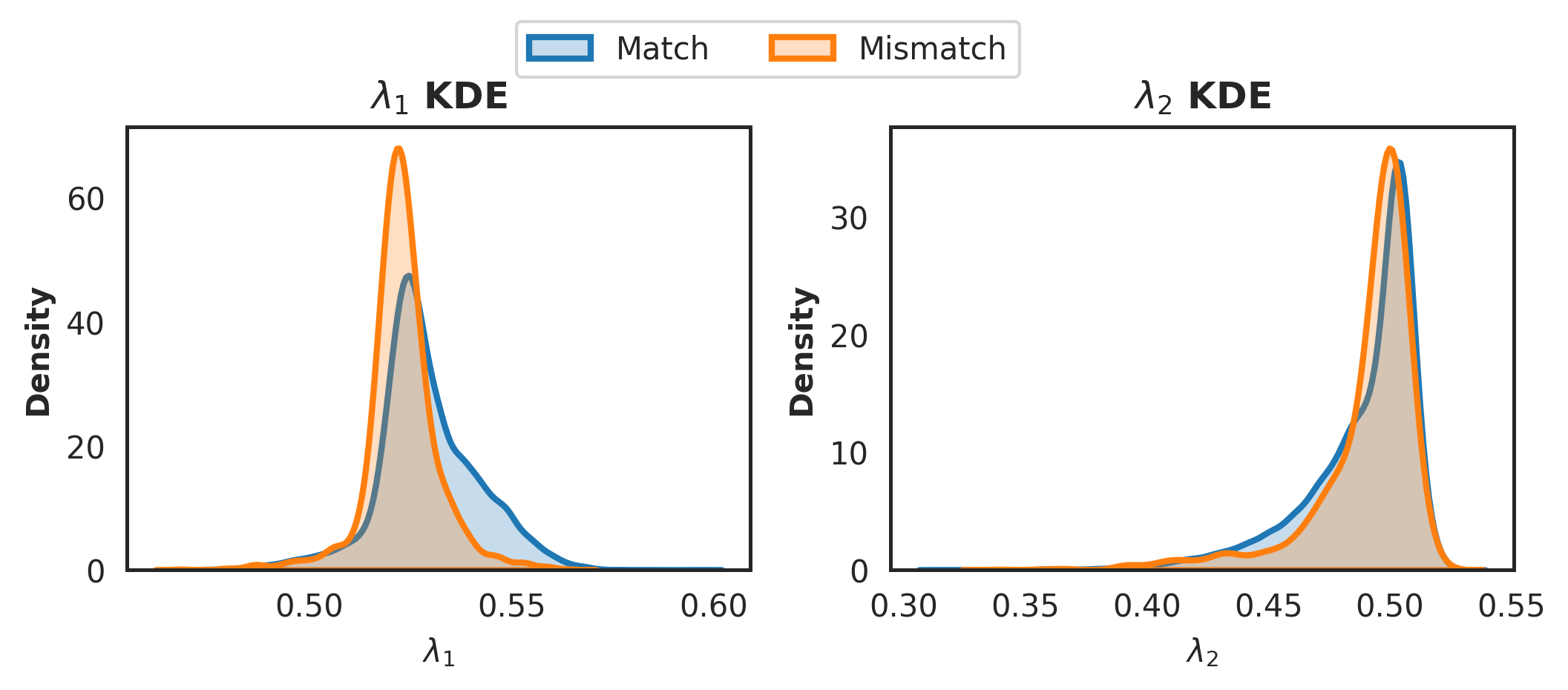

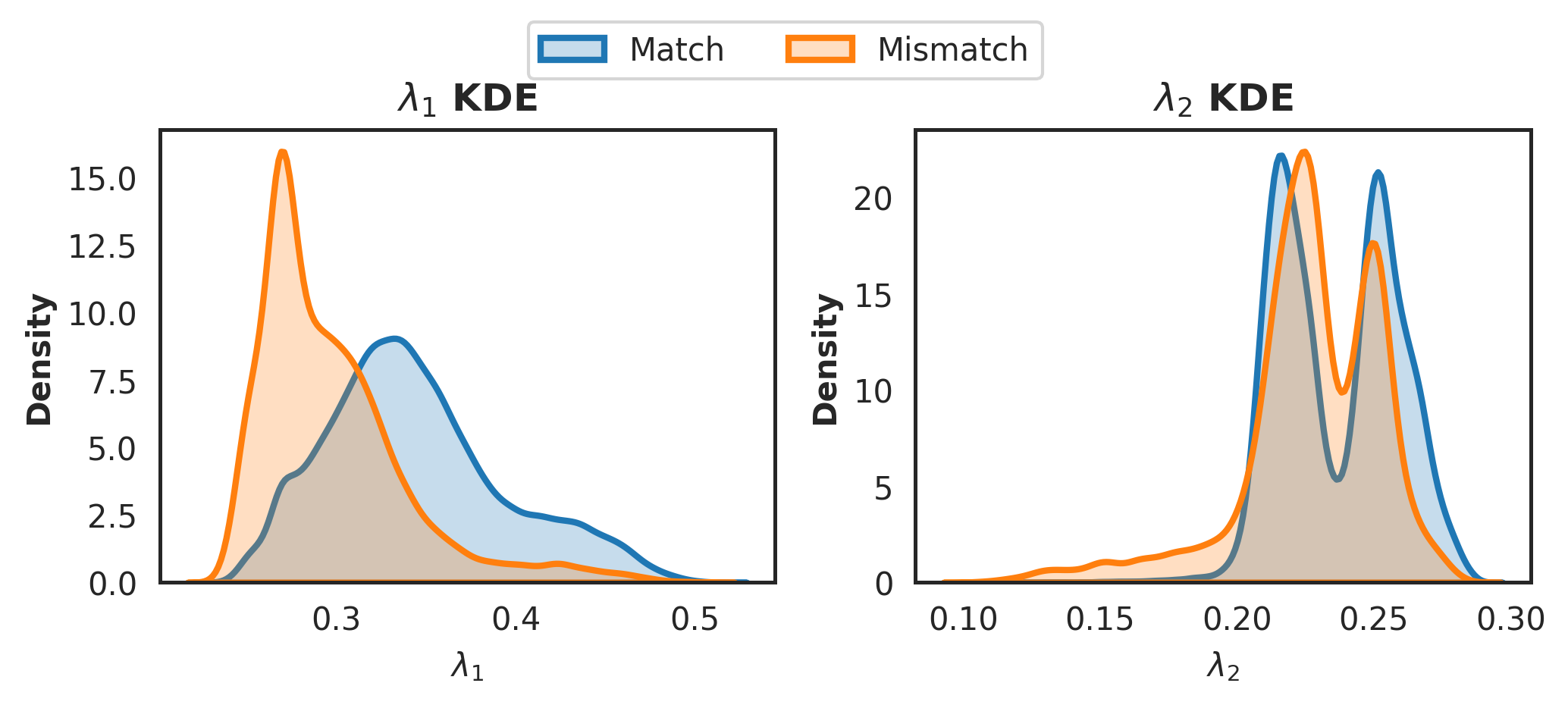

本文提出了一种新颖的由大型语言模型(LLM)引导的加权协同训练方法。在该方法中,我们利用LLM对未标注数据进行标注,并将这些标签作为目标标签,然后协同训练两个基于编码器的网络,这两个网络通过多次迭代相互训练:首先,所有样本通过每个网络,并记录每个网络对LLM标签的置信度的历史估计;其次,根据每个网络对LLM标签质量的置信度,为每个样本导出一个动态重要性权重;最后,两个网络相互交换重要性权重——每个网络反向传播所有样本,这些样本都根据来自其对等网络的重要性权重进行加权,并更新其自身参数。通过策略性地利用LLM生成的指导,我们的方法显著优于传统的SSL方法,尤其是在具有大量未标注数据的设置中。实验结果表明,该方法在5个基准数据集中的4个上实现了最先进的性能,并且在Friedman测试中,在14种比较方法中排名第一。我们的结果突出了半监督学习的一个新方向——LLM作为知识放大器,使骨干协同训练模型能够高效地实现最先进的性能。

🔬 方法详解

问题定义:本文旨在解决文本分类任务中,如何有效利用大量未标注数据的问题。传统的半监督学习方法在面对海量未标注数据时,往往难以充分挖掘其信息,导致模型性能提升有限。此外,现有方法对未标注数据的质量评估不够准确,容易引入噪声,影响模型训练。

核心思路:本文的核心思路是利用大型语言模型(LLM)的强大知识和推理能力,为未标注数据生成高质量的伪标签,并将其作为监督信号来指导模型的训练。同时,采用协同训练框架,让两个模型相互学习,互相纠正,从而提高模型的鲁棒性和泛化能力。通过动态调整样本权重,更加关注LLM置信度高的样本,减少噪声的影响。

技术框架:该方法主要包含以下几个阶段:1) LLM标注:使用LLM对未标注数据进行标注,生成伪标签。2) 模型初始化:初始化两个基于编码器的文本分类模型。3) 协同训练迭代:a) 前向传播:所有样本通过两个网络,记录每个网络对LLM标签的置信度。b) 权重计算:根据每个网络对LLM标签质量的置信度,为每个样本计算动态重要性权重。c) 权重交换:两个网络相互交换重要性权重。d) 反向传播:每个网络使用来自对等网络的重要性权重对所有样本进行加权,并更新自身参数。4) 迭代重复步骤3,直至收敛。

关键创新:该方法最重要的创新点在于将LLM引入到协同训练框架中,利用LLM的知识来指导模型的训练。与传统的协同训练方法相比,该方法能够更有效地利用未标注数据,并提高模型的性能。此外,动态权重调整机制能够更好地处理LLM生成的伪标签中的噪声。

关键设计:关键设计包括:1) 使用基于编码器的网络结构,例如BERT或RoBERTa,以充分利用预训练语言模型的知识。2) 设计动态重要性权重计算方法,例如使用softmax函数将置信度转化为概率分布,并将其作为权重。3) 选择合适的损失函数,例如交叉熵损失函数,来衡量模型预测结果与LLM标签之间的差异。4) 迭代次数和学习率等超参数的选择需要根据具体数据集进行调整。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在5个基准文本分类数据集中的4个上取得了最先进的性能。例如,在AG News数据集上,该方法相比于现有最佳半监督学习方法,准确率提升了超过2%。Friedman测试表明,该方法在14种比较方法中排名第一,证明了其有效性和优越性。

🎯 应用场景

该研究成果可广泛应用于各种文本分类任务中,例如情感分析、主题分类、垃圾邮件检测等。尤其是在标注数据稀缺的场景下,该方法能够有效利用大量未标注数据,提高模型性能,降低标注成本。未来,该方法还可以扩展到其他自然语言处理任务中,例如文本摘要、机器翻译等。

📄 摘要(原文)

In this paper, we introduce a novel weighted co-training approach that is guided by Large Language Models (LLMs). Namely, in our co-training approach, we use LLM labels on unlabeled data as target labels and co-train two encoder-only based networks that train each other over multiple iterations: first, all samples are forwarded through each network and historical estimates of each network's confidence in the LLM label are recorded; second, a dynamic importance weight is derived for each sample according to each network's belief in the quality of the LLM label for that sample; finally, the two networks exchange importance weights with each other -- each network back-propagates all samples weighted with the importance weights coming from its peer network and updates its own parameters. By strategically utilizing LLM-generated guidance, our approach significantly outperforms conventional SSL methods, particularly in settings with abundant unlabeled data. Empirical results show that it achieves state-of-the-art performance on 4 out of 5 benchmark datasets and ranks first among 14 compared methods according to the Friedman test. Our results highlight a new direction in semi-supervised learning -- where LLMs serve as knowledge amplifiers, enabling backbone co-training models to achieve state-of-the-art performance efficiently.