Automated Cyber Defense with Generalizable Graph-based Reinforcement Learning Agents

作者: Isaiah J. King, Benjamin Bowman, H. Howie Huang

分类: cs.LG, cs.CR

发布日期: 2025-09-19

💡 一句话要点

提出基于图神经网络的强化学习智能体,用于自动化网络防御并具备泛化能力

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 自动化网络防御 强化学习 图神经网络 关系归纳偏置 网络安全

📋 核心要点

- 传统强化学习在自动化网络防御中易过拟合特定网络拓扑,泛化能力差,难以应对环境扰动。

- 论文提出基于图的强化学习方法,将网络环境表示为属性图,利用关系归纳偏置提升智能体的泛化能力。

- 实验结果表明,该方法显著优于现有技术,使智能体能够防御前所未见的网络攻击。

📝 摘要(中文)

深度强化学习(RL)正在成为自动化网络防御(ACD)的一种可行策略。传统的RL方法将网络表示为处于各种安全或威胁状态的计算机列表。然而,这些模型被迫过度拟合特定的网络拓扑,即使面对微小的环境扰动也变得无效。本文将ACD构建为一个双人、基于上下文的、部分可观察的马尔可夫决策问题,并将观测表示为属性图。这种方法允许智能体通过关系归纳偏置进行推理。智能体学习如何以更通用的方式推理主机与其他系统实体的交互,并且它们的动作被理解为对表示环境的图的编辑。通过引入这种偏置,我们将展示我们的智能体可以更好地推理网络状态,并零样本适应新的网络。我们表明,这种方法大大优于现有技术,并使我们的智能体能够防御前所未见的网络,对抗各种复杂的多智能体环境中的各种对手。

🔬 方法详解

问题定义:现有自动化网络防御方法依赖于深度强化学习,但传统方法将网络表示为计算机列表,导致模型过度拟合特定网络拓扑。即使面对微小的环境扰动,防御效果也会显著下降,泛化能力不足。因此,需要一种能够适应不同网络拓扑的自动化防御方法。

核心思路:论文的核心思路是将网络环境建模为属性图,其中节点表示主机和系统实体,边表示它们之间的关系。通过图神经网络,智能体可以学习主机与其他实体交互的通用模式,从而获得关系归纳偏置。这种偏置使得智能体能够更好地理解网络状态,并泛化到新的、未见过的网络环境中。

技术框架:该方法将自动化网络防御建模为一个双人、基于上下文的、部分可观察的马尔可夫决策过程(POMDP)。智能体的观测是属性图,动作是对图的编辑。智能体通过与环境交互,学习一个策略,以最大化累积奖励。整体框架包括环境建模、图神经网络、强化学习算法和动作执行四个主要模块。

关键创新:最重要的技术创新点在于使用图神经网络来表示和处理网络环境。与传统的基于列表的表示方法相比,图神经网络能够更好地捕捉网络拓扑结构和实体之间的关系,从而提高智能体的泛化能力。此外,将动作定义为对图的编辑,使得智能体能够以更灵活的方式与环境交互。

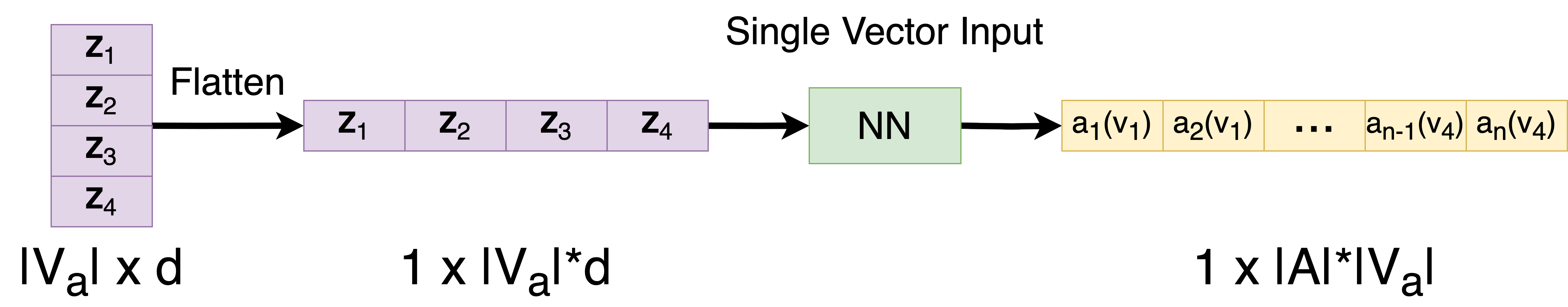

关键设计:论文使用图卷积网络(GCN)作为图神经网络的骨干网络。奖励函数的设计旨在鼓励智能体采取防御措施,同时惩罚攻击行为。强化学习算法采用Actor-Critic方法,Actor网络负责生成动作,Critic网络负责评估状态价值。具体的参数设置和网络结构在论文中有详细描述。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在防御前所未见的网络攻击方面表现出色,显著优于现有技术。具体而言,该方法在各种复杂的多智能体环境中,能够成功防御各种对手的攻击,并且在零样本设置下,能够适应新的网络拓扑。性能提升幅度未知,但摘要中提到“大大优于现有技术”。

🎯 应用场景

该研究成果可应用于各种规模的网络安全防御,包括企业网络、云计算环境和物联网设备。通过自动化网络防御,可以减轻安全人员的负担,提高网络安全水平,并有效应对日益复杂的网络攻击。未来,该技术有望与威胁情报、漏洞挖掘等技术相结合,构建更加智能化的安全防御体系。

📄 摘要(原文)

Deep reinforcement learning (RL) is emerging as a viable strategy for automated cyber defense (ACD). The traditional RL approach represents networks as a list of computers in various states of safety or threat. Unfortunately, these models are forced to overfit to specific network topologies, rendering them ineffective when faced with even small environmental perturbations. In this work, we frame ACD as a two-player context-based partially observable Markov decision problem with observations represented as attributed graphs. This approach allows our agents to reason through the lens of relational inductive bias. Agents learn how to reason about hosts interacting with other system entities in a more general manner, and their actions are understood as edits to the graph representing the environment. By introducing this bias, we will show that our agents can better reason about the states of networks and zero-shot adapt to new ones. We show that this approach outperforms the state-of-the-art by a wide margin, and makes our agents capable of defending never-before-seen networks against a wide range of adversaries in a variety of complex, and multi-agent environments.