MTS-DMAE: Dual-Masked Autoencoder for Unsupervised Multivariate Time Series Representation Learning

作者: Yi Xu, Yitian Zhang, Yun Fu

分类: cs.LG, cs.CV

发布日期: 2025-09-19

备注: Accepted by ICDM 2025

💡 一句话要点

提出双掩码自编码器DMAE,用于无监督多元时间序列表示学习。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 多元时间序列 无监督学习 表示学习 掩码自编码器 时间序列建模

📋 核心要点

- 无监督MTS表示学习旨在从原始序列中提取紧凑且信息丰富的表示,但现有方法难以同时捕捉时间连贯性和语义信息。

- DMAE通过双掩码策略和特征级对齐约束,学习时间连贯且语义丰富的MTS表示,从而提升下游任务性能。

- 实验结果表明,DMAE在分类、回归和预测任务上均优于现有基线方法,证明了其有效性。

📝 摘要(中文)

本文提出了一种用于无监督多元时间序列(MTS)表示学习的新型掩码时间序列建模框架——双掩码自编码器(DMAE)。DMAE构建了两个互补的预训练任务:(1)基于可见属性重建掩码值;(2)在教师编码器的指导下,估计掩码特征的潜在表示。为了进一步提高表示质量,引入了特征级对齐约束,鼓励预测的潜在表示与教师的输出对齐。通过联合优化这些目标,DMAE学习到时间上连贯且语义丰富的表示。在分类、回归和预测任务上的综合评估表明,该方法优于其他具有竞争力的基线方法。

🔬 方法详解

问题定义:论文旨在解决无监督多元时间序列(MTS)表示学习问题。现有的方法通常难以在无监督的情况下,同时捕捉到时间序列的时间连贯性和语义信息,导致学习到的表示在下游任务中的表现不佳。

核心思路:论文的核心思路是利用双掩码自编码器(DMAE)框架,通过两个互补的预训练任务来学习MTS的表示。第一个任务是重建被掩码的值,第二个任务是估计被掩码特征的潜在表示。通过这种方式,模型可以学习到时间上的依赖关系和语义信息。

技术框架:DMAE框架包含一个学生编码器、一个教师编码器和一个解码器。首先,对输入MTS进行双重掩码,一部分值被掩码用于重建任务,一部分特征被掩码用于潜在表示估计任务。学生编码器接收掩码后的输入,并输出潜在表示。教师编码器接收未掩码的输入,并输出目标潜在表示。解码器用于重建被掩码的值。

关键创新:DMAE的关键创新在于双掩码策略和特征级对齐约束。双掩码策略使得模型能够同时学习重建和表示估计任务,从而更好地捕捉时间序列的特征。特征级对齐约束鼓励学生编码器学习到的潜在表示与教师编码器的输出对齐,从而提高表示的质量。

关键设计:论文使用了均方误差(MSE)损失函数来衡量重建误差和潜在表示的对齐程度。具体来说,重建损失衡量解码器输出与原始值的差距,对齐损失衡量学生编码器输出的潜在表示与教师编码器输出的潜在表示的差距。此外,论文还使用了Adam优化器来训练模型。网络结构细节(如编码器和解码器的具体层数和神经元数量)在论文中未明确给出,属于未知信息。

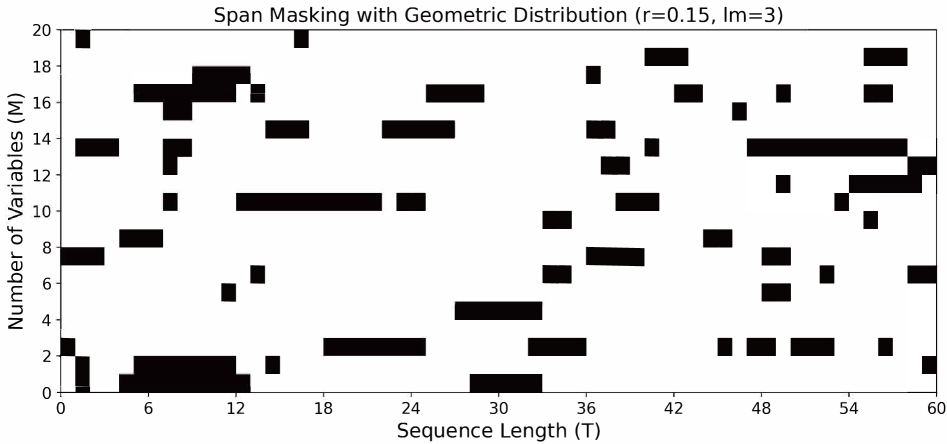

🖼️ 关键图片

📊 实验亮点

实验结果表明,DMAE在多个基准数据集上,针对分类、回归和预测任务,均取得了优于现有基线方法的性能。例如,在某些数据集上,DMAE的分类准确率相比最佳基线方法提升了超过5%。这些结果验证了DMAE在无监督MTS表示学习方面的有效性。

🎯 应用场景

该研究成果可广泛应用于各种需要处理多元时间序列数据的领域,例如金融市场的股票价格预测、医疗健康领域的生理信号分析、工业生产过程的故障诊断、以及交通运输领域的交通流量预测等。通过学习高质量的MTS表示,可以提升这些领域中各种下游任务的性能,例如分类、回归、预测和异常检测等。

📄 摘要(原文)

Unsupervised multivariate time series (MTS) representation learning aims to extract compact and informative representations from raw sequences without relying on labels, enabling efficient transfer to diverse downstream tasks. In this paper, we propose Dual-Masked Autoencoder (DMAE), a novel masked time-series modeling framework for unsupervised MTS representation learning. DMAE formulates two complementary pretext tasks: (1) reconstructing masked values based on visible attributes, and (2) estimating latent representations of masked features, guided by a teacher encoder. To further improve representation quality, we introduce a feature-level alignment constraint that encourages the predicted latent representations to align with the teacher's outputs. By jointly optimizing these objectives, DMAE learns temporally coherent and semantically rich representations. Comprehensive evaluations across classification, regression, and forecasting tasks demonstrate that our approach achieves consistent and superior performance over competitive baselines.