Small LLMs with Expert Blocks Are Good Enough for Hyperparamter Tuning

作者: Om Naphade, Saksham Bansal, Parikshit Pareek

分类: cs.LG, cs.CL

发布日期: 2025-09-19 (更新: 2025-09-25)

💡 一句话要点

提出专家块框架,小LLM即可实现高效超参数调优

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 超参数调优 大型语言模型 小型语言模型 专家块框架 轨迹上下文摘要器

📋 核心要点

- 现有超参数调优方法计算成本高昂,且随着模型增大过程不透明,难以有效应用于大型模型。

- 提出专家块框架,核心是轨迹上下文摘要器(TCS),将训练轨迹转化为结构化上下文,供小型LLM分析优化进度。

- 实验表明,使用TCS的小型LLM在超参数调优任务中,性能可与大型模型GPT-4相媲美,且计算成本更低。

📝 摘要(中文)

超参数调优(HPT)是机器学习(ML)流程中必不可少的步骤,但随着模型规模的增大,其计算成本变得昂贵且过程不透明。最近,大型语言模型(LLM)已被用于HPT,但大多数依赖于超过1000亿参数的模型。我们提出了一种使用小型LLM的HPT专家块框架。其核心是轨迹上下文摘要器(TCS),这是一个确定性块,可将原始训练轨迹转换为结构化上下文,使小型LLM能够分析优化进度,其可靠性可与大型模型相媲美。使用两个本地运行的LLM (phi4:reasoning14B和qwen2.5-coder:32B)和一个10次试验的预算,我们支持TCS的HPT流程在六个不同的任务中实现了平均性能,与GPT-4的差距在~0.9个百分点以内。

🔬 方法详解

问题定义:论文旨在解决大型模型超参数调优过程中计算成本高、过程不透明的问题。现有的基于LLM的超参数调优方法通常依赖于参数量巨大的模型,这使得计算资源受限的研究者难以应用,并且调优过程的解释性较差。

核心思路:论文的核心思路是利用小型LLM,并通过引入专家块框架来弥补小型LLM在处理复杂超参数调优任务时的能力不足。通过将训练轨迹转化为结构化上下文,使得小型LLM能够更好地理解优化过程,从而做出更明智的超参数选择。

技术框架:整体框架包含以下几个主要模块:1) 训练轨迹生成:在给定的超参数配置下,运行模型训练过程,记录训练过程中的损失、准确率等指标。2) 轨迹上下文摘要器(TCS):将原始的训练轨迹数据转化为结构化的上下文信息,例如,将损失曲线的趋势、学习率的变化等信息进行编码。3) 小型LLM:使用小型LLM作为超参数调优的决策者,根据TCS提供的上下文信息,预测下一组超参数配置。4) 迭代优化:重复上述步骤,直到达到预定的试验次数或满足性能要求。

关键创新:论文的关键创新在于提出了轨迹上下文摘要器(TCS)。TCS是一个确定性模块,能够将原始的、非结构化的训练轨迹数据转化为结构化的、易于LLM理解的上下文信息。这使得小型LLM能够像大型LLM一样,有效地分析优化过程,并做出合理的超参数选择。与现有方法相比,该方法降低了对LLM规模的需求,使得在资源受限的环境下进行超参数调优成为可能。

关键设计:TCS的具体实现细节未知,摘要中只提到是确定性模块,将原始训练轨迹转换为结构化上下文。论文中使用的两个小型LLM分别是phi4:reasoning14B和qwen2.5-coder:32B。实验中使用了10次试验的预算,即每个任务只允许进行10次超参数调优尝试。具体的损失函数和网络结构等技术细节未知。

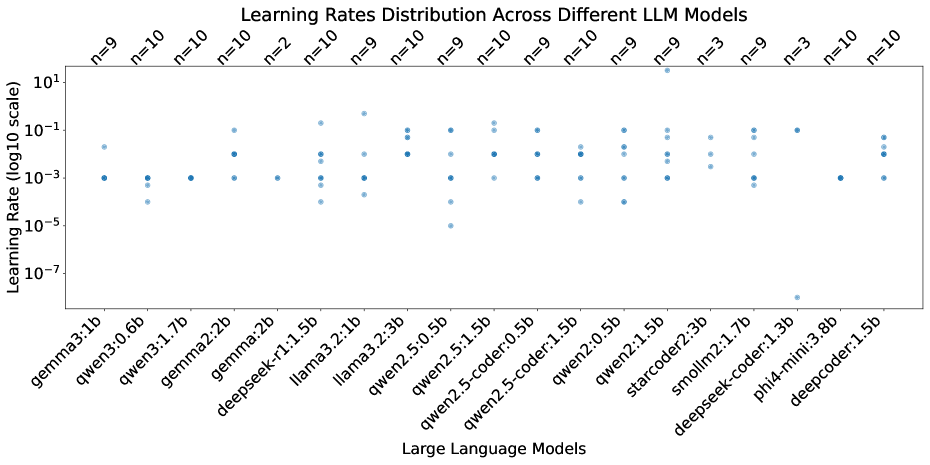

🖼️ 关键图片

📊 实验亮点

实验结果表明,使用TCS的小型LLM (phi4:reasoning14B和qwen2.5-coder:32B) 在六个不同的任务中,仅使用10次试验的预算,即可达到与GPT-4相近的性能,平均性能差距在0.9个百分点以内。这表明,通过有效的上下文信息提取和利用,小型LLM完全可以胜任复杂的超参数调优任务。

🎯 应用场景

该研究成果可应用于各种机器学习模型的超参数调优,尤其适用于计算资源有限的场景。通过降低对LLM规模的需求,使得更多研究者和开发者能够利用LLM进行高效的超参数调优,从而加速模型开发和部署。未来,该方法有望扩展到更复杂的模型和任务中,并与其他优化算法相结合,进一步提升超参数调优的效率和效果。

📄 摘要(原文)

Hyper-parameter Tuning (HPT) is a necessary step in machine learning (ML) pipelines but becomes computationally expensive and opaque with larger models. Recently, Large Language Models (LLMs) have been explored for HPT, yet most rely on models exceeding 100 billion parameters. We propose an Expert Block Framework for HPT using Small LLMs. At its core is the Trajectory Context Summarizer (TCS), a deterministic block that transforms raw training trajectories into structured context, enabling small LLMs to analyze optimization progress with reliability comparable to larger models. Using two locally-run LLMs (phi4:reasoning14B and qwen2.5-coder:32B) and a 10-trial budget, our TCS-enabled HPT pipeline achieves average performance within ~0.9 percentage points of GPT-4 across six diverse tasks.