Temporal Reasoning with Large Language Models Augmented by Evolving Knowledge Graphs

作者: Junhong Lin, Song Wang, Xiaojie Guo, Julian Shun, Yada Zhu

分类: cs.LG

发布日期: 2025-09-18

💡 一句话要点

提出EvoReasoner和EvoKG,增强LLM在时序知识图谱上的推理能力。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 时序推理 知识图谱 大型语言模型 动态知识 问答系统

📋 核心要点

- 现有方法在利用知识图谱增强LLM时,通常忽略了知识图谱的时序动态和事实不一致性,导致推理效果不佳。

- 论文提出EvoReasoner和EvoKG,前者进行时间感知的多跳推理,后者从非结构化文档中增量更新知识图谱,保持知识的时效性。

- 实验表明,该方法在时序问答任务上优于现有基线,并且使用该方法的8B参数模型可以达到671B参数模型的性能水平。

📝 摘要(中文)

大型语言模型(LLM)在许多语言理解任务中表现出色,但难以对不断演化的知识进行推理。为了解决这个问题,最近的研究探索了使用知识图谱(KG)来增强LLM,以提供结构化的、最新的信息。然而,许多现有方法假设KG的静态快照,忽略了现实世界数据中固有的时间动态和事实不一致性。为了应对基于时间变化的知识进行推理的挑战,我们提出了EvoReasoner,一种时间感知的多跳推理算法,它执行全局-局部实体对齐、多路径分解和时间对齐的评分。为了确保底层KG保持准确和最新,我们引入了EvoKG,一个容错的KG演化模块,它通过基于置信度的矛盾解决和时间趋势跟踪,从非结构化文档中增量更新KG。我们在时间QA基准测试和一个KG从原始文档动态更新的新型端到端设置中评估了我们的方法。我们的方法优于基于提示的和KG增强的基线,有效地缩小了小型和大型LLM在动态问答方面的差距。值得注意的是,使用我们方法的8B参数模型与七个月后提示的671B模型性能相匹配。这些结果突出了结合时间推理和KG演化对于鲁棒和最新的LLM性能的重要性。我们的代码已在github.com/junhongmit/TREK上公开。

🔬 方法详解

问题定义:论文旨在解决大型语言模型在处理时序知识推理方面的不足。现有方法通常依赖静态的知识图谱,无法有效处理知识随时间演变带来的挑战,例如事实更新、信息过时等。这导致LLM在需要时序知识的问答任务中表现不佳。

核心思路:论文的核心思路是将LLM与一个可以动态演化的知识图谱相结合。通过EvoReasoner进行时间感知的推理,并利用EvoKG从非结构化文本中持续更新知识图谱,从而使LLM能够获取最新的知识并进行准确的推理。这种动态更新的机制是解决时序知识推理问题的关键。

技术框架:整体框架包含两个主要模块:EvoReasoner和EvoKG。EvoReasoner负责利用LLM进行多跳推理,并结合时间信息对实体和关系进行评分。EvoKG负责从非结构化文档中提取知识,并根据置信度和时间趋势对知识图谱进行增量更新。两个模块协同工作,共同提升LLM在时序知识推理方面的能力。

关键创新:论文的关键创新在于EvoKG模块,它能够从非结构化文档中自动提取并更新知识图谱。EvoKG采用了一种容错机制,可以处理知识提取过程中的噪声和不一致性。此外,EvoKG还考虑了时间趋势,可以根据知识的演变规律对知识图谱进行更新。这种动态更新的机制是与现有方法的本质区别。

关键设计:EvoReasoner的关键设计包括全局-局部实体对齐、多路径分解和时间对齐的评分机制。EvoKG的关键设计包括基于置信度的矛盾解决和时间趋势跟踪。具体的参数设置、损失函数和网络结构等细节在论文中进行了详细描述,例如,置信度阈值的设定,时间衰减函数的选择等。

🖼️ 关键图片

📊 实验亮点

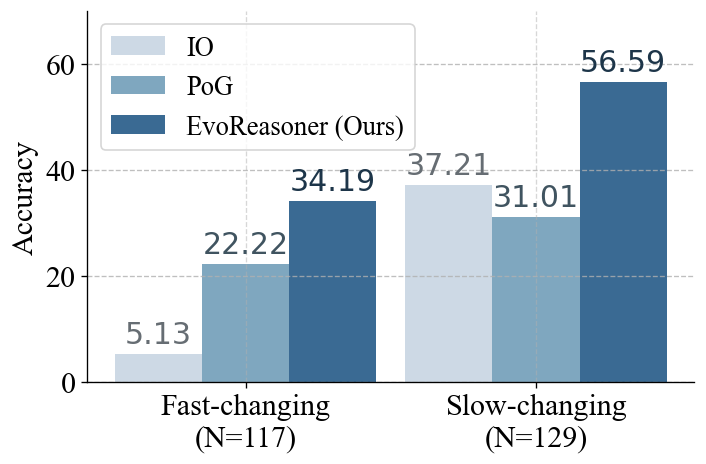

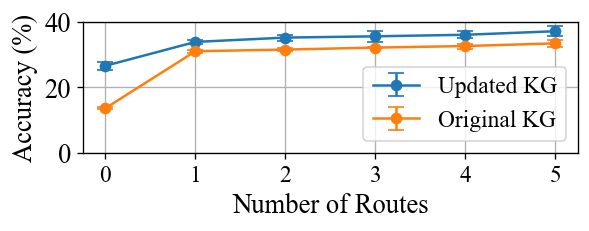

实验结果表明,EvoReasoner和EvoKG能够显著提升LLM在时序问答任务上的性能。特别值得注意的是,使用该方法的8B参数模型可以达到671B参数模型的性能水平,这表明通过知识图谱的增强,可以有效缩小小型和大型LLM之间的差距。此外,该方法在KG从原始文档动态更新的端到端设置中也表现出色,验证了其在实际应用中的可行性。

🎯 应用场景

该研究成果可应用于需要处理时序知识的问答系统、智能助手、金融分析、新闻摘要等领域。例如,可以构建一个能够回答关于历史事件、人物关系、公司发展历程等问题的智能系统。该研究有助于提升LLM在动态环境下的适应性和推理能力,具有重要的实际应用价值和广阔的发展前景。

📄 摘要(原文)

Large language models (LLMs) excel at many language understanding tasks but struggle to reason over knowledge that evolves. To address this, recent work has explored augmenting LLMs with knowledge graphs (KGs) to provide structured, up-to-date information. However, many existing approaches assume a static snapshot of the KG and overlook the temporal dynamics and factual inconsistencies inherent in real-world data. To address the challenge of reasoning over temporally shifting knowledge, we propose EvoReasoner, a temporal-aware multi-hop reasoning algorithm that performs global-local entity grounding, multi-route decomposition, and temporally grounded scoring. To ensure that the underlying KG remains accurate and up-to-date, we introduce EvoKG, a noise-tolerant KG evolution module that incrementally updates the KG from unstructured documents through confidence-based contradiction resolution and temporal trend tracking. We evaluate our approach on temporal QA benchmarks and a novel end-to-end setting where the KG is dynamically updated from raw documents. Our method outperforms both prompting-based and KG-enhanced baselines, effectively narrowing the gap between small and large LLMs on dynamic question answering. Notably, an 8B-parameter model using our approach matches the performance of a 671B model prompted seven months later. These results highlight the importance of combining temporal reasoning with KG evolution for robust and up-to-date LLM performance. Our code is publicly available at github.com/junhongmit/TREK.