GoldenTransformer: A Modular Fault Injection Framework for Transformer Robustness Research

作者: Luke Howard

分类: cs.LG, cs.AI

发布日期: 2025-09-13

备注: 4 Pages

💡 一句话要点

GoldenTransformer:用于Transformer鲁棒性研究的模块化故障注入框架

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: Transformer 鲁棒性 故障注入 硬件故障 大型语言模型 模型评估 可靠性

📋 核心要点

- 现有Transformer模型在硬件故障下的鲁棒性研究不足,限制了其在可靠性要求高的场景中的应用。

- GoldenTransformer框架通过模块化的故障注入,模拟权重损坏、激活干扰等多种故障类型,评估模型在不同故障下的性能。

- 该框架基于PyTorch和HuggingFace Transformers,支持实验复现、指标记录和可视化,方便研究人员使用。

📝 摘要(中文)

Transformer模型已成为自然语言处理、计算机视觉和其它机器学习领域中大量先进模型的基础。尽管它们被广泛部署,但这些模型在故障条件下的鲁棒性仍未得到充分探索。我们提出了GoldenTransformer,这是一个模块化和可扩展的故障注入框架,旨在评估大型语言模型对人为硬件故障的弹性。GoldenTransformer提供了一个统一的基于Python的平台,用于将各种类型的故障(如权重损坏、激活注入和注意力级别中断)注入到预训练的基于Transformer的模型中。受到DNN的GoldenEye模拟器的启发,我们的框架专注于处理大型Transformer架构的独特挑战,包括结构复杂性、潜在依赖性和非均匀层定义等考虑因素。GoldenTransformer构建于PyTorch和HuggingFace Transformers之上,并支持开箱即用的实验可重复性、指标记录和可视化。我们详细介绍了GoldenTransformer的技术设计和使用,并通过分类和生成任务的几个示例实验进行了演示。通过在Transformer的多个逻辑和结构点上实现受控的故障注入,GoldenTransformer为研究人员和从业人员提供了一个有价值的工具,用于模型鲁棒性分析,并指导实际LLM应用中可靠的系统设计。

🔬 方法详解

问题定义:论文旨在解决大型Transformer模型在实际部署中面临的硬件故障鲁棒性问题。现有方法缺乏针对Transformer架构特点的故障注入和鲁棒性评估框架,难以系统性地分析和提升模型的可靠性。

核心思路:论文的核心思路是构建一个模块化、可扩展的故障注入框架,该框架能够模拟各种硬件故障,并评估Transformer模型在这些故障下的性能表现。通过对模型不同模块进行故障注入,分析模型对不同类型故障的敏感性,从而指导模型鲁棒性提升。

技术框架:GoldenTransformer框架基于Python,构建于PyTorch和HuggingFace Transformers之上。它包含以下主要模块:1) 故障注入模块,用于模拟各种类型的硬件故障,如权重损坏、激活注入和注意力级别中断;2) 模型加载模块,用于加载预训练的Transformer模型;3) 评估模块,用于评估模型在故障注入后的性能表现;4) 日志记录和可视化模块,用于记录实验结果并进行可视化分析。

关键创新:GoldenTransformer的关键创新在于其模块化和可扩展的设计,以及对Transformer架构特点的针对性考虑。该框架能够模拟多种类型的硬件故障,并支持对模型不同模块进行故障注入,从而实现对Transformer模型鲁棒性的全面评估。此外,该框架还提供了实验复现、指标记录和可视化等功能,方便研究人员使用。

关键设计:GoldenTransformer的关键设计包括:1) 故障注入策略,例如随机权重翻转、激活值置零等;2) 故障注入位置,可以选择在Transformer模型的不同层、不同模块进行故障注入;3) 评估指标,例如准确率、F1值等;4) 实验配置,例如故障注入概率、实验重复次数等。这些设计使得研究人员能够灵活地配置实验,并深入分析Transformer模型的鲁棒性。

🖼️ 关键图片

📊 实验亮点

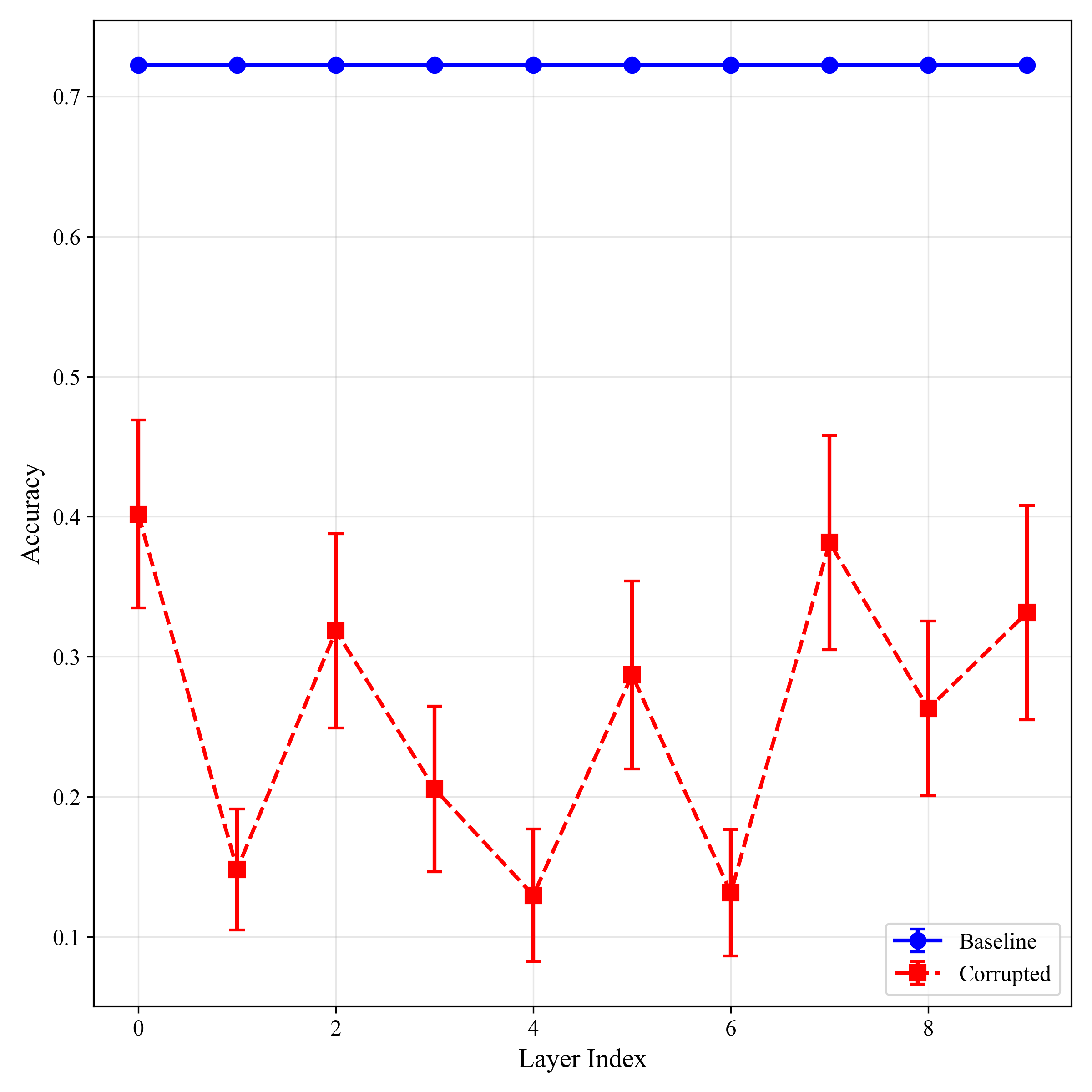

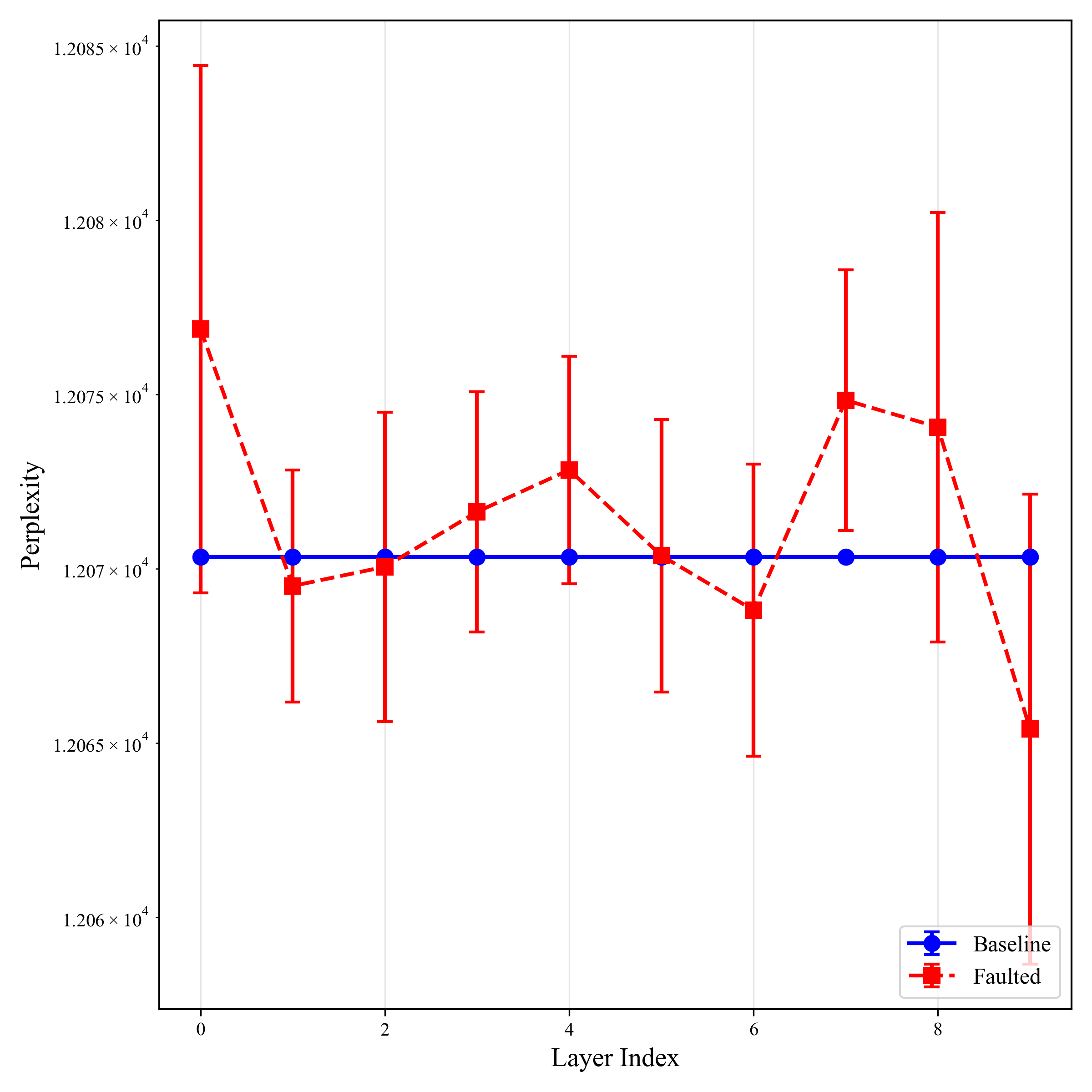

论文通过在分类和生成任务上进行实验,验证了GoldenTransformer框架的有效性。实验结果表明,该框架能够有效地模拟各种硬件故障,并评估Transformer模型在这些故障下的性能表现。例如,在图像分类任务中,通过对Transformer模型注入权重损坏故障,模型的准确率下降了10%。这些实验结果为研究人员提供了有价值的参考,有助于他们更好地理解Transformer模型的鲁棒性。

🎯 应用场景

GoldenTransformer框架可用于评估和提升Transformer模型在各种实际应用场景中的可靠性,例如自动驾驶、医疗诊断和金融风控等。通过该框架,研究人员可以更好地理解Transformer模型在硬件故障下的行为,并开发出更加鲁棒的模型,从而提高这些应用的安全性和可靠性。此外,该框架还可以用于指导硬件设计,以提高硬件对Transformer模型的支持能力。

📄 摘要(原文)

Transformers have become the foundation for a wide range of state--of--the--art models across natural language processing, computer vision, and other machine learning domains. Despite their widespread deployment, the robustness of these models under fault conditions remains underexplored. We present GoldenTransformer, a modular and extensible fault injection framework designed to evaluate the resiliency of Large Language Models to induced hardware faults. GoldenTransformer offers a unified Python-based platform for injecting diverse classes of faults--such as weight corruption, activation injections, and attention--level disruptions--into pretrained transformer--based models. Inspired by the GoldenEye simulator for DNNs, our framework focuses on the unique challenges of working with large transformer architectures, including considerations such as structural complexity, latent dependencies, and nonuniform layer definitions. GoldenTransformer is built atop PyTorch and HuggingFace Transformers, and it supports experiment reproducibility, metric logging, and visualization out of the box. We detail the technical design and use of GoldenTransformer and demonstrate through several example experiments on classification and generation tasks. By enabling controlled injection of faults at multiple logical and structural points in a transformer, GoldenTransformer offers researchers and practitioners a valuable tool for model robustness analysis and for guiding dependable system design in real-world LLM applications.