Test-Time Warmup for Multimodal Large Language Models

作者: Nikita Rajaneesh, Thomas Zollo, Richard Zemel

分类: cs.LG, cs.AI

发布日期: 2025-09-12 (更新: 2025-11-06)

💡 一句话要点

提出测试时预热方法,提升多模态大语言模型在复杂推理任务上的性能。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态大语言模型 测试时预热 弱监督学习 模型自适应 复杂推理

📋 核心要点

- 多模态大语言模型在复杂推理任务中表现不佳,主要原因是多模态训练数据量远小于预训练数据量。

- 论文提出测试时预热方法,利用弱监督辅助任务数据,针对每个测试实例自适应调整MLLM。

- 实验结果表明,该方法在MMMU、VQA-Rad和GQA等数据集上,显著提升了Llama-Vision-Instruct模型的性能。

📝 摘要(中文)

多模态大语言模型(MLLM)在文本和图像交叉领域的高级推理方面具有巨大潜力,但尚未完全发挥。MLLM通常集成一个LLM、一个视觉编码器和一个连接器,该连接器将视觉编码器的嵌入映射到LLM的文本嵌入空间。尽管每个组件都在包含数十亿样本的海量数据集上进行了预训练,但整个多模态模型通常只在数千个(或几百万个)样本上进行训练,这可能导致在复杂推理任务上的性能较弱。为了解决这些缺点,我们提出了一种测试时预热方法,该方法通过利用来自弱监督辅助任务的数据,为每个测试实例调整MLLM,而不是依赖于用于微调的大量标记数据集。通过我们的方法,我们观察到Llama-Vision-Instruct模型在MMMU上相对性能提高了4.03%,在VQA-Rad上提高了5.28%,在GQA上提高了1.63%。我们的方法表明,推理前的“预热”可以增强MLLM在各种推理任务中的鲁棒性。

🔬 方法详解

问题定义:多模态大语言模型(MLLM)在视觉和语言的交叉领域展现出强大的潜力,但其性能受到多模态训练数据规模的限制。尽管MLLM的各个组成部分(如LLM和视觉编码器)都在大规模数据集上进行了预训练,但整个多模态模型通常只在相对较小的数据集上进行微调,导致在复杂推理任务中表现不佳。现有方法依赖于大量标注数据进行微调,成本高昂且难以扩展。

核心思路:论文的核心思路是提出一种测试时预热(Test-Time Warmup)方法,通过利用弱监督辅助任务的数据,在推理阶段对MLLM进行自适应调整。这种方法无需额外的标注数据,而是利用模型自身的能力,在每个测试实例上进行“预热”,从而提高其在特定任务上的性能。

技术框架:该方法的核心在于利用弱监督数据进行测试时的模型调整。具体流程如下:1) 对于给定的测试实例,选择合适的弱监督辅助任务。2) 利用辅助任务的数据,对MLLM进行少量迭代的训练,使其适应当前测试实例的特征。3) 使用预热后的MLLM进行推理,得到最终结果。整个过程无需人工干预,可以自动完成。

关键创新:该方法最重要的创新点在于提出了测试时预热的概念,将模型调整过程从训练阶段转移到推理阶段。与传统的微调方法相比,测试时预热无需大量标注数据,而是利用弱监督数据和模型自身的能力进行自适应调整,更加灵活高效。

关键设计:关键设计包括:1) 弱监督辅助任务的选择策略,需要根据测试实例的特点选择合适的辅助任务。2) 预热迭代次数的设置,需要在性能提升和计算成本之间进行权衡。3) 损失函数的选择,需要根据辅助任务的特点进行调整。具体参数设置和网络结构细节未在摘要中详细说明,属于未知信息。

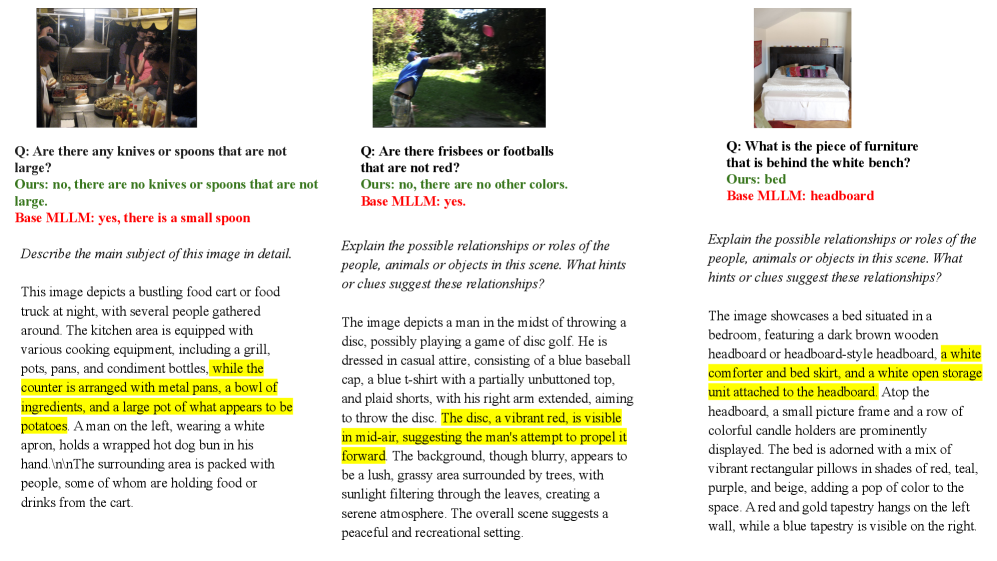

🖼️ 关键图片

📊 实验亮点

实验结果表明,提出的测试时预热方法在MMMU数据集上取得了4.03%的相对性能提升,在VQA-Rad数据集上取得了5.28%的相对性能提升,在GQA数据集上取得了1.63%的相对性能提升。这些结果表明,该方法能够有效提升MLLM在复杂推理任务上的鲁棒性和准确性,且无需额外的标注数据。

🎯 应用场景

该研究成果可广泛应用于需要多模态信息融合和复杂推理的场景,例如智能问答、医学影像诊断、视觉导航等。通过测试时预热,可以提升MLLM在特定任务上的性能,降低对大量标注数据的依赖,加速多模态人工智能技术的落地应用。未来,该方法有望扩展到更多模态和更复杂的任务中。

📄 摘要(原文)

Multimodal Large Language Models (MLLMs) hold great promise for advanced reasoning at the intersection of text and images, yet they have not fully realized this potential. MLLMs typically integrate an LLM, a vision encoder, and a connector that maps the vision encoder's embeddings into the LLM's text embedding space. Although each component is pretrained on massive datasets with billions of samples, the entire multimodal model is typically trained on only thousands (or a few million) samples, which can result in weak performance on complex reasoning tasks. To address these shortcomings, instead of relying on extensive labeled datasets for fine-tuning, we propose a Test-Time Warmup method that adapts the MLLM per test instance by leveraging data from weakly supervised auxiliary tasks. With our approach, we observe a relative performance improvement of 4.03% on MMMU, 5.28% on VQA-Rad, and 1.63% on GQA on the Llama-Vision-Instruct model. Our method demonstrates that 'warming up' before inference can enhance MLLMs' robustness across diverse reasoning tasks.