Symbolic Feedforward Networks for Probabilistic Finite Automata: Exact Simulation and Learnability

作者: Sahil Rajesh Dhayalkar

分类: cs.LG

发布日期: 2025-09-12 (更新: 2025-09-23)

备注: 19 pages, 2 figures

💡 一句话要点

提出基于符号前馈网络的概率有限自动机精确模拟与学习方法

🎯 匹配领域: 支柱八:物理动画 (Physics-based Animation)

关键词: 概率有限自动机 符号计算 前馈神经网络 精确模拟 可学习性

📋 核心要点

- 现有方法难以在神经网络中精确模拟概率有限自动机,缺乏可解释性和理论保证。

- 提出一种基于符号前馈网络的架构,将状态和转移分别表示为向量和矩阵,实现 PFA 的精确模拟。

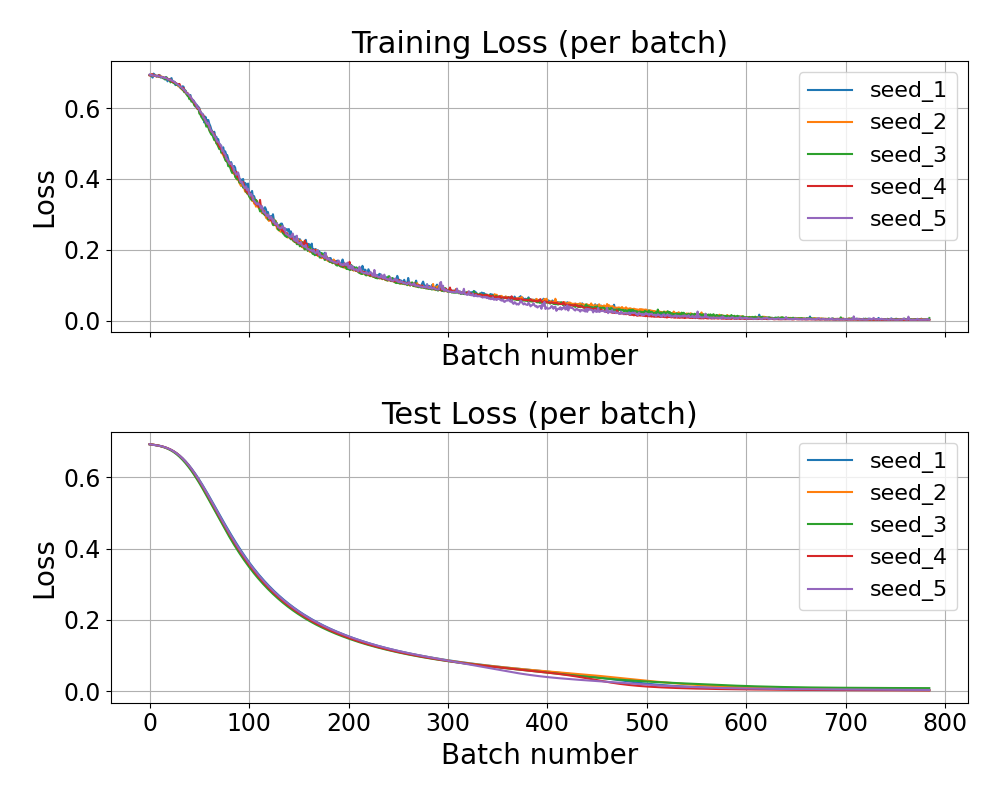

- 实验证明该架构不仅能精确模拟 PFA,还能通过梯度下降学习到 PFA 的行为,具有良好的可学习性。

📝 摘要(中文)

本文提出了一种形式化的、建设性的理论,证明了概率有限自动机(PFAs)可以使用符号前馈神经网络进行精确模拟。该架构将状态分布表示为向量,将转换表示为随机矩阵,从而通过矩阵-向量乘积实现概率状态传播。这产生了一种并行、可解释和可微分的 PFA 动力学模拟,使用了软更新且无需循环。我们正式描述了概率子集构造、ε-闭包和通过分层符号计算进行的精确模拟,并证明了 PFA 和特定类别的神经网络之间的等价性。我们进一步表明,这些符号模拟器不仅具有表达能力,而且是可学习的:通过在标记的序列数据上使用基于梯度下降的标准优化方法进行训练,它们可以恢复真实 PFA 的精确行为。这种可学习性(在命题 5.1 中形式化)是这项工作的关键。我们的结果在一个严格的代数框架下统一了概率自动机理论和神经架构,弥合了符号计算和深度学习之间的差距。

🔬 方法详解

问题定义:概率有限自动机(PFA)的模拟和学习是一个重要的问题。现有的神经网络方法通常难以精确模拟 PFA 的概率转移过程,并且缺乏可解释性。此外,将 PFA 的理论与深度学习模型相结合仍然是一个挑战。

核心思路:本文的核心思路是将 PFA 的状态和转移过程进行符号化表示,并利用前馈神经网络进行模拟。通过将状态表示为向量,转移表示为随机矩阵,可以将 PFA 的状态转移过程转化为矩阵-向量乘积,从而实现 PFA 的精确模拟。

技术框架:该方法的技术框架主要包括以下几个模块:1) 状态表示:将 PFA 的状态表示为向量;2) 转移表示:将 PFA 的状态转移概率表示为随机矩阵;3) 前馈网络:使用前馈神经网络进行状态传播,通过矩阵-向量乘积实现状态转移;4) 训练优化:使用梯度下降等优化算法训练网络,使其能够学习到 PFA 的行为。

关键创新:该方法最重要的技术创新点在于将 PFA 的状态和转移过程进行符号化表示,并利用前馈神经网络进行精确模拟。与现有方法相比,该方法具有更高的精度和可解释性,并且能够将 PFA 的理论与深度学习模型相结合。

关键设计:关键设计包括:1) 状态向量的维度等于 PFA 的状态数;2) 转移矩阵的每一行表示从一个状态到其他状态的转移概率;3) 前馈网络的层数等于输入序列的长度;4) 损失函数采用交叉熵损失,用于衡量网络输出与真实标签之间的差异。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法提出的符号前馈网络能够精确模拟概率有限自动机,并且可以通过梯度下降学习到 PFA 的行为。在合成数据集上,该方法能够以较高的精度恢复真实 PFA 的参数,证明了其有效性和可学习性。

🎯 应用场景

该研究成果可应用于自然语言处理、语音识别、生物信息学等领域,用于建模和学习序列数据中的概率转移关系。通过将概率自动机理论与深度学习相结合,可以提高模型的精度和可解释性,并为解决复杂序列建模问题提供新的思路。

📄 摘要(原文)

We present a formal and constructive theory showing that probabilistic finite automata (PFAs) can be exactly simulated using symbolic feedforward neural networks. Our architecture represents state distributions as vectors and transitions as stochastic matrices, enabling probabilistic state propagation via matrix-vector products. This yields a parallel, interpretable, and differentiable simulation of PFA dynamics using soft updates-without recurrence. We formally characterize probabilistic subset construction, $\varepsilon$-closure, and exact simulation via layered symbolic computation, and prove equivalence between PFAs and specific classes of neural networks. We further show that these symbolic simulators are not only expressive but learnable: trained with standard gradient descent-based optimization on labeled sequence data, they recover the exact behavior of ground-truth PFAs. This learnability, formalized in Proposition 5.1, is the crux of this work. Our results unify probabilistic automata theory with neural architectures under a rigorous algebraic framework, bridging the gap between symbolic computation and deep learning.