Learning to Coordinate: Distributed Meta-Trajectory Optimization Via Differentiable ADMM-DDP

作者: Bingheng Wang, Yichao Gao, Tianchen Sun, Lin Zhao

分类: cs.LG, cs.MA, cs.RO, eess.SY

发布日期: 2025-09-01 (更新: 2025-09-05)

💡 一句话要点

提出L2C框架,通过可微ADMM-DDP实现分布式元轨迹优化,解决多智能体协同问题。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 分布式优化 元学习 ADMM-DDP 多智能体协同 轨迹优化

📋 核心要点

- ADMM-DDP方法在多智能体协同中需要大量调参,这些参数共同控制局部任务性能和全局协同,人工调整成本高昂。

- L2C框架通过元学习智能体超参数,并以分布式方式端到端地微分ADMM-DDP流程,自适应不同任务和智能体配置。

- 实验表明,L2C在复杂任务中生成动态可行轨迹,适应不同团队规模,梯度计算速度比现有方法快88%。

📝 摘要(中文)

本文提出了一种名为Learning to Coordinate (L2C)的通用框架,用于元学习超参数,这些超参数由轻量级的智能体神经网络建模,以适应不同的任务和智能体配置。L2C以分布式方式端到端地通过ADMM-DDP流程进行微分。它还通过重用DDP组件(如Riccati递归和反馈增益)来实现高效的元梯度计算。这些梯度对应于分布式矩阵值LQR问题的最优解,这些问题通过辅助ADMM框架在智能体之间进行协调,该框架在温和的假设下变为凸优化问题。通过截断迭代和元学习ADMM惩罚参数(针对快速残差减少进行了优化),进一步加速了训练,并具有可证明的Lipschitz有界梯度误差。在具有挑战性的合作空中运输任务中,L2C使用IsaacSIM在高保真仿真中生成动态可行的轨迹,重新配置四旋翼飞行器编队以在狭小空间中安全地进行6自由度负载操作,并能鲁棒地适应不同的团队规模和任务条件,同时实现比最先进方法快达88%的梯度计算速度。

🔬 方法详解

问题定义:现有的基于ADMM-DDP的分布式轨迹优化方法在多智能体协同任务中表现出色,但其性能高度依赖于超参数的精细调整。这些超参数控制着局部任务的执行和全局的协同,需要大量的手动调整,且难以泛化到不同的任务和智能体配置。因此,如何自动地学习这些超参数,使其能够适应不同的任务和智能体配置,是一个亟待解决的问题。

核心思路:L2C的核心思路是利用元学习来自动学习ADMM-DDP算法中的关键超参数。具体来说,L2C使用轻量级的神经网络来建模每个智能体的超参数,并通过端到端的微分ADMM-DDP流程来优化这些网络。通过这种方式,L2C可以学习到一组能够适应不同任务和智能体配置的超参数,从而提高多智能体协同的性能和鲁棒性。

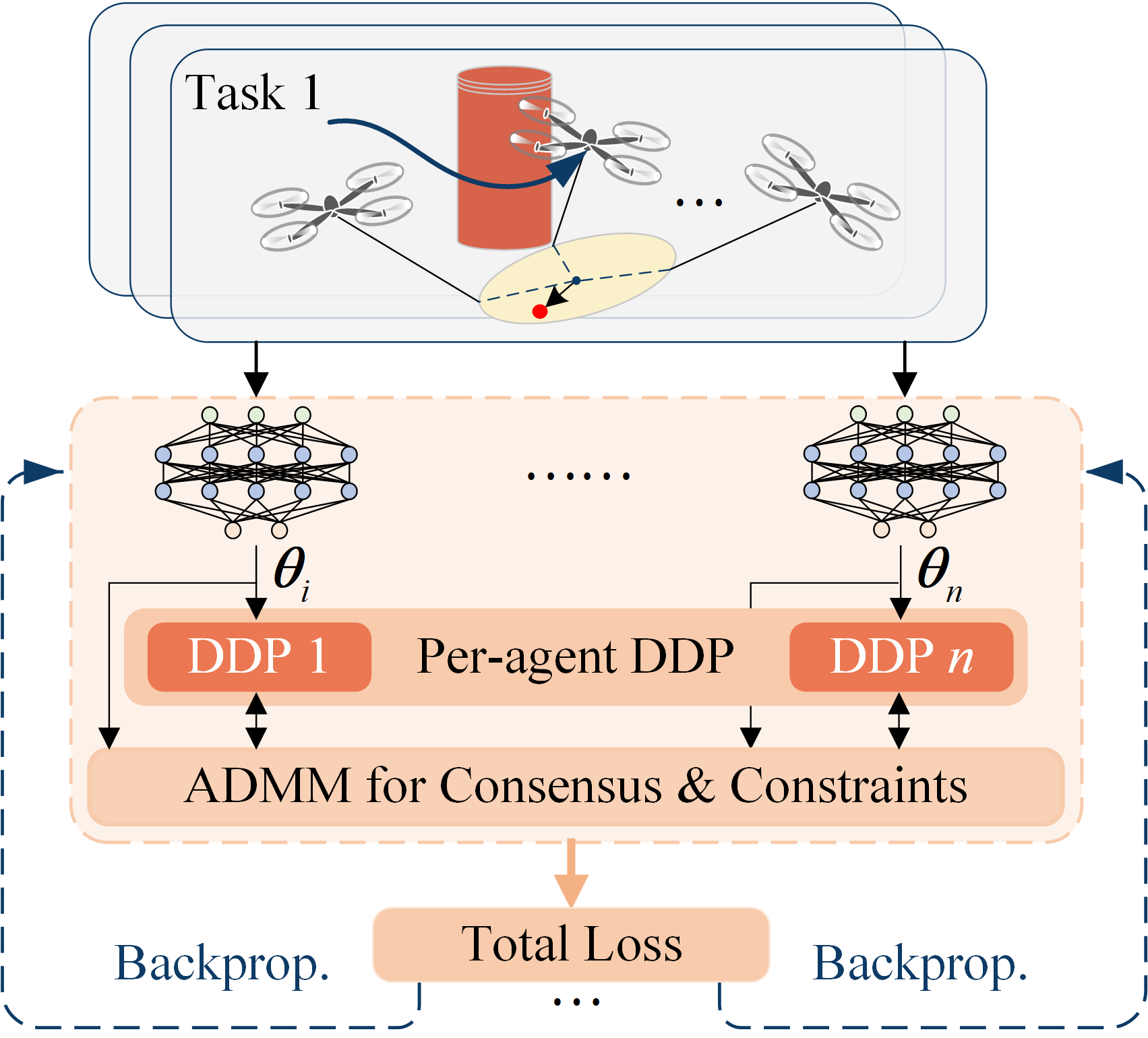

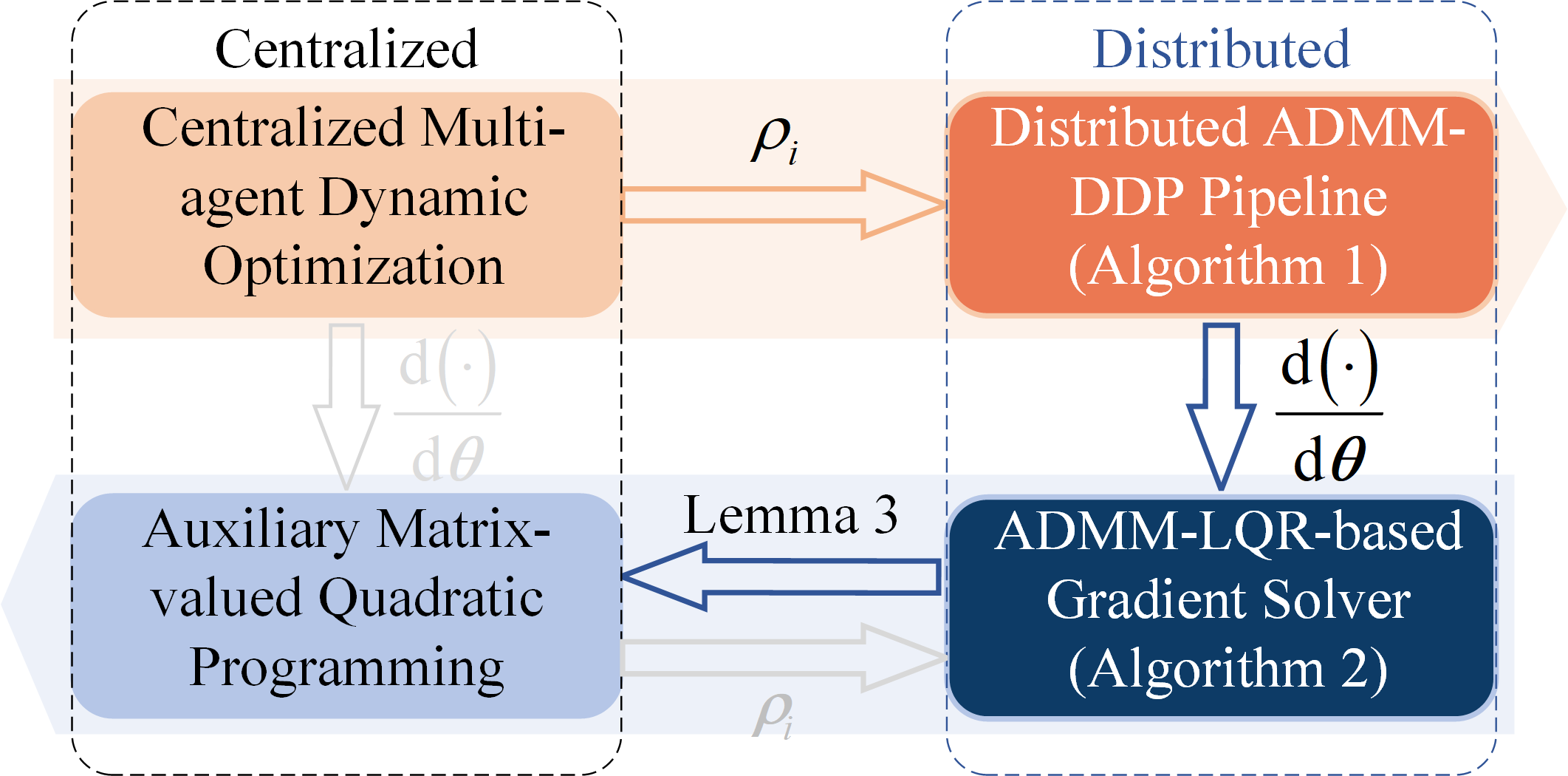

技术框架:L2C的整体框架包括以下几个主要模块:1) ADMM-DDP求解器:用于求解每个智能体的局部轨迹优化问题,并利用ADMM算法进行全局协同。2) 超参数网络:用于建模每个智能体的超参数,并根据当前的任务和智能体配置动态调整这些超参数。3) 元学习优化器:用于优化超参数网络,使其能够适应不同的任务和智能体配置。整个框架以端到端的方式进行训练,通过反向传播算法计算超参数网络的梯度,并利用元学习优化器更新网络参数。

关键创新:L2C最重要的技术创新点在于其端到端的可微ADMM-DDP流程。通过将ADMM-DDP算法嵌入到神经网络中,L2C可以利用反向传播算法计算超参数的梯度,从而实现自动的超参数学习。此外,L2C还通过重用DDP组件(如Riccati递归和反馈增益)来加速元梯度计算,并利用截断迭代和元学习ADMM惩罚参数来提高训练效率。与现有方法相比,L2C无需手动调整超参数,并且能够更好地适应不同的任务和智能体配置。

关键设计:L2C的关键设计包括:1) 超参数网络的结构:使用轻量级的神经网络来建模每个智能体的超参数,以减少计算量和提高泛化能力。2) 损失函数的设计:使用任务相关的损失函数来指导超参数的学习,例如,在合作空中运输任务中,可以使用负载的跟踪误差作为损失函数。3) ADMM惩罚参数的优化:通过元学习来优化ADMM惩罚参数,以加速残差减少和提高收敛速度。4) 梯度截断:通过截断迭代来减少计算量,并利用Lipschitz有界梯度误差来保证训练的稳定性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,L2C在合作空中运输任务中表现出色,能够生成动态可行的轨迹,并能鲁棒地适应不同的团队规模和任务条件。与最先进的方法相比,L2C实现了高达88%的梯度计算速度提升。此外,L2C还能够在高保真仿真环境(IsaacSIM)中成功运行,验证了其在实际应用中的可行性。

🎯 应用场景

L2C框架具有广泛的应用前景,可应用于多机器人协同、自动驾驶、智能交通等领域。例如,在多机器人协同任务中,L2C可以用于自动学习机器人的控制参数,使其能够更好地协同完成任务。在自动驾驶领域,L2C可以用于自动学习车辆的驾驶策略,使其能够更好地适应不同的交通环境。该研究的实际价值在于降低了多智能体系统设计的复杂性,提升了系统的自适应性和鲁棒性,未来有望推动多智能体系统的广泛应用。

📄 摘要(原文)

Distributed trajectory optimization via ADMM-DDP is a powerful approach for coordinating multi-agent systems, but it requires extensive tuning of tightly coupled hyperparameters that jointly govern local task performance and global coordination. In this paper, we propose Learning to Coordinate (L2C), a general framework that meta-learns these hyperparameters, modeled by lightweight agent-wise neural networks, to adapt across diverse tasks and agent configurations. L2C differentiates end-to-end through the ADMM-DDP pipeline in a distributed manner. It also enables efficient meta-gradient computation by reusing DDP components such as Riccati recursions and feedback gains. These gradients correspond to the optimal solutions of distributed matrix-valued LQR problems, coordinated across agents via an auxiliary ADMM framework that becomes convex under mild assumptions. Training is further accelerated by truncating iterations and meta-learning ADMM penalty parameters optimized for rapid residual reduction, with provable Lipschitz-bounded gradient errors. On a challenging cooperative aerial transport task, L2C generates dynamically feasible trajectories in high-fidelity simulation using IsaacSIM, reconfigures quadrotor formations for safe 6-DoF load manipulation in tight spaces, and adapts robustly to varying team sizes and task conditions, while achieving up to $88\%$ faster gradient computation than state-of-the-art methods.