Provable Benefits of In-Tool Learning for Large Language Models

作者: Sam Houliston, Ambroise Odonnat, Charles Arnal, Vivien Cabannes

分类: cs.LG, cs.AI, stat.ML

发布日期: 2025-08-28

💡 一句话要点

证明工具学习在大语言模型中优于权重记忆,实现无限事实回忆

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 工具学习 大语言模型 事实回忆 外部知识 可扩展性

📋 核心要点

- 现有大语言模型的事实记忆能力受限于模型参数量,难以有效扩展。

- 论文提出利用外部工具进行事实检索,突破模型自身参数的限制,实现无限的事实回忆。

- 实验证明,工具增强型模型在事实回忆方面显著优于纯记忆模型,验证了理论分析。

📝 摘要(中文)

配备检索、记忆或外部API的工具增强型语言模型正在重塑人工智能,但其理论优势仍未得到充分探索。本文通过证明工具学习(外部检索)在事实回忆方面优于权重学习(记忆),解决了这个问题。我们表明,模型仅在其权重中记忆的事实数量从根本上受到其参数数量的限制。相反,我们证明,工具的使用通过简单有效的电路构造实现了无限的事实回忆。这些结果在受控实验中得到验证,其中使用工具的模型始终优于记忆模型。我们进一步表明,对于预训练的大型语言模型,教授工具的使用和通用规则比将事实微调到记忆中更有效。我们的工作提供了理论和经验基础,确立了工具增强型工作流程不仅实用,而且在可扩展性方面更胜一筹的原因。

🔬 方法详解

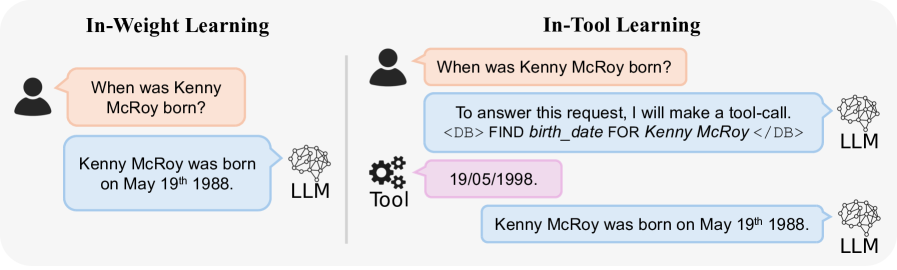

问题定义:论文旨在解决大语言模型事实记忆的扩展性问题。现有方法主要依赖于模型参数来记忆事实,但模型参数量有限,导致事实记忆能力存在上限,无法满足日益增长的知识需求。这种“in-weight learning”的方式存在根本性的瓶颈。

核心思路:论文的核心思路是利用外部工具(如检索系统)进行事实检索,将事实存储在外部知识库中,模型需要时通过工具进行检索。这种“in-tool learning”的方式可以将事实记忆与模型参数解耦,从而突破模型参数的限制,实现无限的事实回忆。

技术框架:论文构建了一个简单的电路模型来证明工具学习的优势。该模型包含一个语言模型和一个外部检索工具。语言模型负责生成查询,检索工具负责根据查询从外部知识库中检索相关事实,然后语言模型利用检索到的事实进行推理或回答问题。整体流程包括查询生成、信息检索和知识融合三个主要阶段。

关键创新:论文最重要的技术创新点在于证明了工具学习可以实现无限的事实回忆,而权重学习存在固有的参数限制。这种理论证明为工具增强型语言模型的发展提供了坚实的理论基础。此外,论文还通过实验验证了工具学习的有效性,表明其在实际应用中具有显著的优势。

关键设计:论文使用了一个简单的电路模型进行理论分析,该模型易于分析和理解。在实验方面,论文设计了受控实验,比较了工具学习和权重学习的性能。此外,论文还研究了如何有效地教授预训练语言模型使用工具,并发现教授通用规则比微调事实更有效。

🖼️ 关键图片

📊 实验亮点

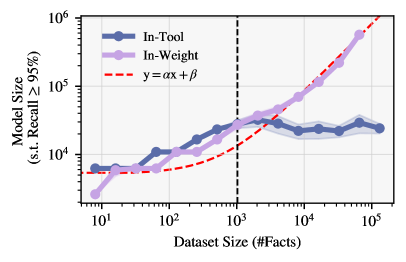

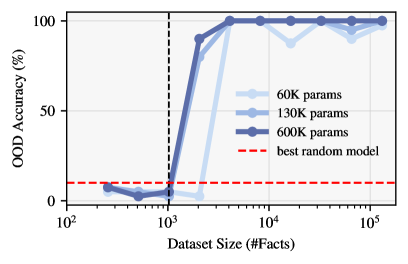

实验结果表明,工具增强型模型在事实回忆方面显著优于纯记忆模型。具体来说,在受控实验中,工具学习模型能够回忆的事实数量远超权重学习模型,并且随着知识库规模的增加,工具学习模型的性能持续提升,而权重学习模型则很快达到饱和。此外,研究还发现,对于预训练的大型语言模型,教授工具的使用和通用规则比将事实微调到记忆中更有效。

🎯 应用场景

该研究成果可应用于各种需要大量事实知识的场景,如问答系统、知识图谱构建、智能客服等。通过利用外部工具,可以构建更强大、更可扩展的语言模型,从而更好地服务于用户,并推动人工智能技术的发展。未来的影响在于,它为构建更智能、更可靠的AI系统指明了方向。

📄 摘要(原文)

Tool-augmented language models, equipped with retrieval, memory, or external APIs, are reshaping AI, yet their theoretical advantages remain underexplored. In this paper, we address this question by demonstrating the benefits of in-tool learning (external retrieval) over in-weight learning (memorization) for factual recall. We show that the number of facts a model can memorize solely in its weights is fundamentally limited by its parameter count. In contrast, we prove that tool-use enables unbounded factual recall via a simple and efficient circuit construction. These results are validated in controlled experiments, where tool-using models consistently outperform memorizing ones. We further show that for pretrained large language models, teaching tool-use and general rules is more effective than finetuning facts into memory. Our work provides both a theoretical and empirical foundation, establishing why tool-augmented workflows are not just practical, but provably more scalable.