SafeLLM: Unlearning Harmful Outputs from Large Language Models against Jailbreak Attacks

作者: Xiangman Li, Xiaodong Wu, Qi Li, Jianbing Ni, Rongxing Lu

分类: cs.LG

发布日期: 2025-08-21

💡 一句话要点

SafeLLM:提出基于遗忘学习的防御框架,对抗大语言模型的越狱攻击

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型安全 越狱攻击防御 遗忘学习 有害内容检测 前馈网络激活

📋 核心要点

- 大型语言模型面临越狱攻击威胁,攻击者通过对抗性提示绕过对齐机制,诱导模型生成有害内容。

- SafeLLM提出基于遗忘学习的防御框架,通过动态检测、有害内容追踪和约束优化,消除LLM中的有害知识。

- 实验表明,SafeLLM能有效降低越狱攻击成功率,同时保持模型通用性能,优于传统防御方法。

📝 摘要(中文)

本文提出SafeLLM,一种新颖的基于遗忘学习的防御框架,旨在从大型语言模型(LLM)中消除有害知识,同时保持语言流畅性和通用能力。SafeLLM采用三阶段流程:(1)使用混合方法动态检测不安全输出,该方法将外部分类器与模型内部评估相结合;(2)通过前馈网络(FFN)激活进行token级别有害内容追踪,以定位有害知识;(3)约束优化,以抑制不安全行为,同时不降低整体模型质量。SafeLLM通过识别和中和负责有害生成路径的FFN子结构,实现有针对性的、不可逆的遗忘。在多个越狱基准测试中,对主流LLM(Vicuna、LLaMA和GPT-J)的广泛实验表明,SafeLLM显著降低了攻击成功率,同时保持了较高的通用性能。与监督微调和直接偏好优化等标准防御方法相比,SafeLLM提供了更强的安全保证、对有害行为更精确的控制以及对未知攻击更大的鲁棒性。此外,SafeLLM在遗忘有害知识后保持了通用性能。这些结果表明,遗忘学习是可扩展且有效的LLM安全方向。

🔬 方法详解

问题定义:大型语言模型(LLM)容易受到越狱攻击,攻击者构造对抗性prompt,绕过模型的安全对齐机制,导致模型生成有害、受限或有偏见的内容。现有的防御方法,如监督微调和直接偏好优化,在安全保证、精确控制和鲁棒性方面存在不足,且可能影响模型的通用性能。

核心思路:SafeLLM的核心思路是通过遗忘学习,从LLM中选择性地移除有害知识,同时保留其语言能力和通用知识。通过识别并中和负责生成有害内容的神经网络结构,实现有针对性的、不可逆的遗忘。这种方法旨在更精确地控制有害行为,并提高模型对未知攻击的鲁棒性。

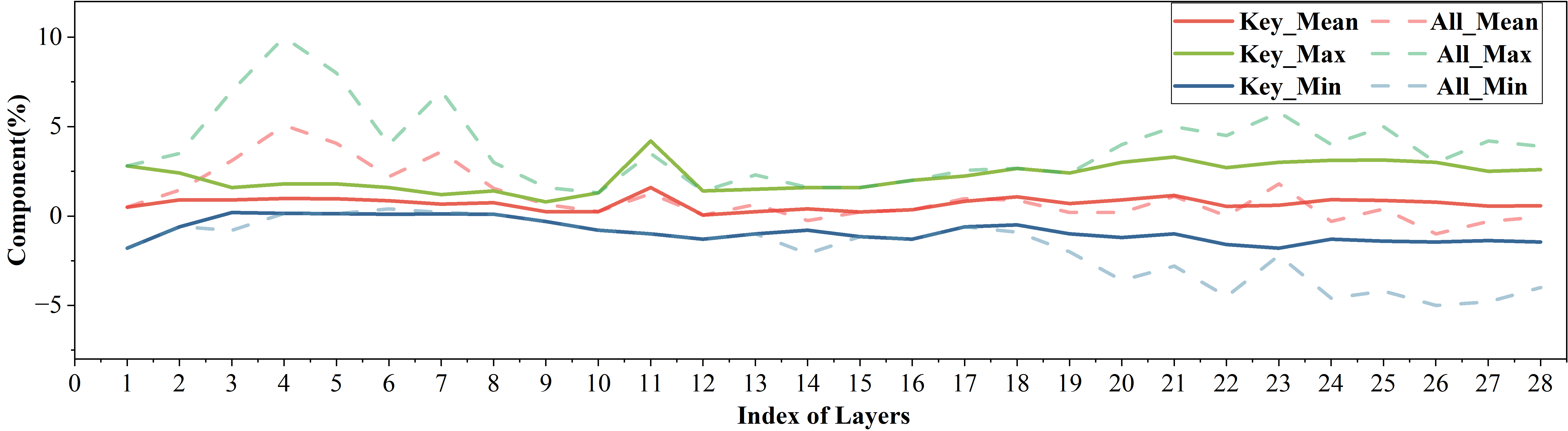

技术框架:SafeLLM包含三个主要阶段:(1)动态不安全输出检测:使用混合方法,结合外部分类器和模型内部评估,动态检测LLM生成的不安全输出。(2)token级别有害内容追踪:通过分析前馈网络(FFN)的激活,追踪有害内容到具体的token,从而定位有害知识在模型中的位置。(3)约束优化:通过约束优化,抑制不安全行为,同时避免降低模型的整体质量。

关键创新:SafeLLM的关键创新在于其基于遗忘学习的防御框架,以及token级别的有害内容追踪方法。与传统的防御方法不同,SafeLLM不是简单地对模型进行微调或优化,而是直接从模型中移除有害知识,从而实现更强的安全保证和更精确的控制。

关键设计:在动态不安全输出检测阶段,使用了外部分类器和模型内部评估相结合的混合方法,以提高检测的准确性。在token级别有害内容追踪阶段,通过分析FFN的激活,定位有害知识在模型中的位置。在约束优化阶段,设计了特定的损失函数,以抑制不安全行为,同时保持模型的通用性能。具体参数设置和网络结构细节在论文中进行了详细描述。

🖼️ 关键图片

📊 实验亮点

SafeLLM在Vicuna、LLaMA和GPT-J等主流LLM上进行了广泛实验,结果表明,SafeLLM能够显著降低越狱攻击的成功率,同时保持较高的通用性能。与监督微调和直接偏好优化等标准防御方法相比,SafeLLM提供了更强的安全保证、对有害行为更精确的控制以及对未知攻击更大的鲁棒性。实验结果证明了遗忘学习在LLM安全防御方面的有效性。

🎯 应用场景

SafeLLM的研究成果可应用于各种需要安全保障的大型语言模型应用场景,例如智能客服、内容生成、教育辅导等。通过消除模型中的有害知识,可以有效防止模型被用于恶意目的,提高用户信任度,并促进LLM技术的健康发展。该研究也为未来LLM安全防御提供了新的思路和方法。

📄 摘要(原文)

Jailbreak attacks pose a serious threat to the safety of Large Language Models (LLMs) by crafting adversarial prompts that bypass alignment mechanisms, causing the models to produce harmful, restricted, or biased content. In this paper, we propose SafeLLM, a novel unlearning-based defense framework that unlearn the harmful knowledge from LLMs while preserving linguistic fluency and general capabilities. SafeLLM employs a three-stage pipeline: (1) dynamic unsafe output detection using a hybrid approach that integrates external classifiers with model-internal evaluations; (2) token-level harmful content tracing through feedforward network (FFN) activations to localize harmful knowledge; and (3) constrained optimization to suppress unsafe behavior without degrading overall model quality. SafeLLM achieves targeted and irreversible forgetting by identifying and neutralizing FFN substructures responsible for harmful generation pathways. Extensive experiments on prominent LLMs (Vicuna, LLaMA, and GPT-J) across multiple jailbreak benchmarks show that SafeLLM substantially reduces attack success rates while maintaining high general-purpose performance. Compared to standard defense methods such as supervised fine-tuning and direct preference optimization, SafeLLM offers stronger safety guarantees, more precise control over harmful behavior, and greater robustness to unseen attacks. Moreover, SafeLLM maintains the general performance after the harmful knowledge unlearned. These results highlight unlearning as a promising direction for scalable and effective LLM safety.