ASkDAgger: Active Skill-level Data Aggregation for Interactive Imitation Learning

作者: Jelle Luijkx, Zlatan Ajanović, Laura Ferranti, Jens Kober

分类: cs.LG, cs.AI, cs.HC, cs.RO

发布日期: 2025-08-07

备注: Accepted for publication in Transactions on Machine Learning Research (TMLR, 2025)

💡 一句话要点

提出ASkDAgger,通过主动技能级数据聚合提升交互式模仿学习效率。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 交互式模仿学习 主动学习 数据聚合 机器人操作 语言条件任务

📋 核心要点

- 现有交互式模仿学习方法依赖大量人工标注,忽略了新手自身计划动作中蕴含的能力和不确定性信息。

- ASkDAgger框架允许新手表达不确定性,并利用教师反馈,通过SAG、FIER和PIER三个模块提升学习效率。

- 实验表明,ASkDAgger能有效减少标注需求,提高泛化能力,并加速适应新环境,在模拟和真实环境中均有验证。

📝 摘要(中文)

交互式模仿学习中,人工教学成本是其广泛应用的主要瓶颈。为了减少所需的查询次数,现有方法采用主动学习,仅在不确定、有风险或新颖的情况下查询人类教师。然而,这些查询忽略了新手的计划动作,尽管其中包含有价值的信息,例如新手的能力以及相应的不确定性水平。为此,论文允许新手表达:“我计划这样做,但我不太确定。”论文提出了主动技能级数据聚合(ASkDAgger)框架,该框架通过三种关键方式利用教师对新手计划的反馈:(1)S-Aware Gating (SAG):调整门控阈值以跟踪敏感性、特异性或最小成功率;(2)Foresight Interactive Experience Replay (FIER):将有效且重新标记的新手动作计划转化为演示;(3)Prioritized Interactive Experience Replay (PIER):根据不确定性、新手成功率和演示年龄来优先回放。这些组件共同平衡了查询频率与失败发生率,减少了所需的演示标注数量,提高了泛化能力,并加快了对变化领域的适应。论文通过模拟和真实环境中的语言条件操作任务验证了ASkDAgger的有效性。

🔬 方法详解

问题定义:交互式模仿学习旨在通过与人类教师的交互,使智能体学习完成特定任务。然而,现有方法通常需要大量的人工标注数据,尤其是在智能体遇到不确定或困难情况时。这些方法忽略了新手(智能体)自身对任务的理解和尝试,以及其中包含的潜在价值信息,例如智能体的能力范围和对自身行为的不确定性评估。因此,如何更有效地利用新手自身的信息,减少对人类教师的依赖,是本论文要解决的核心问题。

核心思路:ASkDAgger的核心思路是让新手在执行动作前,能够表达自身的不确定性,并利用人类教师对新手计划动作的反馈来指导学习。通过这种方式,ASkDAgger能够更有效地利用新手自身的信息,减少对人类教师的查询次数,并提高学习效率。这种设计模拟了人类学习的过程,即学生在尝试解决问题时,会主动寻求老师的指导,并根据老师的反馈调整自己的策略。

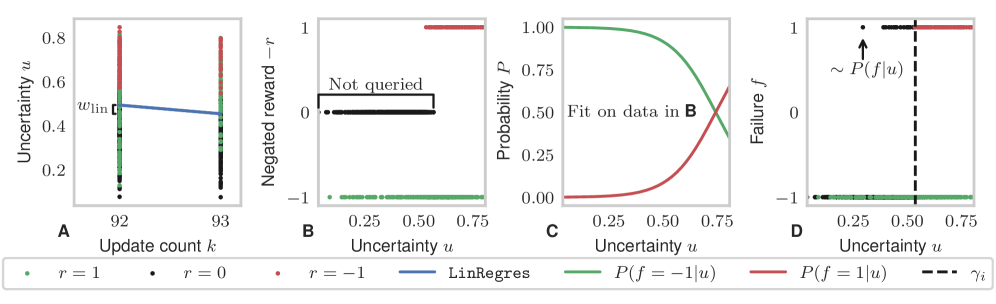

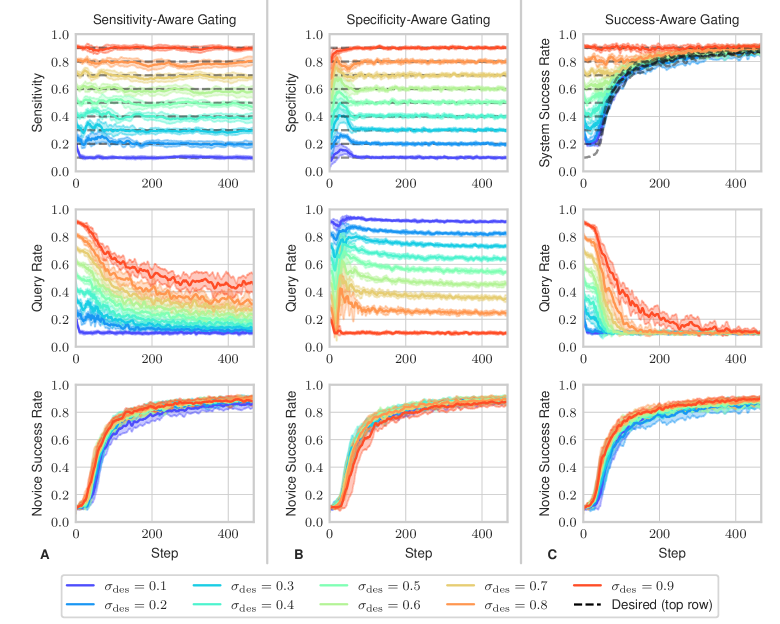

技术框架:ASkDAgger框架主要包含以下几个模块: 1. S-Aware Gating (SAG):根据新手表达的不确定性,动态调整门控阈值,以决定何时向人类教师发起查询。SAG旨在平衡查询频率和任务成功率,避免不必要的查询,同时确保智能体能够及时获得指导。 2. Foresight Interactive Experience Replay (FIER):将人类教师认可或重新标记的新手动作计划转化为高质量的演示数据,并将其加入经验回放缓冲区。FIER能够有效地利用人类教师的反馈,增强智能体的学习效果。 3. Prioritized Interactive Experience Replay (PIER):根据不确定性、新手成功率和演示年龄等因素,对经验回放缓冲区中的数据进行优先级排序。PIER能够使智能体更关注重要的经验,提高学习效率。

关键创新:ASkDAgger的关键创新在于其主动技能级数据聚合策略。与传统的主动学习方法不同,ASkDAgger不仅关注智能体遇到的不确定性,还考虑了智能体自身的计划动作和能力。通过允许智能体表达不确定性,并利用人类教师的反馈,ASkDAgger能够更有效地利用数据,减少对人类教师的依赖。此外,FIER和PIER模块的设计也进一步提高了学习效率和泛化能力。

关键设计: * SAG的阈值调整策略:论文中,SAG的阈值可以根据不同的目标进行调整,例如最大化敏感性、特异性或最小化失败率。具体的调整策略需要根据具体的任务和数据集进行选择。 * FIER的数据增强策略:论文中,FIER不仅将人类教师认可的动作计划转化为演示数据,还允许人类教师对错误的动作计划进行重新标记。这种数据增强策略能够有效地提高智能体的鲁棒性。 * PIER的优先级排序策略:论文中,PIER根据不确定性、新手成功率和演示年龄等因素对经验进行排序。具体的排序权重需要根据具体的任务和数据集进行调整。

🖼️ 关键图片

📊 实验亮点

实验结果表明,ASkDAgger在语言条件操作任务中表现出色,显著减少了所需的演示标注数量,提高了泛化能力,并加速了对变化领域的适应。具体而言,与现有方法相比,ASkDAgger能够在保证任务成功率的前提下,减少高达50%的人工标注需求。

🎯 应用场景

ASkDAgger框架具有广泛的应用前景,可应用于机器人操作、自动驾驶、游戏AI等领域。通过减少对人工标注的依赖,该方法能够降低智能体学习的成本,并提高其适应新环境的能力。未来,ASkDAgger有望成为一种通用的交互式模仿学习框架,推动人工智能技术的进一步发展。

📄 摘要(原文)

Human teaching effort is a significant bottleneck for the broader applicability of interactive imitation learning. To reduce the number of required queries, existing methods employ active learning to query the human teacher only in uncertain, risky, or novel situations. However, during these queries, the novice's planned actions are not utilized despite containing valuable information, such as the novice's capabilities, as well as corresponding uncertainty levels. To this end, we allow the novice to say: "I plan to do this, but I am uncertain." We introduce the Active Skill-level Data Aggregation (ASkDAgger) framework, which leverages teacher feedback on the novice plan in three key ways: (1) S-Aware Gating (SAG): Adjusts the gating threshold to track sensitivity, specificity, or a minimum success rate; (2) Foresight Interactive Experience Replay (FIER), which recasts valid and relabeled novice action plans into demonstrations; and (3) Prioritized Interactive Experience Replay (PIER), which prioritizes replay based on uncertainty, novice success, and demonstration age. Together, these components balance query frequency with failure incidence, reduce the number of required demonstration annotations, improve generalization, and speed up adaptation to changing domains. We validate the effectiveness of ASkDAgger through language-conditioned manipulation tasks in both simulation and real-world environments. Code, data, and videos are available at https://askdagger.github.io.