Domain-driven Metrics for Reinforcement Learning: A Case Study on Epidemic Control using Agent-based Simulation

作者: Rishabh Gaur, Gaurav Deshkar, Jayanta Kshirsagar, Harshal Hayatnagarkar, Janani Venugopalan

分类: cs.LG, cs.AI, cs.MA

发布日期: 2025-08-07

💡 一句话要点

提出领域驱动的强化学习评估指标,用于基于Agent的疫情控制仿真。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 强化学习 Agent-based模型 领域驱动指标 疫情控制 策略优化

📋 核心要点

- 现有强化学习在ABM和RABM模型中应用广泛,但缺乏标准化评估指标,难以有效评估模型性能。

- 论文提出领域驱动的强化学习指标,结合领域知识设计奖励函数,提升策略优化效果。

- 通过疫情控制案例研究,验证了领域驱动奖励与传统指标结合的有效性,尤其在不同场景下。

📝 摘要(中文)

在Agent-based模型(ABM)和理性Agent-based模型(RABM)的开发和优化中,强化学习等优化算法被广泛使用。然而,由于建模系统的复杂性和随机性,以及缺乏用于比较强化学习算法的良好标准化指标,评估基于强化学习的ABM和RABM模型的性能具有挑战性。本研究在现有先进指标的基础上,为强化学习开发领域驱动的指标。我们通过在一个理性ABM疾病建模案例研究中进行策略优化来展示我们的“领域驱动的强化学习指标”,以模拟疫情中的口罩佩戴行为、疫苗接种和封锁。结果表明,领域驱动的奖励与传统和最先进的指标结合使用,适用于一些不同的模拟场景,例如口罩的不同可用性。

🔬 方法详解

问题定义:现有基于强化学习的ABM和RABM模型,在评估性能时面临挑战,主要原因是缺乏标准化的、能够反映领域特性的评估指标。传统的强化学习指标可能无法充分捕捉复杂系统中的关键行为和领域知识,导致策略优化效果不佳。

核心思路:论文的核心思路是引入“领域驱动”的视角,设计与特定领域知识相关的奖励函数和评估指标。通过将领域专家的知识融入到强化学习过程中,可以更有效地引导Agent学习到符合实际需求的策略,并更准确地评估模型的性能。

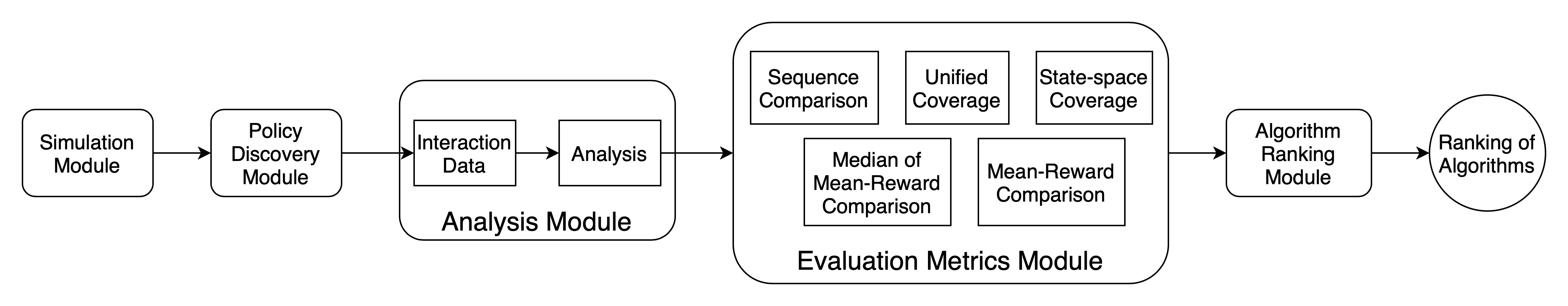

技术框架:该研究的技术框架主要包括以下几个部分:1)构建基于Agent的疫情传播仿真模型(ABM);2)利用强化学习算法(具体算法未知)优化Agent的行为策略,例如口罩佩戴、疫苗接种和封锁;3)设计领域驱动的奖励函数,鼓励Agent采取符合疫情控制目标的行为;4)结合传统强化学习指标和领域驱动指标,综合评估模型的性能。

关键创新:该研究的关键创新在于提出了“领域驱动的强化学习指标”这一概念,并将其应用于疫情控制的ABM模型中。与传统的强化学习方法相比,该方法能够更好地利用领域知识,提高策略优化的效率和效果。

关键设计:论文的关键设计包括:1)领域驱动奖励函数的具体形式,如何将疫情控制的目标(例如降低感染率、减少死亡人数)转化为奖励信号;2)如何选择和组合传统强化学习指标和领域驱动指标,以全面评估模型的性能;3)ABM模型中Agent的行为规则和交互方式,如何模拟真实世界中的疫情传播过程。

🖼️ 关键图片

📊 实验亮点

研究结果表明,在疫情控制的ABM模型中,结合领域驱动的奖励函数和传统强化学习指标,能够更有效地优化Agent的行为策略。例如,在口罩可用性不同的场景下,该方法能够找到更合理的口罩佩戴策略,从而降低感染率。具体的性能提升数据未知。

🎯 应用场景

该研究提出的领域驱动的强化学习指标,可广泛应用于复杂系统的建模与优化,例如交通管理、资源分配、供应链优化等。通过结合领域知识,可以更有效地训练智能体,提升决策效率和系统性能,为实际应用提供更可靠的解决方案。

📄 摘要(原文)

For the development and optimization of agent-based models (ABMs) and rational agent-based models (RABMs), optimization algorithms such as reinforcement learning are extensively used. However, assessing the performance of RL-based ABMs and RABMS models is challenging due to the complexity and stochasticity of the modeled systems, and the lack of well-standardized metrics for comparing RL algorithms. In this study, we are developing domain-driven metrics for RL, while building on state-of-the-art metrics. We demonstrate our ``Domain-driven-RL-metrics'' using policy optimization on a rational ABM disease modeling case study to model masking behavior, vaccination, and lockdown in a pandemic. Our results show the use of domain-driven rewards in conjunction with traditional and state-of-the-art metrics for a few different simulation scenarios such as the differential availability of masks.