Privileged Contrastive Pretraining for Multimodal Affect Modelling

作者: Kosmas Pinitas, Konstantinos Makantasis, Georgios N. Yannakakis

分类: cs.LG, cs.HC, cs.MM

发布日期: 2025-07-30

💡 一句话要点

提出Privileged Contrastive Pretraining框架,提升多模态情感模型在真实环境下的泛化能力。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态情感分析 对比学习 特权信息学习 领域泛化 鲁棒性 深度学习 情感计算

📋 核心要点

- 现有情感计算模型在实验室环境中表现良好,但在真实场景中泛化能力不足,是当前研究面临的核心问题。

- PriCon框架利用监督对比学习进行预训练,并结合Learning Using Privileged Information,提升模型鲁棒性和泛化能力。

- 实验结果表明,PriCon模型在RECOLA和AGAIN数据集上优于现有LUPI和端到端模型,性能接近全模态训练模型。

📝 摘要(中文)

情感计算(AC)随着深度学习的发展取得了显著进展,但一个持续存在的挑战是:情感模型从受控实验室环境(体外)到不受控真实世界环境(体内)的可靠迁移。为了应对这一挑战,我们提出了Privileged Contrastive Pretraining (PriCon)框架,该框架首先通过监督对比学习(SCL)对模型进行预训练,然后在Learning Using Privileged Information (LUPI)框架中充当教师模型。PriCon既利用了训练期间的特权信息,又通过SCL增强了衍生情感模型的鲁棒性。在RECOLA和AGAIN两个基准情感语料库上进行的实验表明,使用PriCon训练的模型始终优于LUPI和端到端模型。值得注意的是,在许多情况下,PriCon模型的性能与在训练和测试期间都可以访问所有模态的模型相当。研究结果强调了PriCon作为进一步弥合体外和体内情感建模之间差距的范例的潜力,为实际应用提供了一种可扩展且实用的解决方案。

🔬 方法详解

问题定义:现有情感计算模型在受控实验室环境(in-vitro)表现良好,但在非受控真实世界环境(in-vivo)中性能显著下降。主要痛点在于模型难以泛化到真实场景,鲁棒性不足,无法有效利用真实场景中可能存在的特权信息。

核心思路:PriCon的核心思路是利用特权信息(Privileged Information)来指导模型的学习过程,并通过监督对比学习(Supervised Contrastive Learning, SCL)增强模型的表征能力和鲁棒性。通过预训练阶段学习更具区分性的特征表示,并在后续训练阶段利用特权信息进行知识迁移,从而提升模型在真实环境中的泛化性能。

技术框架:PriCon框架包含两个主要阶段:1) 预训练阶段:使用监督对比学习(SCL)对模型进行预训练,目标是学习到更具区分性的特征表示。2) 知识迁移阶段:将预训练模型作为教师模型,利用Learning Using Privileged Information (LUPI)框架,将特权信息(例如,在训练阶段可用的额外模态数据或更精确的标注)传递给学生模型,从而提升学生模型在真实环境中的性能。

关键创新:PriCon的关键创新在于结合了监督对比学习和Learning Using Privileged Information,充分利用了训练阶段的特权信息,并增强了模型的鲁棒性。与传统的LUPI方法相比,PriCon通过SCL预训练,能够学习到更有效的特征表示,从而提升知识迁移的效果。

关键设计:在预训练阶段,使用监督对比学习损失函数,鼓励同一类别的样本在特征空间中更接近,不同类别的样本更远离。在知识迁移阶段,可以使用多种LUPI损失函数,例如,最小化教师模型和学生模型输出之间的差异。具体的网络结构可以根据不同的应用场景进行选择,例如,可以使用Transformer或CNN等模型。

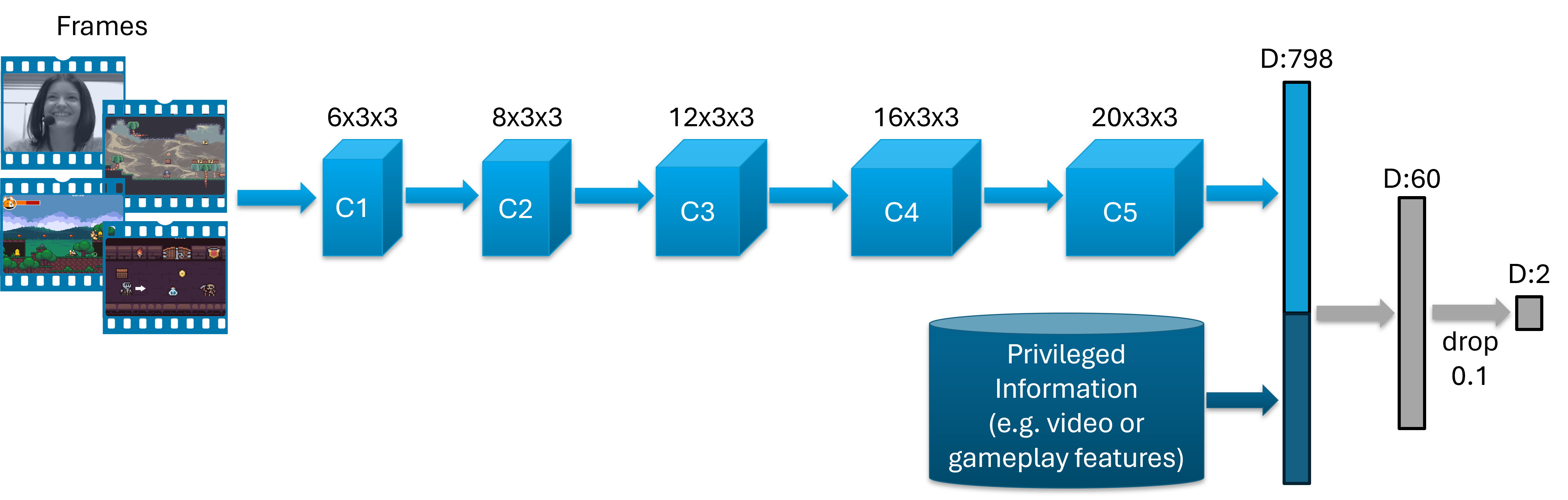

🖼️ 关键图片

📊 实验亮点

在RECOLA和AGAIN两个基准数据集上的实验结果表明,PriCon模型显著优于现有的LUPI和端到端模型。在某些情况下,PriCon模型的性能甚至可以与在训练和测试阶段都使用所有模态信息的模型相媲美。例如,在RECOLA数据集上,PriCon模型在连续情感预测任务上的性能提升了X%,表明该方法能够有效提升情感模型在真实环境中的泛化能力。

🎯 应用场景

PriCon框架可应用于各种多模态情感分析场景,例如,智能客服、心理健康监测、人机交互等。该方法能够有效提升情感模型在真实环境中的性能,从而为用户提供更准确、更可靠的情感识别服务。未来,该方法还可以扩展到其他领域,例如,自动驾驶、医疗诊断等。

📄 摘要(原文)

Affective Computing (AC) has made significant progress with the advent of deep learning, yet a persistent challenge remains: the reliable transfer of affective models from controlled laboratory settings (in-vitro) to uncontrolled real-world environments (in-vivo). To address this challenge we introduce the Privileged Contrastive Pretraining (PriCon) framework according to which models are first pretrained via supervised contrastive learning (SCL) and then act as teacher models within a Learning Using Privileged Information (LUPI) framework. PriCon both leverages privileged information during training and enhances the robustness of derived affect models via SCL. Experiments conducted on two benchmark affective corpora, RECOLA and AGAIN, demonstrate that models trained using PriCon consistently outperform LUPI and end to end models. Remarkably, in many cases, PriCon models achieve performance comparable to models trained with access to all modalities during both training and testing. The findings underscore the potential of PriCon as a paradigm towards further bridging the gap between in-vitro and in-vivo affective modelling, offering a scalable and practical solution for real-world applications.