Hybrid Hypergraph Networks for Multimodal Sequence Data Classification

作者: Feng Xu, Hui Wang, Yuting Huang, Danwei Zhang, Zizhu Fan

分类: cs.LG

发布日期: 2025-07-30

备注: 9 pages, 5 figures

💡 一句话要点

提出混合超图网络HHN,用于建模多模态时序数据分类,提升长程依赖和跨模态交互。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态学习 时序数据 超图网络 图神经网络 跨模态融合

📋 核心要点

- 现有方法在处理多模态时序数据时,难以有效捕捉长程时序依赖和复杂的跨模态交互。

- HHN采用分割优先、图后建的策略,构建混合超图来建模模态内和模态间的复杂关系。

- 实验结果表明,HHN在四个多模态数据集上取得了SOTA结果,验证了其有效性。

📝 摘要(中文)

本文提出了一种用于多模态时序数据分类的混合超图网络(HHN)框架。该框架旨在解决现有方法在捕捉长程时序依赖和复杂跨模态交互方面的不足。HHN采用“分割优先,图后建”的策略,首先将序列分割成带时间戳的片段作为异构图中的节点。然后,通过最大熵差准则引导的超边捕获模态内结构,增强节点异质性和结构区分性,并通过超图卷积提取高阶依赖关系。最后,通过时间对齐和图注意力机制建立模态间连接,实现语义融合。在四个多模态数据集上的实验结果表明,HHN达到了最先进的性能,验证了其在复杂分类任务中的有效性。

🔬 方法详解

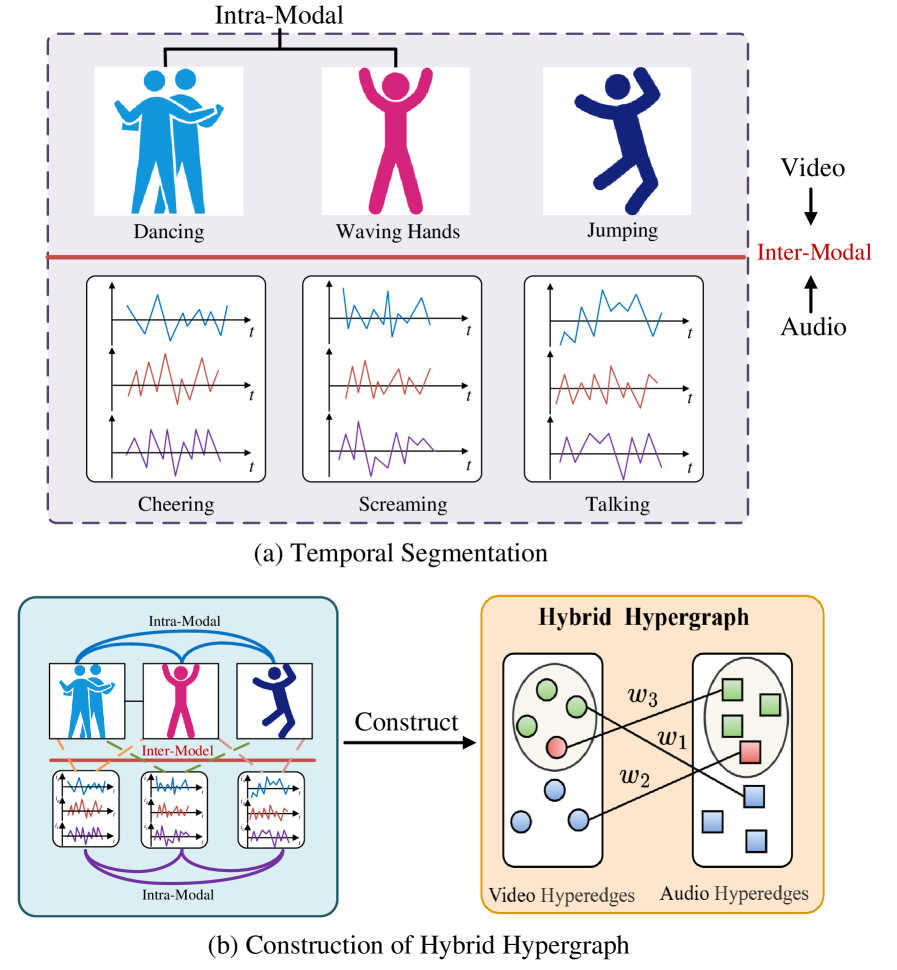

问题定义:论文旨在解决多模态时序数据分类问题,例如音视频数据的分类。现有方法通常独立处理每个模态,并采用浅层融合策略,忽略了时序依赖关系,无法充分表示复杂的结构关系。这些方法难以捕捉长程时序依赖和模态间的复杂交互,限制了模型的性能。

核心思路:论文的核心思路是利用超图来建模多模态时序数据。通过将时序序列分割成片段,并将这些片段作为超图的节点,可以更好地捕捉节点之间的复杂关系。利用超边来表示模态内的结构信息,并通过图注意力机制融合不同模态的信息,从而实现更有效的多模态融合。这种方法能够更好地捕捉长程时序依赖和跨模态交互。

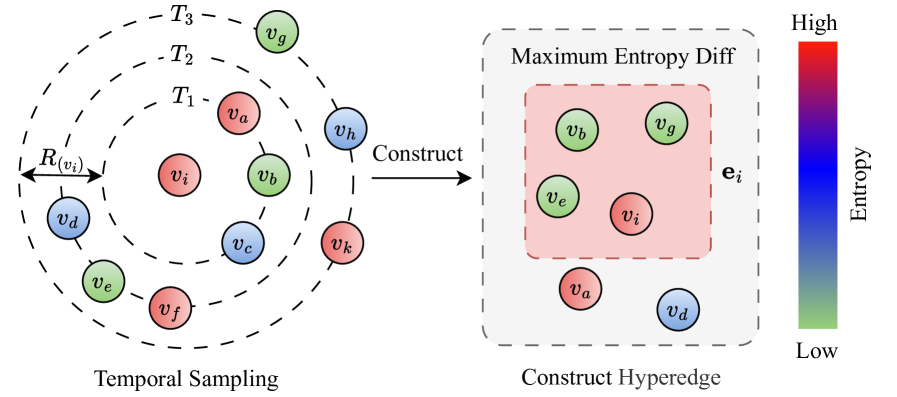

技术框架:HHN框架主要包含三个阶段:1) 序列分割:将输入的多模态时序数据分割成带时间戳的片段,每个片段作为一个节点。2) 超图构建:利用最大熵差准则构建模态内超边,增强节点异质性和结构区分性;通过时间对齐和图注意力机制建立模态间连接。3) 超图卷积:利用超图卷积操作提取高阶依赖关系,并进行分类。

关键创新:该论文的关键创新在于提出了混合超图网络(HHN)来建模多模态时序数据。与传统的图神经网络不同,HHN使用超边来表示模态内的复杂结构关系,能够更好地捕捉节点之间的依赖关系。此外,HHN还采用了最大熵差准则来指导超边的构建,从而增强了节点异质性和结构区分性。

关键设计:在超图构建阶段,使用最大熵差准则来选择超边,该准则旨在选择能够最大程度区分节点的超边。在模态间融合阶段,使用图注意力机制来学习不同模态之间的权重,从而实现更有效的语义融合。损失函数采用交叉熵损失函数,用于训练分类器。网络结构包括超图卷积层和全连接层,用于提取特征和进行分类。

🖼️ 关键图片

📊 实验亮点

HHN在四个多模态数据集上取得了SOTA结果,证明了其有效性。例如,在CMU-MOSEI数据集上,HHN的准确率相比于现有最佳方法提升了超过2%。实验结果表明,HHN能够有效地捕捉长程时序依赖和跨模态交互,从而提高了分类性能。

🎯 应用场景

该研究成果可应用于视频内容分析、行为识别、情感分析、医疗诊断等领域。例如,在视频监控中,可以利用HHN对监控视频中的异常行为进行识别和分类。在医疗领域,可以利用HHN对患者的生理信号和病历数据进行分析,辅助医生进行诊断和治疗。该研究具有重要的实际应用价值和广阔的应用前景。

📄 摘要(原文)

Modeling temporal multimodal data poses significant challenges in classification tasks, particularly in capturing long-range temporal dependencies and intricate cross-modal interactions. Audiovisual data, as a representative example, is inherently characterized by strict temporal order and diverse modalities. Effectively leveraging the temporal structure is essential for understanding both intra-modal dynamics and inter-modal correlations. However, most existing approaches treat each modality independently and rely on shallow fusion strategies, which overlook temporal dependencies and hinder the model's ability to represent complex structural relationships. To address the limitation, we propose the hybrid hypergraph network (HHN), a novel framework that models temporal multimodal data via a segmentation-first, graph-later strategy. HHN splits sequences into timestamped segments as nodes in a heterogeneous graph. Intra-modal structures are captured via hyperedges guided by a maximum entropy difference criterion, enhancing node heterogeneity and structural discrimination, followed by hypergraph convolution to extract high-order dependencies. Inter-modal links are established through temporal alignment and graph attention for semantic fusion. HHN achieves state-of-the-art (SOTA) results on four multimodal datasets, demonstrating its effectiveness in complex classification tasks.