Kimi K2: Open Agentic Intelligence

作者: Kimi Team, Yifan Bai, Yiping Bao, Guanduo Chen, Jiahao Chen, Ningxin Chen, Ruijue Chen, Yanru Chen, Yuankun Chen, Yutian Chen, Zhuofu Chen, Jialei Cui, Hao Ding, Mengnan Dong, Angang Du, Chenzhuang Du, Dikang Du, Yulun Du, Yu Fan, Yichen Feng, Kelin Fu, Bofei Gao, Hongcheng Gao, Peizhong Gao, Tong Gao, Xinran Gu, Longyu Guan, Haiqing Guo, Jianhang Guo, Hao Hu, Xiaoru Hao, Tianhong He, Weiran He, Wenyang He, Chao Hong, Yangyang Hu, Zhenxing Hu, Weixiao Huang, Zhiqi Huang, Zihao Huang, Tao Jiang, Zhejun Jiang, Xinyi Jin, Yongsheng Kang, Guokun Lai, Cheng Li, Fang Li, Haoyang Li, Ming Li, Wentao Li, Yanhao Li, Yiwei Li, Zhaowei Li, Zheming Li, Hongzhan Lin, Xiaohan Lin, Zongyu Lin, Chengyin Liu, Chenyu Liu, Hongzhang Liu, Jingyuan Liu, Junqi Liu, Liang Liu, Shaowei Liu, T. Y. Liu, Tianwei Liu, Weizhou Liu, Yangyang Liu, Yibo Liu, Yiping Liu, Yue Liu, Zhengying Liu, Enzhe Lu, Lijun Lu, Shengling Ma, Xinyu Ma, Yingwei Ma, Shaoguang Mao, Jie Mei, Xin Men, Yibo Miao, Siyuan Pan, Yebo Peng, Ruoyu Qin, Bowen Qu, Zeyu Shang, Lidong Shi, Shengyuan Shi, Feifan Song, Jianlin Su, Zhengyuan Su, Xinjie Sun, Flood Sung, Heyi Tang, Jiawen Tao, Qifeng Teng, Chensi Wang, Dinglu Wang, Feng Wang, Haiming Wang, Jianzhou Wang, Jiaxing Wang, Jinhong Wang, Shengjie Wang, Shuyi Wang, Yao Wang, Yejie Wang, Yiqin Wang, Yuxin Wang, Yuzhi Wang, Zhaoji Wang, Zhengtao Wang, Zhexu Wang, Chu Wei, Qianqian Wei, Wenhao Wu, Xingzhe Wu, Yuxin Wu, Chenjun Xiao, Xiaotong Xie, Weimin Xiong, Boyu Xu, Jing Xu, Jinjing Xu, L. H. Xu, Lin Xu, Suting Xu, Weixin Xu, Xinran Xu, Yangchuan Xu, Ziyao Xu, Junjie Yan, Yuzi Yan, Xiaofei Yang, Ying Yang, Zhen Yang, Zhilin Yang, Zonghan Yang, Haotian Yao, Xingcheng Yao, Wenjie Ye, Zhuorui Ye, Bohong Yin, Longhui Yu, Enming Yuan, Hongbang Yuan, Mengjie Yuan, Haobing Zhan, Dehao Zhang, Hao Zhang, Wanlu Zhang, Xiaobin Zhang, Yangkun Zhang, Yizhi Zhang, Yongting Zhang, Yu Zhang, Yutao Zhang, Yutong Zhang, Zheng Zhang, Haotian Zhao, Yikai Zhao, Huabin Zheng, Shaojie Zheng, Jianren Zhou, Xinyu Zhou, Zaida Zhou, Zhen Zhu, Weiyu Zhuang, Xinxing Zu

分类: cs.LG, cs.AI, cs.CL

发布日期: 2025-07-28

备注: tech report of Kimi K2

💡 一句话要点

Kimi K2:开源Agentic智能大模型,采用MuonClip优化器,实现卓越的Agent能力。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 Agentic智能 混合专家模型 MuonClip优化器 强化学习 软件工程 开源模型

📋 核心要点

- 现有大模型训练面临token效率和训练稳定性挑战,尤其是在大规模预训练中。

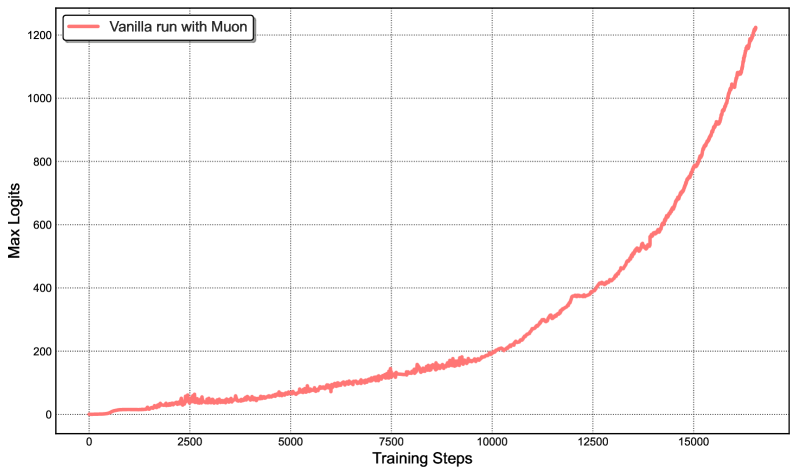

- 论文提出MuonClip优化器,通过QK-clip技术改进Muon,提升token效率并解决训练不稳定性问题。

- Kimi K2在多个Agentic任务和基准测试中取得领先,证明了其卓越的Agentic能力和通用性能。

📝 摘要(中文)

本文介绍了Kimi K2,一个具有320亿激活参数和1万亿总参数的混合专家(MoE)大型语言模型。我们提出了一种名为MuonClip的优化器,它通过一种新颖的QK-clip技术改进了Muon,解决了训练不稳定性的问题,同时享受了Muon的高级token效率。基于MuonClip,K2在15.5万亿个token上进行了预训练,且损失没有出现峰值。在后训练阶段,K2经历了一个多阶段的后训练过程,其亮点在于大规模的Agentic数据合成管道和一个联合强化学习(RL)阶段,模型通过与真实和合成环境的交互来提高其能力。Kimi K2在开源非思维模型中实现了最先进的性能,尤其在Agentic能力方面表现突出。值得注意的是,K2在Tau2-Bench上获得了66.1分,在ACEBench (En)上获得了76.5分,在SWE-Bench Verified上获得了65.8分,在SWE-Bench Multilingual上获得了47.3分,超过了大多数开源和闭源的非思维基线。它还在编码、数学和推理任务中表现出强大的能力,在LiveCodeBench v6上获得了53.7分,在AIME 2025上获得了49.5分,在GPQA-Diamond上获得了75.1分,在OJBench上获得了27.1分,所有这些都没有进行扩展思维。这些结果使Kimi K2成为迄今为止最有能力的开源大型语言模型之一,尤其是在软件工程和Agentic任务方面。我们发布了我们的基础模型和后训练模型检查点,以促进Agentic智能的未来研究和应用。

🔬 方法详解

问题定义:论文旨在构建一个高性能、高效率的开源Agentic智能大模型。现有大模型在训练过程中,尤其是在大规模预训练时,面临着token效率低和训练不稳定性的问题,这限制了模型的性能和可扩展性。此外,如何有效提升模型的Agentic能力,使其能够更好地与环境交互并完成复杂任务,也是一个重要的挑战。

核心思路:论文的核心思路是结合MoE架构和高效稳定的优化器,并通过多阶段的后训练过程,包括大规模Agentic数据合成和联合强化学习,来提升模型的性能和Agentic能力。MoE架构允许模型拥有更大的参数规模,同时保持较低的计算成本。MuonClip优化器则解决了训练不稳定性的问题,提高了token效率。后训练过程则进一步提升了模型在特定任务上的性能。

技术框架:Kimi K2的整体框架包括预训练和后训练两个主要阶段。在预训练阶段,模型使用MuonClip优化器在15.5万亿个token上进行训练。在后训练阶段,模型首先进行大规模的Agentic数据合成,然后通过联合强化学习与真实和合成环境进行交互,从而提升Agentic能力。

关键创新:论文最重要的技术创新点是MuonClip优化器,它通过引入QK-clip技术改进了Muon优化器。QK-clip技术能够有效地抑制训练过程中的梯度爆炸和震荡,从而提高了训练的稳定性,并允许使用更大的学习率,从而提高了token效率。与现有优化器相比,MuonClip在保证训练稳定性的前提下,能够更快地收敛。

关键设计:Kimi K2采用了MoE架构,具有320亿激活参数和1万亿总参数。MuonClip优化器中的QK-clip技术涉及到对Query和Key矩阵的梯度进行裁剪,以防止梯度爆炸。后训练阶段的Agentic数据合成管道涉及到生成大量的Agentic任务数据,用于提升模型的Agentic能力。联合强化学习阶段则涉及到设计合适的奖励函数和环境交互策略,以引导模型学习最优的行为。

🖼️ 关键图片

📊 实验亮点

Kimi K2在多个基准测试中取得了显著的成果。在Agentic能力方面,K2在Tau2-Bench上获得了66.1分,在ACEBench (En)上获得了76.5分,在SWE-Bench Verified上获得了65.8分,在SWE-Bench Multilingual上获得了47.3分,超过了大多数开源和闭源的非思维基线。在编码、数学和推理任务中,K2在LiveCodeBench v6上获得了53.7分,在AIME 2025上获得了49.5分,在GPQA-Diamond上获得了75.1分,在OJBench上获得了27.1分。

🎯 应用场景

Kimi K2具有广泛的应用前景,包括智能助手、软件开发、自动化测试、数据分析等领域。其强大的Agentic能力使其能够更好地理解用户意图,并自主完成复杂任务。开源的特性也使其能够被广泛应用于学术研究和商业应用,促进Agentic智能的发展。

📄 摘要(原文)

We introduce Kimi K2, a Mixture-of-Experts (MoE) large language model with 32 billion activated parameters and 1 trillion total parameters. We propose the MuonClip optimizer, which improves upon Muon with a novel QK-clip technique to address training instability while enjoying the advanced token efficiency of Muon. Based on MuonClip, K2 was pre-trained on 15.5 trillion tokens with zero loss spike. During post-training, K2 undergoes a multi-stage post-training process, highlighted by a large-scale agentic data synthesis pipeline and a joint reinforcement learning (RL) stage, where the model improves its capabilities through interactions with real and synthetic environments. Kimi K2 achieves state-of-the-art performance among open-source non-thinking models, with strengths in agentic capabilities. Notably, K2 obtains 66.1 on Tau2-Bench, 76.5 on ACEBench (En), 65.8 on SWE-Bench Verified, and 47.3 on SWE-Bench Multilingual -- surpassing most open and closed-sourced baselines in non-thinking settings. It also exhibits strong capabilities in coding, mathematics, and reasoning tasks, with a score of 53.7 on LiveCodeBench v6, 49.5 on AIME 2025, 75.1 on GPQA-Diamond, and 27.1 on OJBench, all without extended thinking. These results position Kimi K2 as one of the most capable open-source large language models to date, particularly in software engineering and agentic tasks. We release our base and post-trained model checkpoints to facilitate future research and applications of agentic intelligence.