Inducing Causal World Models in LLMs for Zero-Shot Physical Reasoning

作者: Aditya Sharma, Ananya Gupta, Chengyu Wang, Chiamaka Adebayo, Jakub Kowalski

分类: cs.LG, cs.HC

发布日期: 2025-07-26 (更新: 2025-12-26)

备注: 12 pages, 4 figures,

💡 一句话要点

提出CWMI框架,通过在LLM中嵌入因果世界模型实现零样本物理推理

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 因果推理 世界模型 大型语言模型 物理常识 零样本学习 多模态学习 机器人控制

📋 核心要点

- 现有LLM缺乏对物理动态的理解,限制了其在需要因果推理的现实场景中的应用。

- CWMI框架通过引入因果物理模块和因果干预损失,使LLM学习因果关系而非统计相关性。

- 实验表明,CWMI在零样本物理推理任务上显著优于现有LLM,提升了模型性能。

📝 摘要(中文)

大型语言模型(LLM)虽然具备先进的语言能力,但本质上缺乏对物理动态的直观理解,这限制了它们在需要因果推理的现实场景中的有效性。本文介绍了一种新的框架——因果世界模型归纳(CWMI),旨在将显式的因果物理模型嵌入到LLM中。我们的方法包含一个专用的因果物理模块(CPM)和一个新的训练目标,称为因果干预损失,鼓励模型从多模态数据中学习因果关系。通过训练模型来预测假设干预的结果,而不是仅仅捕捉统计相关性,CWMI发展了物理定律的鲁棒内部表示。实验结果表明,CWMI在零样本物理推理任务上显著优于最先进的LLM,包括PIQA基准和我们新提出的PhysiCa-Bench数据集。这些发现表明,诱导因果世界模型是实现更可靠和更具泛化性的AI系统的关键一步。

🔬 方法详解

问题定义:现有大型语言模型(LLM)在处理需要物理常识和因果推理的任务时表现不佳。它们往往依赖于数据中的统计相关性,而缺乏对物理世界基本规律的理解,导致在面对新的、未见过的情景时泛化能力不足。因此,如何让LLM具备更强的物理推理能力是一个重要的研究问题。

核心思路:论文的核心思路是通过在LLM中显式地嵌入一个因果世界模型,使其能够理解物理世界的因果关系。具体来说,就是训练模型预测在特定干预下的结果,从而学习物理定律的内部表示。这种方法避免了模型仅仅学习数据中的统计相关性,而是鼓励其学习真实的因果机制。

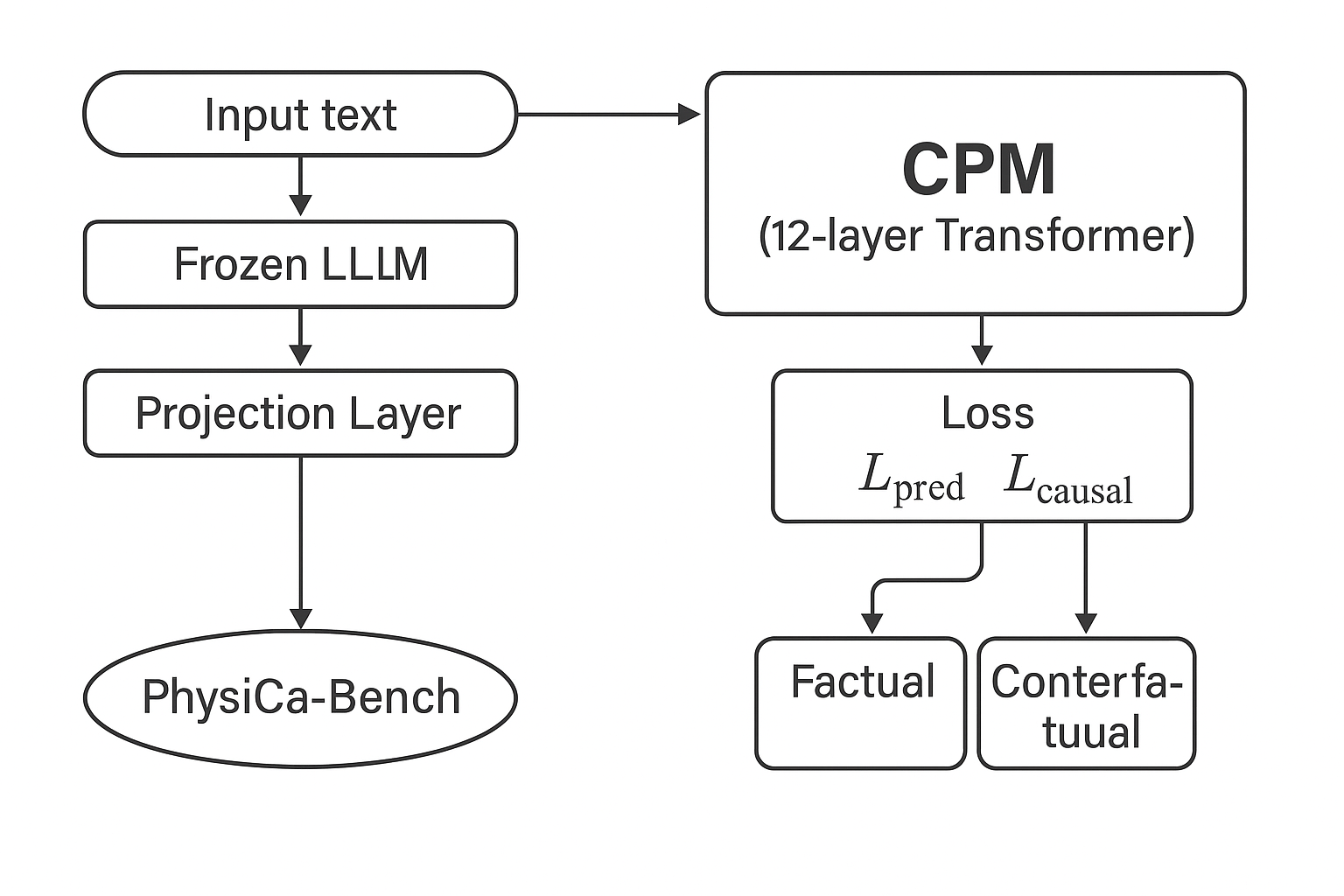

技术框架:CWMI框架包含两个主要组成部分:一个是现有的LLM,另一个是新引入的因果物理模块(CPM)。CPM负责处理多模态输入(例如图像和文本),并预测物理事件的结果。整个训练过程使用因果干预损失,该损失函数鼓励模型预测在假设干预下的结果。训练时,模型接收描述物理场景的输入,并被要求预测在特定干预(例如,推动一个物体)之后会发生什么。

关键创新:该论文的关键创新在于提出了因果世界模型归纳(CWMI)框架,它通过显式地学习因果关系来提升LLM的物理推理能力。与以往仅仅依赖于统计相关性的方法不同,CWMI鼓励模型学习物理世界的因果机制,从而提高其泛化能力。另一个创新点是提出了因果干预损失,该损失函数专门用于训练模型预测在干预下的结果。

关键设计:CPM的具体实现细节未知,但可以推测其可能包含一些用于处理图像和文本输入的模块,以及一些用于预测物理事件结果的模块。因果干预损失的具体形式也未知,但可以推测其可能基于预测结果与真实结果之间的差异来计算。论文中提到使用了多模态数据进行训练,这意味着模型需要能够处理不同类型的数据输入,例如图像和文本。

🖼️ 关键图片

📊 实验亮点

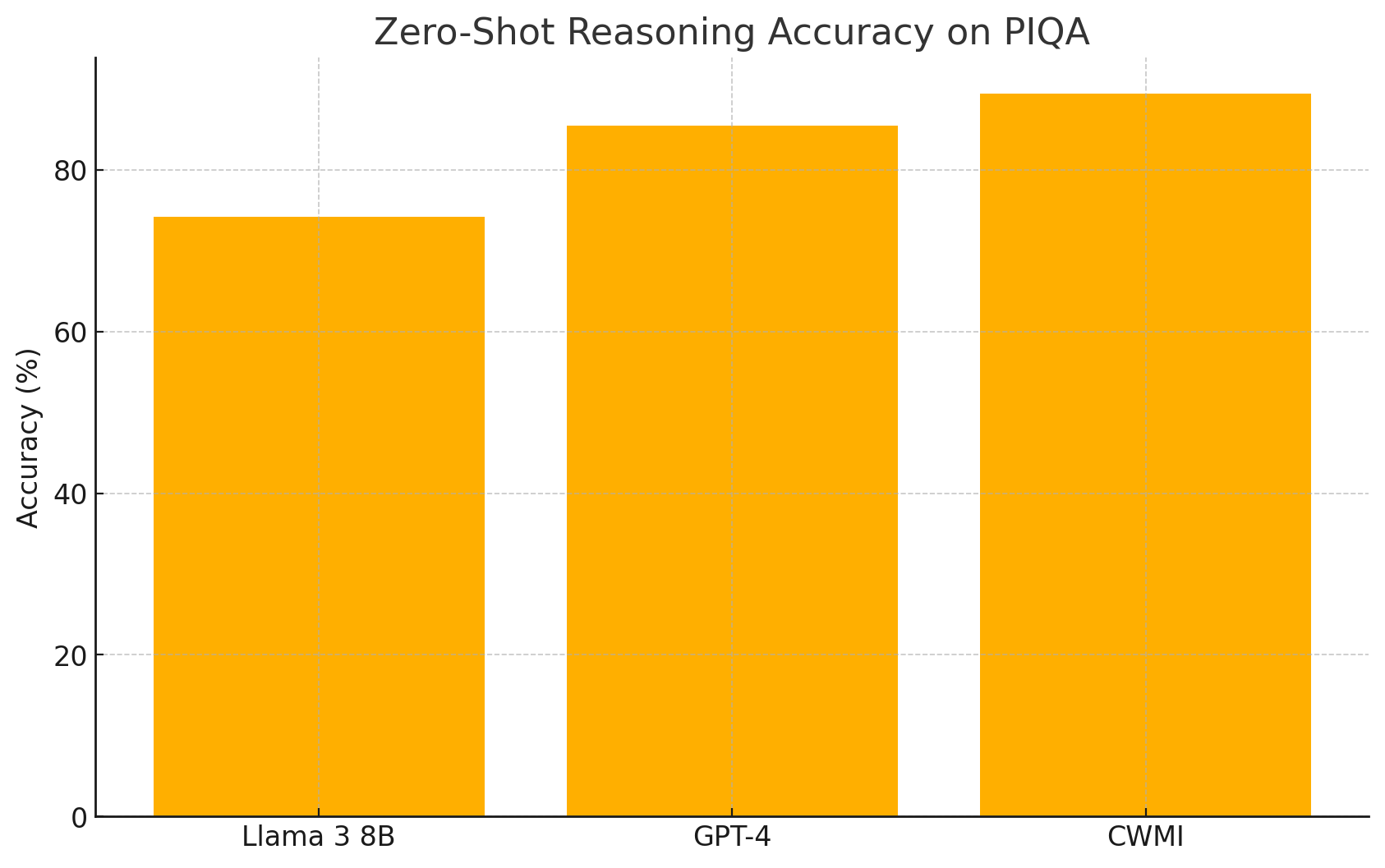

实验结果表明,CWMI在PIQA基准和新提出的PhysiCa-Bench数据集上显著优于现有LLM。具体性能数据未知,但论文强调了CWMI在零样本物理推理任务上的优越性,表明其具备更强的泛化能力。这证明了在LLM中引入因果世界模型是提升物理推理能力的一种有效方法。

🎯 应用场景

该研究成果可应用于机器人控制、游戏AI、虚拟现实等领域。通过使AI系统具备更强的物理推理能力,可以提升其在复杂环境中的决策能力和适应性。例如,机器人可以更好地理解周围环境,并根据物理规律做出更合理的动作规划。未来,该技术有望推动通用人工智能的发展。

📄 摘要(原文)

Large Language Models (LLMs), despite their advanced linguistic capabilities, fundamentally lack an intuitive understanding of physical dynamics, which limits their effectiveness in real-world scenarios that require causal reasoning. In this paper, we introduce Causal World Model Induction (CWMI), a novel framework designed to embed an explicit model of causal physics within an LLM. Our approach incorporates a dedicated Causal Physics Module (CPM) and a new training objective called Causal Intervention Loss, encouraging the model to learn cause-and-effect relationships from multimodal data. By training the model to predict the outcomes of hypothetical interventions instead of merely capturing statistical correlations, CWMI develops a robust internal representation of physical laws. Experimental results show that CWMI significantly outperforms state-of-the-art LLMs on zero-shot physical reasoning tasks, including the PIQA benchmark and our newly proposed PhysiCa-Bench dataset. These findings demonstrate that inducing a causal world model is a critical step toward more reliable and generalizable AI systems.