Hallucination Detection and Mitigation with Diffusion in Multi-Variate Time-Series Foundation Models

作者: Vijja Wichitwechkarn, Charles Fox, Ruchi Choudhary

分类: cs.LG, cs.CL

发布日期: 2025-07-23

💡 一句话要点

针对多变量时间序列基础模型,提出基于扩散模型的幻觉检测与缓解方法

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多变量时间序列 基础模型 幻觉检测 扩散模型 时间序列插补

📋 核心要点

- 现有的多变量时间序列(MVTS)基础模型缺乏对幻觉现象的明确定义和有效的检测/缓解方法,限制了其可靠性和应用。

- 本文提出了一种基于扩散模型的MVTS幻觉检测与缓解框架,通过扩散模型估计幻觉水平,从而实现对幻觉的有效识别和抑制。

- 实验结果表明,该方法能够有效降低开源MVTS插补基础模型中的关系幻觉,最高可降低47.7%,显著提升模型性能。

📝 摘要(中文)

自然语言处理的基础模型对幻觉有许多连贯的定义以及检测和缓解方法。然而,多变量时间序列(MVTS)基础模型却缺乏类似的定义和方法。本文针对MVTS幻觉提出了新的定义,以及使用扩散模型估计幻觉水平的检测和缓解方法。我们从流行的时序数据集中导出关系数据集,以评估这些关系幻觉水平。使用这些定义和模型,我们发现开源预训练的MVTS插补基础模型的关系幻觉平均高达弱基线的59.5%。所提出的缓解方法将此降低了高达47.7%。该定义和方法可以改善MVTS基础模型的采用和安全使用。

🔬 方法详解

问题定义:论文旨在解决多变量时间序列(MVTS)基础模型中存在的幻觉问题。现有方法缺乏对MVTS幻觉的明确定义和有效的检测与缓解机制,导致模型在实际应用中可能产生不准确或不合理的结果。现有方法难以量化和控制MVTS模型中的幻觉现象。

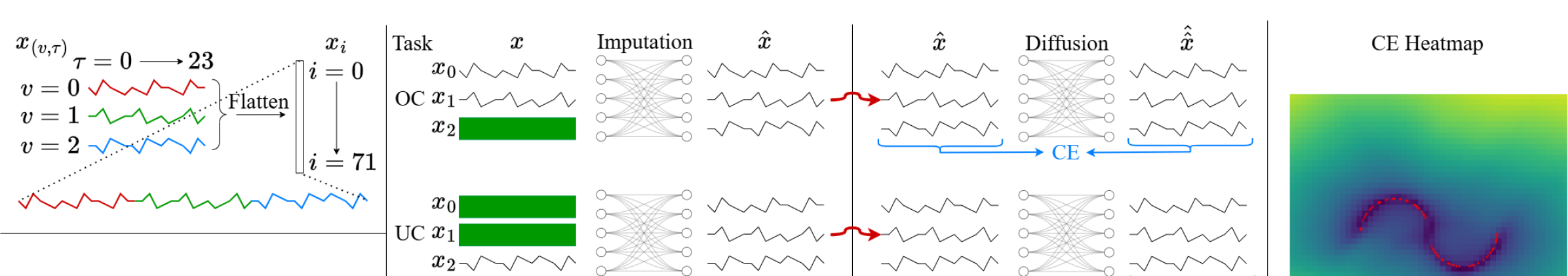

核心思路:论文的核心思路是利用扩散模型来估计MVTS模型中的幻觉水平。扩散模型能够学习数据的潜在分布,并生成与真实数据相似的样本。通过比较原始数据和扩散模型生成的“无幻觉”数据,可以量化模型产生的幻觉程度,并以此指导幻觉缓解。

技术框架:整体框架包含以下几个主要步骤:1)定义MVTS幻觉的概念,并构建关系数据集用于幻觉评估。2)使用预训练的MVTS基础模型进行时间序列插补或预测。3)利用扩散模型学习真实时间序列数据的分布。4)使用训练好的扩散模型生成“无幻觉”的时间序列数据。5)比较原始模型输出和扩散模型生成的输出,计算幻觉水平。6)基于幻觉水平,设计缓解策略,例如调整模型参数或引入额外的约束。

关键创新:论文的关键创新在于:1)提出了针对MVTS基础模型的幻觉定义,弥补了该领域的空白。2)将扩散模型应用于幻觉检测与缓解,提供了一种新的解决思路。3)构建了关系数据集,为MVTS幻觉评估提供了基准。

关键设计:论文使用了扩散模型来生成“无幻觉”的时间序列数据。扩散模型的具体结构和训练方式需要根据具体的时间序列数据和任务进行调整。损失函数的设计需要考虑如何有效地衡量原始模型输出和扩散模型生成输出之间的差异,例如可以使用均方误差或动态时间规整(DTW)距离。缓解策略可以包括对模型输出进行后处理,或者在模型训练过程中引入正则化项,以降低幻觉水平。具体参数设置和网络结构细节在论文中未详细说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

实验结果表明,开源预训练的MVTS插补基础模型存在显著的关系幻觉,平均高达弱基线的59.5%。通过应用提出的缓解方法,可以将幻觉水平降低高达47.7%。这些结果验证了所提出的幻觉检测和缓解方法的有效性,为提升MVTS基础模型的性能提供了有力的支持。

🎯 应用场景

该研究成果可应用于各种涉及多变量时间序列预测和插补的领域,例如金融风险预测、智能交通管理、工业设备故障诊断、医疗健康监测等。通过降低MVTS基础模型中的幻觉,可以提高预测的准确性和可靠性,从而为决策提供更可靠的依据,并促进MVTS基础模型在实际场景中的安全应用。

📄 摘要(原文)

Foundation models for natural language processing have many coherent definitions of hallucination and methods for its detection and mitigation. However, analogous definitions and methods do not exist for multi-variate time-series (MVTS) foundation models. We propose new definitions for MVTS hallucination, along with new detection and mitigation methods using a diffusion model to estimate hallucination levels. We derive relational datasets from popular time-series datasets to benchmark these relational hallucination levels. Using these definitions and models, we find that open-source pre-trained MVTS imputation foundation models relationally hallucinate on average up to 59.5% as much as a weak baseline. The proposed mitigation method reduces this by up to 47.7% for these models. The definition and methods may improve adoption and safe usage of MVTS foundation models.