TD-Interpreter: Enhancing the Understanding of Timing Diagrams with Visual-Language Learning

作者: Jie He, Vincent Theo Willem Kenbeek, Zhantao Yang, Meixun Qu, Ezio Bartocci, Dejan Ničković, Radu Grosu

分类: cs.LG

发布日期: 2025-07-20

💡 一句话要点

TD-Interpreter:利用视觉-语言学习增强时序图理解能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 时序图理解 视觉问答 多模态学习 LLaVA 合成数据生成

📋 核心要点

- 工程师在设计验证中理解第三方时序图面临挑战,现有方法缺乏有效工具。

- TD-Interpreter通过微调LLaVA,构建视觉问答系统,理解时序图并回答相关问题。

- 通过合成数据生成,缓解数据不足问题,实验证明TD-Interpreter优于GPT-4o。

📝 摘要(中文)

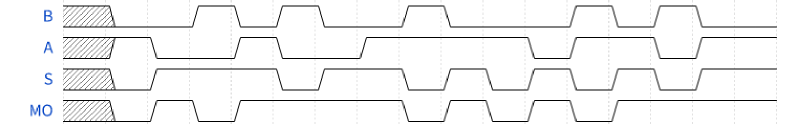

TD-Interpreter是一个专门的机器学习工具,旨在帮助工程师理解第三方提供的复杂时序图(TDs),这在设计和验证过程中至关重要。TD-Interpreter提供了一个视觉问答环境,允许工程师输入一组时序图,并提出关于这些时序图的设计和验证查询。我们通过微调轻量级的7B多模态大型语言模型(MLLM)LLaVA,实现了TD-Interpreter的多模态学习。为了解决训练数据有限的问题,我们开发了一个合成数据生成工作流程,将视觉信息与其文本解释对齐。实验评估表明,TD-Interpreter的实用性优于未经调整的GPT-4o,在评估的基准测试中表现出色。

🔬 方法详解

问题定义:论文旨在解决工程师在设计和验证过程中理解第三方提供的复杂时序图(TDs)的难题。现有方法缺乏专门针对时序图的理解工具,工程师需要手动分析,效率低下且容易出错。现有通用大模型在时序图理解方面表现不佳,无法满足实际需求。

核心思路:论文的核心思路是利用多模态学习,将时序图的视觉信息和文本描述相结合,构建一个视觉问答系统。通过微调多模态大型语言模型(MLLM),使模型能够理解时序图的内容,并回答用户提出的关于时序图的设计和验证问题。这种方法能够有效利用视觉和文本信息,提高时序图理解的准确性和效率。

技术框架:TD-Interpreter的技术框架主要包括以下几个模块:1)时序图输入模块:接收工程师输入的时序图;2)视觉特征提取模块:提取时序图的视觉特征;3)文本特征提取模块:提取用户提出的问题的文本特征;4)多模态融合模块:将视觉特征和文本特征进行融合;5)答案生成模块:根据融合后的特征生成答案。整体流程是,用户输入时序图和问题,系统提取视觉和文本特征,进行融合,最后生成答案。

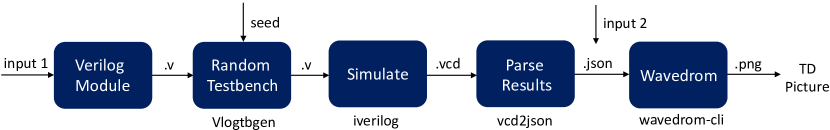

关键创新:论文的关键创新在于:1)提出了一个专门针对时序图理解的视觉问答系统TD-Interpreter;2)开发了一个合成数据生成工作流程,解决了训练数据有限的问题,该流程能够自动生成与时序图对应的文本描述,用于训练模型;3)通过微调LLaVA,实现了高效的多模态学习,在时序图理解任务上取得了显著的性能提升。与现有方法的本质区别在于,TD-Interpreter是专门为时序图理解设计的,能够更好地利用时序图的视觉和文本信息。

关键设计:论文的关键设计包括:1)选择LLaVA作为基础模型,因为它是一个轻量级的多模态大型语言模型,易于微调;2)设计了合成数据生成工作流程,包括时序图的生成、文本描述的生成和对齐;3)采用了视觉问答的形式,方便工程师使用;4)针对时序图的特点,设计了特定的损失函数,以提高模型的训练效果。具体参数设置和网络结构细节在论文中未详细说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

实验结果表明,TD-Interpreter在时序图理解任务上显著优于未经调整的GPT-4o。具体的性能数据和提升幅度在摘要中未给出,属于未知信息。论文强调了TD-Interpreter在评估基准测试中的出色表现,证明了其有效性和实用性。

🎯 应用场景

TD-Interpreter可应用于电子设计自动化(EDA)领域,辅助工程师理解和验证第三方提供的时序图,提高设计效率,减少错误。该工具还可用于教学,帮助学生更好地理解时序图的概念和应用。未来,TD-Interpreter有望扩展到其他类型的图表理解,例如电路图、流程图等,具有广阔的应用前景。

📄 摘要(原文)

We introduce TD-Interpreter, a specialized ML tool that assists engineers in understanding complex timing diagrams (TDs), originating from a third party, during their design and verification process. TD-Interpreter is a visual question-answer environment which allows engineers to input a set of TDs and ask design and verification queries regarding these TDs. We implemented TD-Interpreter with multimodal learning by fine-tuning LLaVA, a lightweight 7B Multimodal Large Language Model (MLLM). To address limited training data availability, we developed a synthetic data generation workflow that aligns visual information with its textual interpretation. Our experimental evaluation demonstrates the usefulness of TD-Interpreter which outperformed untuned GPT-4o by a large margin on the evaluated benchmarks.