Application-Specific Component-Aware Structured Pruning of Deep Neural Networks in Control via Soft Coefficient Optimization

作者: Ganesh Sundaram, Jonas Ulmen, Amjad Haider, Daniel Görges

分类: cs.LG, cs.AI

发布日期: 2025-07-20 (更新: 2025-11-13)

备注: 8 pages, 24th European Control Conference (ECC26)

💡 一句话要点

提出一种面向控制的深度神经网络结构化剪枝方法,通过软系数优化实现应用特定性能保持。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 深度神经网络 模型压缩 结构化剪枝 神经网络控制器 应用感知 软系数优化 模型预测控制

📋 核心要点

- 现有模型压缩策略在神经网络控制器(NNCs)上的应用受限,无法同时满足模型小型化和应用特定性能保持的需求。

- 该论文提出一种新的结构化剪枝框架,通过优化剪枝组的重要性指标,在模型压缩的同时考虑应用特定的约束。

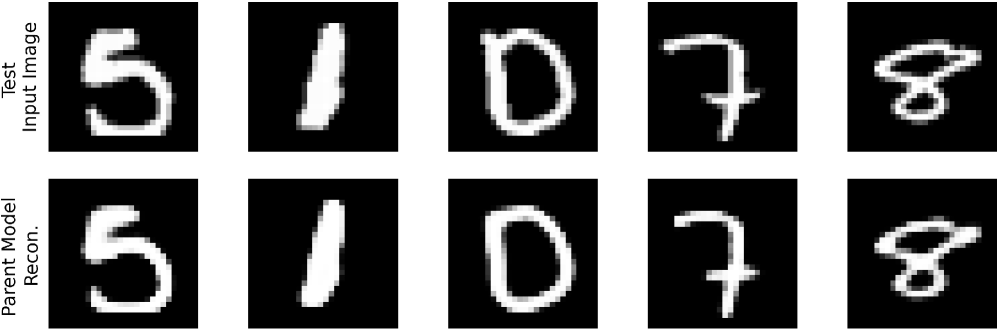

- 实验结果表明,该方法在MNIST自编码器和TDMPC代理上均能有效减小模型尺寸,并保持应用相关的性能。

📝 摘要(中文)

深度神经网络(DNNs)具有显著的灵活性和鲁棒的性能,使其成为构建系统模型和高级神经网络控制器(NNCs)的理想选择。然而,它们的高复杂性和计算需求常常限制了其应用。过去几十年里,人们开发了各种模型压缩策略来解决这些问题。这些策略对于通用DNNs有效,但不能直接应用于NNCs。NNCs既需要尺寸缩小,又需要保留关键的应用特定性能特征。在结构化剪枝中,标准的重要性指标通常无法保护这些关键特性。本文提出了一种新的框架,用于计算剪枝组中的重要性指标。该框架不仅缩小了模型尺寸,还考虑了各种应用特定的约束。为了找到每个组的最佳剪枝系数,我们评估了两种方法。第一种方法是通过网格搜索进行简单探索。第二种方法利用梯度下降优化,旨在平衡压缩和任务性能。我们在两个用例中测试了我们的方法:一个在MNIST自编码器上,另一个在时序差分模型预测控制(TDMPC)代理上。结果表明,该方法有效地保持了应用相关的性能,同时实现了模型尺寸的显著减小。

🔬 方法详解

问题定义:深度神经网络控制器(NNCs)虽然性能强大,但计算复杂度高,难以部署。现有的模型压缩方法,特别是结构化剪枝,在应用于NNCs时,无法很好地平衡模型大小和应用特定性能,因为标准的重要性度量方法无法有效识别和保留对控制任务至关重要的网络组件。

核心思路:核心思路是设计一种应用感知的结构化剪枝方法,通过优化每个剪枝组的“软系数”,在剪枝过程中显式地考虑应用特定的约束。这种方法允许在剪枝过程中保留对控制性能至关重要的网络组件,从而在压缩模型的同时保持其性能。

技术框架:该框架包含以下主要步骤:1) 定义剪枝组:将网络划分为多个可独立剪枝的组。2) 计算重要性指标:针对每个剪枝组,计算其对应用特定性能的影响。3) 软系数优化:通过网格搜索或梯度下降优化,确定每个剪枝组的最佳剪枝系数,以平衡模型压缩和性能保持。4) 模型剪枝:根据优化后的剪枝系数,对网络进行结构化剪枝。

关键创新:关键创新在于应用感知的重要性指标计算和软系数优化方法。传统方法通常使用权重幅度等通用指标,而该方法则根据应用特定的性能指标(例如,控制任务的奖励或误差)来评估每个剪枝组的重要性。软系数优化允许更精细的控制剪枝过程,避免了硬剪枝可能导致的性能下降。

关键设计:1) 剪枝组的划分策略:根据网络的结构和应用特点,选择合适的剪枝粒度(例如,神经元、卷积核、层)。2) 应用特定的性能指标:根据具体的控制任务,选择合适的性能指标作为优化目标。3) 软系数优化方法:可以选择网格搜索或梯度下降等优化算法,并设计合适的损失函数来平衡模型压缩和性能保持。例如,损失函数可以包含模型大小的惩罚项和性能下降的惩罚项。

🖼️ 关键图片

📊 实验亮点

在MNIST自编码器实验中,该方法在保持重建误差基本不变的情况下,显著减小了模型尺寸。在TDMPC代理实验中,该方法在保持控制性能接近原始模型的情况下,实现了模型参数数量的大幅减少。具体数据未给出,但强调了在两个用例中都实现了模型压缩和性能保持的平衡。

🎯 应用场景

该研究成果可应用于各种需要高性能和低计算成本的控制系统,例如自动驾驶、机器人控制、无人机控制等。通过对神经网络控制器进行应用感知的结构化剪枝,可以在资源受限的平台上部署复杂的控制算法,提高系统的实时性和可靠性。此外,该方法还可以用于优化其他类型的深度学习模型,例如图像识别和自然语言处理模型。

📄 摘要(原文)

Deep neural networks (DNNs) offer significant flexibility and robust performance. This makes them ideal for building not only system models but also advanced neural network controllers (NNCs). However, their high complexity and computational needs often limit their use. Various model compression strategies have been developed over the past few decades to address these issues. These strategies are effective for general DNNs but do not directly apply to NNCs. NNCs need both size reduction and the retention of key application-specific performance features. In structured pruning, which removes groups of related elements, standard importance metrics often fail to protect these critical characteristics. In this paper, we introduce a novel framework for calculating importance metrics in pruning groups. This framework not only shrinks the model size but also considers various application-specific constraints. To find the best pruning coefficient for each group, we evaluate two approaches. The first approach involves simple exploration through grid search. The second utilizes gradient descent optimization, aiming to balance compression and task performance. We test our method in two use cases: one on an MNIST autoencoder and the other on a Temporal Difference Model Predictive Control (TDMPC) agent. Results show that the method effectively maintains application-relevant performance while achieving a significant reduction in model size.