Hierarchical Multi-Agent Reinforcement Learning with Control Barrier Functions for Safety-Critical Autonomous Systems

作者: H. M. Sabbir Ahmad, Ehsan Sabouni, Alexander Wasilkoff, Param Budhraja, Zijian Guo, Songyuan Zhang, Chuchu Fan, Christos Cassandras, Wenchao Li

分类: cs.LG, cs.AI, cs.RO

发布日期: 2025-07-20 (更新: 2025-08-18)

💡 一句话要点

提出基于控制屏障函数的分层多智能体强化学习方法,用于安全关键自主系统。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 多智能体强化学习 控制屏障函数 安全策略学习 分层强化学习 自主系统

📋 核心要点

- 现有方法难以保证多智能体系统在复杂环境下的安全性和协作性,尤其是在安全关键场景中。

- 论文提出一种分层强化学习框架,在高层学习协作策略,在低层利用控制屏障函数确保个体智能体的安全。

- 实验表明,该方法在复杂道路网络导航任务中,显著提高了安全性和性能,接近完美的成功/安全率。

📝 摘要(中文)

本文研究了多智能体安全关键自主系统中的安全策略学习问题。在这样的系统中,每个智能体必须始终满足安全要求,同时与其他智能体合作以完成任务。为此,我们提出了一种基于控制屏障函数(CBF)的安全分层多智能体强化学习(HMARL)方法。我们提出的分层方法将整体强化学习问题分解为两个层次:在高层学习联合协作行为,在低层或智能体层学习以高层策略为条件的个体安全行为。具体来说,我们提出了一种基于技能的HMARL-CBF算法,其中高层问题涉及学习所有智能体技能的联合策略,而低层问题涉及学习使用CBF安全执行技能的策略。我们在具有挑战性的环境场景中验证了我们的方法,其中大量智能体必须安全地通过冲突的道路网络。与现有的最先进方法相比,我们的方法显著提高了安全性,实现了接近完美的(5%以内)成功/安全率,同时也提高了所有环境中的性能。

🔬 方法详解

问题定义:论文旨在解决多智能体安全关键自主系统中,如何学习安全策略的问题。现有方法通常难以在保证智能体协作完成任务的同时,满足严格的安全约束。尤其是在复杂环境中,智能体间的相互作用可能导致违反安全规则的情况发生。

核心思路:论文的核心思路是将强化学习问题分解为两个层次。高层负责学习智能体间的协作策略,确定每个智能体应该执行的技能。低层则负责安全地执行这些技能,利用控制屏障函数(CBF)来确保智能体在执行技能的过程中不违反安全约束。这种分层结构使得可以分别优化协作和安全,从而提高整体性能。

技术框架:整体框架是一个两层的分层强化学习结构。高层使用强化学习算法(具体算法未知)学习一个联合策略,该策略决定了每个智能体应该执行的技能。低层则为每个智能体学习一个策略,该策略在执行高层指定的技能时,利用CBF来保证安全性。CBF作为一个约束条件被加入到低层策略的学习过程中,确保智能体的行为始终满足安全要求。

关键创新:关键创新在于将分层强化学习与控制屏障函数相结合,从而在多智能体系统中实现安全策略学习。通过分层结构,可以将复杂的学习问题分解为更易于处理的子问题,并利用CBF来显式地保证安全性。这种方法不同于传统的强化学习方法,后者通常难以保证安全约束。

关键设计:论文采用基于技能的HMARL-CBF算法。高层策略学习所有智能体技能的联合策略,低层策略学习使用CBF安全执行技能的策略。具体的参数设置、损失函数和网络结构等技术细节在论文中未详细描述,属于未知信息。控制屏障函数的具体形式需要根据具体的安全约束来设计,例如,避免碰撞的安全距离等。

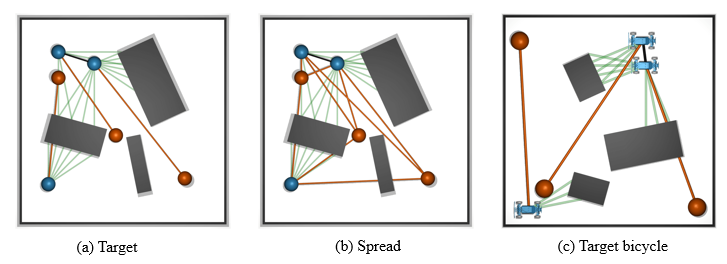

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在复杂道路网络导航任务中,显著提高了安全性和性能。与现有方法相比,该方法实现了接近完美的(5%以内)成功/安全率,同时在所有测试环境中都取得了更好的性能。这表明该方法在保证安全性的同时,也能够有效地完成任务。

🎯 应用场景

该研究成果可应用于各种安全关键的多智能体自主系统,例如自动驾驶、无人机集群、机器人协作等。通过保证智能体在执行任务时的安全性,可以降低事故风险,提高系统的可靠性和效率。该方法在智能交通、物流配送、应急救援等领域具有广阔的应用前景。

📄 摘要(原文)

We address the problem of safe policy learning in multi-agent safety-critical autonomous systems. In such systems, it is necessary for each agent to meet the safety requirements at all times while also cooperating with other agents to accomplish the task. Toward this end, we propose a safe Hierarchical Multi-Agent Reinforcement Learning (HMARL) approach based on Control Barrier Functions (CBFs). Our proposed hierarchical approach decomposes the overall reinforcement learning problem into two levels learning joint cooperative behavior at the higher level and learning safe individual behavior at the lower or agent level conditioned on the high-level policy. Specifically, we propose a skill-based HMARL-CBF algorithm in which the higher level problem involves learning a joint policy over the skills for all the agents and the lower-level problem involves learning policies to execute the skills safely with CBFs. We validate our approach on challenging environment scenarios whereby a large number of agents have to safely navigate through conflicting road networks. Compared with existing state of the art methods, our approach significantly improves the safety achieving near perfect (within 5%) success/safety rate while also improving performance across all the environments.