FuSeFL: Fully Secure and Scalable Cross-Silo Federated Learning

作者: Sahar Ghoflsaz Ghinani, Elaheh Sadredini

分类: cs.CR, cs.LG

发布日期: 2025-07-18 (更新: 2025-08-23)

备注: 15 Pages, 12 Figures

💡 一句话要点

FuSeFL:一种全安全、可扩展的跨孤岛联邦学习方案

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱五:交互与反应 (Interaction & Reaction)

关键词: 联邦学习 安全多方计算 跨孤岛 隐私保护 模型安全 梯度泄露 推理攻击

📋 核心要点

- 现有安全联邦学习方法在防御推理攻击时,面临计算、通信和内存开销过高的挑战,且常常忽略全局模型的机密性。

- FuSeFL通过在客户端对之间使用轻量级MPC分散训练,并将服务器角色限制为安全聚合,实现了全安全和可扩展的联邦学习。

- 实验结果表明,FuSeFL在防御推理威胁的同时,显著降低了通信延迟和服务器内存使用,并提高了模型准确性。

📝 摘要(中文)

联邦学习(FL)无需集中客户端数据即可实现协作模型训练,这使其在隐私敏感领域极具吸引力。虽然现有方法采用同态加密、差分隐私或安全多方计算等密码技术来缓解推理攻击(包括模型反演、成员推理和梯度泄露),但它们通常存在计算、通信或内存开销过高的缺点。此外,许多方法忽略了全局模型本身的机密性,而全局模型可能是专有的和敏感的。这些挑战限制了安全FL的实用性,尤其是在涉及大型数据集和严格合规要求的跨孤岛部署中。我们提出了FuSeFL,一种专为跨孤岛环境设计的全安全、可扩展的FL方案。FuSeFL使用轻量级安全多方计算(MPC)在客户端对之间分散训练,同时将服务器的角色限制在安全聚合。这种设计消除了服务器瓶颈,避免了数据卸载,并在整个训练过程中保持数据、模型和更新的完全机密性。FuSeFL防御推理威胁,实现了高达95%的通信延迟降低和50%的服务器内存使用量降低,并且提高了优于先前安全FL解决方案的准确性,从而证明了大规模下的强大安全性和效率。

🔬 方法详解

问题定义:论文旨在解决跨孤岛联邦学习中,现有安全方法计算开销大、通信延迟高、内存占用多,以及全局模型可能泄露的问题。现有方法通常依赖于同态加密、差分隐私或安全多方计算,但这些技术在高维数据和复杂模型下效率较低,难以满足大规模跨孤岛场景的需求。

核心思路:FuSeFL的核心思路是将训练过程去中心化,通过客户端之间的安全多方计算(MPC)来完成大部分计算任务,从而减轻服务器的负担。服务器仅负责安全聚合客户端的更新,无需访问原始数据或中间梯度,从而保护了数据隐私和模型机密性。

技术框架:FuSeFL的整体架构包括以下几个主要阶段:1)客户端配对:客户端随机或根据某种策略进行配对。2)本地训练:每个客户端使用本地数据训练模型。3)安全梯度计算:客户端对之间使用轻量级MPC安全地计算梯度。4)安全聚合:服务器安全地聚合来自客户端的加密梯度。5)模型更新:服务器将聚合后的梯度发送给客户端,客户端更新本地模型。

关键创新:FuSeFL的关键创新在于其去中心化的训练方式,将计算负担从服务器转移到客户端,并利用轻量级MPC保证客户端之间梯度计算的安全性。与传统的中心化安全联邦学习方法相比,FuSeFL避免了服务器瓶颈,降低了通信延迟,并提高了可扩展性。

关键设计:FuSeFL使用了一种轻量级的MPC协议,例如基于秘密分享的协议,来安全地计算客户端之间的梯度。具体来说,每个客户端将其梯度分成多个秘密份额,并将这些份额分发给其他客户端。然后,客户端使用MPC协议来计算聚合后的梯度,而无需暴露任何单个客户端的梯度信息。此外,FuSeFL还采用了差分隐私技术来进一步增强隐私保护。

🖼️ 关键图片

📊 实验亮点

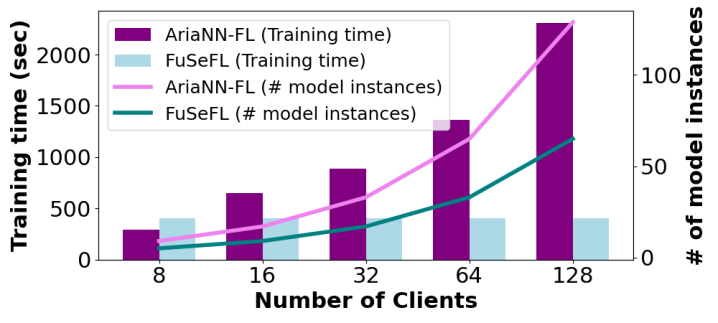

FuSeFL在实验中表现出显著的性能优势。与现有的安全联邦学习方案相比,FuSeFL实现了高达95%的通信延迟降低和50%的服务器内存使用量降低。此外,FuSeFL还在多个数据集上取得了更高的模型准确性,证明了其在安全性和效率方面的优越性。这些结果表明,FuSeFL是一种具有实际应用价值的安全联邦学习方案。

🎯 应用场景

FuSeFL适用于需要高度隐私保护和大规模数据协作的跨机构场景,例如医疗健康、金融服务和供应链管理。在这些领域,不同机构拥有大量敏感数据,但由于隐私法规和竞争关系,无法直接共享数据。FuSeFL提供了一种安全有效的方式,使这些机构能够在不泄露数据的情况下,共同训练高质量的模型,从而改善医疗诊断、风险评估和运营效率。

📄 摘要(原文)

Federated Learning (FL) enables collaborative model training without centralizing client data, making it attractive for privacy-sensitive domains. While existing approaches employ cryptographic techniques such as homomorphic encryption, differential privacy, or secure multiparty computation to mitigate inference attacks-including model inversion, membership inference, and gradient leakage-they often suffer from high computational, communication, or memory overheads. Moreover, many methods overlook the confidentiality of the global model itself, which may be proprietary and sensitive. These challenges limit the practicality of secure FL, especially in cross-silo deployments involving large datasets and strict compliance requirements. We present FuSeFL, a fully secure and scalable FL scheme designed for cross-silo settings. FuSeFL decentralizes training across client pairs using lightweight secure multiparty computation (MPC), while confining the server's role to secure aggregation. This design eliminates server bottlenecks, avoids data offloading, and preserves full confidentiality of data, model, and updates throughout training. FuSeFL defends against inference threats, achieves up to 95% lower communication latency and 50% lower server memory usage, and improves accuracy over prior secure FL solutions, demonstrating strong security and efficiency at scale.