Feature Distillation is the Better Choice for Model-Heterogeneous Federated Learning

作者: Yichen Li, Xiuying Wang, Wenchao Xu, Haozhao Wang, Yining Qi, Jiahua Dong, Ruixuan Li

分类: cs.LG, cs.AI

发布日期: 2025-07-14 (更新: 2025-10-14)

💡 一句话要点

提出FedFD:一种基于特征蒸馏的模型异构联邦学习方法

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 联邦学习 模型异构 特征蒸馏 知识蒸馏 正交投影

📋 核心要点

- 现有异构联邦学习方法主要依赖logit蒸馏,忽略了异构模型带来的知识偏差,导致训练不稳定。

- FedFD通过特征蒸馏,利用正交投影对齐异构模型的特征,从而更好地整合知识,减少知识偏差。

- 实验结果表明,FedFD相较于现有方法,在模型异构联邦学习任务上取得了显著的性能提升。

📝 摘要(中文)

模型异构联邦学习(Hetero-FL)因其能够在本地保留私有数据的前提下,聚合来自异构模型的知识而备受关注。为了更好地聚合来自客户端的知识,集成蒸馏作为一种广泛使用且有效的技术,通常在全局聚合后被采用,以提高全局模型的性能。然而,简单地将Hetero-FL和集成蒸馏结合起来并不总能产生理想的结果,并且可能使训练过程不稳定。原因是现有方法主要关注logit蒸馏,虽然logit蒸馏与softmax预测无关模型,但无法弥补由异构模型引起的知识偏差。为了解决这个挑战,我们提出了一种稳定且高效的用于模型异构联邦学习的特征蒸馏方法,称为FedFD,它可以通过正交投影来整合对齐的特征信息,从而更好地整合来自异构模型的知识。具体来说,提出了一种新的基于特征的集成联邦知识蒸馏范式。服务器上的全局模型需要为每个客户端模型架构维护一个投影层,以分别对齐特征。采用正交技术重新参数化投影层,以减轻来自异构模型的知识偏差,从而最大化蒸馏知识。大量实验表明,与最先进的方法相比,FedFD取得了优异的性能。

🔬 方法详解

问题定义:模型异构联邦学习旨在聚合来自不同结构的客户端模型的知识,但现有方法主要采用logit蒸馏,忽略了模型结构差异带来的知识偏差,导致全局模型训练不稳定,性能提升有限。现有方法无法有效弥补异构模型带来的知识偏差。

核心思路:FedFD的核心思路是利用特征蒸馏,直接对齐不同模型的特征表示,从而更有效地传递知识。通过为每个客户端模型维护一个投影层,将客户端模型的特征投影到公共空间,从而实现特征对齐。正交投影的使用旨在减少知识偏差,提高蒸馏效率。

技术框架:FedFD的整体框架包括以下几个主要步骤:1) 客户端模型在本地数据上进行训练;2) 客户端将模型参数和特征发送到服务器;3) 服务器为每个客户端模型维护一个投影层,将客户端特征投影到公共空间;4) 服务器利用全局模型和投影后的客户端特征进行特征蒸馏,更新全局模型和投影层参数;5) 将更新后的全局模型发送给客户端。

关键创新:FedFD的关键创新在于引入了特征蒸馏,并使用正交投影来对齐异构模型的特征。与传统的logit蒸馏相比,特征蒸馏能够更直接地传递知识,减少知识偏差。正交投影的使用进一步提高了特征对齐的效率和准确性。

关键设计:FedFD的关键设计包括:1) 为每个客户端模型维护一个独立的投影层,以适应不同的模型结构;2) 使用正交投影来约束投影层的参数,减少知识偏差;3) 设计合适的损失函数,鼓励全局模型学习客户端模型的特征表示。具体的损失函数可能包括特征对齐损失和模型预测损失等。投影层的具体结构(例如线性层或非线性层)以及正交约束的实现方式(例如正交正则化或正交初始化)也是重要的设计细节。

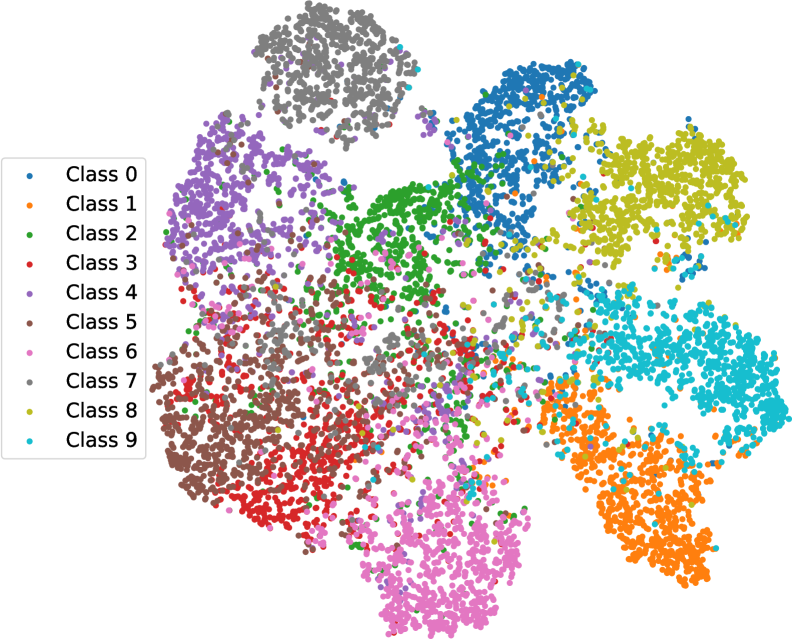

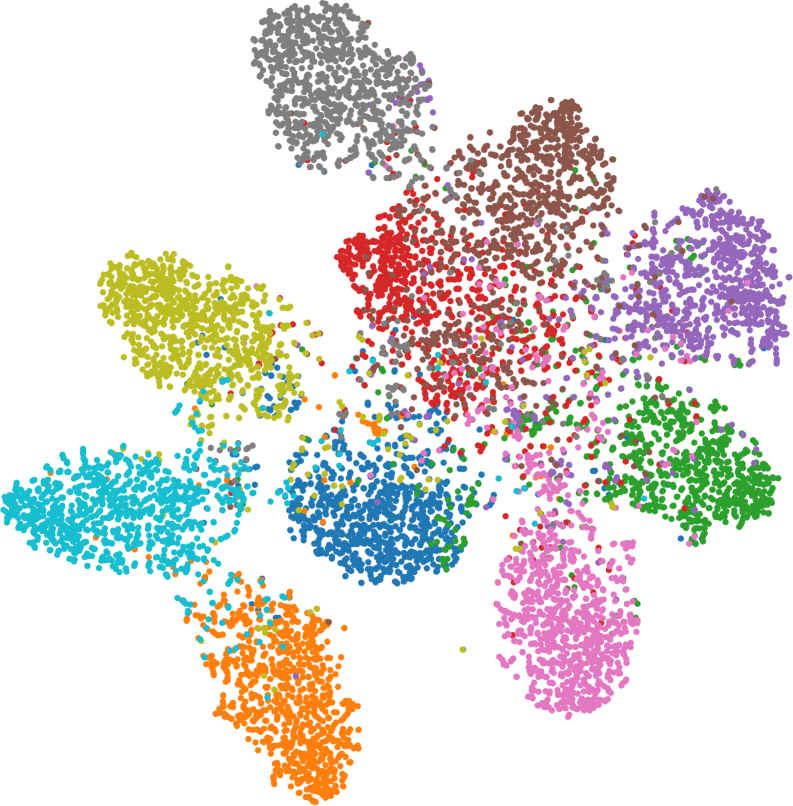

🖼️ 关键图片

📊 实验亮点

实验结果表明,FedFD在多个数据集上优于现有的模型异构联邦学习方法。例如,在CIFAR-10数据集上,FedFD相比于基线方法取得了显著的性能提升,具体提升幅度未知,原文未给出具体数值。FedFD的训练过程更加稳定,收敛速度更快。

🎯 应用场景

FedFD可应用于各种需要模型异构联邦学习的场景,例如医疗健康、金融风控、智能交通等。在这些场景中,不同机构或设备可能拥有不同结构的本地模型,FedFD能够有效地聚合这些模型的知识,提高全局模型的性能,同时保护用户隐私。该方法还可以应用于跨设备联邦学习,例如在智能手机上训练个性化模型。

📄 摘要(原文)

Model-Heterogeneous Federated Learning (Hetero-FL) has attracted growing attention for its ability to aggregate knowledge from heterogeneous models while keeping private data locally. To better aggregate knowledge from clients, ensemble distillation, as a widely used and effective technique, is often employed after global aggregation to enhance the performance of the global model. However, simply combining Hetero-FL and ensemble distillation does not always yield promising results and can make the training process unstable. The reason is that existing methods primarily focus on logit distillation, which, while being model-agnostic with softmax predictions, fails to compensate for the knowledge bias arising from heterogeneous models. To tackle this challenge, we propose a stable and efficient Feature Distillation for model-heterogeneous Federated learning, dubbed FedFD, that can incorporate aligned feature information via orthogonal projection to integrate knowledge from heterogeneous models better. Specifically, a new feature-based ensemble federated knowledge distillation paradigm is proposed. The global model on the server needs to maintain a projection layer for each client-side model architecture to align the features separately. Orthogonal techniques are employed to re-parameterize the projection layer to mitigate knowledge bias from heterogeneous models and thus maximize the distilled knowledge. Extensive experiments show that FedFD achieves superior performance compared to state-of-the-art methods.