AdaBrain-Bench: Benchmarking Brain Foundation Models for Brain-Computer Interface Applications

作者: Jiamin Wu, Zichen Ren, Junyu Wang, Pengyu Zhu, Yonghao Song, Mianxin Liu, Qihao Zheng, Lei Bai, Wanli Ouyang, Chunfeng Song

分类: cs.LG

发布日期: 2025-07-14 (更新: 2025-08-05)

💡 一句话要点

提出AdaBrain-Bench,用于评估脑机接口应用中脑基础模型的性能

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 脑机接口 脑基础模型 基准测试 迁移学习 脑电图 自监督学习 非侵入式BCI

📋 核心要点

- 非侵入式脑机接口面临噪声大、数据有限的挑战,限制了解码能力,需要更有效的评估方法。

- AdaBrain-Bench提供了一个大规模标准化基准,用于系统评估脑基础模型在不同BCI任务中的性能。

- 该基准包含多样的数据集、简化的适应流程和多维评估指标,支持跨被试、多被试和少样本场景的评估。

📝 摘要(中文)

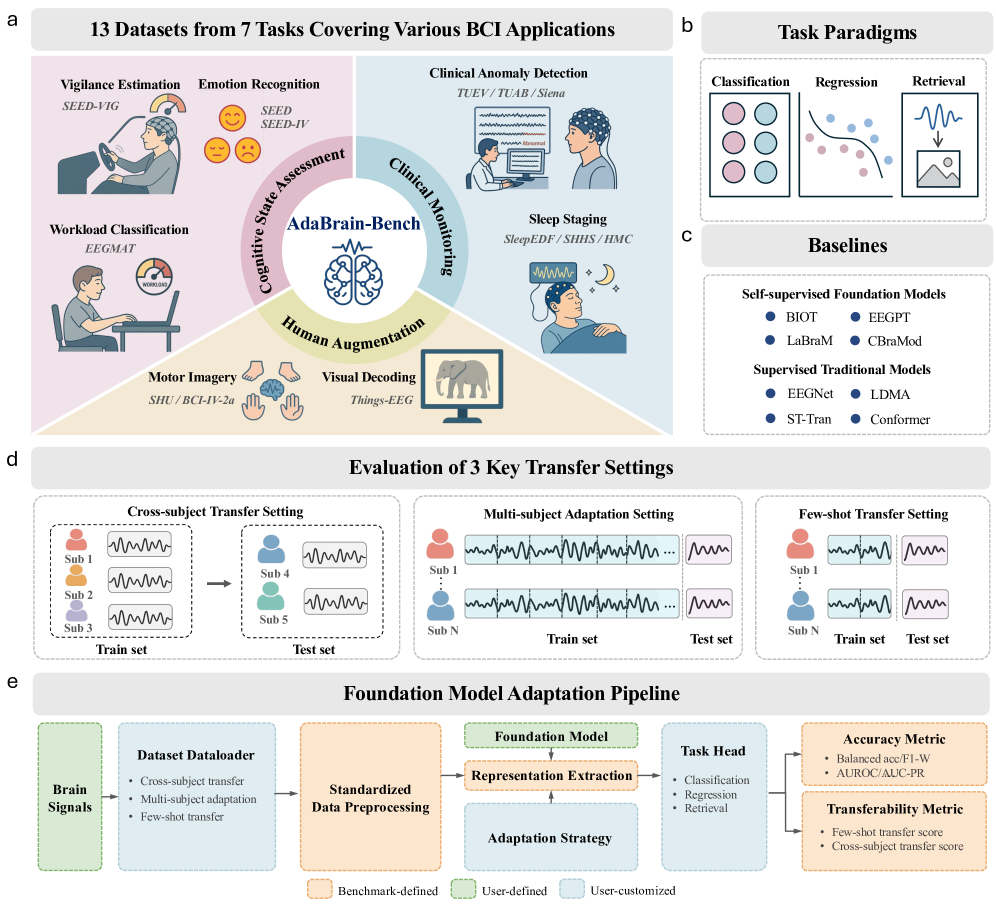

非侵入式脑机接口(BCI)提供了一种安全且易于访问的方式,将人脑与外部设备连接,在家庭和临床环境中具有广泛的应用,以增强人类能力。然而,非侵入式信号中的高噪声水平和有限的任务特定数据限制了解码能力。最近,自监督预训练的应用正在改变非侵入式BCI研究的格局,使得能够开发脑基础模型,以从大规模未标记的脑电图(EEG)信号中捕获通用神经表征,这些信号具有大量的噪声。然而,尽管取得了这些进展,但该领域目前缺乏全面、实用和可扩展的基准来评估公共基础模型在各种BCI任务中的效用,从而阻碍了它们的广泛采用。为了应对这一挑战,我们提出了AdaBrain-Bench,这是一个大规模标准化基准,用于系统地评估广泛的非侵入式BCI任务中的脑基础模型。AdaBrain-Bench包含代表性的BCI解码数据集,涵盖7个关键应用。它引入了一个简化的任务适应流程,集成了多维评估指标和一组适应工具。该基准提供了一个包容性的框架,用于评估脑基础模型在关键迁移设置中的泛化能力,包括跨被试、多被试和少样本场景。我们利用AdaBrain-Bench来评估一套公开可用的脑基础模型,并提供关于在各种场景中选择适当模型的实践的见解。我们提供我们的基准流程,以实现可重复的研究和外部使用,提供一个不断发展的平台,以促进朝着稳健和通用的神经解码解决方案的进展。

🔬 方法详解

问题定义:现有的非侵入式脑机接口(BCI)研究面临着数据噪声大、任务特定数据有限的问题,这严重限制了解码的准确性和泛化能力。虽然自监督预训练的脑基础模型在一定程度上缓解了这个问题,但缺乏一个全面、实用且可扩展的基准来评估这些模型的性能,阻碍了它们在不同BCI任务中的广泛应用。因此,需要一个统一的平台来系统地评估和比较不同的脑基础模型。

核心思路:AdaBrain-Bench的核心思路是构建一个大规模、标准化的基准测试平台,该平台包含多样化的BCI数据集,涵盖不同的应用场景和实验设置。通过提供统一的任务适应流程、多维评估指标和适应工具,AdaBrain-Bench旨在促进对脑基础模型在不同迁移学习场景下的泛化能力的评估和比较。这样可以帮助研究人员更好地理解不同模型的优势和局限性,并为选择合适的模型提供指导。

技术框架:AdaBrain-Bench的技术框架主要包括以下几个部分:1) 多样化的BCI数据集:收集了涵盖7个关键应用的代表性BCI解码数据集。2) 简化的任务适应流程:提供了一个标准化的流程,用于将脑基础模型适应到不同的BCI任务中。3) 多维评估指标:采用多种评估指标,从不同角度评估模型的性能,包括准确率、F1-score等。4) 适应工具:提供了一组工具,用于简化模型的适应过程。该框架支持跨被试、多被试和少样本等多种迁移学习场景的评估。

关键创新:AdaBrain-Bench的关键创新在于其提供了一个大规模、标准化且易于使用的基准测试平台,用于评估脑基础模型在非侵入式BCI应用中的性能。与以往的研究相比,AdaBrain-Bench更加全面地考虑了不同应用场景、数据集和评估指标,并提供了一套完整的工具和流程,方便研究人员进行实验和比较。此外,AdaBrain-Bench还特别关注了模型的泛化能力,支持多种迁移学习场景的评估。

关键设计:AdaBrain-Bench的关键设计包括:1) 数据集选择:选择具有代表性的BCI数据集,涵盖不同的应用场景和实验设置。2) 评估指标:采用多种评估指标,以全面评估模型的性能。3) 任务适应流程:设计一个标准化的任务适应流程,方便研究人员将脑基础模型应用到不同的BCI任务中。4) 迁移学习设置:支持跨被试、多被试和少样本等多种迁移学习场景的评估。具体参数设置和网络结构取决于所评估的脑基础模型。

🖼️ 关键图片

📊 实验亮点

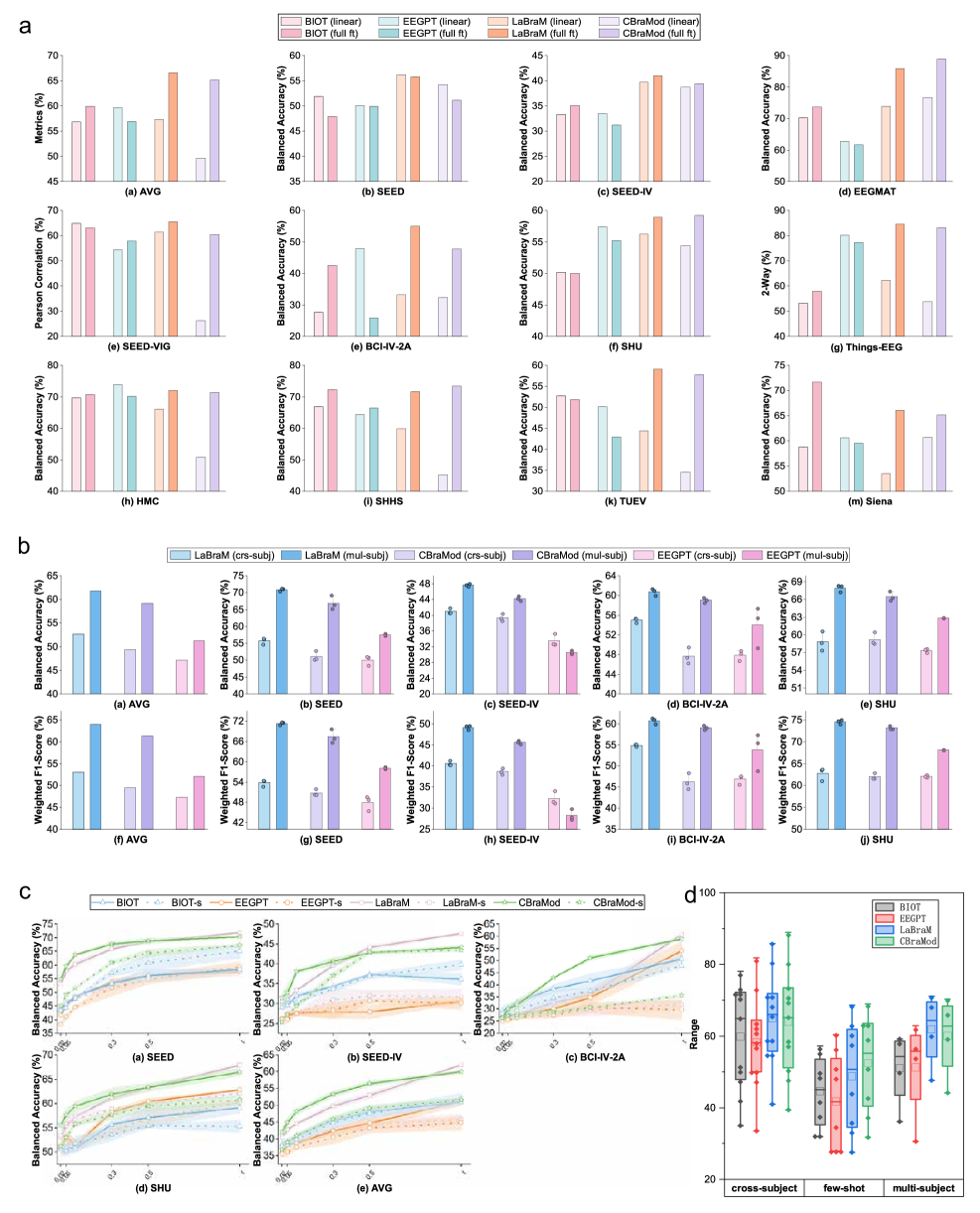

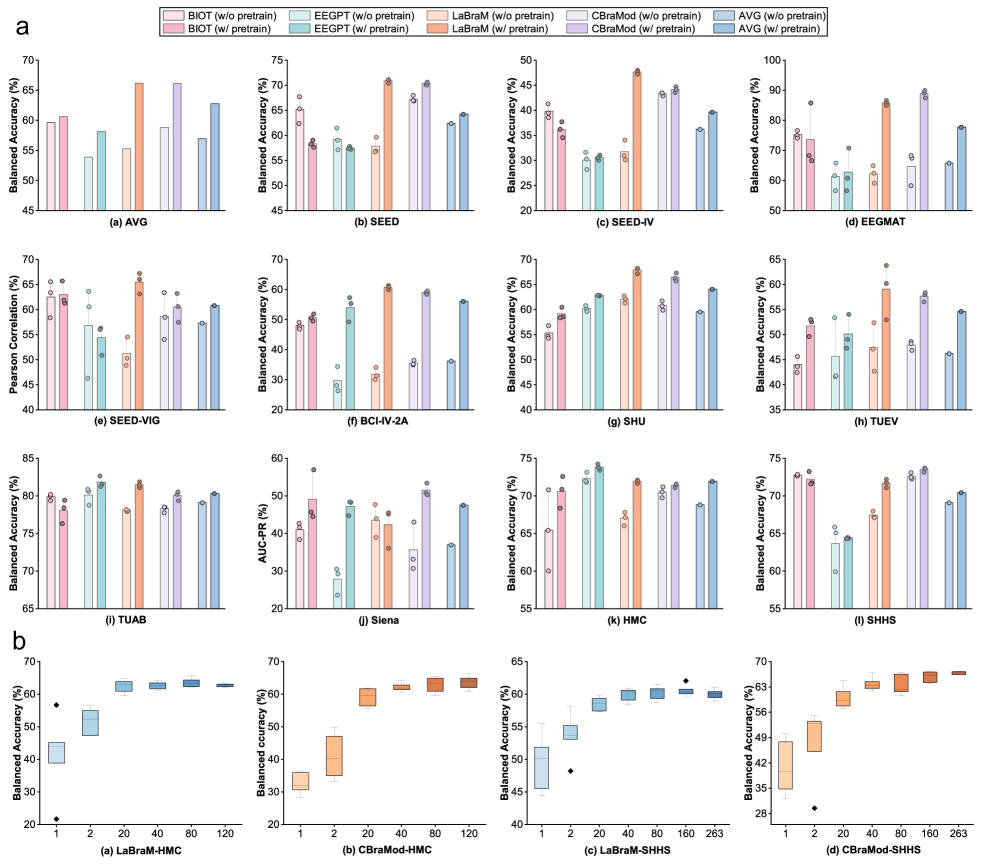

AdaBrain-Bench评估了多个公开可用的脑基础模型,并提供了在不同场景下选择合适模型的实践指导。实验结果表明,不同的脑基础模型在不同的BCI任务和迁移学习设置下表现出不同的性能。该基准测试平台为研究人员提供了一个客观的评估工具,有助于推动脑机接口技术的进步。

🎯 应用场景

AdaBrain-Bench可广泛应用于脑机接口领域,加速脑基础模型的研究和应用。它能够帮助研究人员选择合适的模型,优化模型参数,并评估模型在不同场景下的泛化能力。这对于开发更高效、更可靠的脑机接口系统,从而改善患者的生活质量,具有重要的实际价值和深远的影响。

📄 摘要(原文)

Non-invasive Brain-Computer Interfaces (BCI) offer a safe and accessible means of connecting the human brain to external devices, with broad applications in home and clinical settings to enhance human capabilities. However, the high noise level and limited task-specific data in non-invasive signals constrain decoding capabilities. Recently, the adoption of self-supervised pre-training is transforming the landscape of non-invasive BCI research, enabling the development of brain foundation models to capture generic neural representations from large-scale unlabeled electroencephalography (EEG) signals with substantial noises. However, despite these advances, the field currently lacks comprehensive, practical and extensible benchmarks to assess the utility of the public foundation models across diverse BCI tasks, hindering their widespread adoption. To address this challenge, we present AdaBrain-Bench, a large-scale standardized benchmark to systematically evaluate brain foundation models in widespread non-invasive BCI tasks. AdaBrain-Bench encompasses a diverse collection of representative BCI decoding datasets spanning 7 key applications. It introduces a streamlined task adaptation pipeline integrated with multi-dimensional evaluation metrics and a set of adaptation tools. The benchmark delivers an inclusive framework for assessing generalizability of brain foundation models across key transfer settings, including cross-subject, multi-subject, and few-shot scenarios. We leverage AdaBrain-Bench to evaluate a suite of publicly available brain foundation models and offer insights into practices for selecting appropriate models in various scenarios. We make our benchmark pipeline available to enable reproducible research and external use, offering a continuously evolving platform to foster progress toward robust and generalized neural decoding solutions.