Scaling Laws for Optimal Data Mixtures

作者: Mustafa Shukor, Louis Bethune, Dan Busbridge, David Grangier, Enrico Fini, Alaaeldin El-Nouby, Pierre Ablin

分类: cs.LG

发布日期: 2025-07-12 (更新: 2025-10-02)

💡 一句话要点

提出基于缩放定律的数据混合优化方法,提升大模型在目标领域的性能。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 缩放定律 数据混合 预训练模型 领域自适应 模型优化

📋 核心要点

- 传统数据混合方法依赖试错,在大规模预训练中效率低下且成本高昂。

- 利用缩放定律,预测不同数据混合比例下模型在目标领域的性能表现。

- 实验验证了该方法在LLM、NMM和LVM预训练中的有效性,并能外推至更大规模。

📝 摘要(中文)

大型基础模型通常在来自多个领域的数据上进行训练,数据混合(即每个领域的使用比例)在模型性能中起着至关重要的作用。选择这种混合的标准方法依赖于反复试验,这对于大规模预训练来说是不切实际的。我们提出了一种系统的方法,利用缩放定律来确定任何目标领域的最佳数据混合。我们的方法能够准确预测模型大小为N,使用D个tokens和特定的领域权重向量h训练的模型的损失。我们通过证明这些缩放定律在三个不同的大规模环境中的预测能力来验证它们的普遍性:大型语言模型(LLM)、原生多模态模型(NMM)和大型视觉模型(LVM)预训练。我们进一步表明,这些缩放定律可以外推到新的数据混合和跨尺度:它们的参数可以使用一些小规模的训练运行来准确估计,并用于估计更大尺度和未见过的领域权重的性能。缩放定律允许在给定的训练预算(N,D)下推导出任何目标领域的最佳领域权重,为昂贵的反复试验方法提供了一种有原则的替代方案。

🔬 方法详解

问题定义:论文旨在解决大规模预训练中数据混合比例优化的问题。现有方法主要依赖于耗时且低效的试错法来确定不同领域数据的最佳混合比例,这在大规模模型训练中变得不可行。因此,如何高效地找到针对特定目标领域的最佳数据混合比例是一个关键挑战。

核心思路:论文的核心思路是利用缩放定律来建模模型性能与数据混合比例之间的关系。通过建立模型大小、训练数据量和领域权重与模型损失之间的函数关系,可以预测不同数据混合比例下模型的性能。这种方法避免了大规模的试错,从而显著降低了计算成本。

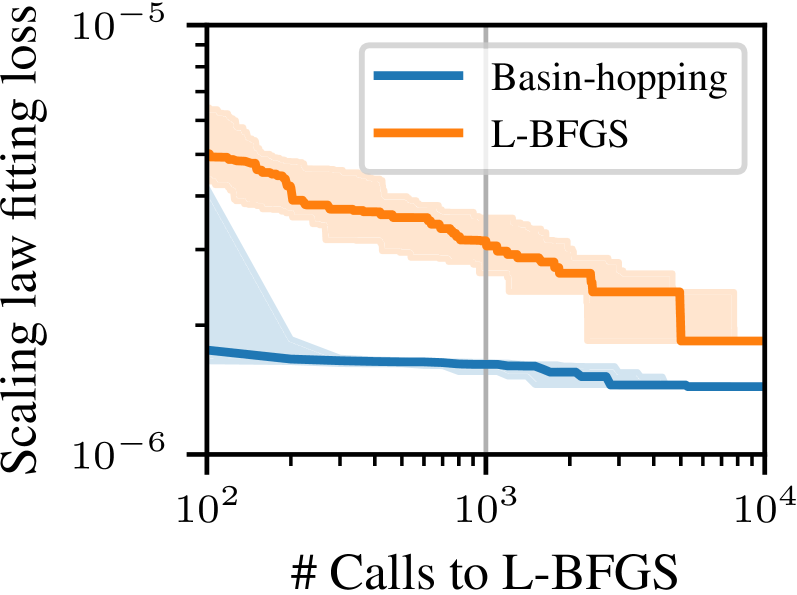

技术框架:该方法主要包含以下几个阶段:1) 小规模实验:在不同数据混合比例下进行小规模模型训练,收集模型性能数据。2) 缩放定律建模:利用收集到的数据,拟合缩放定律的参数,建立模型性能与数据混合比例之间的关系模型。3) 优化:基于缩放定律模型,优化数据混合比例,找到针对特定目标领域的最佳混合比例。4) 大规模验证:使用优化后的数据混合比例进行大规模模型训练,验证方法的有效性。

关键创新:该论文的关键创新在于将缩放定律应用于数据混合比例的优化。与传统的试错法相比,该方法能够利用小规模实验数据预测大规模模型在不同数据混合比例下的性能,从而实现高效的数据混合比例优化。此外,该方法具有通用性,可以应用于不同类型的模型和数据集。

关键设计:论文中,缩放定律的具体形式需要根据实际情况进行选择和调整。例如,可以使用幂律、对数律等不同的函数形式来建模模型性能与数据混合比例之间的关系。此外,损失函数的选择也会影响缩放定律的拟合效果。在实验中,需要仔细选择合适的损失函数,并进行充分的实验验证。

🖼️ 关键图片

📊 实验亮点

论文在三个大规模实验中验证了所提出方法的有效性,包括LLM、NMM和LVM预训练。实验结果表明,该方法能够准确预测不同数据混合比例下模型的性能,并能外推到新的数据混合和跨尺度。通过优化数据混合比例,模型在目标领域的性能得到了显著提升,训练成本也得到了有效控制。

🎯 应用场景

该研究成果可广泛应用于大规模预训练模型的训练中,例如大型语言模型、多模态模型和视觉模型。通过优化数据混合比例,可以显著提升模型在特定目标领域的性能,降低训练成本,加速模型开发周期。该方法还可用于指导数据集的构建和选择,提高数据利用效率。

📄 摘要(原文)

Large foundation models are typically trained on data from multiple domains, with the data mixture--the proportion of each domain used--playing a critical role in model performance. The standard approach to selecting this mixture relies on trial and error, which becomes impractical for large-scale pretraining. We propose a systematic method to determine the optimal data mixture for any target domain using scaling laws. Our approach accurately predicts the loss of a model of size $N$ trained with $D$ tokens and a specific domain weight vector $h$. We validate the universality of these scaling laws by demonstrating their predictive power in three distinct and large-scale settings: large language model (LLM), native multimodal model (NMM), and large vision models (LVM) pretraining. We further show that these scaling laws can extrapolate to new data mixtures and across scales: their parameters can be accurately estimated using a few small-scale training runs, and used to estimate the performance at larger scales and unseen domain weights. The scaling laws allow to derive the optimal domain weights for any target domain under a given training budget ($N$,$D$), providing a principled alternative to costly trial-and-error methods.