SPLASH! Sample-efficient Preference-based inverse reinforcement learning for Long-horizon Adversarial tasks from Suboptimal Hierarchical demonstrations

作者: Peter Crowley, Zachary Serlin, Tyler Paine, Makai Mann, Michael Benjamin, Calin Belta

分类: cs.LG, cs.RO

发布日期: 2025-07-11

💡 一句话要点

SPLASH:基于偏好的逆强化学习,从次优分层演示中学习长时对抗任务

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 逆强化学习 偏好学习 次优演示 长时程任务 对抗性环境 分层强化学习 无人水面艇

📋 核心要点

- 现有逆强化学习方法通常依赖于专家演示,难以处理次优演示下的长时程和对抗性任务。

- SPLASH通过基于偏好的学习方式,从次优分层演示中学习奖励函数,从而解决长时程对抗任务。

- 实验表明,SPLASH在模拟和真实世界的无人水面艇任务中,显著优于现有从次优演示学习的方法。

📝 摘要(中文)

逆强化学习(IRL)为从人类演示中学习复杂的机器人任务提供了一个强大的范例。然而,大多数方法都假设可以获得专家演示,但情况往往并非如此。那些允许演示中存在次优性的方法,并非为长时程目标或对抗性任务而设计。许多理想的机器人能力属于这两类中的一类或两类,因此突出了IRL在生成可用于实际的机器人代理方面的关键缺陷。我们引入了Sample-efficient Preference-based inverse reinforcement learning for Long-horizon Adversarial tasks from Suboptimal Hierarchical demonstrations (SPLASH),它推进了从次优演示中学习到长时程和对抗性设置的最新技术。我们通过在模拟中的海上夺旗任务上对SPLASH进行实证验证,并通过在自主无人水面车辆上的sim-to-real转换实验证明了其在现实世界中的适用性。我们表明,我们提出的方法使SPLASH能够显著优于从次优演示中进行奖励学习的最新技术。

🔬 方法详解

问题定义:论文旨在解决从次优分层演示中学习长时程对抗任务的奖励函数的问题。现有逆强化学习方法要么依赖于高质量的专家演示,要么无法有效处理长时程和对抗性环境下的次优演示,导致学习到的策略性能不佳。

核心思路:SPLASH的核心思路是利用基于偏好的学习方式,通过人类对不同轨迹片段的偏好来学习奖励函数。这种方法不需要完美的专家演示,并且能够更好地处理次优演示中的噪声和不确定性。同时,利用分层演示结构,将长时程任务分解为多个子任务,从而降低学习难度。

技术框架:SPLASH的整体框架包含以下几个主要模块:1) 轨迹生成模块:生成一系列轨迹片段,这些轨迹片段可能来自次优的演示数据。2) 偏好收集模块:通过模拟或真实用户,对生成的轨迹片段进行偏好排序。3) 奖励学习模块:利用收集到的偏好数据,学习一个奖励函数,该奖励函数能够反映人类对不同行为的偏好。4) 策略优化模块:使用学习到的奖励函数,训练一个策略来完成目标任务。

关键创新:SPLASH的关键创新在于结合了基于偏好的学习和分层演示结构,从而能够从次优演示中学习长时程对抗任务的奖励函数。与传统的逆强化学习方法相比,SPLASH不需要高质量的专家演示,并且能够更好地处理次优演示中的噪声和不确定性。此外,分层演示结构降低了学习难度,使得SPLASH能够处理更复杂的任务。

关键设计:SPLASH的关键设计包括:1) 使用Bradley-Terry模型来建模人类的偏好关系。2) 使用神经网络来表示奖励函数,并使用偏好数据来训练该网络。3) 使用分层强化学习算法来优化策略,例如分层Q学习或选项框架。4) 设计合适的轨迹片段生成策略,例如随机采样或基于模型的生成。

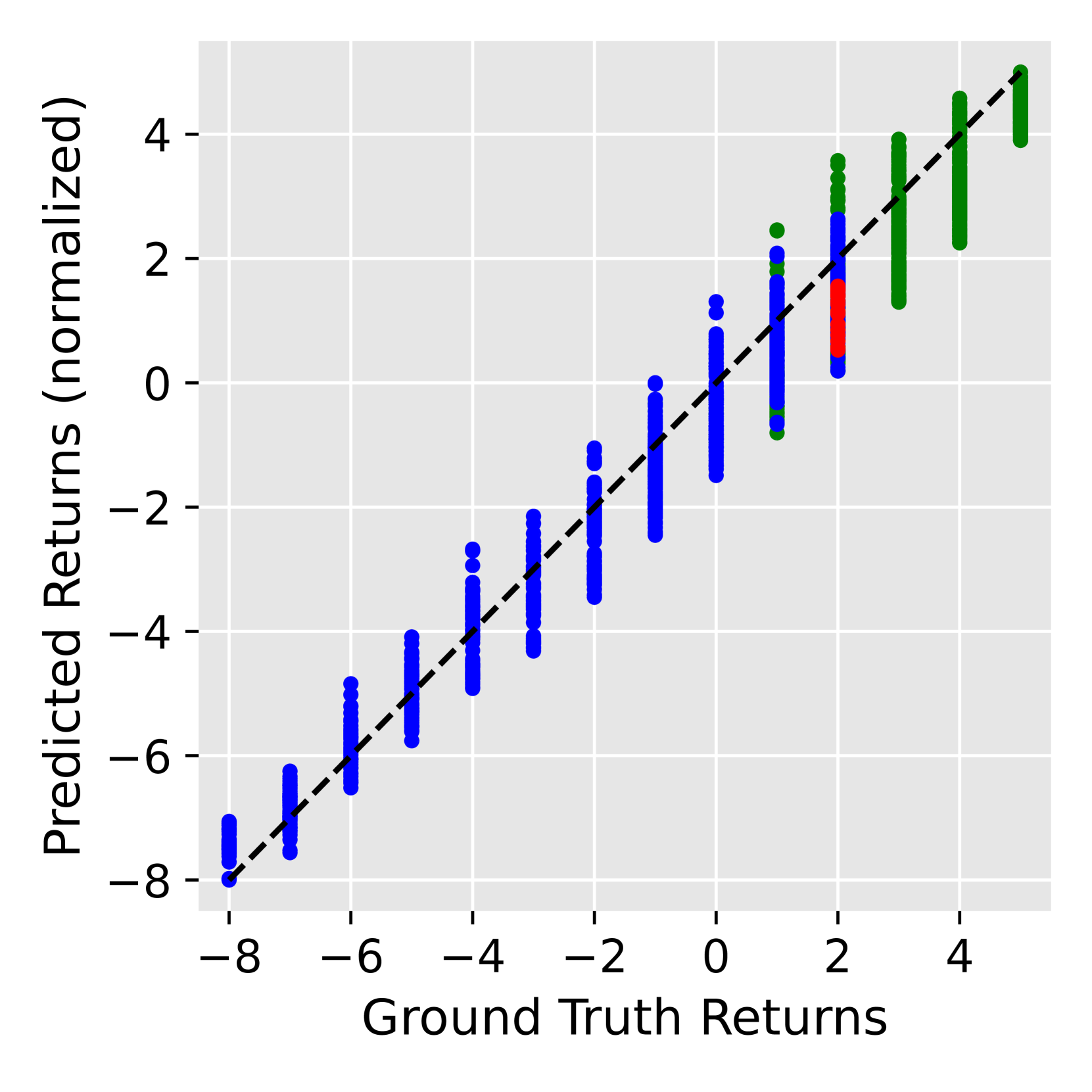

🖼️ 关键图片

📊 实验亮点

SPLASH在模拟的海上夺旗任务中,显著优于现有的从次优演示学习方法。在真实世界的无人水面艇实验中,SPLASH通过sim-to-real转换,成功实现了自主导航和目标追踪,验证了其在实际应用中的可行性。具体性能提升数据在论文中给出,表明SPLASH在奖励学习和策略优化方面都取得了显著进展。

🎯 应用场景

SPLASH可应用于各种需要从次优演示中学习复杂行为的机器人任务,例如自主导航、目标追踪、人机协作等。特别是在对抗性环境中,例如海上安全巡逻、无人机防御等,SPLASH能够学习到鲁棒性更强的策略,具有重要的实际应用价值。未来,SPLASH可以进一步扩展到更复杂的任务和环境,例如多智能体协作、动态环境等。

📄 摘要(原文)

Inverse Reinforcement Learning (IRL) presents a powerful paradigm for learning complex robotic tasks from human demonstrations. However, most approaches make the assumption that expert demonstrations are available, which is often not the case. Those that allow for suboptimality in the demonstrations are not designed for long-horizon goals or adversarial tasks. Many desirable robot capabilities fall into one or both of these categories, thus highlighting a critical shortcoming in the ability of IRL to produce field-ready robotic agents. We introduce Sample-efficient Preference-based inverse reinforcement learning for Long-horizon Adversarial tasks from Suboptimal Hierarchical demonstrations (SPLASH), which advances the state-of-the-art in learning from suboptimal demonstrations to long-horizon and adversarial settings. We empirically validate SPLASH on a maritime capture-the-flag task in simulation, and demonstrate real-world applicability with sim-to-real translation experiments on autonomous unmanned surface vehicles. We show that our proposed methods allow SPLASH to significantly outperform the state-of-the-art in reward learning from suboptimal demonstrations.