Reinforcement Fine-Tuning Naturally Mitigates Forgetting in Continual Post-Training

作者: Song Lai, Haohan Zhao, Rong Feng, Changyi Ma, Wenzhuo Liu, Hongbo Zhao, Xi Lin, Dong Yi, Qingfu Zhang, Hongbin Liu, Gaofeng Meng, Fei Zhu

分类: cs.LG, cs.AI, cs.CL

发布日期: 2025-07-07 (更新: 2026-01-21)

💡 一句话要点

提出基于强化学习的微调方法,缓解持续后训练中的灾难性遗忘问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 持续学习 强化微调 灾难性遗忘 多模态学习 后训练 正则化 大语言模型

📋 核心要点

- 现有持续后训练方法在适应新任务时,容易遗忘先前学习的任务知识,即灾难性遗忘问题。

- 论文提出使用强化微调(RFT)作为持续后训练的学习范式,利用其内在的正则化机制来缓解遗忘。

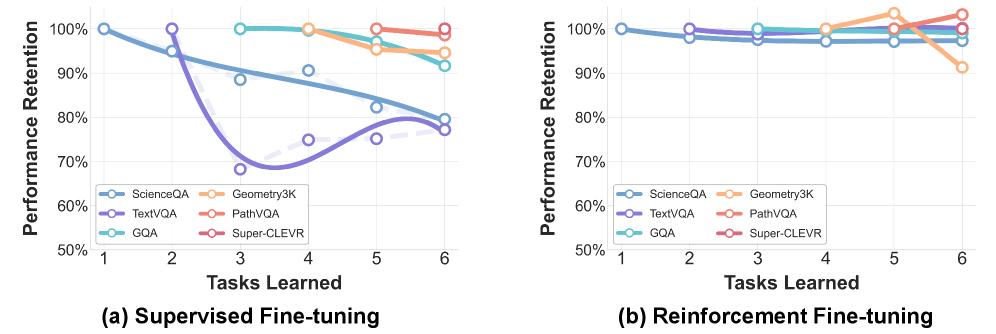

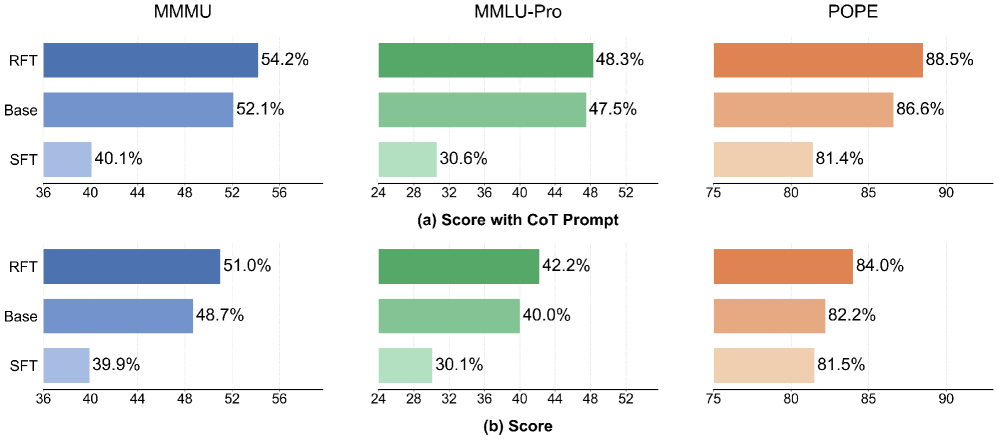

- 实验表明,RFT在持续学习下游任务时,能有效保留先前知识,甚至提升通用知识,优于监督微调。

📝 摘要(中文)

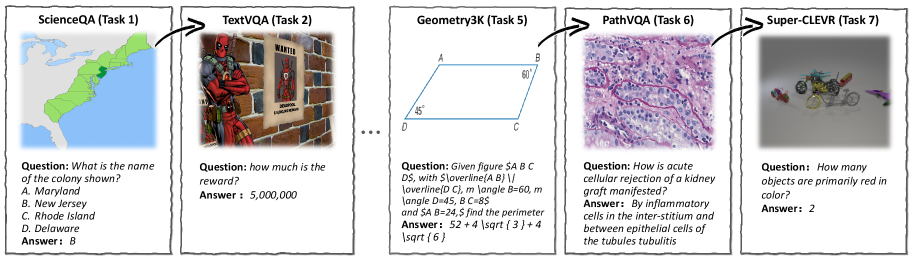

持续后训练(CPT)是一种流行的技术,用于将多模态大语言模型等基础模型适应于特定的、不断发展的下游任务。现有研究主要集中于数据回放、模型扩展或参数正则化等方法,而CPT中学习范式的基本作用在很大程度上未被探索。本文对两种核心后训练范式:监督微调(SFT)和强化微调(RFT)进行了比较分析,研究了它们各自对CPT期间知识保留的影响。实验在一个包含七个不同多模态任务的基准上进行,使用Qwen2.5-VL-7B-Instruct作为持续后训练的基础模型。研究结果表明:(1)在下游任务上持续学习时,SFT会导致先前学习任务的灾难性遗忘。相比之下,RFT固有地保留了先前的知识,并实现了与多任务训练相当的性能。(2)RFT成功地保护甚至增强了模型在标准基准(如MMMU和MMLU-Pro)上的通用知识。相反,SFT严重降低了模型的通用能力。进一步的分析表明,这种稳定性并非主要归因于诸如KL惩罚或思维链推理等显式机制。相反,我们将RFT固有的隐式正则化机制确定为一个关键因素。我们的理论分析表明,RFT的梯度更新自然地被奖励方差缩放,充当一种数据相关的正则化器,从而固有地保护了先前获得的知识。最后,我们提出了一种基于rollout的实例过滤算法,以提高RFT的稳定性和效率。我们的综合研究表明,RFT是持续后训练的一种鲁棒范式。

🔬 方法详解

问题定义:持续后训练(CPT)旨在使预训练模型适应不断变化的下游任务。然而,传统的监督微调(SFT)在CPT中面临灾难性遗忘的问题,即模型在学习新任务时会忘记先前学习的任务。现有方法如数据回放、模型扩展和参数正则化等,虽然能缓解遗忘,但计算成本高昂或效果有限。

核心思路:论文的核心思路是利用强化微调(RFT)作为CPT的学习范式,RFT通过奖励信号引导模型学习,其梯度更新受到奖励方差的调节,从而产生一种隐式的正则化效果。这种正则化能够保护模型已有的知识,减少在学习新任务时对先前知识的干扰,从而缓解灾难性遗忘。

技术框架:论文使用Qwen2.5-VL-7B-Instruct作为基础模型,并在包含七个不同多模态任务的基准上进行实验。整体流程如下:1. 使用RFT或SFT对模型进行持续后训练,依次学习各个下游任务。2. 在每个任务学习后,评估模型在该任务以及先前任务上的性能,以衡量遗忘程度。3. 在标准基准(MMMU和MMLU-Pro)上评估模型的通用知识。4. 分析RFT的梯度更新,验证其隐式正则化机制。5. 提出基于rollout的实例过滤算法,进一步提高RFT的稳定性和效率。

关键创新:论文的关键创新在于:1. 首次将强化微调(RFT)应用于持续后训练(CPT),并证明其在缓解灾难性遗忘方面的有效性。2. 揭示了RFT的隐式正则化机制,即梯度更新受到奖励方差的调节,从而保护了先前知识。3. 提出了一种基于rollout的实例过滤算法,进一步提高了RFT的稳定性和效率。

关键设计:1. 奖励函数的设计:奖励函数需要能够准确反映模型在下游任务上的表现,例如,可以使用任务的准确率或F1值作为奖励。2. rollout策略:使用rollout策略生成训练样本,例如,可以使用模型的输出作为rollout的动作。3. 实例过滤算法:基于rollout的实例过滤算法用于选择更有价值的训练样本,从而提高RFT的效率和稳定性。该算法通过评估rollout过程中奖励的方差来判断样本的价值,选择方差较高的样本进行训练。

🖼️ 关键图片

📊 实验亮点

实验结果表明,在持续学习七个多模态任务时,RFT显著优于SFT,能够有效保留先前任务的知识,并取得与多任务训练相当的性能。此外,RFT还能保护甚至增强模型在MMMU和MMLU-Pro等标准基准上的通用知识,而SFT则会严重降低模型的通用能力。消融实验验证了RFT的隐式正则化机制,并证明了基于rollout的实例过滤算法能够进一步提高RFT的稳定性和效率。

🎯 应用场景

该研究成果可应用于各种需要持续学习的场景,例如智能客服、自动驾驶、机器人等。通过使用强化微调,模型可以在不断学习新任务的同时,保持甚至提升其通用知识和先前任务的性能,从而提高系统的鲁棒性和适应性。此外,该研究也为持续学习领域提供了新的思路,即利用学习范式本身的特性来缓解灾难性遗忘。

📄 摘要(原文)

Continual post-training (CPT) is a popular and effective technique for adapting foundation models like multimodal large language models to specific and ever-evolving downstream tasks. While existing research has primarily concentrated on methods like data replay, model expansion, or parameter regularization, the fundamental role of the learning paradigm within CPT remains largely unexplored. This paper presents a comparative analysis of two core post-training paradigms: supervised fine-tuning (SFT) and reinforcement fine-tuning (RFT), investigating their respective impacts on knowledge retention during CPT. Our experiments are conducted on a benchmark comprising seven diverse multimodal tasks, utilizing Qwen2.5-VL-7B-Instruct as the base model for continual post-training. The investigation yields two significant findings: (1) When continuously learning on downstream tasks, SFT leads to catastrophic forgetting of previously learned tasks. In contrast, RFT inherently preserves prior knowledge and achieve performance comparable to multi-task training. (2) RFT successfully protects and even enhances the model's general knowledge on standard benchmarks (e.g., MMMU and MMLU-Pro). Conversely, SFT degrades general model capabilities severely. Further analysis reveals that this stability is not primarily due to explicit mechanisms like KL penalty or chain-of-thought reasoning. Instead, we identify an implicit regularization mechanism inherent to RFT as a key contributing factor. Our theoretical analysis suggests that RFT's gradient updates are naturally scaled by the reward variance, acting as a data-dependent regularizer that inherently protects previously acquired knowledge. Finally, we propose a rollout-based instance filtering algorithm to enhance the stability and efficiency of RFT. Our comprehensive study demonstrates the superiority of RFT as a robust paradigm for continual post-training.