When do World Models Successfully Learn Dynamical Systems?

作者: Edmund Ross, Claudia Drygala, Leonhard Schwarz, Samir Kaiser, Francesca di Mare, Tobias Breiten, Hanno Gottschalk

分类: math.NA, cs.LG

发布日期: 2025-07-07 (更新: 2025-11-24)

💡 一句话要点

提出基于World Models的动力系统学习框架,有效模拟物理系统。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: World Models 动力系统 物理仿真 计算流体动力学 生成对抗网络

📋 核心要点

- 现有方法在模拟复杂物理系统时,难以在计算效率和精度之间取得平衡,尤其是在高维数据和长时间序列预测方面。

- 论文提出基于World Models的动力系统学习框架,通过tokenization将高维数据映射到低维潜在空间,并学习潜在空间的动态演化规律。

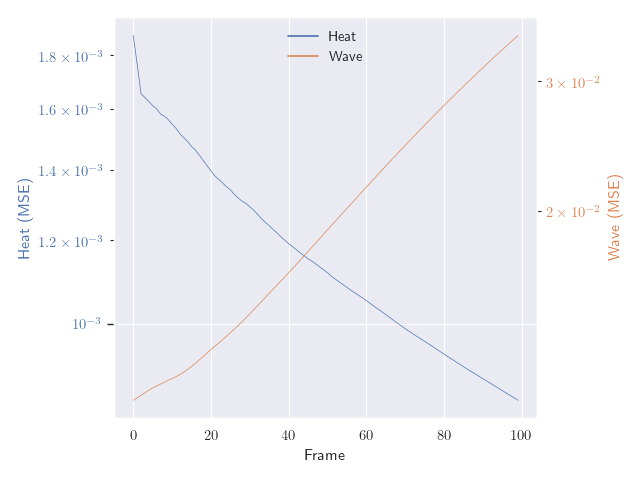

- 实验表明,该方法在多种物理数据集上表现出色,包括混沌系统和计算流体动力学,能够有效重现流动现象。

📝 摘要(中文)

本文探讨了使用具有学习时间动态的紧凑潜在表示(“World Models”)来模拟物理系统。借鉴控制理论的概念,我们提出了一个理论框架,解释了为什么将时间切片投影到低维空间,然后连接形成历史(“Tokenization”)在学习物理数据集时如此有效,并描述了底层动力学何时允许从先前tokenized帧的历史到下一个帧的重建映射。为了验证这些说法,我们开发了一系列复杂度递增的模型,从最小二乘回归开始,逐步发展到简单的线性层、浅层对抗学习器,最终到全尺寸生成对抗网络(GAN)。我们在各种数据集上评估这些模型,包括热方程和波动方程的修改形式、混沌状态下的二维Kuramoto-Sivashinsky方程,以及一个具有挑战性的二维卡门涡街绕固定圆柱体的计算流体动力学(CFD)数据集,我们的模型成功地重现了流动。

🔬 方法详解

问题定义:现有方法在模拟复杂物理系统时,面临高维数据处理和长时间序列预测的挑战。传统的数值模拟方法计算成本高昂,而直接学习高维数据的动态模型则容易过拟合。因此,需要一种能够有效降低数据维度,并准确捕捉系统动态特征的方法。

核心思路:论文的核心思路是利用World Models的思想,将物理系统的状态表示为低维潜在空间中的token,并通过学习潜在空间的动态演化规律来模拟系统的行为。通过tokenization,可以有效降低数据的维度,并提取关键的动态特征。

技术框架:整体框架包含以下几个主要模块:1) Tokenization:将原始高维数据(例如,物理场的快照)投影到低维潜在空间,生成token序列。2) 动态模型学习:学习潜在空间中token序列的时间动态演化规律,例如使用循环神经网络(RNN)或Transformer等模型。3) 重建:将潜在空间中的token序列解码回原始高维数据空间,用于可视化或进一步分析。

关键创新:论文的关键创新在于提出了一个理论框架,解释了tokenization在学习物理数据集时的有效性,并给出了底层动力学允许从先前tokenized帧的历史到下一个帧的重建映射的条件。此外,论文还系统地比较了不同复杂度的模型(从最小二乘回归到GAN)在模拟物理系统时的性能。

关键设计:论文中使用了多种模型结构,包括线性层、浅层对抗学习器和GAN。在GAN的训练过程中,使用了对抗损失和重建损失,以保证生成模型的质量和重建的准确性。此外,论文还探索了不同的tokenization方法,例如使用自编码器或变分自编码器来学习潜在空间。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在模拟二维卡门涡街绕固定圆柱体的计算流体动力学(CFD)数据集上表现出色,能够成功地重现流动现象。此外,该方法还在热方程、波动方程和Kuramoto-Sivashinsky方程等数据集上取得了良好的效果,验证了其在不同物理系统中的适用性。

🎯 应用场景

该研究成果可应用于各种物理系统的建模和仿真,例如流体动力学、热传导、材料科学等。通过学习系统的动态模型,可以进行预测、控制和优化,从而加速科学发现和工程设计。例如,可以用于优化飞行器的气动外形,设计高效的散热系统,或预测气候变化的影响。

📄 摘要(原文)

In this work, we explore the use of compact latent representations with learned time dynamics ('World Models') to simulate physical systems. Drawing on concepts from control theory, we propose a theoretical framework that explains why projecting time slices into a low-dimensional space and then concatenating to form a history ('Tokenization') is so effective at learning physics datasets, and characterise when exactly the underlying dynamics admit a reconstruction mapping from the history of previous tokenized frames to the next. To validate these claims, we develop a sequence of models with increasing complexity, starting with least-squares regression and progressing through simple linear layers, shallow adversarial learners, and ultimately full-scale generative adversarial networks (GANs). We evaluate these models on a variety of datasets, including modified forms of the heat and wave equations, the chaotic regime 2D Kuramoto-Sivashinsky equation, and a challenging computational fluid dynamics (CFD) dataset of a 2D Kármán vortex street around a fixed cylinder, where our model is successfully able to recreate the flow.