Interpretable Reward Modeling with Active Concept Bottlenecks

作者: Sonia Laguna, Katarzyna Kobalczyk, Julia E. Vogt, Mihaela Van der Schaar

分类: cs.LG

发布日期: 2025-07-07 (更新: 2025-07-20)

期刊: ICML 2025 Workshop on Programmatic Representations for Agent Learning

💡 一句话要点

提出基于主动概念瓶颈的可解释奖励建模框架,提升奖励模型透明度和样本效率。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 奖励建模 可解释性 主动学习 概念瓶颈 人机对齐

📋 核心要点

- 现有奖励模型依赖不透明函数,缺乏可解释性,难以理解模型决策依据。

- CB-RM将奖励预测分解为人类可解释的概念,并通过主动学习策略高效获取概念标签。

- 实验表明,CB-RM在可解释性和样本效率方面优于现有方法,尤其是在低监督场景下。

📝 摘要(中文)

本文提出了一种概念瓶颈奖励模型(CB-RM),该奖励建模框架通过选择性的概念标注来实现可解释的偏好学习。与依赖不透明奖励函数的标准RLHF方法不同,CB-RM将奖励预测分解为人类可解释的概念。为了使该框架在低监督设置中高效,本文形式化了一种主动学习策略,该策略动态地获取信息量最大的概念标签。本文提出了一种基于期望信息增益的获取函数,并表明它可以在不影响偏好准确性的前提下显著加速概念学习。在UltraFeedback数据集上的评估表明,本文方法在可解释性和样本效率方面优于基线方法,标志着朝着更透明、可审计和人类对齐的奖励模型迈出了一步。

🔬 方法详解

问题定义:现有基于强化学习的人工反馈(RLHF)方法依赖于不透明的奖励函数,这些函数难以解释和审计。这使得理解模型如何做出决策以及如何与人类价值观对齐变得困难。此外,在低监督环境下,学习有效的奖励模型需要大量的标注数据,成本高昂。

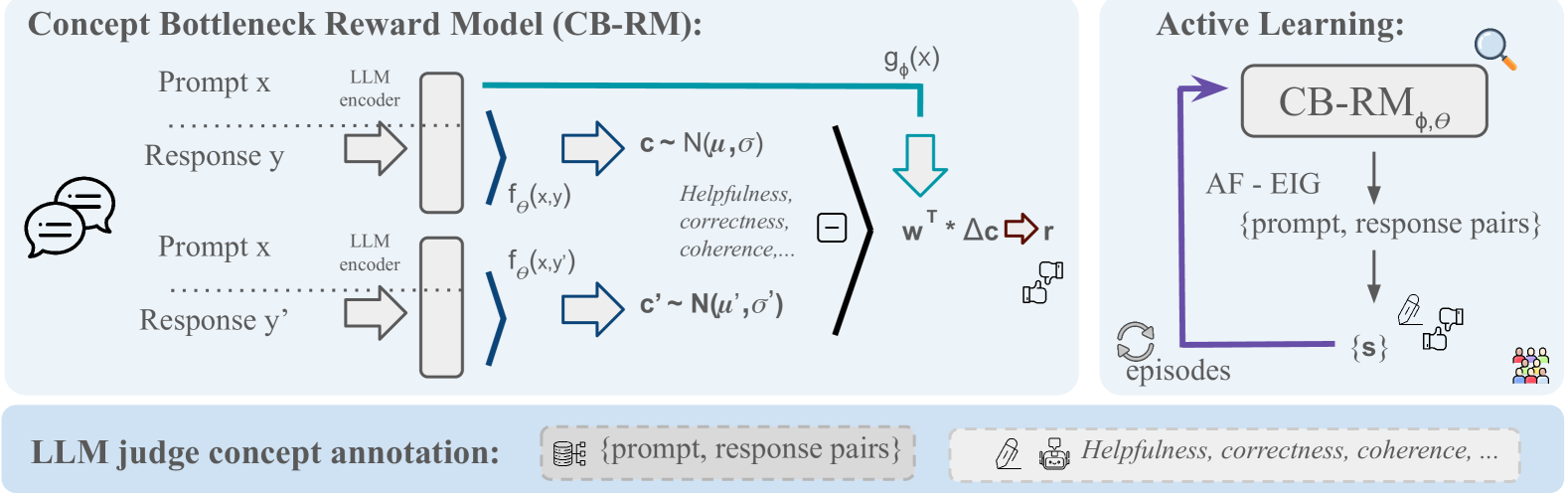

核心思路:CB-RM的核心思路是将奖励预测分解为一组人类可解释的概念。通过显式地建模这些概念与奖励之间的关系,可以提高奖励模型的可解释性。此外,CB-RM采用主动学习策略,选择性地标注最有信息量的概念,从而提高样本效率。

技术框架:CB-RM框架包含以下主要模块:1) 概念编码器:将输入文本或状态编码为概念表示。2) 奖励预测器:基于概念表示预测奖励值。3) 主动学习模块:根据期望信息增益选择下一个需要标注的概念。整个流程如下:首先,使用少量初始标注数据训练CB-RM。然后,主动学习模块选择下一个需要标注的概念,并将其呈现给标注者。标注者提供概念标签后,使用新的标注数据更新CB-RM。重复此过程,直到达到预定的标注预算或模型性能达到满意水平。

关键创新:CB-RM的关键创新在于将概念瓶颈与主动学习相结合,以实现可解释且样本高效的奖励建模。与传统的RLHF方法相比,CB-RM提供了对奖励函数内部运作的更深入了解。与被动学习方法相比,主动学习策略显著提高了样本效率。

关键设计:CB-RM使用期望信息增益(EIG)作为获取函数,以选择下一个需要标注的概念。EIG衡量了标注某个概念后,模型对奖励预测的不确定性降低程度。具体而言,EIG定义为:EIG(c) = H(R) - E[H(R|c)],其中H(R)是奖励R的熵,H(R|c)是在给定概念c的标签后的奖励R的条件熵。CB-RM使用神经网络来实现概念编码器和奖励预测器。损失函数包括奖励预测损失和概念预测损失。奖励预测损失衡量预测奖励与真实奖励之间的差异。概念预测损失衡量预测概念标签与真实概念标签之间的差异。

🖼️ 关键图片

📊 实验亮点

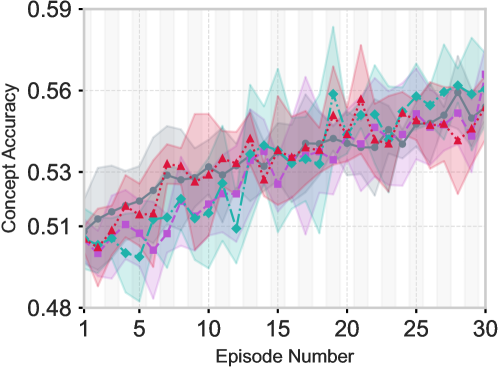

在UltraFeedback数据集上的实验表明,CB-RM在可解释性和样本效率方面优于基线方法。具体而言,CB-RM在保持偏好准确性的前提下,显著减少了所需的标注数据量。与被动学习方法相比,基于EIG的主动学习策略可以将概念学习速度提高20%-30%。

🎯 应用场景

CB-RM可应用于各种需要可解释和人类对齐的奖励模型的场景,例如:对话系统、推荐系统、自动驾驶等。通过理解模型决策背后的原因,可以提高用户对系统的信任度,并促进人机协作。此外,CB-RM还可以用于检测和纠正模型中的偏差,从而提高模型的公平性和可靠性。

📄 摘要(原文)

We introduce Concept Bottleneck Reward Models (CB-RM), a reward modeling framework that enables interpretable preference learning through selective concept annotation. Unlike standard RLHF methods that rely on opaque reward functions, CB-RM decomposes reward prediction into human-interpretable concepts. To make this framework efficient in low-supervision settings, we formalize an active learning strategy that dynamically acquires the most informative concept labels. We propose an acquisition function based on Expected Information Gain and show that it significantly accelerates concept learning without compromising preference accuracy. Evaluated on the UltraFeedback dataset, our method outperforms baselines in interpretability and sample efficiency, marking a step towards more transparent, auditable, and human-aligned reward models.