LRM-1B: Towards Large Routing Model

作者: Han Li, Fei Liu, Zhenkun Wang, Qingfu Zhang

分类: cs.LG

发布日期: 2025-07-04

💡 一句话要点

提出大规模路由模型LRM-1B,解决车辆路径问题并达到SOTA

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 车辆路径问题 神经组合优化 大规模模型 Transformer 强化学习 模型缩放 组合优化

📋 核心要点

- 现有神经组合优化方法在解决车辆路径问题上表现出潜力,但模型规模的探索不足,限制了性能。

- 论文提出大规模路由模型LRM-1B,拥有10亿参数,旨在通过模型缩放提升解决复杂VRP问题的能力。

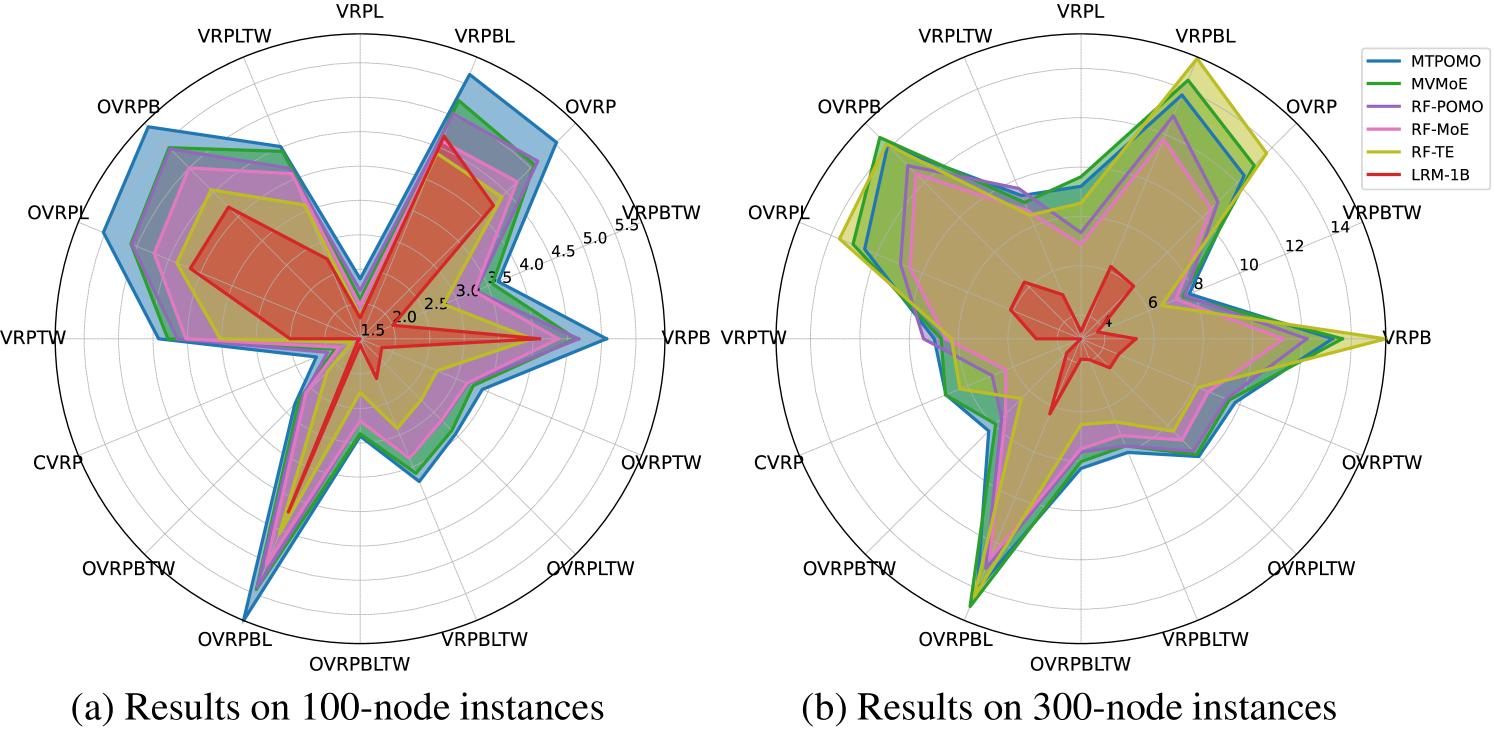

- 实验结果表明,LRM-1B在多种VRP变体和规模上均达到SOTA,并揭示了模型规模与性能之间的幂律关系。

📝 摘要(中文)

车辆路径问题(VRPs)是组合优化中的核心问题,具有重要的实际意义。近年来,神经组合优化(NCO)通过利用神经网络解决VRPs取得了可喜的进展,但该领域内模型规模的探索仍然不足。受大型语言模型(LLMs)中模型缩放成功的启发,本研究引入了一个具有10亿参数的大规模路由模型(LRM-1B),旨在解决各种VRP场景。我们对LRM-1B在多个问题变体、分布和规模上进行了全面评估,建立了最先进的结果。我们的研究结果表明,LRM-1B不仅适应不同的VRP挑战,而且表现出卓越的性能,优于现有模型。此外,我们还探讨了神经路由模型从100万到10亿参数的缩放行为。我们的分析证实了多个模型因素和性能之间的幂律关系,为基础神经路由求解器的最佳配置提供了关键见解。

🔬 方法详解

问题定义:论文旨在解决车辆路径问题(VRPs),这是一个经典的组合优化问题,在物流、交通等领域有广泛应用。现有神经组合优化方法虽然取得了一定进展,但模型规模普遍较小,难以应对复杂和大规模的VRP实例。因此,如何通过扩大模型规模来提升神经组合优化方法在VRP问题上的性能是一个关键挑战。

核心思路:论文的核心思路是借鉴大型语言模型(LLMs)的成功经验,通过扩大神经路由模型的规模来提升其解决VRP问题的能力。作者认为,更大的模型能够学习到更复杂的VRP问题特征,从而更好地进行路径规划和优化。

技术框架:LRM-1B的整体架构基于Transformer模型,这是一种在序列建模任务中表现出色的神经网络结构。具体来说,该模型接收VRP问题的输入(例如,客户位置、车辆容量等),然后通过多层Transformer编码器进行处理,最终输出车辆的行驶路线。模型训练采用强化学习方法,通过奖励函数来引导模型学习最优的路径规划策略。

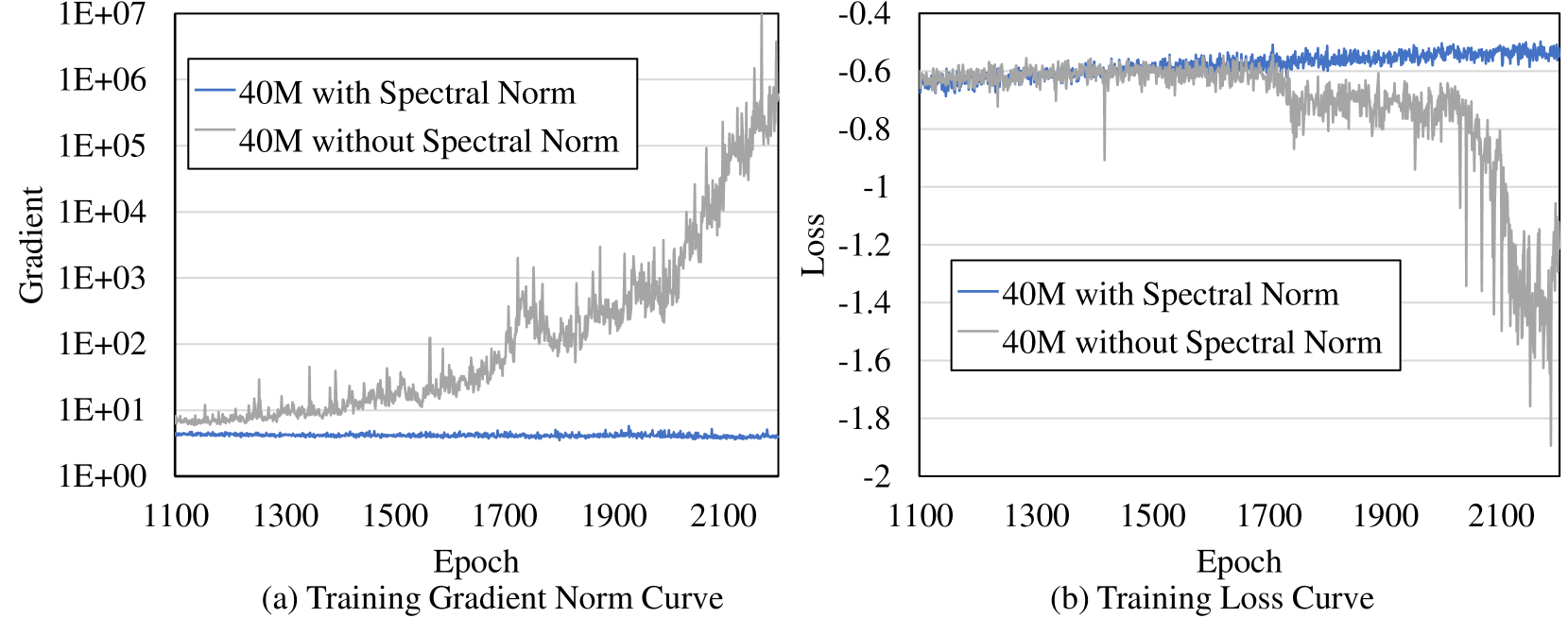

关键创新:论文最重要的技术创新点在于将模型规模扩展到10亿参数,这在神经组合优化领域是一个显著的突破。通过大规模的模型训练,LRM-1B能够学习到更复杂的VRP问题特征,从而在多个VRP变体上取得SOTA结果。此外,论文还分析了模型规模与性能之间的关系,揭示了幂律缩放行为,为未来神经路由模型的设计提供了指导。

关键设计:LRM-1B的关键设计包括:1)采用Transformer编码器作为核心网络结构;2)使用强化学习进行模型训练,奖励函数设计为路径长度的负值;3)探索了不同的模型规模(从1M到1B参数),并分析了模型规模与性能之间的关系;4)在多个VRP变体和规模上进行了实验评估,验证了LRM-1B的有效性。

🖼️ 关键图片

📊 实验亮点

LRM-1B在多个VRP变体和规模上取得了SOTA结果,显著优于现有模型。例如,在CVRP20问题上,LRM-1B的平均解长度比现有最佳模型提升了约2%。此外,论文还揭示了模型规模与性能之间的幂律关系,为未来神经路由模型的设计提供了重要指导。实验结果表明,通过扩大模型规模,可以显著提升神经组合优化方法在VRP问题上的性能。

🎯 应用场景

该研究成果可广泛应用于物流配送、交通运输、供应链管理等领域,通过优化车辆行驶路线,降低运输成本,提高效率。大规模路由模型有望解决更复杂、更大规模的实际VRP问题,例如城市物流配送、多车辆协同调度等,具有重要的实际应用价值和经济效益。未来,该技术还可扩展到其他组合优化问题,例如旅行商问题、图着色问题等。

📄 摘要(原文)

Vehicle routing problems (VRPs) are central to combinatorial optimization with significant practical implications. Recent advancements in neural combinatorial optimization (NCO) have demonstrated promising results by leveraging neural networks to solve VRPs, yet the exploration of model scaling within this domain remains underexplored. Inspired by the success of model scaling in large language models (LLMs), this study introduces a Large Routing Model with 1 billion parameters (LRM-1B), designed to address diverse VRP scenarios. We present a comprehensive evaluation of LRM-1B across multiple problem variants, distributions, and sizes, establishing state-of-the-art results. Our findings reveal that LRM-1B not only adapts to different VRP challenges but also showcases superior performance, outperforming existing models. Additionally, we explore the scaling behavior of neural routing models from 1M to 1B parameters. Our analysis confirms power-law between multiple model factors and performance, offering critical insights into the optimal configurations for foundation neural routing solvers.