Dyn-O: Building Structured World Models with Object-Centric Representations

作者: Zizhao Wang, Kaixin Wang, Li Zhao, Peter Stone, Jiang Bian

分类: cs.LG

发布日期: 2025-07-04

💡 一句话要点

Dyn-O:构建基于对象中心表示的结构化世界模型,提升复杂场景泛化能力

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 世界模型 对象中心表示 环境动态 特征解耦 Procgen 强化学习 视觉预测

📋 核心要点

- 现有世界模型在复杂视觉场景中泛化能力不足,尤其是在对象交互驱动的环境动态建模方面。

- Dyn-O 通过学习对象中心表示来构建结构化世界模型,并解耦动态无关和动态相关的特征,以提升泛化能力。

- 实验表明,Dyn-O 在 Procgen 游戏中直接从像素观测学习对象中心世界模型,预测精度优于 DreamerV3。

📝 摘要(中文)

世界模型旨在捕捉环境动态,使智能体能够预测和规划未来状态。在大多数场景中,动态性高度依赖于环境内对象之间的交互。这促使人们开发基于对象中心表示而非单体表示的世界模型,以更有效地捕捉环境动态并增强组合泛化能力。然而,对象中心世界模型的开发主要集中在视觉复杂度有限的环境中(例如基本几何形状)。此类模型是否可以推广到具有多样纹理和杂乱场景的更复杂设置仍未得到充分探索。本文通过引入 Dyn-O 来填补这一空白,Dyn-O 是一种建立在对象中心表示之上的增强型结构化世界模型。与以往的对象中心表示工作相比,Dyn-O 在学习表示和建模动态方面均有所改进。在具有挑战性的 Procgen 游戏中,我们发现我们的方法可以直接从像素观测中学习对象中心世界模型,在 rollout 预测精度方面优于 DreamerV3。此外,通过将对象中心特征解耦为与动态无关和与动态相关的组件,我们能够对这些特征进行更细粒度的操作,并生成更多样化的想象轨迹。

🔬 方法详解

问题定义:现有对象中心世界模型在视觉复杂度有限的环境中表现良好,但在具有多样纹理和杂乱场景的复杂环境中泛化能力不足。现有方法难以有效地从像素观测中提取和利用对象之间的关系,从而限制了模型对环境动态的理解和预测。

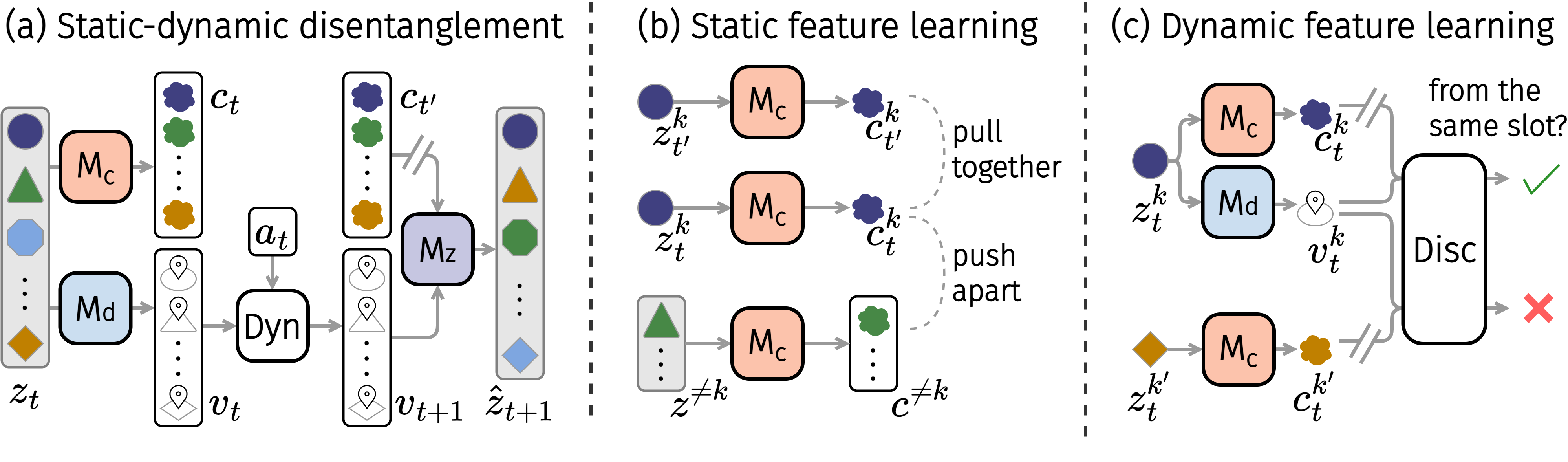

核心思路:Dyn-O 的核心思路是构建一个能够从像素观测中学习对象中心表示的结构化世界模型,并通过解耦对象中心特征为动态无关和动态相关的组件,从而实现对环境动态更细粒度的建模和控制。这种解耦允许模型更好地捕捉对象之间的交互,并生成更多样化的想象轨迹。

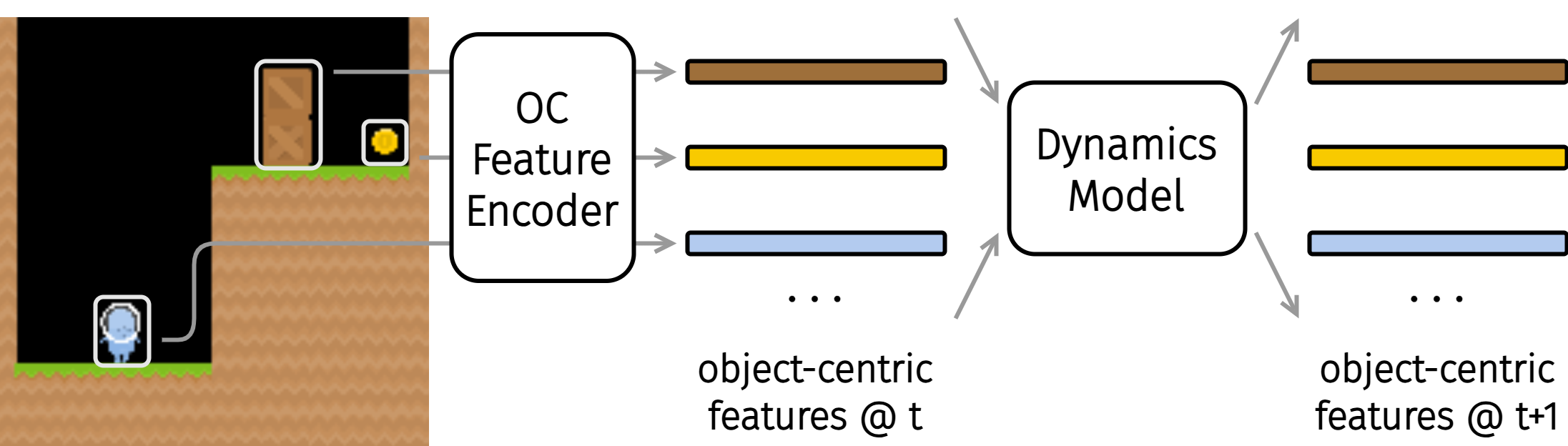

技术框架:Dyn-O 的整体架构包含以下主要模块:1) 对象发现模块:负责从像素观测中提取对象中心表示。2) 动态建模模块:利用提取的对象中心表示来预测环境的未来状态。3) 特征解耦模块:将对象中心特征解耦为动态无关和动态相关的组件。整个流程是从像素观测开始,经过对象发现,然后将对象特征输入到动态建模模块,同时进行特征解耦,最终预测未来状态。

关键创新:Dyn-O 的关键创新在于:1) 提出了一种新的对象中心世界模型,可以直接从像素观测中学习对象中心表示,无需人工标注。2) 引入了特征解耦机制,将对象中心特征解耦为动态无关和动态相关的组件,从而实现对环境动态更细粒度的建模和控制。3) 在复杂视觉场景下,验证了对象中心表示的有效性和泛化能力。

关键设计:在对象发现模块中,使用了基于 Transformer 的架构来提取对象中心表示。在动态建模模块中,使用了循环神经网络(RNN)来建模环境的动态。特征解耦模块使用了变分自编码器(VAE)来实现特征的解耦。损失函数包括重构损失、预测损失和解耦损失。具体的参数设置和网络结构细节在论文中有详细描述。

🖼️ 关键图片

📊 实验亮点

Dyn-O 在 Procgen 游戏中表现出色,直接从像素观测中学习对象中心世界模型,并在 rollout 预测精度方面优于 DreamerV3。实验结果表明,Dyn-O 能够有效地捕捉环境动态,并生成更多样化的想象轨迹。与基线方法相比,Dyn-O 在复杂视觉场景中具有更强的泛化能力。

🎯 应用场景

Dyn-O 的潜在应用领域包括机器人导航、游戏 AI、自动驾驶等。通过学习环境的动态模型,智能体可以更好地理解和预测环境的变化,从而做出更明智的决策。该研究的实际价值在于提高了智能体在复杂环境中的适应性和泛化能力。未来,该技术可以应用于更广泛的领域,例如虚拟现实、增强现实等。

📄 摘要(原文)

World models aim to capture the dynamics of the environment, enabling agents to predict and plan for future states. In most scenarios of interest, the dynamics are highly centered on interactions among objects within the environment. This motivates the development of world models that operate on object-centric rather than monolithic representations, with the goal of more effectively capturing environment dynamics and enhancing compositional generalization. However, the development of object-centric world models has largely been explored in environments with limited visual complexity (such as basic geometries). It remains underexplored whether such models can generalize to more complex settings with diverse textures and cluttered scenes. In this paper, we fill this gap by introducing Dyn-O, an enhanced structured world model built upon object-centric representations. Compared to prior work in object-centric representations, Dyn-O improves in both learning representations and modeling dynamics. On the challenging Procgen games, we find that our method can learn object-centric world models directly from pixel observations, outperforming DreamerV3 in rollout prediction accuracy. Furthermore, by decoupling object-centric features into dynamics-agnostic and dynamics-aware components, we enable finer-grained manipulation of these features and generate more diverse imagined trajectories.