Improving Consistency in Vehicle Trajectory Prediction Through Preference Optimization

作者: Caio Azevedo, Lina Achaji, Stefano Sabatini, Nicola Poerio, Grzegorz Bartyzel, Sascha Hornauer, Fabien Moutarde

分类: cs.LG

发布日期: 2025-07-03

备注: Accepted for publication at ITSC 2025

💡 一句话要点

通过偏好优化提升车辆轨迹预测中的一致性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 轨迹预测 偏好优化 场景一致性 多智能体交互 自动驾驶

📋 核心要点

- 现有轨迹预测模型在复杂交互场景中难以捕捉智能体间的依赖关系,导致预测不一致。

- 该论文利用偏好优化,通过学习智能体间的偏好关系来提升轨迹预测的一致性。

- 实验表明,该方法在多个数据集上显著提升了场景一致性,且对预测精度影响很小。

📝 摘要(中文)

轨迹预测是自动驾驶车辆流程中的关键步骤。不准确或不一致的预测会导致规划不佳的操作,并可能对最终用户造成危险。目前最先进的基于深度学习的轨迹预测模型可以在公共数据集上实现出色的准确性。然而,在更复杂的交互场景中使用时,它们常常无法捕捉到智能体之间重要的相互依赖关系,导致交通场景中智能体之间的预测不一致。受将人类偏好融入大型语言模型的有效性的启发,本研究使用偏好优化在多智能体环境中微调轨迹预测模型。通过将自动计算的预测未来偏好排序作为微调过程的输入,我们的实验——使用最先进的模型在三个独立的数据集上——表明我们能够在最小程度牺牲轨迹预测准确性的同时,显著提高场景一致性,并且不会增加推理时的额外计算需求。

🔬 方法详解

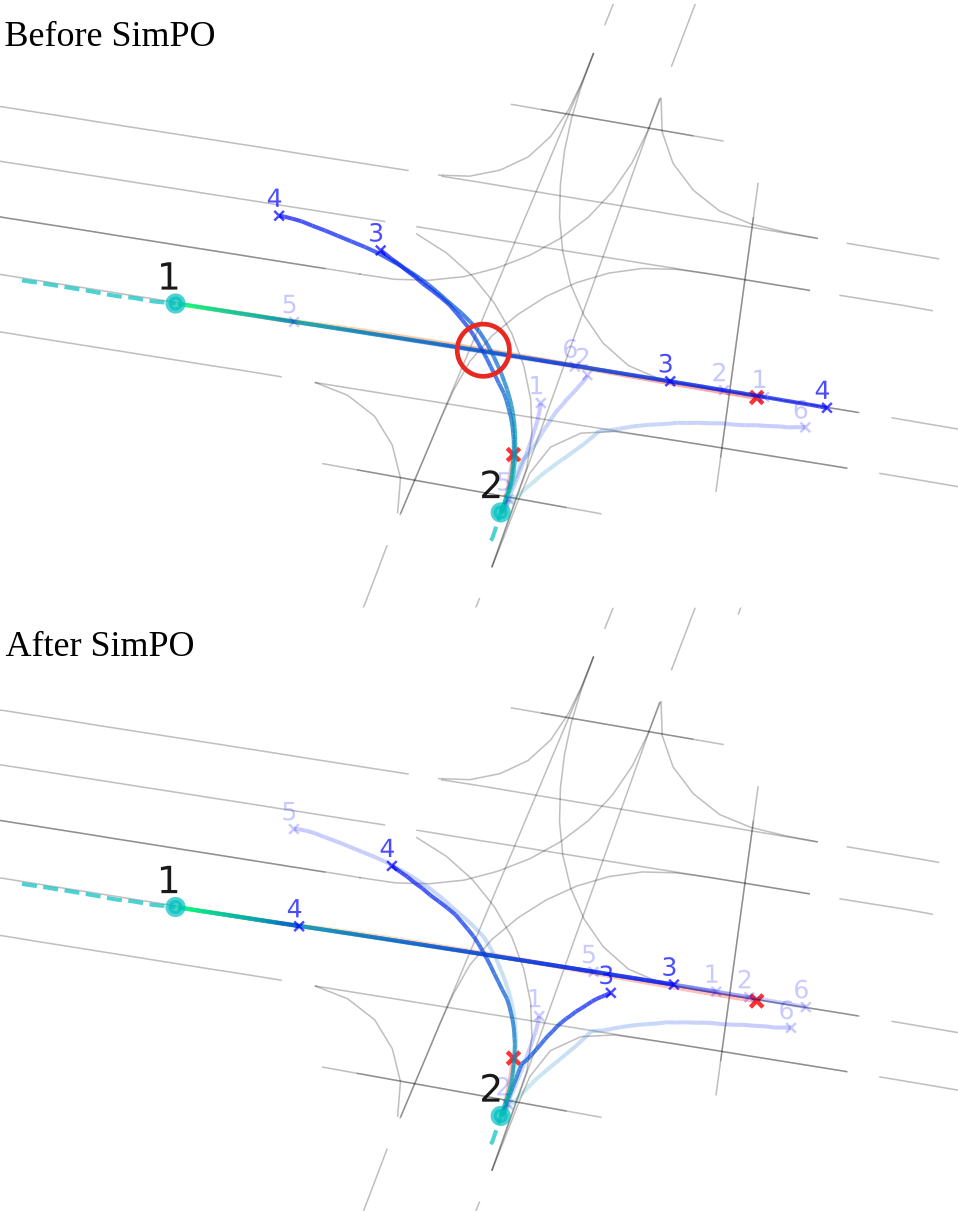

问题定义:现有轨迹预测模型在多智能体交互场景中,难以保证预测轨迹的一致性。例如,如果预测车辆A向左变道,而车辆B的预测轨迹没有相应调整,则可能出现碰撞,导致预测结果不合理。现有方法通常关注个体轨迹的准确性,忽略了场景中智能体之间的相互影响,缺乏对场景一致性的建模。

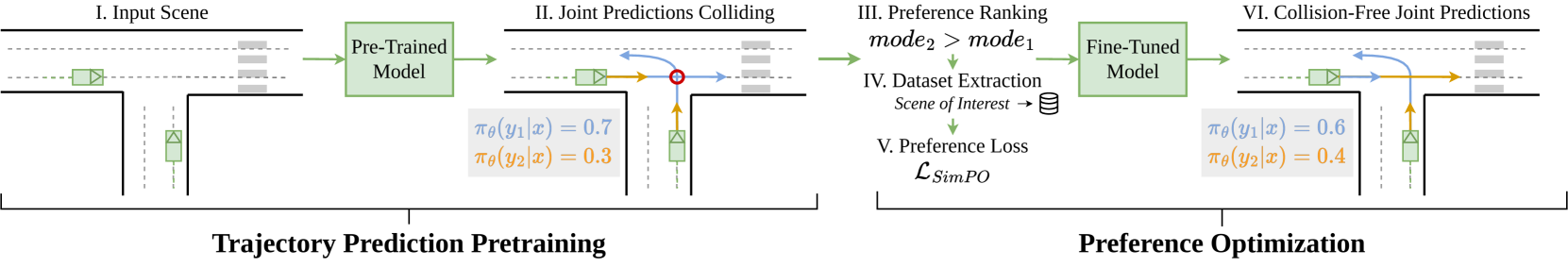

核心思路:该论文借鉴了人类偏好学习的思想,通过学习智能体之间的偏好关系来提高轨迹预测的一致性。核心思想是,如果一个预测场景更符合智能体之间的交互规则(例如,避免碰撞),那么这个场景应该被赋予更高的偏好。通过优化模型,使其预测结果更符合这些偏好,从而提高场景一致性。

技术框架:该方法主要分为两个阶段:首先,使用现有的轨迹预测模型生成多个可能的未来轨迹;然后,利用偏好优化方法对这些轨迹进行排序,选择最符合场景一致性的轨迹。具体来说,该方法首先使用轨迹预测模型生成K个可能的未来轨迹,然后使用一个偏好模型对这些轨迹进行排序。偏好模型的目标是学习一个函数,该函数可以根据轨迹的场景一致性程度对其进行评分。最后,使用排序损失函数来训练轨迹预测模型,使其生成的轨迹更符合偏好模型的排序结果。

关键创新:该论文的关键创新在于将偏好优化引入到轨迹预测任务中,通过学习智能体之间的偏好关系来提高场景一致性。与现有方法相比,该方法不需要显式地建模智能体之间的交互规则,而是通过学习数据中的偏好关系来隐式地建模这些规则。这种方法更加灵活,可以适应不同的交通场景。

关键设计:该论文的关键设计包括:1) 偏好模型的选择:可以使用各种模型,例如神经网络或决策树,来学习偏好关系。2) 排序损失函数的选择:可以使用各种排序损失函数,例如pairwise ranking loss或listwise ranking loss,来训练轨迹预测模型。3) 偏好数据的生成:可以使用各种方法来生成偏好数据,例如人工标注或自动生成。论文中使用自动计算的偏好排序,避免了人工标注的成本。

🖼️ 关键图片

📊 实验亮点

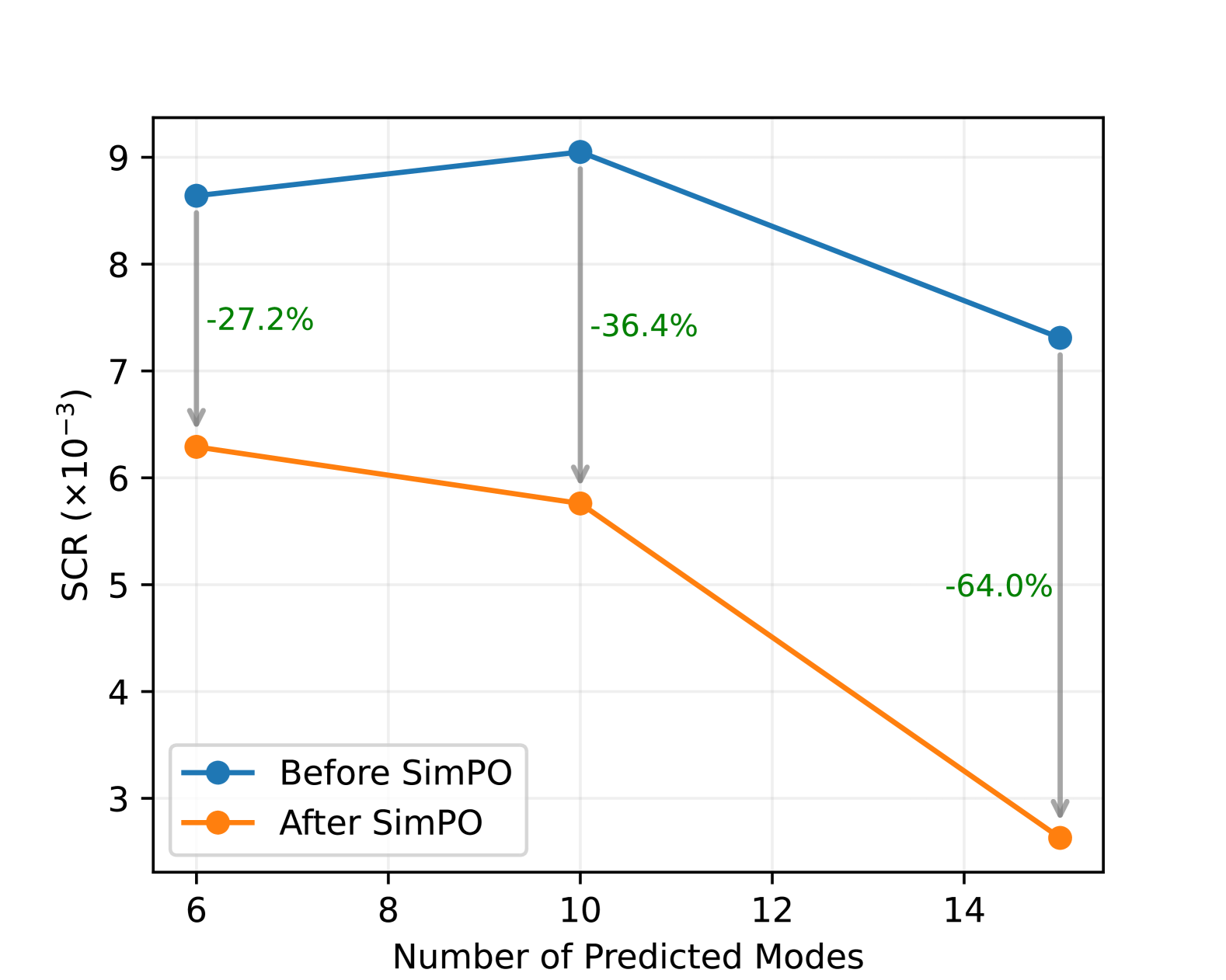

实验结果表明,该方法在三个数据集上显著提高了场景一致性,同时对轨迹预测准确性的影响很小。具体而言,该方法在场景一致性指标上取得了显著提升,同时保持了与基线模型相当的轨迹预测精度。该方法无需增加推理时的计算量,易于部署。

🎯 应用场景

该研究成果可应用于自动驾驶、高级驾驶辅助系统(ADAS)等领域,提升车辆在复杂交通环境中的决策能力和安全性。通过提高轨迹预测的一致性,可以减少潜在的碰撞风险,改善交通流效率,并为自动驾驶车辆提供更可靠的环境感知。

📄 摘要(原文)

Trajectory prediction is an essential step in the pipeline of an autonomous vehicle. Inaccurate or inconsistent predictions regarding the movement of agents in its surroundings lead to poorly planned maneuvers and potentially dangerous situations for the end-user. Current state-of-the-art deep-learning-based trajectory prediction models can achieve excellent accuracy on public datasets. However, when used in more complex, interactive scenarios, they often fail to capture important interdependencies between agents, leading to inconsistent predictions among agents in the traffic scene. Inspired by the efficacy of incorporating human preference into large language models, this work fine-tunes trajectory prediction models in multi-agent settings using preference optimization. By taking as input automatically calculated preference rankings among predicted futures in the fine-tuning process, our experiments--using state-of-the-art models on three separate datasets--show that we are able to significantly improve scene consistency while minimally sacrificing trajectory prediction accuracy and without adding any excess computational requirements at inference time.