Deep Reinforcement Learning-Based DRAM Equalizer Parameter Optimization Using Latent Representations

作者: Muhammad Usama, Dong Eui Chang

分类: cs.LG

发布日期: 2025-07-03

💡 一句话要点

提出基于深度强化学习的DRAM均衡器参数优化方法,提升信号完整性。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 深度强化学习 DRAM 均衡器 信号完整性 潜在表示

📋 核心要点

- 高速DRAM系统中均衡器参数优化面临计算量大或依赖精确模型的挑战。

- 利用学习到的潜在信号表示进行快速信号完整性评估,并用强化学习智能体优化参数。

- 实验表明,该方法在DRAM波形上显著提升了眼图张开窗口面积,优于现有技术。

📝 摘要(中文)

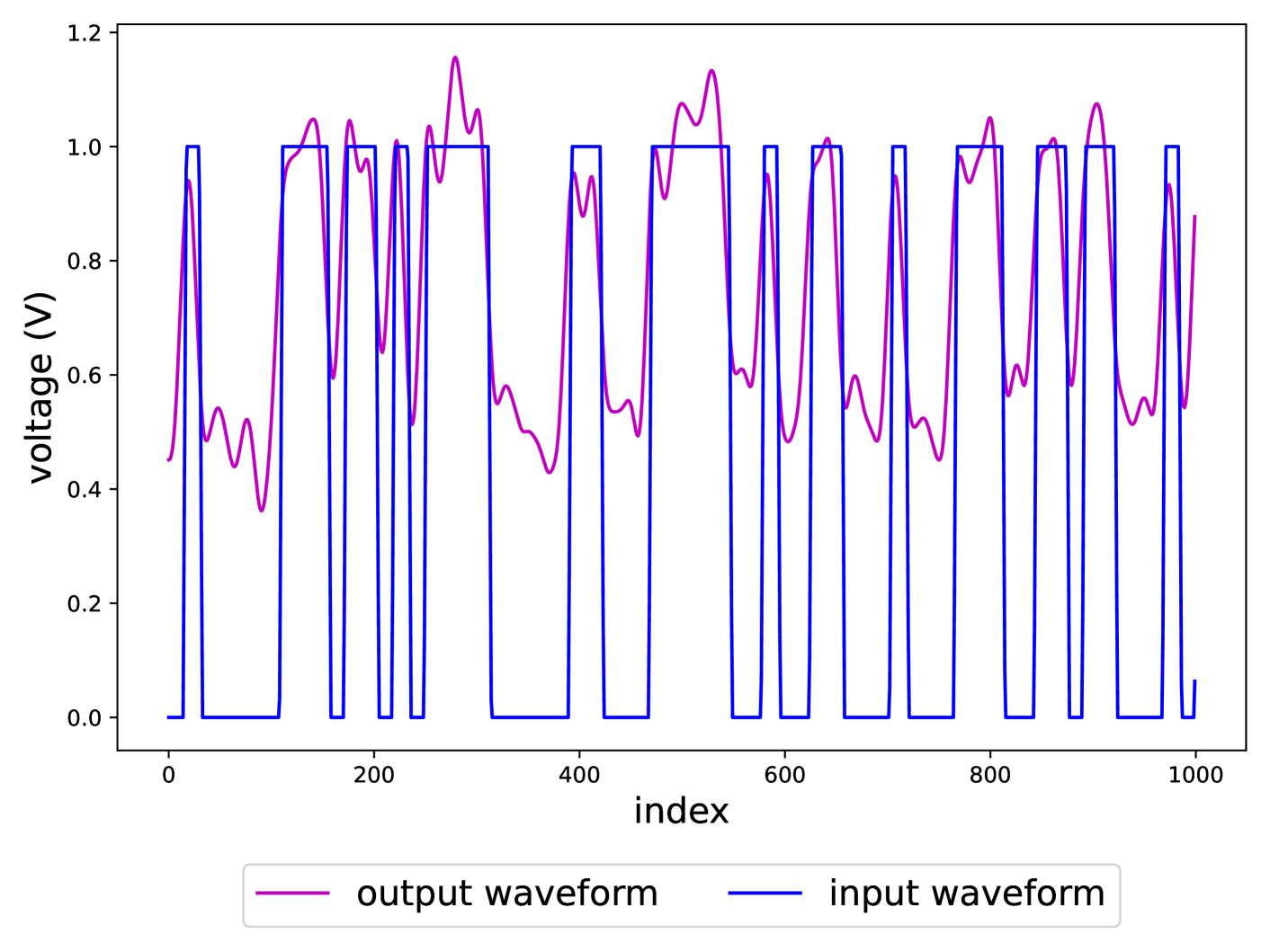

本文提出了一种数据驱动的框架,该框架利用学习到的潜在信号表示进行高效的信号完整性评估,并结合无模型的Advantage Actor-Critic强化学习智能体进行参数优化,以解决高速动态随机存取存储器(DRAM)系统中信号完整性的均衡器参数优化问题。潜在表示捕捉了重要的信号完整性特征,为优化期间的直接眼图分析提供了一种快速替代方案,而强化学习智能体无需显式系统模型即可获得最佳均衡器设置。该方法应用于工业标准的DRAM波形,实现了显著的眼图张开窗口面积改进:级联连续时间线性均衡器和判决反馈均衡器结构提高了42.7%,仅判决反馈均衡器配置提高了36.8%。结果表明,与现有技术相比,该方法在各种DRAM单元中具有卓越的性能、计算效率和强大的泛化能力。核心贡献包括用于优化的有效潜在信号完整性度量、强大的无模型强化学习策略以及针对复杂均衡器架构的验证的卓越性能。

🔬 方法详解

问题定义:论文旨在解决高速DRAM系统中均衡器参数优化的问题。现有方法要么计算量大,需要耗费大量时间进行仿真和优化;要么依赖于精确的系统模型,而建立精确模型往往非常困难,且模型一旦有偏差,优化结果就会受到影响。因此,需要一种高效且无需精确模型的方法来优化均衡器参数,以提升信号完整性。

核心思路:论文的核心思路是利用深度学习学习信号的潜在表示,该潜在表示能够捕捉信号完整性的关键特征,从而可以快速评估信号质量。然后,使用强化学习算法,以潜在表示作为状态,均衡器参数作为动作,训练一个智能体来自动优化均衡器参数,最大化信号完整性。这种方法避免了直接进行耗时的眼图分析,也无需建立精确的系统模型。

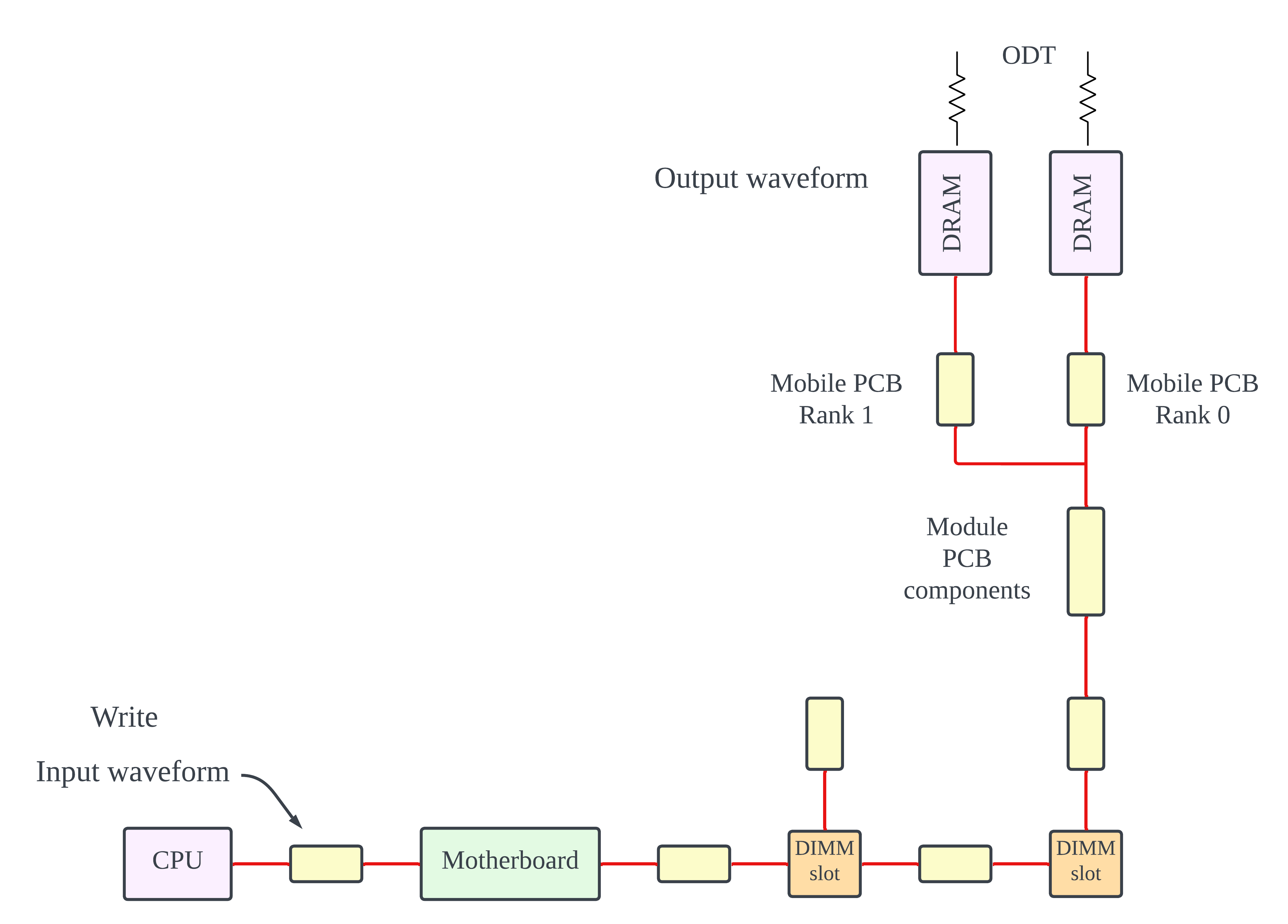

技术框架:整体框架包含两个主要模块:潜在表示学习模块和强化学习优化模块。首先,使用自编码器等深度学习模型学习信号的潜在表示,该潜在表示能够反映信号的眼图张开程度等关键指标。然后,使用Advantage Actor-Critic (A2C) 等强化学习算法,以潜在表示作为状态输入,均衡器参数作为动作,训练一个智能体。智能体的目标是最大化奖励,奖励函数与眼图张开程度相关,鼓励智能体选择能够改善信号完整性的均衡器参数。

关键创新:论文的关键创新在于将深度学习和强化学习相结合,提出了一种数据驱动的均衡器参数优化方法。与传统方法相比,该方法无需建立精确的系统模型,也避免了耗时的眼图分析,从而大大提高了优化效率。此外,使用潜在表示作为强化学习的状态,能够有效地提取信号的关键特征,提高强化学习的性能。

关键设计:在潜在表示学习模块中,可以使用卷积自编码器等网络结构,损失函数可以选择均方误差等。在强化学习模块中,使用A2C算法,奖励函数可以设计为与眼图张开窗口面积成正比的函数。均衡器参数的范围需要根据实际情况进行设置。此外,为了提高泛化能力,可以使用数据增强等技术。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在工业标准的DRAM波形上取得了显著的眼图张开窗口面积改进。对于级联的CTLE-DFE结构,眼图张开窗口面积提高了42.7%;对于仅DFE结构,提高了36.8%。这些结果表明,与现有技术相比,该方法具有卓越的性能和计算效率。

🎯 应用场景

该研究成果可应用于高速DRAM系统的设计和优化,提高存储器的性能和可靠性。通过自动优化均衡器参数,可以降低系统调试的难度和成本,缩短产品上市时间。此外,该方法还可以推广到其他高速信号传输系统的信号完整性优化问题中。

📄 摘要(原文)

Equalizer parameter optimization for signal integrity in high-speed Dynamic Random Access Memory systems is crucial but often computationally demanding or model-reliant. This paper introduces a data-driven framework employing learned latent signal representations for efficient signal integrity evaluation, coupled with a model-free Advantage Actor-Critic reinforcement learning agent for parameter optimization. The latent representation captures vital signal integrity features, offering a fast alternative to direct eye diagram analysis during optimization, while the reinforcement learning agent derives optimal equalizer settings without explicit system models. Applied to industry-standard Dynamic Random Access Memory waveforms, the method achieved significant eye-opening window area improvements: 42.7\% for cascaded Continuous-Time Linear Equalizer and Decision Feedback Equalizer structures, and 36.8\% for Decision Feedback Equalizer-only configurations. These results demonstrate superior performance, computational efficiency, and robust generalization across diverse Dynamic Random Access Memory units compared to existing techniques. Core contributions include an efficient latent signal integrity metric for optimization, a robust model-free reinforcement learning strategy, and validated superior performance for complex equalizer architectures.