BEST-Route: Adaptive LLM Routing with Test-Time Optimal Compute

作者: Dujian Ding, Ankur Mallick, Shaokun Zhang, Chi Wang, Daniel Madrigal, Mirian Del Carmen Hipolito Garcia, Menglin Xia, Laks V. S. Lakshmanan, Qingyun Wu, Victor Rühle

分类: cs.LG, cs.AI, cs.CL, cs.DB

发布日期: 2025-06-28

备注: Accepted to ICML 2025 (main conference)

💡 一句话要点

BEST-Route:基于测试时最优计算的自适应LLM路由框架

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: LLM路由 自适应计算 成本优化 多响应选择 查询难度评估

📋 核心要点

- 现有LLM查询路由方法通常只生成单个响应,小型模型难以匹敌大型模型,导致成本节省潜力受限。

- BEST-Route框架根据查询难度和质量阈值,自适应选择模型和采样响应数量,实现成本与性能的平衡。

- 实验表明,BEST-Route在真实数据集上能显著降低成本(高达60%),同时保持性能(性能下降小于1%)。

📝 摘要(中文)

大型语言模型(LLM)功能强大,但大规模部署成本高昂。LLM查询路由通过动态地将查询分配给不同成本和质量的模型来缓解这个问题,从而获得期望的权衡。先前的查询路由方法仅从所选模型生成一个响应,而来自小型(廉价)模型的单个响应通常不足以胜过来自大型(昂贵)模型的响应,导致过度使用大型模型并错失潜在的成本节省。然而,众所周知,对于小型模型,生成多个响应并选择最佳响应可以提高质量,同时保持比单个大型模型响应更低的成本。我们利用这一思想提出了BEST-Route,这是一种新颖的路由框架,它基于查询难度和质量阈值来选择模型以及从中采样的响应数量。在真实世界数据集上的实验表明,我们的方法可降低高达60%的成本,而性能下降不到1%。

🔬 方法详解

问题定义:论文旨在解决大规模部署LLM时,如何在保证性能的前提下,降低计算成本的问题。现有的LLM查询路由方法通常只选择一个模型并生成单个响应,这使得小型模型的潜力无法充分发挥,导致大型模型被过度使用,成本居高不下。

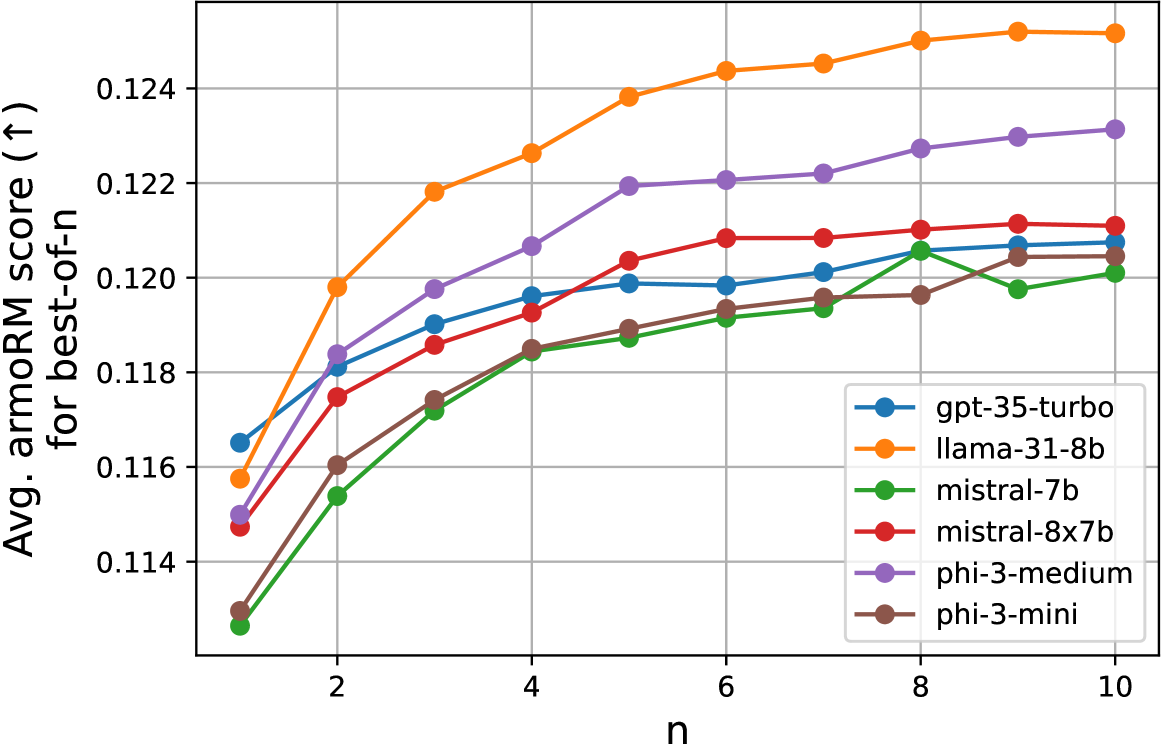

核心思路:论文的核心思路是,对于小型模型,可以通过生成多个响应并选择最佳响应的方式来提高质量,同时保持比单个大型模型响应更低的成本。因此,论文提出了一种自适应的路由框架,可以根据查询的难度和质量要求,动态地选择合适的模型以及生成响应的数量。

技术框架:BEST-Route框架包含以下几个主要模块:1) 查询难度评估模块:评估输入查询的难度,用于后续的模型选择和响应数量确定。2) 模型选择模块:根据查询难度和预设的质量阈值,选择合适的LLM模型。3) 响应生成模块:根据选择的模型和查询难度,确定生成响应的数量,并从模型中采样生成多个响应。4) 响应选择模块:从生成的多个响应中选择最佳响应,作为最终输出。

关键创新:该论文的关键创新在于提出了一个自适应的LLM路由框架,该框架可以根据查询难度和质量阈值,动态地选择模型和生成响应的数量。这种方法充分利用了小型模型的潜力,通过生成多个响应并选择最佳响应的方式,提高了小型模型的性能,从而降低了整体的计算成本。与现有方法相比,BEST-Route能够更有效地平衡成本和性能。

关键设计:BEST-Route的关键设计包括:1) 查询难度评估方法:可以使用各种文本复杂度度量或模型预测置信度作为查询难度的指标。2) 响应选择策略:可以使用各种排序模型或基于规则的方法来选择最佳响应。3) 成本-效益权衡策略:需要仔细设计模型选择和响应数量的策略,以在成本和性能之间取得最佳平衡。具体的损失函数和网络结构的选择取决于具体的应用场景和数据集。

🖼️ 关键图片

📊 实验亮点

实验结果表明,BEST-Route在真实世界数据集上能够显著降低成本,最高可达60%,同时性能下降小于1%。这表明BEST-Route能够有效地平衡成本和性能,为LLM的大规模部署提供了一种可行的解决方案。与传统的查询路由方法相比,BEST-Route具有明显的优势。

🎯 应用场景

BEST-Route适用于各种需要大规模部署LLM的应用场景,例如智能客服、机器翻译、文本摘要等。通过自适应地选择模型和生成响应的数量,BEST-Route可以显著降低计算成本,提高部署效率,使得LLM能够更广泛地应用于各种实际场景中。该研究对于推动LLM的普及和应用具有重要意义。

📄 摘要(原文)

Large language models (LLMs) are powerful tools but are often expensive to deploy at scale. LLM query routing mitigates this by dynamically assigning queries to models of varying cost and quality to obtain a desired trade-off. Prior query routing approaches generate only one response from the selected model and a single response from a small (inexpensive) model was often not good enough to beat a response from a large (expensive) model due to which they end up overusing the large model and missing out on potential cost savings. However, it is well known that for small models, generating multiple responses and selecting the best can enhance quality while remaining cheaper than a single large-model response. We leverage this idea to propose BEST-Route, a novel routing framework that chooses a model and the number of responses to sample from it based on query difficulty and the quality thresholds. Experiments on real-world datasets demonstrate that our method reduces costs by up to 60% with less than 1% performance drop.