Accelerating Residual Reinforcement Learning with Uncertainty Estimation

作者: Lakshita Dodeja, Karl Schmeckpeper, Shivam Vats, Thomas Weng, Mingxi Jia, George Konidaris, Stefanie Tellex

分类: cs.LG, cs.AI, cs.RO

发布日期: 2025-06-21

💡 一句话要点

利用不确定性估计加速残差强化学习,提升样本效率并支持随机策略。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 残差强化学习 不确定性估计 离策略学习 随机策略 样本效率

📋 核心要点

- 现有残差强化学习方法在稀疏奖励和处理随机基础策略方面存在不足,限制了其应用范围。

- 该论文利用基础策略的不确定性估计引导探索,并改进离策略学习以适应随机基础策略。

- 实验表明,该方法在模拟环境中显著优于现有方法,并在真实世界中实现了零样本迁移。

📝 摘要(中文)

残差强化学习(Residual RL)是一种通过学习轻量级的残差策略来调整预训练策略的常用方法,该残差策略提供修正动作。虽然残差强化学习比微调整个基础策略更具样本效率,但现有方法在稀疏奖励方面存在困难,并且是为确定性基础策略设计的。我们提出了对残差强化学习的两项改进,进一步提高了其样本效率,并使其适用于随机基础策略。首先,我们利用基础策略的不确定性估计来集中探索基础策略不确定的区域。其次,我们对离策略残差学习进行了一个简单的修改,使其能够观察基础动作并更好地处理随机基础策略。我们在来自Robosuite和D4RL的任务上,使用基于高斯和基于扩散的随机基础策略评估了我们的方法,并与最先进的微调方法、演示增强的强化学习方法和其他残差强化学习方法进行了比较。我们的算法在各种模拟基准环境中显著优于现有的基线。我们还在现实世界中部署了我们学习到的策略,以展示它们在零样本sim-to-real迁移中的鲁棒性。

🔬 方法详解

问题定义:论文旨在解决残差强化学习在处理稀疏奖励和随机基础策略时的局限性。现有的残差强化学习方法通常假设基础策略是确定性的,并且在奖励稀疏的环境中难以有效探索。这限制了残差强化学习在更广泛和更具挑战性的任务中的应用。

核心思路:论文的核心思路是利用基础策略的不确定性估计来指导探索,并改进离策略学习算法以更好地处理随机基础策略。通过关注基础策略不确定的区域,可以更有效地探索有潜力的状态空间。同时,通过观察基础动作,可以更准确地估计残差策略的价值函数。

技术框架:该方法包含两个主要改进:1) 基于不确定性的探索:利用基础策略的不确定性估计来指导探索,例如使用高斯过程或扩散模型来估计不确定性。在训练过程中,优先探索基础策略不确定的区域。2) 改进的离策略残差学习:修改离策略残差学习算法,使其能够观察基础动作。这可以通过在价值函数的估计中考虑基础动作来实现,从而更准确地估计残差策略的价值。

关键创新:该论文的关键创新在于将不确定性估计与离策略残差学习相结合,从而提高了样本效率并使其能够处理随机基础策略。与现有方法相比,该方法能够更有效地探索状态空间,并更准确地估计残差策略的价值函数。

关键设计:在基于不确定性的探索中,可以使用不同的不确定性估计方法,例如高斯过程或扩散模型。在改进的离策略残差学习中,可以通过在价值函数的估计中添加一个项来考虑基础动作,例如使用以下公式:Q(s, a) = Q_base(s, a_base) + Q_residual(s, a),其中Q_base是基础策略的价值函数,Q_residual是残差策略的价值函数,a_base是基础策略的动作,a是残差策略的动作。

🖼️ 关键图片

📊 实验亮点

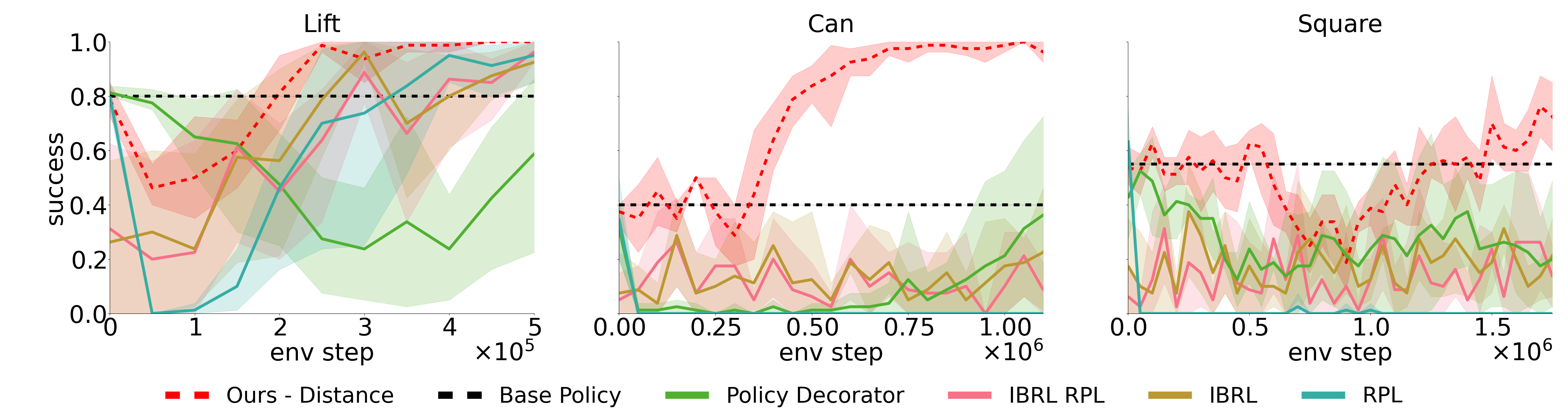

该论文在Robosuite和D4RL等模拟环境中进行了实验,并与最先进的微调方法、演示增强的强化学习方法和其他残差强化学习方法进行了比较。实验结果表明,该方法在各种模拟基准环境中显著优于现有的基线。此外,该方法还在真实世界中进行了部署,并成功实现了零样本sim-to-real迁移,验证了其鲁棒性。

🎯 应用场景

该研究成果可应用于机器人控制、自动驾驶等领域,尤其是在需要利用预训练策略并进行快速适应的场景中。通过提高残差强化学习的样本效率和鲁棒性,可以降低训练成本,并使其能够应用于更复杂的任务。该方法在真实世界的零样本迁移能力也使其具有很高的实际应用价值。

📄 摘要(原文)

Residual Reinforcement Learning (RL) is a popular approach for adapting pretrained policies by learning a lightweight residual policy that provides corrective actions. While Residual RL is more sample-efficient than finetuning the entire base policy, existing methods struggle with sparse rewards and are designed for deterministic base policies. We propose two improvements to Residual RL that further enhance its sample efficiency and make it suitable for stochastic base policies. First, we leverage uncertainty estimates of the base policy to focus exploration on regions in which the base policy is not confident. Second, we propose a simple modification to off-policy residual learning that allows it to observe base actions and better handle stochastic base policies. We evaluate our method with both Gaussian-based and Diffusion-based stochastic base policies on tasks from Robosuite and D4RL, and compare against state-of-the-art finetuning methods, demo-augmented RL methods, and other residual RL methods. Our algorithm significantly outperforms existing baselines in a variety of simulation benchmark environments. We also deploy our learned polices in the real world to demonstrate their robustness with zero-shot sim-to-real transfer.