Caterpillar GNN: Replacing Message Passing with Efficient Aggregation

作者: Marek Černý

分类: cs.LG

发布日期: 2025-06-07 (更新: 2025-09-26)

备注: 35 pages, 13 figures, 3 tables, preprint in review

💡 一句话要点

提出Caterpillar GNN,通过高效聚合替代消息传递,提升图神经网络性能。

🎯 匹配领域: 支柱五:交互与反应 (Interaction & Reaction)

关键词: 图神经网络 消息传递 图学习 高效聚合 归纳偏置

📋 核心要点

- 现有MPGNNs依赖于邻接关系的聚合,表达能力受限,且计算复杂度较高。

- Caterpillar GNN通过walk incidence矩阵进行高效聚合,在表达能力和归纳偏置间取得平衡。

- 实验表明,Caterpillar GNN在特定基准测试中表现出色,并在真实数据集上实现了性能与效率的提升。

📝 摘要(中文)

消息传递图神经网络(MPGNNs)在现代图学习中占据主导地位。通常的研究工作通过丰富基于邻接关系的聚合来增强MPGNN的表达能力。与此相反,我们引入了一种基于walk incidence矩阵的高效聚合,该矩阵的构建旨在权衡一定的表达能力,以换取更强和更结构化的归纳偏置。我们的方法允许在经典消息传递和基于walk的更简单方法之间无缝扩展。我们使用广义毛毛虫图层次结构上的同态计数,严格地表征了每个中间步骤的表达能力。基于此基础,我们提出了Caterpillar GNN,其强大的图级聚合成功地解决了专门设计用于挑战MPGNN的基准。此外,我们证明了在真实世界的数据集上,Caterpillar GNN实现了可比的预测性能,同时显著减少了计算图隐藏层中的节点数量。

🔬 方法详解

问题定义:现有消息传递图神经网络(MPGNNs)在图学习任务中面临表达能力和计算效率的挑战。它们通常依赖于基于邻接关系的局部聚合,这限制了它们捕获长距离依赖关系和复杂图结构的能力。此外,为了增强表达能力,通常需要增加消息传递的轮数或使用更复杂的聚合函数,这会导致计算成本显著增加。因此,如何在保持或提高表达能力的同时,降低计算复杂度是当前MPGNNs研究的一个重要问题。

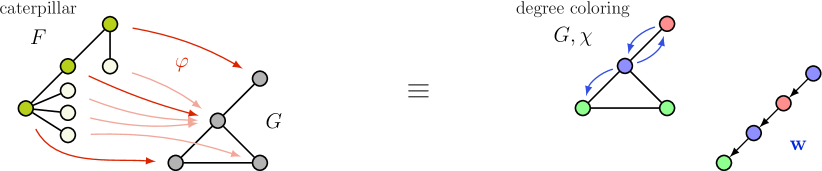

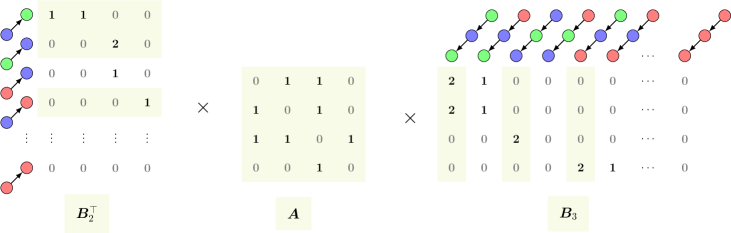

核心思路:Caterpillar GNN的核心思路是通过引入基于walk incidence矩阵的高效聚合来替代传统的消息传递机制。这种方法旨在通过权衡一定的表达能力,换取更强和更结构化的归纳偏置。具体来说,它利用图中的walk信息,允许模型捕获节点之间的长距离依赖关系,而无需进行多轮消息传递。通过精心设计的walk incidence矩阵,模型可以在计算效率和表达能力之间取得更好的平衡。

技术框架:Caterpillar GNN的整体框架包括以下几个主要步骤:1) 构建walk incidence矩阵:根据预定义的walk长度和策略,生成描述图中节点之间walk关系的矩阵。2) 特征聚合:使用walk incidence矩阵对节点特征进行聚合,得到新的节点表示。3) 图级聚合:将节点表示聚合为图级别的表示,用于图分类或回归等任务。4) 模型训练:使用适当的损失函数和优化器训练模型,使其能够学习到有效的图表示。

关键创新:Caterpillar GNN最重要的技术创新点在于使用walk incidence矩阵进行高效聚合,替代了传统的消息传递机制。与MPGNNs相比,Caterpillar GNN不需要进行多轮消息传递,从而显著降低了计算复杂度。此外,通过精心设计的walk incidence矩阵,Caterpillar GNN可以在表达能力和归纳偏置之间取得更好的平衡。

关键设计:Caterpillar GNN的关键设计包括:1) Walk长度的选择:walk长度决定了模型能够捕获的节点之间的最远距离。较长的walk长度可以捕获更长的依赖关系,但也可能增加计算复杂度。2) Walk策略的选择:不同的walk策略(如随机walk、最短路径walk等)会影响walk incidence矩阵的结构和模型的性能。3) 聚合函数的选择:聚合函数用于将节点特征聚合为图级别的表示。常用的聚合函数包括求和、平均、最大值等。4) 损失函数的选择:损失函数用于衡量模型的预测结果与真实标签之间的差异。常用的损失函数包括交叉熵损失、均方误差损失等。

🖼️ 关键图片

📊 实验亮点

Caterpillar GNN在专门设计用于挑战MPGNN的基准测试中表现出色,证明了其强大的图级聚合能力。在真实世界的数据集上,Caterpillar GNN实现了与MPGNNs相当的预测性能,同时显著减少了计算图隐藏层中的节点数量,从而提高了计算效率。具体性能数据和提升幅度在论文中有详细展示。

🎯 应用场景

Caterpillar GNN具有广泛的应用前景,包括但不限于:分子性质预测、社交网络分析、推荐系统、知识图谱推理等。其高效的聚合机制使其能够处理大规模图数据,并在资源受限的环境中部署。未来,该方法可以进一步扩展到动态图、异构图等更复杂的图结构,为图学习领域的发展做出贡献。

📄 摘要(原文)

Message-passing graph neural networks (MPGNNs) dominate modern graph learning. Typical efforts enhance MPGNN's expressive power by enriching the adjacency-based aggregation. In contrast, we introduce an efficient aggregation over walk incidence-based matrices that are constructed to deliberately trade off some expressivity for stronger and more structured inductive bias. Our approach allows for seamless scaling between classical message-passing and simpler methods based on walks. We rigorously characterize the expressive power at each intermediate step using homomorphism counts over a hierarchy of generalized caterpillar graphs. Based on this foundation, we propose Caterpillar GNNs, whose robust graph-level aggregation successfully tackles a benchmark specifically designed to challenge MPGNNs. Moreover, we demonstrate that, on real-world datasets, Caterpillar GNNs achieve comparable predictive performance while significantly reducing the number of nodes in the hidden layers of the computational graph.