Uni-LoRA: One Vector is All You Need

作者: Kaiyang Li, Shaobo Han, Qing Su, Wei Li, Zhipeng Cai, Shihao Ji

分类: cs.LG

发布日期: 2025-06-01 (更新: 2025-10-28)

备注: NeurIPS 2025 Spotlight

🔗 代码/项目: GITHUB

💡 一句话要点

Uni-LoRA:提出一种单向量LoRA统一框架,实现极致参数高效的LLM微调。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 参数高效微调 低秩适应 大型语言模型 统一框架 单向量 全局参数共享 等距投影 模型压缩

📋 核心要点

- 现有LoRA变体依赖层级或结构特定投影,限制跨层参数共享,降低参数效率。

- Uni-LoRA通过统一框架,利用单向量投影重建LoRA参数,实现全局参数共享。

- 实验表明,Uni-LoRA在参数效率上达到SOTA,并在多个任务中性能优于或匹配现有方法。

📝 摘要(中文)

低秩适应(LoRA)已成为大型语言模型(LLM)参数高效微调(PEFT)的事实标准,它将权重更新限制在低秩矩阵内。最近的研究,如Tied-LoRA、VeRA和VB-LoRA,通过引入额外的约束来减少可训练参数空间,进一步提高了效率。本文表明,这些LoRA变体采用的参数空间缩减策略可以在一个统一的框架Uni-LoRA中进行公式化,其中LoRA参数空间(扁平化为高维向量空间R^D)可以通过从子空间R^d的投影来重建,其中d << D。我们证明了各种LoRA方法之间的根本区别在于投影矩阵P ∈ R^(D×d)的选择。大多数现有的LoRA变体依赖于层级或结构特定的投影,这限制了跨层参数共享,从而降低了参数效率。鉴于此,我们引入了一种高效且理论上合理的等距投影矩阵,能够实现全局参数共享并减少计算开销。此外,在Uni-LoRA的统一视角下,这种设计只需要一个可训练向量来重建整个LLM的LoRA参数——使Uni-LoRA既是一个统一的框架,也是一个“仅需单向量”的解决方案。在GLUE、数学推理和指令调优基准上的大量实验表明,Uni-LoRA实现了最先进的参数效率,同时在预测性能方面优于或匹配了先前的方法。

🔬 方法详解

问题定义:现有LoRA方法及其变体,如Tied-LoRA、VeRA、VB-LoRA等,虽然通过约束权重更新矩阵的秩来减少可训练参数,但它们通常采用层级或结构特定的投影方式。这种方式限制了跨层参数的共享,导致参数效率降低,并且需要维护多个独立的LoRA模块。因此,如何进一步提升LoRA的参数效率,实现更紧凑的模型微调,是本文要解决的核心问题。

核心思路:Uni-LoRA的核心思路是将各种LoRA变体统一到一个框架下,并证明它们之间的差异主要在于投影矩阵的选择。通过设计一个高效且理论上合理的投影矩阵,特别是等距投影矩阵,实现全局参数共享。更进一步,Uni-LoRA提出仅使用一个可训练向量,通过该向量的投影来重建整个LLM的LoRA参数,从而达到极致的参数效率。

技术框架:Uni-LoRA的技术框架主要包含以下几个部分:1) LoRA参数空间的扁平化:将LoRA的权重矩阵参数展平成一个高维向量空间R^D;2) 子空间投影:从一个低维子空间R^d(d << D)通过投影矩阵P ∈ R^(D×d)来重建LoRA参数;3) 投影矩阵的设计:设计高效的投影矩阵,特别是等距投影矩阵,以实现全局参数共享;4) 单向量重建:使用单个可训练向量来生成投影矩阵所需的参数,从而重建整个LLM的LoRA参数。

关键创新:Uni-LoRA最重要的技术创新点在于其“单向量”的设计。通过精心设计的投影矩阵,只需要一个可训练向量就能重建整个LLM的LoRA参数,实现了极致的参数效率。与现有LoRA方法相比,Uni-LoRA避免了层级或结构特定的参数,实现了真正的全局参数共享。此外,Uni-LoRA的统一框架也为理解和改进LoRA方法提供了新的视角。

关键设计:Uni-LoRA的关键设计在于投影矩阵P的选择。论文提出使用等距投影矩阵,这种矩阵能够保持向量的长度不变,从而保证了重建后的LoRA参数的质量。具体实现中,可以通过正交矩阵或随机矩阵来构造等距投影矩阵。此外,Uni-LoRA还设计了一种参数化的方式,使得投影矩阵的参数可以由一个可训练的向量生成,从而实现了“单向量”的设计。损失函数方面,Uni-LoRA沿用了标准的语言模型训练损失函数。

🖼️ 关键图片

📊 实验亮点

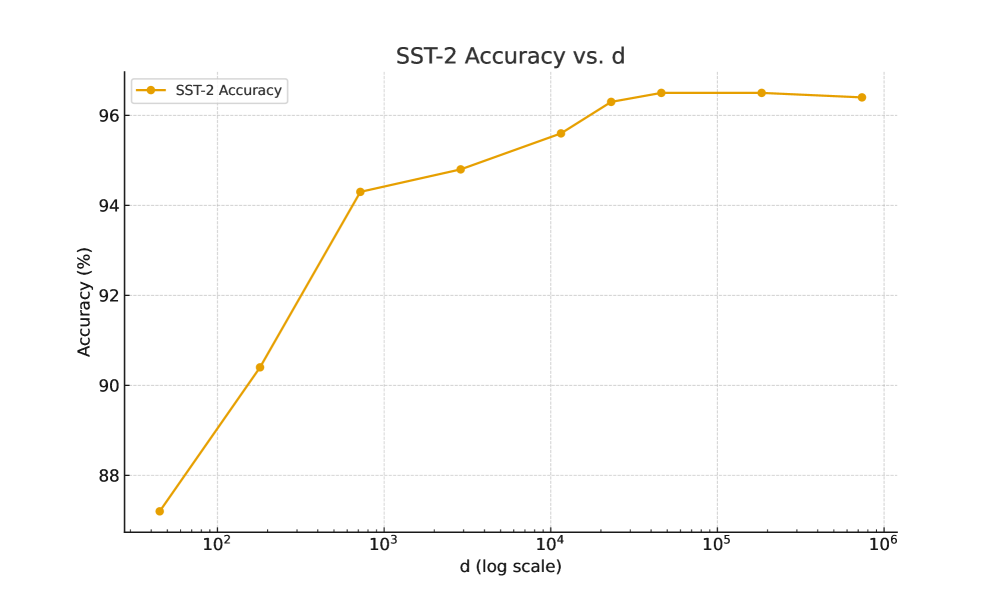

Uni-LoRA在GLUE、数学推理和指令调优等多个基准测试中取得了显著的成果。实验结果表明,Uni-LoRA在实现最先进参数效率的同时,在预测性能方面优于或匹配了先前的LoRA方法。例如,在某些任务上,Uni-LoRA仅使用极少量的可训练参数,就能达到与全参数微调相当的性能。

🎯 应用场景

Uni-LoRA在资源受限的场景下具有广泛的应用前景,例如移动设备上的LLM部署、边缘计算环境中的模型微调等。其极高的参数效率使得在计算能力有限的设备上进行LLM的个性化定制成为可能。此外,Uni-LoRA的统一框架也为研究更高效的参数微调方法提供了新的思路,有望推动LLM在更多领域的应用。

📄 摘要(原文)

Low-Rank Adaptation (LoRA) has become the de facto parameter-efficient fine-tuning (PEFT) method for large language models (LLMs) by constraining weight updates to low-rank matrices. Recent works such as Tied-LoRA, VeRA, and VB-LoRA push efficiency further by introducing additional constraints to reduce the trainable parameter space. In this paper, we show that the parameter space reduction strategies employed by these LoRA variants can be formulated within a unified framework, Uni-LoRA, where the LoRA parameter space, flattened as a high-dimensional vector space $R^D$, can be reconstructed through a projection from a subspace R^d, with $d \ll D$. We demonstrate that the fundamental difference among various LoRA methods lies in the choice of the projection matrix, $P \in R^{D \times d}$.Most existing LoRA variants rely on layer-wise or structure-specific projections that limit cross-layer parameter sharing, thereby compromising parameter efficiency. In light of this, we introduce an efficient and theoretically grounded projection matrix that is isometric, enabling global parameter sharing and reducing computation overhead. Furthermore, under the unified view of Uni-LoRA, this design requires only a single trainable vector to reconstruct LoRA parameters for the entire LLM - making Uni-LoRA both a unified framework and a "one-vector-only" solution. Extensive experiments on GLUE, mathematical reasoning, and instruction tuning benchmarks demonstrate that Uni-LoRA achieves state-of-the-art parameter efficiency while outperforming or matching prior approaches in predictive performance. Our code is available at https://github.com/KaiyangLi1992/Uni-LoRA.