Understanding Behavioral Metric Learning: A Large-Scale Study on Distracting Reinforcement Learning Environments

作者: Ziyan Luo, Tianwei Ni, Pierre-Luc Bacon, Doina Precup, Xujie Si

分类: cs.LG, cs.AI

发布日期: 2025-05-31 (更新: 2025-09-08)

💡 一句话要点

大规模研究揭示行为度量学习在干扰强化学习环境中的作用机制

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 行为度量学习 深度强化学习 状态抽象 等距嵌入 鲁棒性 噪声环境 去噪因子

📋 核心要点

- 现有深度强化学习方法在处理干扰信息时缺乏鲁棒性,准确估计行为度量仍然是一个挑战。

- 论文提出通过等距嵌入统一现有度量学习方法,并系统评估其在不同噪声环境下的性能。

- 实验引入去噪因子评估编码器过滤干扰的能力,并开源代码库以促进未来研究。

📝 摘要(中文)

状态抽象的关键方法是在观察空间中近似行为度量(特别是双模拟度量),并将这些学习到的距离嵌入到表征空间中。虽然先前的研究表明,这种方法在应对与任务无关的噪声时具有良好的鲁棒性,但准确估计这些度量仍然具有挑战性,需要各种设计选择,从而导致理论与实践之间存在差距。以往的评估主要集中在最终回报上,使得学习到的度量的质量和性能提升的来源尚不清楚。为了系统地评估度量学习在深度强化学习(RL)中的工作方式,我们评估了五种最新的方法,这些方法在概念上统一为具有不同设计选择的等距嵌入。我们使用基线在20个基于状态的任务和14个基于像素的任务中对它们进行基准测试,涵盖了370个具有不同噪声设置的任务配置。除了最终回报之外,我们还引入了去噪因子的评估,以量化编码器过滤干扰的能力。为了进一步隔离度量学习的效果,我们提出并评估了一个孤立的度量估计设置,其中编码器仅受度量损失的影响。最后,我们发布了一个开源的模块化代码库,以提高可重复性并支持未来对深度RL中度量学习的研究。

🔬 方法详解

问题定义:现有的深度强化学习方法在处理包含大量与任务无关的干扰信息(例如图像中的噪声)的环境时,鲁棒性较差。行为度量学习旨在学习一个状态表征,使得相似行为的状态在表征空间中距离较近,从而忽略干扰信息。然而,如何准确有效地学习这种行为度量仍然是一个挑战,现有的方法在设计选择上存在差异,缺乏统一的评估框架。

核心思路:论文的核心思路是将现有的行为度量学习方法统一到等距嵌入的框架下,并系统地评估它们在不同噪声环境下的性能。等距嵌入的目标是学习一个嵌入函数,使得状态之间的距离在原始状态空间和嵌入空间中保持一致。通过这种方式,可以学习到对干扰信息不敏感的状态表征。

技术框架:论文的整体框架包括以下几个主要模块:1) 编码器:将原始状态(或像素)映射到低维的表征空间。2) 度量学习模块:基于编码器的输出,学习状态之间的距离度量。3) 强化学习算法:使用学习到的状态表征进行策略学习。论文评估了五种不同的度量学习方法,它们的主要区别在于度量学习模块的设计。

关键创新:论文的主要创新点在于:1) 提出了一个统一的等距嵌入框架,用于理解和比较不同的行为度量学习方法。2) 设计了一个全面的实验评估框架,包括多种任务、噪声设置和评估指标(包括去噪因子)。3) 提出了一个孤立的度量估计设置,用于单独评估度量学习模块的性能。

关键设计:论文的关键设计包括:1) 使用对比损失或三元组损失来学习状态之间的距离度量。2) 设计不同的网络结构用于编码器,例如卷积神经网络(CNN)用于像素输入。3) 引入去噪因子作为评估指标,用于量化编码器过滤干扰信息的能力。4) 开源了一个模块化的代码库,方便研究人员复现和扩展实验。

🖼️ 关键图片

📊 实验亮点

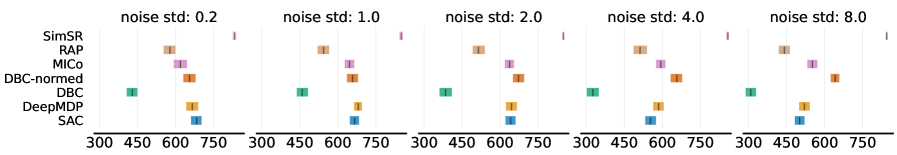

实验结果表明,不同的度量学习方法在不同的噪声环境下表现各异。通过引入去噪因子,论文能够更清晰地量化编码器过滤干扰的能力。在某些任务中,度量学习方法能够显著提升智能体的性能,尤其是在高噪声环境下。孤立的度量估计实验表明,度量学习模块的性能直接影响最终的强化学习效果。

🎯 应用场景

该研究成果可应用于机器人导航、自动驾驶、游戏AI等领域,提高智能体在复杂、噪声环境中的鲁棒性和泛化能力。通过学习对任务关键信息敏感的状态表征,可以减少对环境的依赖,降低训练成本,并提升智能体的决策效率。

📄 摘要(原文)

A key approach to state abstraction is approximating behavioral metrics (notably, bisimulation metrics) in the observation space and embedding these learned distances in the representation space. While promising for robustness to task-irrelevant noise, as shown in prior work, accurately estimating these metrics remains challenging, requiring various design choices that create gaps between theory and practice. Prior evaluations focus mainly on final returns, leaving the quality of learned metrics and the source of performance gains unclear. To systematically assess how metric learning works in deep reinforcement learning (RL), we evaluate five recent approaches, unified conceptually as isometric embeddings with varying design choices. We benchmark them with baselines across 20 state-based and 14 pixel-based tasks, spanning 370 task configurations with diverse noise settings. Beyond final returns, we introduce the evaluation of a denoising factor to quantify the encoder's ability to filter distractions. To further isolate the effect of metric learning, we propose and evaluate an isolated metric estimation setting, in which the encoder is influenced solely by the metric loss. Finally, we release an open-source, modular codebase to improve reproducibility and support future research on metric learning in deep RL.