Object Centric Concept Bottlenecks

作者: David Steinmann, Wolfgang Stammer, Antonia Wüst, Kristian Kersting

分类: cs.LG, cs.AI

发布日期: 2025-05-30 (更新: 2025-10-07)

💡 一句话要点

提出Object-Centric Concept Bottlenecks,提升复杂视觉任务中概念瓶颈模型的性能与可解释性。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 概念瓶颈模型 对象中心建模 可解释性AI 视觉任务 深度学习

📋 核心要点

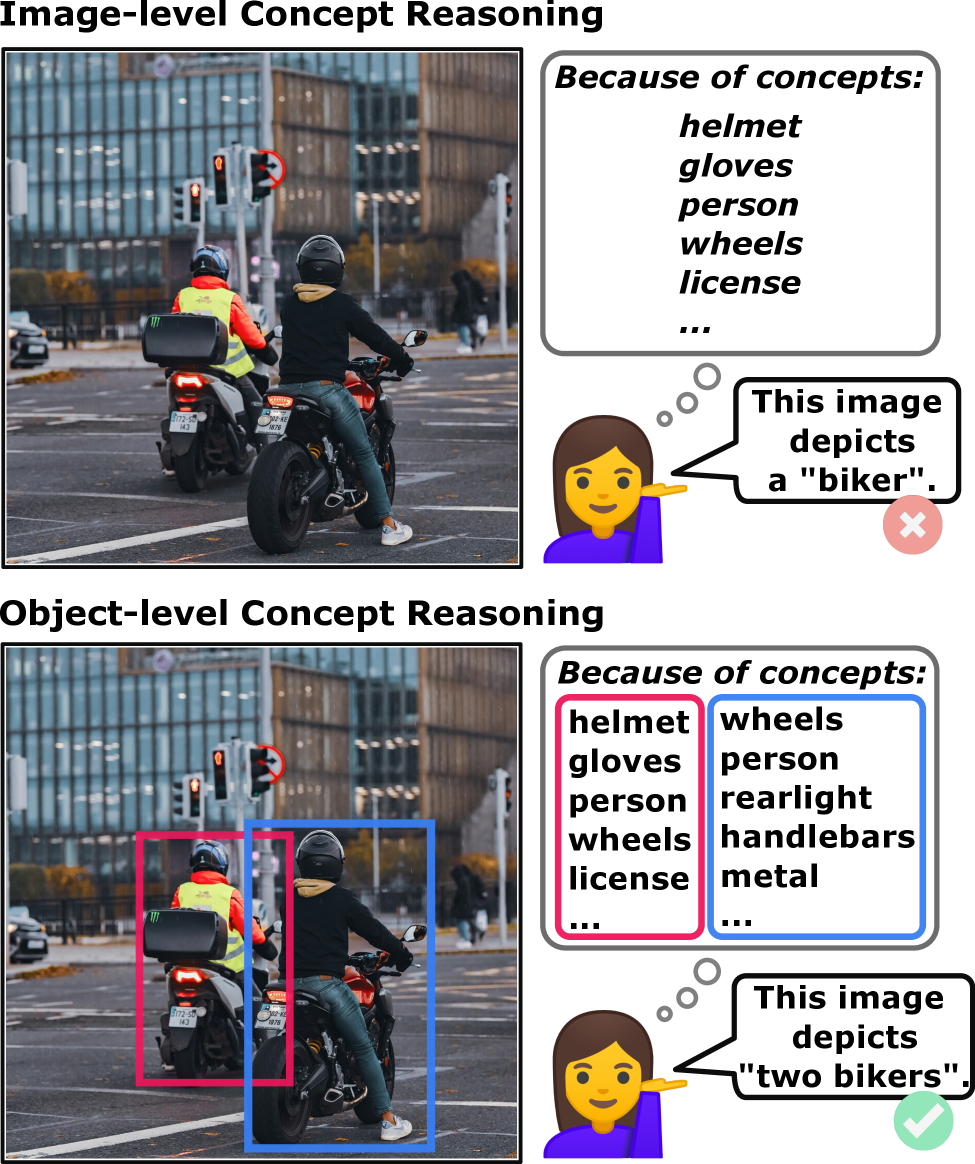

- 传统概念瓶颈模型依赖全局图像编码,在对象中心场景下表达能力受限,难以解决复杂视觉任务。

- OCB框架结合概念瓶颈模型与预训练对象中心模型,提取对象级别的概念,提升性能与可解释性。

- 实验表明,OCB在复杂图像数据集上优于传统概念瓶颈模型,并支持对复杂视觉任务进行可解释的决策。

📝 摘要(中文)

在现代人工智能中,开发高性能且可解释的模型仍然是一个关键挑战。概念瓶颈模型(CBMs)试图通过从全局编码(例如,图像编码)中提取人类可理解的概念,然后在生成的概念激活上应用线性分类器来解决这个问题,从而实现透明的决策。然而,它们对整体图像编码的依赖限制了它们在以对象为中心的真实世界环境中的表达能力,从而阻碍了它们解决超出单标签分类的复杂视觉任务的能力。为了应对这些挑战,我们引入了Object-Centric Concept Bottlenecks(OCB),该框架结合了CBMs和预训练的以对象为中心的基础模型的优势,从而提高了性能和可解释性。我们在复杂的图像数据集上评估了OCB,并进行了全面的消融研究,以分析框架的关键组件,例如聚合对象-概念编码的策略。结果表明,OCB优于传统的CBMs,并且可以为复杂的视觉任务做出可解释的决策。

🔬 方法详解

问题定义:论文旨在解决传统概念瓶颈模型(CBMs)在处理复杂视觉任务时,由于依赖全局图像编码而导致的表达能力不足的问题。现有CBMs难以有效处理对象中心场景,限制了其在真实世界应用中的潜力。

核心思路:论文的核心思路是将CBMs与预训练的以对象为中心的基础模型相结合。通过利用对象中心模型提取图像中各个对象的特征表示,再将这些特征与概念关联起来,从而实现更精细、更具表达力的概念瓶颈。这样既能保持CBMs的可解释性,又能提升其在复杂场景下的性能。

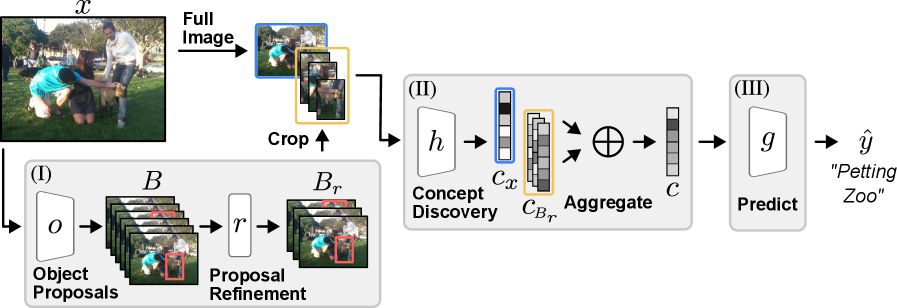

技术框架:OCB框架主要包含以下几个阶段:1) 对象检测与分割:使用预训练的对象中心模型(如DETR)检测并分割图像中的对象。2) 对象特征提取:对每个对象提取特征向量。3) 概念预测:将对象特征映射到概念空间,得到每个对象对应于不同概念的激活值。4) 概念聚合:将各个对象的概念激活值进行聚合,得到图像级别的概念表示。5) 决策:基于图像级别的概念表示进行最终的分类或预测。

关键创新:OCB的关键创新在于将对象中心建模的思想引入到概念瓶颈模型中。与传统CBMs直接从全局图像编码中提取概念不同,OCB首先关注图像中的各个对象,然后将对象特征与概念关联起来。这种对象中心的概念建模方式更符合人类的认知方式,也更易于解释。

关键设计:OCB的关键设计包括:1) 对象中心模型的选择:可以选择不同的预训练对象中心模型,如DETR、Mask R-CNN等。2) 概念预测器的设计:可以使用线性层、MLP等将对象特征映射到概念空间。3) 概念聚合策略:可以使用平均池化、最大池化、注意力机制等将各个对象的概念激活值进行聚合。4) 损失函数:可以使用交叉熵损失函数等来训练模型。

🖼️ 关键图片

📊 实验亮点

论文在复杂图像数据集上进行了实验,结果表明OCB显著优于传统的CBMs。通过消融研究,作者分析了OCB框架中各个组件的重要性,例如对象中心模型选择、概念预测器设计和概念聚合策略。实验结果验证了OCB框架的有效性和优越性。

🎯 应用场景

OCB框架可应用于需要高可解释性的复杂视觉任务,例如医疗图像诊断、自动驾驶场景理解、安全监控等。通过提供对象级别的概念解释,OCB可以帮助用户理解模型的决策过程,提高模型的可靠性和可信度,并促进人机协作。

📄 摘要(原文)

Developing high-performing, yet interpretable models remains a critical challenge in modern AI. Concept-based models (CBMs) attempt to address this by extracting human-understandable concepts from a global encoding (e.g., image encoding) and then applying a linear classifier on the resulting concept activations, enabling transparent decision-making. However, their reliance on holistic image encodings limits their expressiveness in object-centric real-world settings and thus hinders their ability to solve complex vision tasks beyond single-label classification. To tackle these challenges, we introduce Object-Centric Concept Bottlenecks (OCB), a framework that combines the strengths of CBMs and pre-trained object-centric foundation models, boosting performance and interpretability. We evaluate OCB on complex image datasets and conduct a comprehensive ablation study to analyze key components of the framework, such as strategies for aggregating object-concept encodings. The results show that OCB outperforms traditional CBMs and allows one to make interpretable decisions for complex visual tasks.