Adaptive Budget Allocation for Orthogonal-Subspace Adapter Tuning in LLMs Continual Learning

作者: Zhiyi Wan, Wanrou Du, Liang Li, Miao Pan, Xiaoqi Qin

分类: cs.LG, cs.AI

发布日期: 2025-05-28 (更新: 2025-10-16)

💡 一句话要点

提出OA-Adapter以解决LLMs持续学习中的预算分配问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 持续学习 大型语言模型 正交子空间 动态预算分配 参数效率 机器学习

📋 核心要点

- 现有方法在持续学习中使用固定预算分配,无法适应任务复杂性变化,导致性能下降。

- OA-Adapter通过动态瓶颈维度适应机制,统一了预算分配与任务目标优化,避免了优化与预算的错位。

- 实验结果显示,OA-Adapter在标准CL基准上准确率提高58.5%,且在两个包含15个任务的大型基准上保持优势。

📝 摘要(中文)

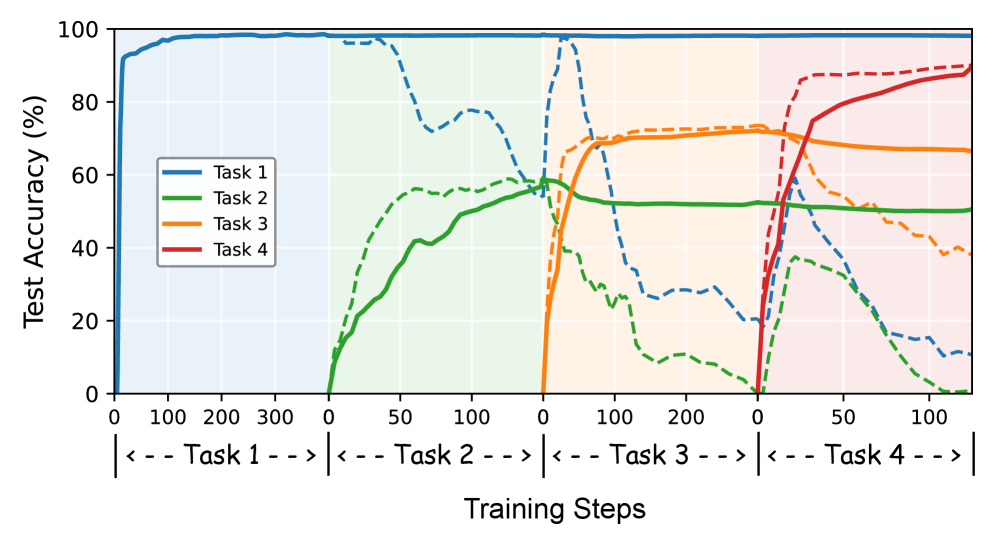

大型语言模型(LLMs)在持续学习(CL)场景中常常面临灾难性遗忘的问题,即在训练新任务时,之前学习的任务性能严重下降。尽管采用正交子空间的前沿CL方法可以减轻任务干扰,但它们通常使用固定的预算分配,忽视了任务和层之间复杂性的变化。此外,最近的预算自适应调优方法往往采用多阶段范式,导致优化与预算分配的解耦,从而影响实际应用。为了解决这些局限性,本文提出了一种新颖的参数高效方法OA-Adapter,统一了动态预算适应与正交子空间学习,采用端到端的训练阶段。实验结果表明,OA-Adapter在准确性和参数效率上均优于现有最先进的方法。

🔬 方法详解

问题定义:本文旨在解决大型语言模型在持续学习中面临的灾难性遗忘问题,现有方法由于固定预算分配而无法适应不同任务的复杂性,导致性能下降。

核心思路:OA-Adapter的核心思路是通过动态预算适应机制,结合正交子空间学习,实现高效的参数分配与任务目标的优化,避免了传统方法中优化与预算分配的错位。

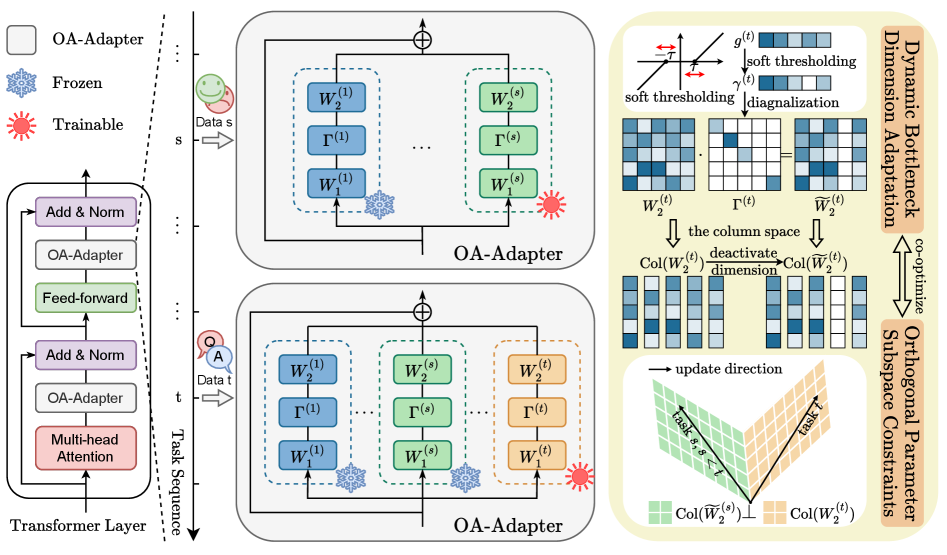

技术框架:OA-Adapter的整体架构包括动态预算分配模块和正交约束模块,前者负责根据任务复杂性动态调整参数预算,后者确保当前任务的参数子空间与历史任务的动态分配子空间之间的正交性。

关键创新:OA-Adapter的主要创新在于将动态预算适应与正交子空间学习结合在一起,形成端到端的训练流程,这与现有的多阶段解耦方法形成鲜明对比。

关键设计:在设计上,OA-Adapter引入了动态瓶颈维度适应机制,具体参数设置和损失函数设计旨在同时优化任务目标和参数预算,确保在保持知识的同时有效分配资源。

🖼️ 关键图片

📊 实验亮点

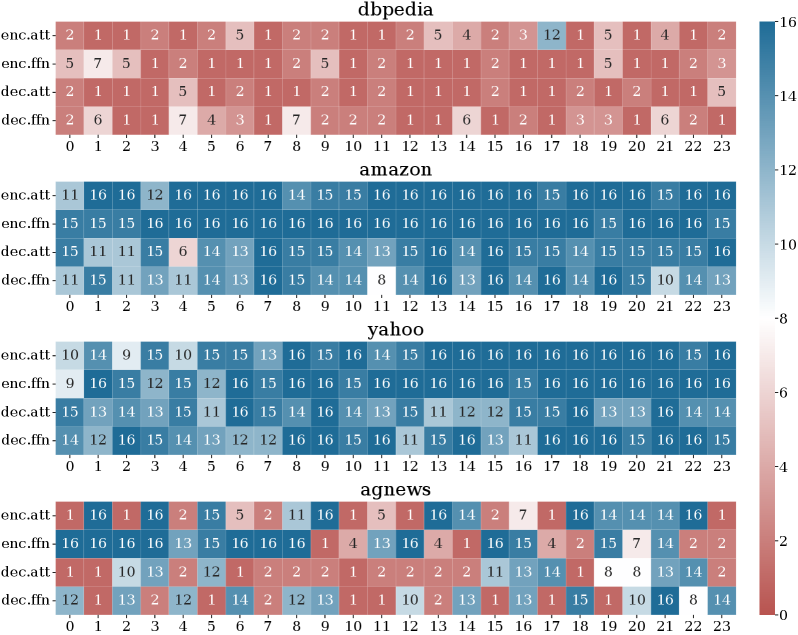

OA-Adapter在标准持续学习基准上实现了58.5%的参数减少,同时提高了平均准确率,超越了当前最先进的方法。此外,在两个包含15个任务的大型基准测试中,OA-Adapter也保持了其性能优势,显示出其在参数效率和准确性上的显著提升。

🎯 应用场景

该研究的潜在应用领域包括自然语言处理、智能对话系统和在线学习等。OA-Adapter能够有效提升模型在动态任务环境中的学习能力,具有重要的实际价值和广泛的应用前景,尤其是在需要快速适应新任务的场景中。

📄 摘要(原文)

Large language models (LLMs) often suffer from catastrophic forgetting in continual learning (CL) scenarios, where performance on previously learned tasks degrades severely while training on sequentially arriving tasks. Although pioneering CL approaches using orthogonal subspaces can mitigate task interference, they typically employ fixed budget allocation, neglecting the varying complexity across tasks and layers. Besides, recent budget-adaptive tuning methods for LLMs often adopt multi-stage paradigms that decouple optimization and budget allocation. Such decoupling results in potential misalignment, which hinders those approaches' practical application in CL scenarios. To address these limitations, we propose OA-Adapter, a novel parameter-efficient approach for continual learning in LLMs that unifies dynamic budget adaptation with orthogonal subspace learning in an end-to-end training stage. Specifically, OA-Adapter introduces a dynamic bottleneck dimension adaptation mechanism that simultaneously allocates an efficient parameter budget and optimizes task objectives without misalignment.To effectively preserve previously acquired knowledge while coordinating with the dynamic budget allocation, orthogonal constraints are applied specifically between the parameter subspace of the current task and the dynamically allocated parameter subspaces of historical tasks. Experimental results on continual learning benchmarks demonstrate that OA-Adapter outperforms state-of-the-art methods in both accuracy and parameter efficiency. OA-Adapter achieves higher average accuracy while using 58.5% fewer parameters on the standard CL benchmark, and maintains its advantages on two larger benchmarks comprising 15 tasks.