Let Me Think! A Long Chain-of-Thought Can Be Worth Exponentially Many Short Ones

作者: Parsa Mirtaheri, Ezra Edelman, Samy Jelassi, Eran Malach, Enric Boix-Adsera

分类: cs.LG, cs.AI, cs.CL

发布日期: 2025-05-27 (更新: 2026-01-09)

备注: Published at NeurIPS 2025

💡 一句话要点

长链思维胜过短链并行:揭示语言模型推理中序列计算的指数级优势

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 长链思维 序列扩展 并行扩展 图连通性 语言模型推理

📋 核心要点

- 现有方法在分配推理时计算资源方面存在不足,未能充分理解序列扩展和并行扩展的优劣。

- 论文核心思想是证明在特定推理场景下,序列扩展(长链思维)比并行扩展(短链投票)具有指数级的优势。

- 实验结果验证了理论发现,表明在图连通性问题上,长链思维策略在多种语言模型中表现更优。

📝 摘要(中文)

本文研究了大型语言模型推理时计算资源分配的问题,重点关注序列扩展(例如,更长的思维链)与并行扩展(例如,多个短思维链的多数投票)之间的权衡。研究表明,在图连通性问题的特定场景下,序列扩展相比并行扩展具有指数级的优势。作者通过在具有挑战性的图分布上进行实验,验证了理论发现,实验涵盖了从头开始训练的图连通性模型(使用不同的思维链策略)以及大型推理模型。

🔬 方法详解

问题定义:论文旨在解决大型语言模型在推理时,如何更有效地分配计算资源的问题。现有方法通常难以确定是应该优先使用更长的思维链(序列扩展),还是应该并行生成多个较短的思维链并进行投票(并行扩展)。尤其是在复杂推理任务中,这种选择会显著影响模型的性能。

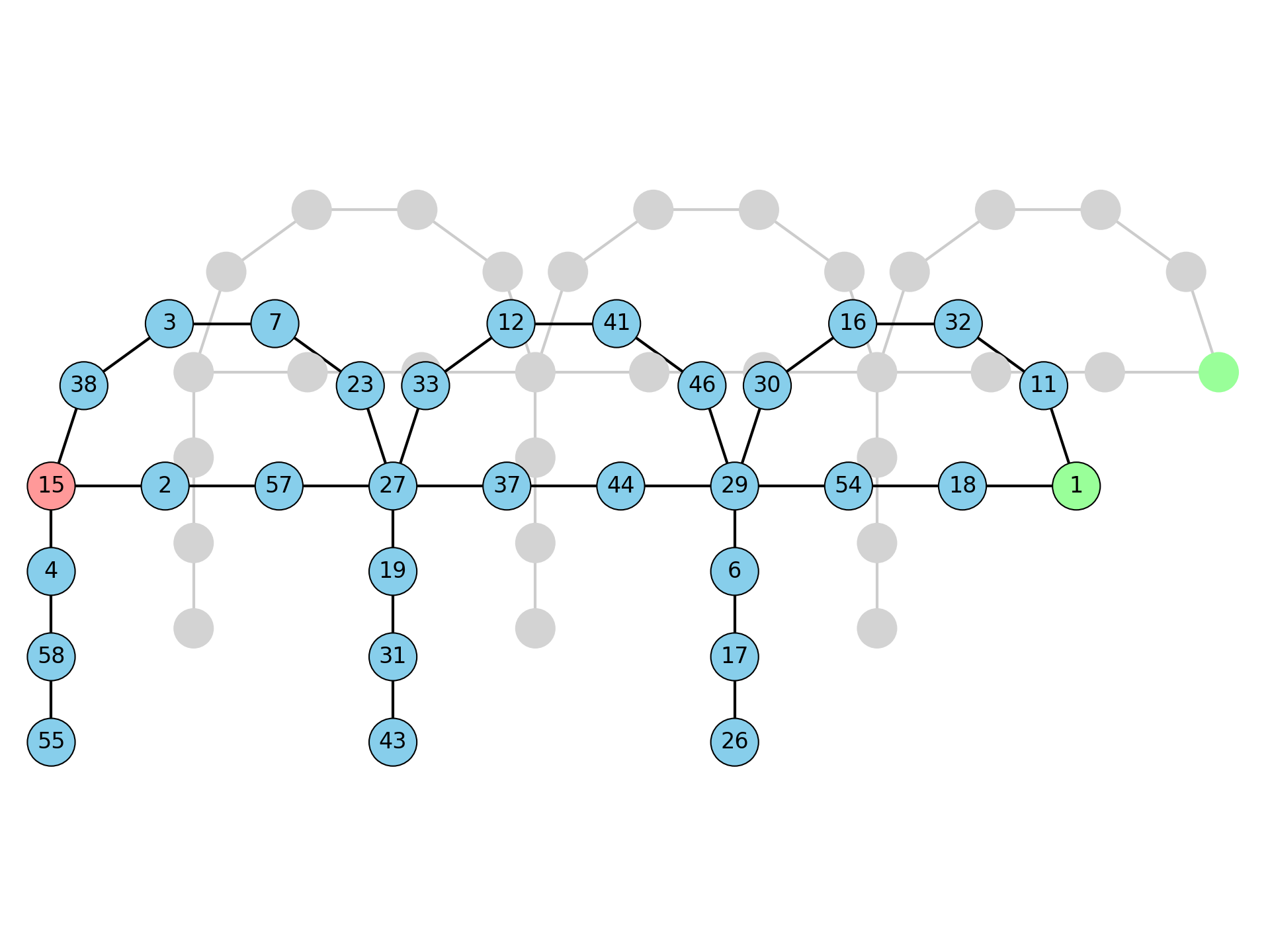

核心思路:论文的核心思路是证明在某些特定的推理场景下,序列扩展具有指数级的优势。具体来说,作者关注图连通性问题,并设计了具有挑战性的图分布,在这些分布上,长链思维能够更有效地探索图的结构,从而找到正确的答案。这种设计基于一个假设:即在某些问题中,逐步推理的过程比并行猜测更有利于找到全局最优解。

技术框架:论文的技术框架主要包括以下几个部分:1) 定义图连通性问题,并设计具有挑战性的图分布;2) 使用不同的思维链策略训练语言模型,包括短链和长链策略;3) 在不同的语言模型上进行实验,比较序列扩展和并行扩展的性能;4) 对实验结果进行理论分析,验证序列扩展的指数级优势。

关键创新:论文最重要的技术创新点在于揭示了序列扩展在特定推理场景下的指数级优势。与现有方法不同,该研究不仅关注模型的性能,更深入地探讨了计算资源分配策略对模型推理能力的影响。通过理论分析和实验验证,证明了长链思维在解决某些复杂问题时的优越性。

关键设计:论文的关键设计包括:1) 图分布的设计,确保问题具有挑战性,并且长链思维能够发挥优势;2) 思维链策略的设计,包括短链和长链两种策略,用于比较序列扩展和并行扩展的性能;3) 实验指标的选择,用于评估模型在图连通性问题上的准确率和效率。

🖼️ 关键图片

📊 实验亮点

实验结果表明,在图连通性问题上,使用长链思维策略训练的语言模型比使用短链思维策略训练的模型表现更好。更重要的是,实验验证了理论分析,证明了序列扩展相比并行扩展具有指数级的优势。具体性能提升幅度未知,但论文强调了“指数级”的优势。

🎯 应用场景

该研究成果可应用于需要复杂推理和规划的领域,例如机器人导航、任务规划、知识图谱推理等。通过优化推理时的计算资源分配,可以提高语言模型在这些领域的性能和效率。此外,该研究也为未来语言模型的设计和训练提供了新的思路,即应该更加重视序列推理能力。

📄 摘要(原文)

Inference-time computation has emerged as a promising scaling axis for improving large language model reasoning. However, despite yielding impressive performance, the optimal allocation of inference-time computation remains poorly understood. A central question is whether to prioritize sequential scaling (e.g., longer chains of thought) or parallel scaling (e.g., majority voting across multiple short chains of thought). In this work, we seek to illuminate the landscape of test-time scaling by demonstrating the existence of reasoning settings where sequential scaling offers an exponential advantage over parallel scaling. These settings are based on graph connectivity problems in challenging distributions of graphs. We validate our theoretical findings with comprehensive experiments across a range of language models, including models trained from scratch for graph connectivity with different chain of thought strategies as well as large reasoning models.