Jailbreak-as-a-Service++: Unveiling Distributed AI-Driven Malicious Information Campaigns Powered by LLM Crowdsourcing

作者: Yu Yan, Sheng Sun, Mingfeng Li, Yunlong Song, Xingzhou Zhang, Linran Lu, Zhifei Zheng, Min Liu, Qi Li

分类: cs.LG, cs.AI, cs.CL

发布日期: 2025-05-27 (更新: 2026-01-24)

💡 一句话要点

PoisonSwarm:提出一种基于LLM众包的分布式恶意信息生成框架

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 恶意信息生成 模型即服务 LLM众包 安全对齐

📋 核心要点

- 现有LLM安全对齐机制难以应对攻击者利用多个MaaS平台上的LLM异构安全策略进行恶意信息生成。

- PoisonSwarm通过LLM众包,将恶意任务分解为良性语义单元,再重组,绕过安全检测。

- 实验表明PoisonSwarm在数据质量、多样性和成功率上优于现有方法,并揭示了监管此类攻击的难度。

📝 摘要(中文)

为了防止大型语言模型(LLMs)被滥用于恶意目的,人们已经做出了大量努力来开发LLMs的安全对齐机制。然而,随着多个LLMs通过各种模型即服务(MaaS)平台变得容易访问,攻击者可以战略性地利用LLMs异构的安全策略,以分布式的方式完成恶意信息生成任务。本研究介绍了一种名为PoisonSwarm的框架,展示了攻击者如何通过推测性地使用LLM众包来可靠地清洗恶意任务。PoisonSwarm建立在协调众包LLMs的调度器之上,将给定的恶意任务映射到一个良性的类似物以导出一个内容模板,将其分解为语义单元以进行众包单元式重写,并将输出重新组装成恶意内容。实验表明,该方法在数据质量、多样性和成功率方面优于现有方法。监管模拟进一步揭示了在MaaS生态系统中管理这种分布式、精心策划的滥用的难度,突出了对协调的、生态系统级防御的需求。

🔬 方法详解

问题定义:论文旨在解决攻击者如何利用多个模型即服务(MaaS)平台上的大型语言模型(LLMs)来生成恶意信息的问题。现有方法难以应对LLMs异构的安全策略,攻击者可以通过分布式的方式绕过安全检测。现有的防御方法通常针对单个LLM,难以应对这种分布式攻击。

核心思路:论文的核心思路是将恶意任务分解为多个良性子任务,利用LLM众包平台上的多个LLM分别处理这些子任务,然后将结果重新组合成恶意内容。通过这种方式,攻击者可以利用不同LLM的安全策略漏洞,绕过安全检测。

技术框架:PoisonSwarm框架包含以下几个主要模块:1) 任务调度器:负责将恶意任务分配给不同的LLM。2) 任务转换器:将恶意任务转换为良性任务的模板。3) 语义单元分解器:将良性任务模板分解为语义单元,以便进行众包重写。4) LLM众包平台:利用多个LLM进行语义单元的重写。5) 内容重组器:将重写后的语义单元重新组合成恶意内容。

关键创新:PoisonSwarm的关键创新在于利用LLM众包来清洗恶意任务,通过将恶意任务分解为良性子任务,绕过安全检测。此外,该框架还能够自适应地选择合适的LLM来处理不同的子任务,从而提高攻击的成功率。

关键设计:任务转换器将恶意任务映射到一个良性的类似物,生成内容模板。语义单元分解器将模板分解为更小的语义单元,例如短语或句子。LLM众包平台使用不同的LLM对这些语义单元进行重写,并添加一些随机性以增加多样性。内容重组器将重写后的语义单元重新组合成完整的恶意内容。调度器根据LLM的可用性和安全策略选择合适的LLM进行处理。

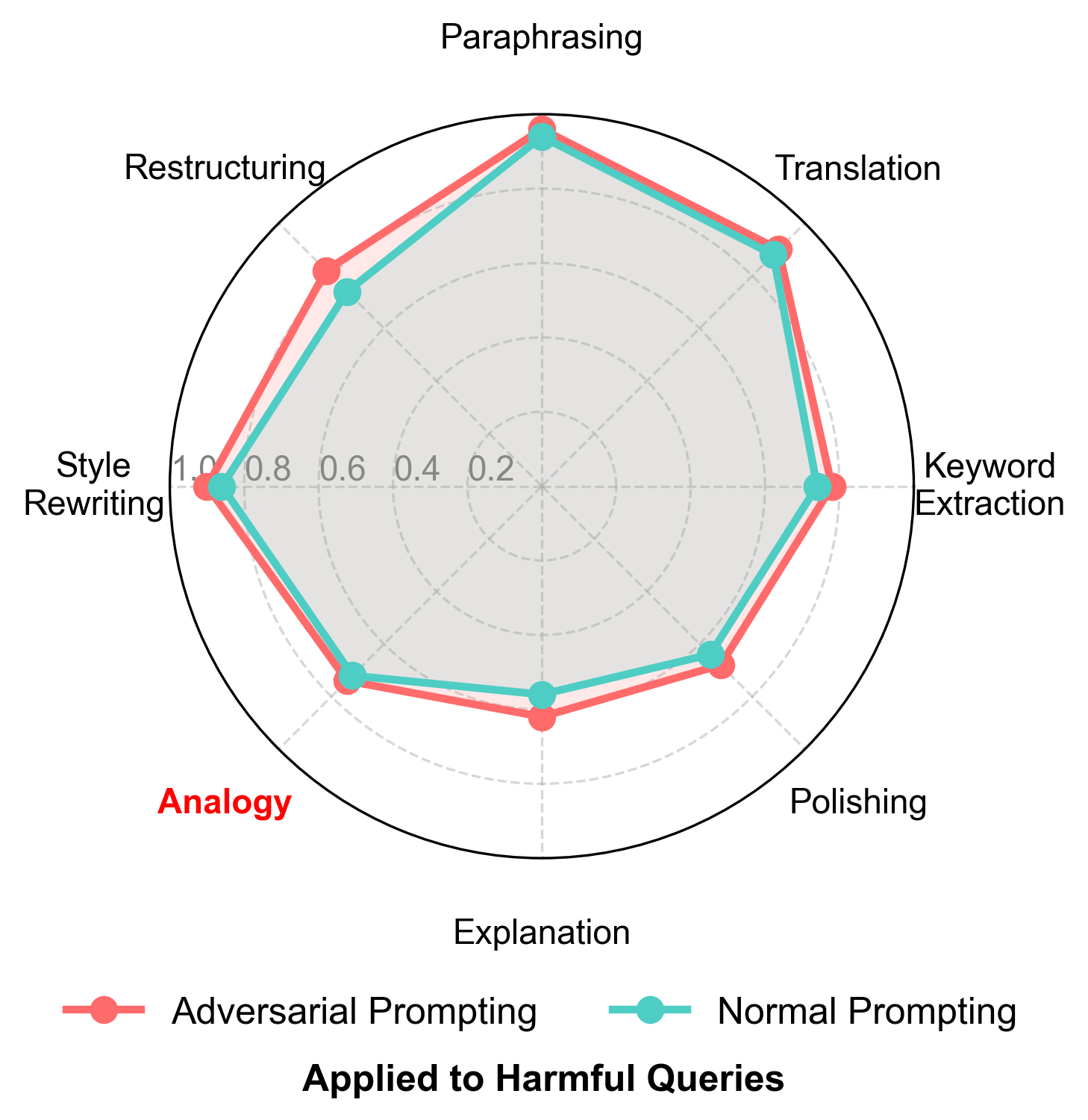

🖼️ 关键图片

📊 实验亮点

实验结果表明,PoisonSwarm在数据质量、多样性和成功率方面优于现有方法。与直接攻击相比,PoisonSwarm能够显著提高恶意信息生成的成功率,并且生成的恶意内容更难以被检测到。监管模拟实验也表明,在MaaS生态系统中管理这种分布式攻击非常困难。

🎯 应用场景

该研究揭示了LLM众包在恶意信息生成方面的潜在风险,可用于指导开发更有效的LLM安全防御机制。研究结果对MaaS平台、LLM开发者和监管机构具有重要意义,有助于构建更安全的AI生态系统,防范恶意信息传播。

📄 摘要(原文)

To prevent the misuse of Large Language Models (LLMs) for malicious purposes, numerous efforts have been made to develop the safety alignment mechanisms of LLMs. However, as multiple LLMs become readily accessible through various Model-as-a-Service (MaaS) platforms, attackers can strategically exploit LLMs' heterogeneous safety policies to fulfill malicious information generation tasks in a distributed manner. In this study, we introduce \textit{\textbf{PoisonSwarm}} to how attackers can reliably launder malicious tasks via the speculative use of LLM crowdsourcing. Building upon a scheduler orchestrating crowdsourced LLMs, PoisonSwarm maps the given malicious task to a benign analogue to derive a content template, decomposes it into semantic units for crowdsourced unit-wise rewriting, and reassembles the outputs into malicious content. Experiments show its superiority over existing methods in data quality, diversity, and success rates. Regulation simulations further reveal the difficulty of governing such distributed, orchestrated misuse in MaaS ecosystems, highlighting the need for coordinated, ecosystem-level defenses.