BASE-Q: Bias and Asymmetric Scaling Enhanced Rotational Quantization for Large Language Models

作者: Liulu He, Shenli Zheng, Karwei Sun, Yijiang Liu, Yufei Zhao, Chongkang Tan, Huanrui Yang, Yuan Du, Li Du

分类: cs.LG, cs.AI, cs.CL

发布日期: 2025-05-26 (更新: 2025-08-29)

💡 一句话要点

BASE-Q:通过偏差校正和非对称缩放增强LLM的旋转量化

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 量化 旋转量化 偏差校正 非对称缩放

📋 核心要点

- 现有旋转量化方法在优化旋转参数时面临性能提升有限和训练开销大的问题,限制了其在实际应用中的价值。

- BASE-Q通过引入偏差校正和非对称缩放,有效减少了量化过程中的舍入误差和裁剪误差,提升了量化精度。

- 实验结果表明,BASE-Q在多种LLM和基准测试中显著优于现有旋转量化方法,有效缩小了与全精度模型的精度差距。

📝 摘要(中文)

旋转已成为大型语言模型(LLM)量化流程中的关键技术,能够有效平滑权重和激活中的异常值。然而,进一步优化旋转参数带来的性能提升有限,且引入了显著的训练开销:由于旋转参数共享,必须同时加载整个模型才能进行反向传播,导致巨大的内存消耗和有限的实际应用价值。本文指出了现有旋转量化方法的两个根本局限性:(i)旋转未能对齐通道均值,导致更宽的量化边界和更大的舍入误差;(ii)旋转使激活分布更接近高斯分布,增加了由裁剪误差引起的能量损失。为了解决这些问题,我们提出BASE-Q,一种简单而强大的方法,结合了偏差校正和非对称缩放,以有效减少舍入和裁剪误差。此外,BASE-Q支持分块优化,无需内存密集型的全模型反向传播。在各种LLM和基准测试上的大量实验表明,BASE-Q的有效性,与QuaRot、SpinQuant和OSTQuant相比,分别缩小了50.5%、42.9%和29.2%的精度差距。代码即将发布。

🔬 方法详解

问题定义:现有旋转量化方法在压缩大型语言模型时,虽然通过旋转操作平滑了权重和激活中的异常值,但存在两个主要问题。一是旋转操作未能有效对齐通道均值,导致量化范围扩大,舍入误差增加。二是旋转操作使激活分布更接近高斯分布,增加了裁剪误差带来的能量损失。这些问题限制了量化模型的精度,并且需要全模型反向传播,导致内存消耗巨大。

核心思路:BASE-Q的核心思路是通过偏差校正和非对称缩放来解决旋转量化中的舍入误差和裁剪误差问题。偏差校正旨在对齐通道均值,减少量化范围,从而降低舍入误差。非对称缩放则根据激活分布的特性,调整量化范围,减少裁剪误差。通过结合这两种方法,BASE-Q能够更有效地保留模型的信息,提高量化精度。

技术框架:BASE-Q的整体框架是在现有的旋转量化流程中加入偏差校正和非对称缩放两个模块。首先,对权重或激活进行旋转操作。然后,应用偏差校正来对齐通道均值。接着,使用非对称缩放来调整量化范围。最后,进行量化操作。与现有方法不同的是,BASE-Q支持分块优化,无需加载整个模型进行反向传播,从而降低了内存消耗。

关键创新:BASE-Q的关键创新在于提出了偏差校正和非对称缩放两种方法,并将其与旋转量化相结合。偏差校正能够有效对齐通道均值,减少舍入误差,而非对称缩放能够根据激活分布的特性,减少裁剪误差。此外,BASE-Q支持分块优化,降低了内存消耗,使其更具实用性。

关键设计:偏差校正的具体实现方式是计算每个通道的均值,并将其减去。非对称缩放的具体实现方式是根据激活分布的最小值和最大值,动态调整量化范围。分块优化则是将模型分成多个块,分别进行量化和反向传播。具体的参数设置和损失函数细节在论文中未明确给出,属于未知信息。

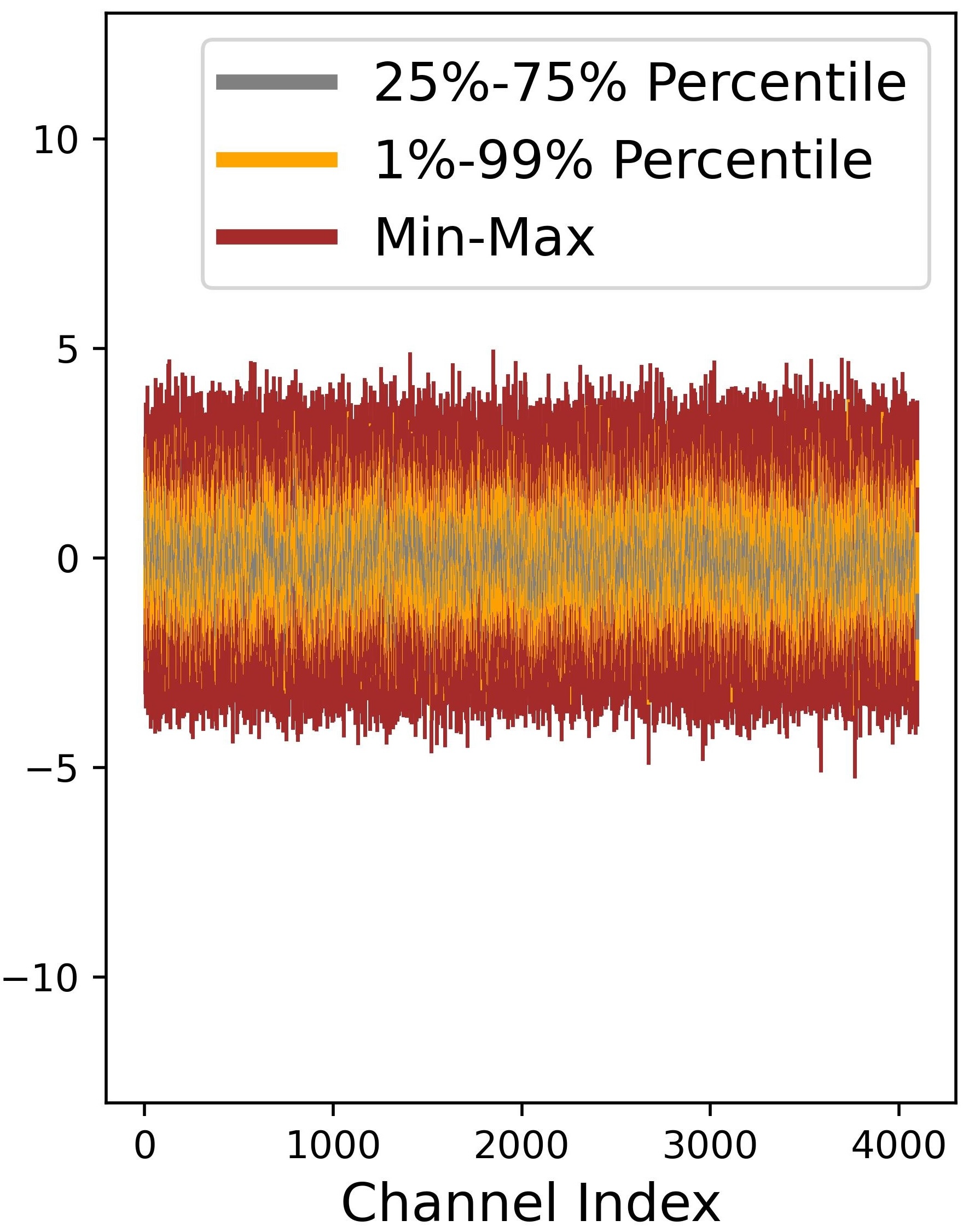

🖼️ 关键图片

📊 实验亮点

BASE-Q在各种LLM和基准测试中表现出色,与QuaRot、SpinQuant和OSTQuant等现有旋转量化方法相比,分别缩小了50.5%、42.9%和29.2%的精度差距。这些结果表明,BASE-Q能够显著提高量化模型的精度,使其更接近全精度模型,具有很强的竞争力。

🎯 应用场景

BASE-Q具有广泛的应用前景,可用于在资源受限的设备上部署大型语言模型,例如移动设备和嵌入式系统。通过降低模型的存储空间和计算复杂度,BASE-Q能够使这些设备也能运行复杂的AI应用,例如自然语言处理、机器翻译和对话系统。此外,BASE-Q还可以用于加速模型训练和推理,提高AI应用的效率。

📄 摘要(原文)

Rotations have become essential to state-of-the-art quantization pipelines for large language models (LLMs) by effectively smoothing outliers in weights and activations. However, further optimizing the rotation parameters offers only limited performance gains and introduces significant training overhead: due to rotation parameter sharing, full-model must be loaded simultaneously to enable backpropagation, resulting in substantial memory consumption and limited practical utility. In this work, we identify two fundamental limitations of current rotational quantization methods: (i) rotation fails to align channel means, resulting in wider quantization bounds and increased rounding errors; and (ii) rotation makes the activation distribution more Gaussian-like, increasing energy loss caused by clipping errors. To address these issues, we introduce \textbf{BASE-Q}, a simple yet powerful approach that combines bias correction and asymmetric scaling to effectively reduce rounding and clipping errors. Furthermore, BASE-Q enables blockwise optimization, eliminating the need for memory-intensive full-model backpropagation. Extensive experiments on various LLMs and benchmarks demonstrate the effectiveness of BASE-Q, narrowing the accuracy gap to full-precision models by 50.5\%, 42.9\%, and 29.2\% compared to QuaRot, SpinQuant, and OSTQuant, respectively. The code will be released soon.