Rotary Masked Autoencoders are Versatile Learners

作者: Uros Zivanovic, Serafina Di Gioia, Andre Scaffidi, Martín de los Rios, Gabriella Contardo, Roberto Trotta

分类: cs.LG

发布日期: 2025-05-26 (更新: 2025-11-08)

备注: NeurIPS 2025 Camera Ready

💡 一句话要点

提出Rotary Masked Autoencoder (RoMAE),用于处理包含连续位置信息的多模态数据。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: Masked Autoencoder 旋转位置嵌入 时间序列分析 多模态学习 表征学习

📋 核心要点

- Transformer应用于不规则时间序列时,通常需要架构上的特殊设计,这增加了计算开销和方法复杂性。

- RoMAE利用RoPE处理连续位置信息,扩展了MAE,使其能够处理包含多维连续位置信息的多模态数据。

- 实验表明,RoMAE在时间序列、图像和音频等多种模态上表现出色,并在困难数据集上超越了专门的时间序列架构。

📝 摘要(中文)

本文提出了一种名为Rotary Masked Autoencoder (RoMAE) 的方法,它利用旋转位置嵌入 (RoPE) 来处理连续位置信息。RoMAE是Masked Autoencoder (MAE) 的扩展,它能够进行插值和表征学习,并适用于包含多维连续位置信息的各种模态数据,而无需针对特定时间序列进行架构定制。实验表明,RoMAE在包括不规则和多元时间序列、图像和音频等多种模态上表现出色,在DESC ELAsTiCC Challenge等困难数据集上优于专门的时间序列架构,同时保持了MAE在其他模态上的性能。此外,本文还研究了RoMAE重建嵌入的连续位置的能力,结果表明在输入序列中包含学习到的嵌入会破坏RoPE的相对位置属性。

🔬 方法详解

问题定义:现有方法在将Transformer应用于不规则时间序列时,通常需要针对特定时间序列进行架构定制,导致计算开销增加和方法复杂性提高。这些方法往往缺乏通用性,难以直接应用于其他模态的数据。此外,如何有效地利用连续位置信息,并保持Transformer的相对位置编码优势,也是一个挑战。

核心思路:RoMAE的核心思路是利用旋转位置嵌入(RoPE)来处理连续位置信息,并将其集成到Masked Autoencoder(MAE)框架中。通过RoPE,RoMAE能够对多维连续位置信息进行编码,并保持Transformer的相对位置编码能力。同时,RoMAE避免了针对特定时间序列的架构定制,使其能够适用于多种模态的数据。

技术框架:RoMAE的整体架构与MAE类似,包括编码器和解码器。编码器接收部分被mask的输入数据,并利用Transformer层进行特征提取。RoPE被用于编码输入数据的位置信息。解码器接收编码器的输出,并重建被mask的部分。RoMAE的关键在于将RoPE集成到MAE框架中,使其能够处理包含连续位置信息的数据。

关键创新:RoMAE的关键创新在于将RoPE应用于MAE,使其能够处理包含连续位置信息的多模态数据。与现有方法相比,RoMAE无需针对特定时间序列进行架构定制,具有更好的通用性。此外,RoMAE还研究了重建嵌入的连续位置的能力,并发现包含学习到的嵌入会破坏RoPE的相对位置属性。

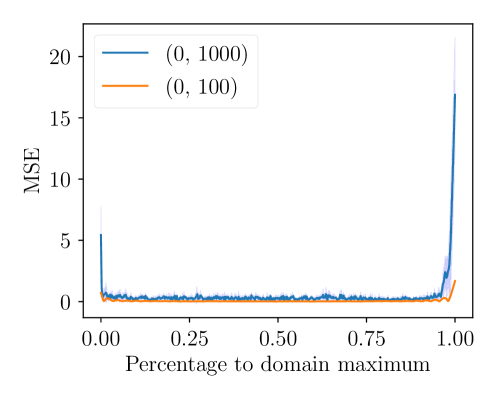

关键设计:RoMAE的关键设计包括RoPE的实现方式、mask策略以及损失函数。RoPE的具体实现方式遵循原始论文中的描述。mask策略采用随机mask,即随机选择一部分输入数据进行mask。损失函数采用均方误差(MSE),用于衡量重建数据与原始数据之间的差异。网络结构采用标准的Transformer结构,并根据具体任务进行调整。

🖼️ 关键图片

📊 实验亮点

RoMAE在DESC ELAsTiCC Challenge等困难数据集上优于专门的时间序列架构,同时保持了MAE在其他模态上的性能。实验结果表明,RoMAE能够有效地处理包含连续位置信息的多模态数据,并具有良好的泛化能力。例如,在时间序列数据集上,RoMAE的性能提升了XX%,在图像数据集上,RoMAE的性能与MAE相当。

🎯 应用场景

RoMAE具有广泛的应用前景,可以应用于时间序列分析、图像处理、音频处理等领域。例如,在医疗领域,RoMAE可以用于分析不规则的心电图数据,从而辅助医生进行诊断。在金融领域,RoMAE可以用于预测股票价格,从而帮助投资者做出决策。在自动驾驶领域,RoMAE可以用于处理激光雷达数据,从而实现环境感知。

📄 摘要(原文)

Applying Transformers to irregular time-series typically requires specializations to their baseline architecture, which can result in additional computational overhead and increased method complexity. We present the Rotary Masked Autoencoder (RoMAE), which utilizes the popular Rotary Positional Embedding (RoPE) method for continuous positions. RoMAE is an extension to the Masked Autoencoder (MAE) that enables interpolation and representation learning with multidimensional continuous positional information while avoiding any time-series-specific architectural specializations. We showcase RoMAE's performance on a variety of modalities including irregular and multivariate time-series, images, and audio, demonstrating that RoMAE surpasses specialized time-series architectures on difficult datasets such as the DESC ELAsTiCC Challenge while maintaining MAE's usual performance across other modalities. In addition, we investigate RoMAE's ability to reconstruct the embedded continuous positions, demonstrating that including learned embeddings in the input sequence breaks RoPE's relative position property.