Boost Post-Training Quantization via Null Space Optimization for Large Language Models

作者: Jiaqi Zhao, Miao Zhang, Deng Xiang, Ming Li, Weili Guan, Liqiang Nie

分类: cs.LG

发布日期: 2025-05-21 (更新: 2025-10-26)

备注: 17 pages, 4 figures

🔗 代码/项目: GITHUB

💡 一句话要点

提出Q2N:通过零空间优化提升大语言模型后训练量化性能

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 后训练量化 大语言模型 零空间优化 模型压缩 量化误差

📋 核心要点

- 现有LLM后训练量化方法收益递减,难以支持更压缩的模型,需要新的量化策略。

- 论文提出Q2N,核心思想是将量化误差约束在输入激活的零空间内,以缓解量化带来的性能损失。

- 实验表明,Q2N在多个SOTA LLM上有效,验证了零空间优化在LLM量化中的潜力。

📝 摘要(中文)

现有的针对大型语言模型(LLMs)的后训练量化(PTQ)方法已经取得了显著的成功。然而,性能提升的边际效应递减表明,现有的量化策略不足以支持更压缩模型的发展。为了激发未来研究的新方向,本文将零空间的概念引入LLMs量化。我们认为,通过约束量化后的权重扰动位于输入激活的零空间内,可以有效地缓解量化误差。为了验证这一想法,我们为现有的里程碑式PTQ基线设计了一个即插即用的零空间投影模块,名为Q2N。具体来说,我们首先设计了一种针对LLMs特性的高效且精确的零空间投影近似方法。随后,我们从理论上推导出了所获得的投影矩阵的等效向量的闭式解,该解满足实际推理条件,同时避免了额外的内存开销。在各种最先进的LLMs(LLaMA3、DeepSeek、Qwen3)和基线上进行了广泛的实验,证明了我们的Q2N和零空间优化视角对于LLMs量化的有效性。我们将本文视为基于零空间洞察进一步缓解量化误差的第一步,希望它能启发未来的研究人员设计更先进的量化方法。

🔬 方法详解

问题定义:现有大语言模型后训练量化(PTQ)方法面临性能瓶颈,进一步压缩模型变得困难。核心痛点在于量化过程引入的误差难以有效缓解,导致模型精度下降。

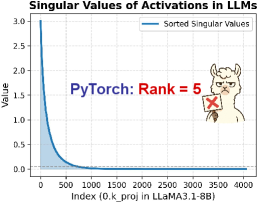

核心思路:论文的核心思路是将量化误差限制在输入激活的零空间中。这意味着量化后的权重扰动不会影响模型的输出,从而在一定程度上缓解量化误差。这样设计的目的是在不显著改变模型输出的前提下,允许权重进行量化,从而提高压缩率。

技术框架:Q2N是一个即插即用的模块,可以添加到现有的PTQ基线方法中。主要流程包括:1) 使用现有的PTQ方法对模型进行初步量化;2) 计算输入激活的零空间;3) 将量化后的权重投影到该零空间中,从而减少量化误差。

关键创新:论文的关键创新在于将零空间的概念引入到LLM量化中,并提出了一种高效且精确的零空间投影近似方法。此外,论文还推导出了投影矩阵的闭式解,避免了额外的内存开销,使其适用于实际推理。

关键设计:Q2N的关键设计包括:1) 针对LLM特性设计的零空间投影近似方法,提高了计算效率和精度;2) 推导出的投影矩阵闭式解,避免了存储整个投影矩阵的需求,降低了内存占用;3) Q2N作为一个独立的模块,可以方便地集成到不同的PTQ方法中。

🖼️ 关键图片

📊 实验亮点

实验结果表明,Q2N在LLaMA3、DeepSeek、Qwen3等多个最先进的LLM上都取得了显著的性能提升。与现有PTQ基线相比,Q2N能够在保持甚至提高模型精度的同时,实现更高的压缩率,验证了零空间优化在LLM量化中的有效性。

🎯 应用场景

该研究成果可应用于各种需要部署大型语言模型的场景,例如移动设备、边缘计算设备等资源受限的环境。通过降低模型大小和计算复杂度,Q2N有助于在这些平台上实现高效的LLM推理,从而推动LLM在更广泛的应用领域落地,例如智能助手、自然语言处理等。

📄 摘要(原文)

Existing post-training quantization methods for large language models (LLMs) offer remarkable success. However, the increasingly marginal performance gains suggest that existing quantization strategies are insufficient to support the development of more compressed models. To inspire new directions for future research, this paper introduces the concept of null space into LLMs quantization. We argue that the quantization error can be effectively alleviated by constraining the post-quantization weight perturbation to lie within the null space of input activations. To prove this idea, we propose a plug-and-play null space projection module for existing milestone PTQ baselines named Q2N. Specifically, we first design an efficient and accurate null space projection approximation method tailored to the characteristics of LLMs. Subsequently, we theoretically derive a closed-form solution for an equivalent vector of the obtained projection matrix, which satisfies practical inference condition while avoiding additional memory overhead. Extensive experiments are conducted on various state-of-the-art LLMs (LLaMA3, DeepSeek, Qwen3) and baselines, demonstrating the effectiveness of both our Q2N and the perspective of null space optimization for LLMs quantization. We view this paper the first step to further alleviate the quantization error based on the insights of null space, hoping it inspiring future researchers to design more advanced quantization methods. Codes are available at https://github.com/zjq0455/q2n.