Not All Models Suit Expert Offloading: On Local Routing Consistency of Mixture-of-Expert Models

作者: Jingcong Liang, Siyuan Wang, Miren Tian, Yitong Li, Duyu Tang, Zhongyu Wei

分类: cs.LG, cs.AI

发布日期: 2025-05-21 (更新: 2025-12-10)

🔗 代码/项目: GITHUB

💡 一句话要点

提出MoE模型局部路由一致性度量指标,优化专家卸载策略,提升推理效率。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 混合专家模型 专家卸载 局部路由一致性 推理优化 模型部署

📋 核心要点

- 现有MoE模型专家卸载策略缺乏对局部路由一致性的充分考量,导致推理效率受限。

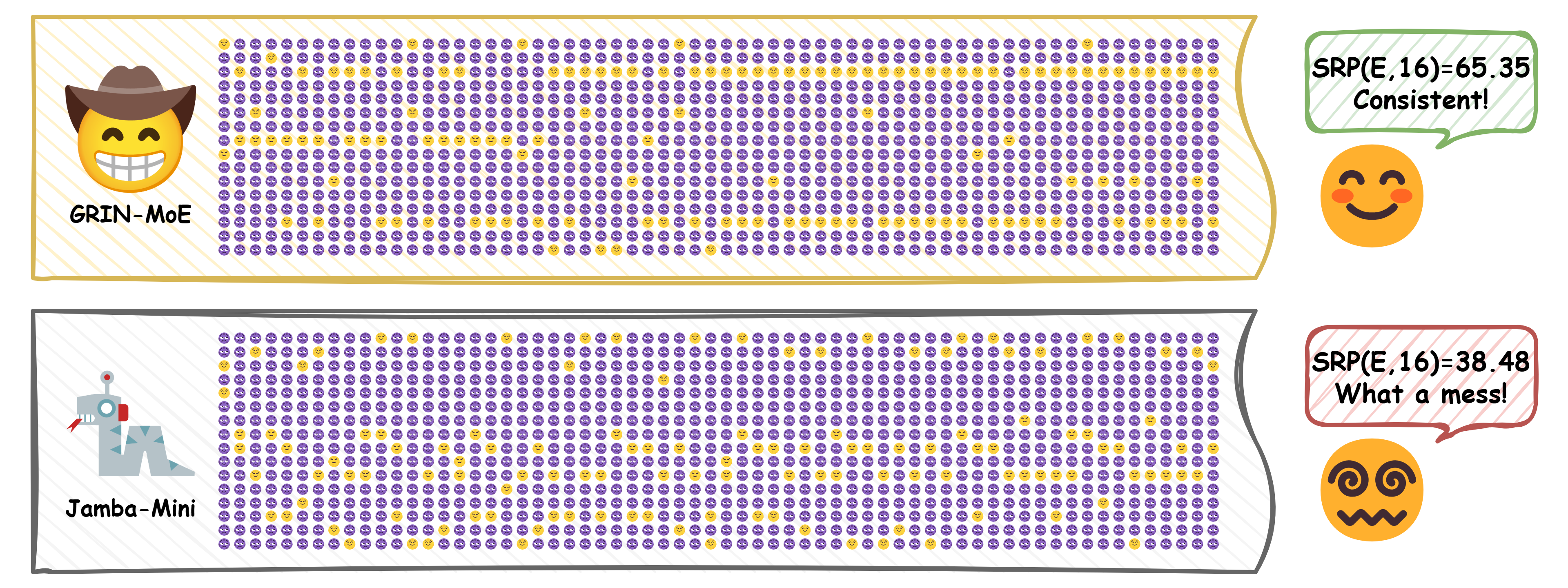

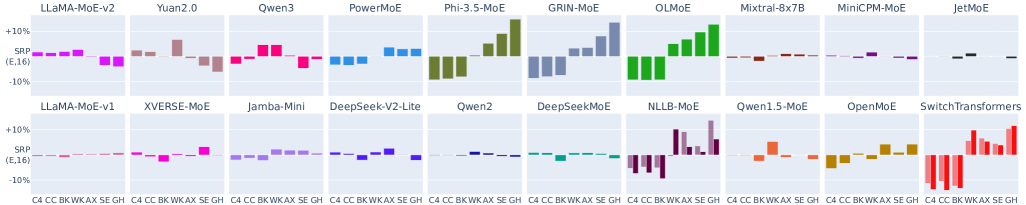

- 提出分段路由最佳性能(SRP)和分段缓存最佳命中率(SCH)两个指标,用于评估MoE模型的局部路由一致性。

- 通过对20个MoE LLM的分析,揭示了局部路由一致性与负载均衡、专家类型等因素的权衡关系,为优化MoE模型设计提供指导。

📝 摘要(中文)

混合专家模型(MoE)通过在推理过程中稀疏激活专家,实现了大型语言模型(LLM)的有效扩展。为了在内存受限的设备上高效部署大型MoE模型,许多系统引入了专家卸载,即将一部分专家缓存在快速内存中,而将其他专家保留在慢速内存中,以便在CPU上运行或按需加载。虽然一些研究已经利用了专家激活的局部性,即连续的token激活相似的专家,但这种局部路由一致性的程度因模型而异,并且仍然缺乏研究。在本文中,我们提出了两个指标来衡量MoE模型的局部路由一致性:(1)分段路由最佳性能(SRP),它评估了一组固定的专家能够多好地满足一段token的需求,以及(2)分段缓存最佳命中率(SCH),它衡量了在缓存限制下,利用未来信息长度的专家缓存的命中率。我们分析了20个具有不同大小和架构的MoE LLM,并使用玩具模型来验证与局部路由一致性相关的关键因素。我们发现局部路由一致性和局部负载平衡之间存在很强的权衡,同时表明全局负载平衡可以与局部路由一致性共存。同时,像共享专家这样减少专家组合空间的设置会导致较低的局部路由一致性。我们进一步揭示了领域专业专家比词汇专业专家对路由一致性的贡献更大,并且大多数模型在缓存有效性和效率之间取得平衡,缓存大小约为活动专家的两倍。这些发现为在不影响推理速度的情况下,实现内存高效的MoE设计和部署铺平了道路。我们发布了用于复制实验的代码。

🔬 方法详解

问题定义:论文旨在解决MoE模型在资源受限设备上部署时,由于专家卸载策略不合理导致的推理效率问题。现有方法主要关注专家激活的局部性,但缺乏对不同MoE模型局部路由一致性的系统性度量和分析,导致卸载策略无法针对不同模型进行优化。

核心思路:论文的核心思路是通过量化MoE模型的局部路由一致性,从而更好地指导专家卸载策略的设计。通过分析不同模型在局部路由一致性上的差异,可以针对性地选择合适的卸载策略,提高推理效率。

技术框架:论文的技术框架主要包括以下几个部分:1) 定义了两个新的度量指标:SRP和SCH,用于量化局部路由一致性。2) 对20个不同大小和架构的MoE LLM进行了实验分析,评估了它们的局部路由一致性。3) 使用玩具模型验证了影响局部路由一致性的关键因素,如负载均衡、专家类型等。4) 分析了缓存大小与缓存命中率之间的关系,为选择合适的缓存大小提供了指导。

关键创新:论文最重要的技术创新点在于提出了SRP和SCH两个度量指标,能够有效地量化MoE模型的局部路由一致性。与现有方法相比,这两个指标能够更全面地评估模型的局部路由特性,为专家卸载策略的设计提供了更准确的依据。

关键设计:SRP指标通过评估固定专家组覆盖token段需求的程度来衡量局部路由一致性。SCH指标则衡量了在缓存限制下,利用未来信息的专家缓存的命中率。论文还分析了不同因素对局部路由一致性的影响,例如专家共享、领域/词汇专家等,并给出了相应的结论。

🖼️ 关键图片

📊 实验亮点

实验结果表明,局部路由一致性与局部负载均衡之间存在权衡关系,而全局负载均衡可以与局部路由一致性共存。领域专业专家比词汇专业专家对路由一致性的贡献更大。大多数模型在缓存有效性和效率之间取得平衡,缓存大小约为活动专家的两倍。这些发现为内存高效的MoE设计和部署提供了重要指导。

🎯 应用场景

该研究成果可应用于各种需要部署大型MoE模型的场景,尤其是在内存资源受限的边缘设备上。通过优化专家卸载策略,可以显著提高推理速度,降低部署成本,从而推动MoE模型在移动设备、嵌入式系统等领域的应用。此外,该研究也为未来MoE模型的设计提供了新的思路,可以设计出更易于部署和优化的模型。

📄 摘要(原文)

Mixture-of-Experts (MoE) enables efficient scaling of large language models (LLMs) with sparsely activated experts during inference. To effectively deploy large MoE models on memory-constrained devices, many systems introduce expert offloading that caches a subset of experts in fast memory, leaving others on slow memory to run on CPU or load on demand. While some research has exploited the locality of expert activations, where consecutive tokens activate similar experts, the degree of this local routing consistency varies across models and remains understudied. In this paper, we propose two metrics to measure local routing consistency of MoE models: (1) Segment Routing Best Performance (SRP), which evaluates how well a fixed group of experts can cover the needs of a segment of tokens, and (2) Segment Cache Best Hit Rate (SCH), which measures the hit rate of an expert cache utilizing a length of future information under a cache limit. We analyze 20 MoE LLMs with diverse sizes and architectures and use toy models to verify key factors related to local routing consistency. We find a strong trade-off between local routing consistency and local load balance, while showing that global load balance can coexist with local routing consistency. Meanwhile, settings like shared experts that decrease expert combination space can lead to low local routing consistency. We further reveal that domain-specialized experts contribute more to routing consistency than vocabulary-specialized ones, and that most models balance between cache effectiveness and efficiency with cache sizes approximately twice the active experts. These findings pave the way for memory-efficient MoE design and deployment without compromising inference speed. We publish the code for replicating experiments at https://github.com/ljcleo/moe-lrc .